引言:从概念到作品,一次掌握ETL工程师简历核心

在2026年的数据驱动时代,ETL工程师作为数据管道的核心构建者,需求量持续旺盛。然而,一份优秀的简历是敲开理想公司大门的“数据通行证”。本文精准对应你的搜索意图——ETL工程师是什么及其简历范文,旨在为你提供从概念解析到可落地作品的完整指南。我们不仅会阐释这个角色的内涵,更会提供可直接参考的专业简历框架与写作范例,并介绍如何利用现代工具高效产出个性化、高匹配度的简历,助你在数据职场的竞争中脱颖而出。

ETL工程师概念解析:2026年的数据“管道工”与“炼金术士”

在深入简历之前,我们必须清晰理解ETL工程师的定位。ETL,即 Extract(抽取)、Transform(转换)、Load(加载),是构建数据仓库、数据湖及各类数据分析平台的核心流程。

ETL工程师的核心职责是什么?

ETL工程师不仅是技术的执行者,更是业务与数据之间的桥梁。其主要职责包括:

1. 数据抽取:从各类异构数据源(如关系型数据库、NoSQL、API、日志文件、SaaS平台)中稳定、高效地提取数据。

2. 数据清洗与转换:这是价值创造的关键环节。包括处理数据缺失、异常、去重,进行格式标准化、数据聚合、关联,以及根据复杂的业务规则进行逻辑计算。

3. 数据加载与调度:将处理后的数据加载到目标存储系统,并设计可靠的自动化任务调度流程,监控任务执行,保障数据管道的稳定与时效性。

4. 性能优化与故障排查:持续优化数据处理性能,降低成本和延迟,并快速定位和解决管道运行中的问题。

2026年ETL工程师的技能矩阵

技术栈在演进,但核心能力要求愈发清晰:

• 硬技能:精通 SQL 是基石;掌握至少一种脚本语言(Python/PySpark 为主流);熟悉 Hadoop、Spark、Flink 等分布式计算框架;了解主流ETL/ELT工具(如 Airflow, NiFi, dbt, DataStage, Kettle);具备云平台(AWS Glue、Azure Data Factory、GCP Dataflow)使用经验是巨大加分项。

• 软技能与业务理解:强大的逻辑思维与问题解决能力;对数据质量有极高要求;能够理解业务需求,并将其转化为数据逻辑;具备良好的团队协作与沟通能力。

ETL工程师简历怎么写?分步详解与核心模块范例

一份出色的ETL工程师简历,应是一份“数据产品说明书”,清晰展示你构建稳定、高效、有价值数据管道的能力。以下是分模块的写作指南与示例。

第一步:专业摘要——用30秒抓住HR眼球

摘要不是空洞的自我评价,而是高度浓缩的技能与成就概览。对于寻求金融或互联网领域机会的资深人士或转行者,这里需要直击要害。

普通写法:“有经验的ETL工程师,熟悉数据仓库开发,工作认真负责。”

优化范例(瞄准提升回应率):

“拥有5年数据平台开发经验的ETL工程师,精通基于 Hadoop/Spark 生态的分布式数据管道设计与优化。擅长将复杂的业务逻辑转化为高效、可靠的ETL流程,曾主导金融风控数据仓库项目,将核心数据T+1报表产出时间从6小时缩短至1.5小时,保障了每日亿级交易数据的准时交付。熟练使用 Python、SQL、Airflow,并具备阿里云DataWorks与AWS云原生数据服务实战经验。”

第二步:工作经历——用STAR法则与量化成果说话

这是简历的核心。避免写成岗位职责清单,要用“情境-任务-行动-结果”的结构,突出你的行动带来的量化价值。

模块范例:工作经历撰写

**公司名称 | 大数据开发工程师 | 2023.03 – 2026.01**

• 项目:实时用户行为分析数据管道建设

情境与任务:为支持运营实时决策,需将APP端埋点日志(日增量50GB)实时接入数据湖,并产出用户 funnel 分析看板。

行动:设计并实施基于 Flink + Kafka + Hudi 的流式ETL架构。使用 Python 编写数据清洗逻辑,处理乱序与重复数据;通过 Hudi 的 Upsert 功能实现数据湖层级的增量更新。

结果:将数据端到端延迟从 T+1 降低至 5 分钟内,支撑了运营活动的分钟级效果评估;数据管道日均处理记录超100亿条,运行稳定性达99.95%。

• 优化:历史数据批量迁移与性能调优

情境与任务:原有 Hive 查询缓慢,影响分析师效率。

行动:将核心事实表从 Hive 迁移至 Spark SQL on YARN,重构数据倾斜严重的 Join 逻辑,对关键字段建立分区与分桶。

结果:使高频查询的平均响应时间从 120秒 缩短至 15秒 以内,提升了数据团队整体工作效率。

第三步:技能清单——清晰陈列你的“工具箱”

分门别类,便于HR和ATS系统快速扫描。

• 编程与查询语言:SQL(精通),Python(熟练),Scala(了解)

• 大数据框架:Apache Spark(PySpark/Spark SQL),Apache Flink,Hadoop(HDFS, YARN, Hive)

• ETL/调度工具:Apache Airflow(熟练),AWS Glue,Apache NiFi

• 数据库与云平台:MySQL,PostgreSQL;AWS(S3, EMR, IAM),阿里云(MaxCompute, DataWorks)

• 其他:Git,Linux,Docker,数据建模基础

ETL工程师简历范文(2026年专业模板参考)

以下是一份为具有3-5年经验、寻求互联网大厂或金融科技公司机会的工程师设计的简历范文框架。你可以根据自身情况填充具体内容。

个人信息

张伟 | ETL/大数据开发工程师

电话:138-xxxx-xxxx | 邮箱:zhangwei.data@email.com

所在地:上海(可接受远程)

GitHub:github.com/yourprofile(可选,如有优质项目)

专业摘要

专注于构建高可靠、高性能数据管道的大数据开发工程师,拥有4年互联网数据平台经验。深刻理解从数据采集、清洗到服务应用的完整链路,擅长使用 Spark、Flink 等生态工具解决海量数据处理挑战。主导过日处理百亿级数据的实时ETL项目,对性能优化与数据质量保障有丰富实践经验。追求通过卓越的数据工程能力驱动业务增长。

工作经历

**上海某科技有限公司 | 大数据开发工程师 | 2022.07 – 2026.03**

• 实时推荐特征数据管道:基于 Flink 构建实时特征计算平台,处理用户实时点击流,产出低延迟特征供推荐模型使用,将特征更新延迟稳定在2秒内,助推推荐CTR提升3.2%。

• 离线数据仓库层级优化:重构公司核心 ODS-DWD-DWS-ADS 数仓层级,统一数据口径与开发规范。使用 Airflow 编排数千个依赖任务,实现任务全链路监控与自动重试,将任务失败率降低70%。

• 成本优化专项:通过分析 Spark 作业运行模式,对存在数据倾斜的作业进行优化,并推动冷数据归档至低成本存储,季度节省云计算成本约15%。

**北京某数据服务公司 | ETL工程师 | 2020.09 – 2022.06**

• 多源数据集成项目:为某汽车客户搭建企业数据中台,负责从 SAP、MongoDB 及第三方API等10余个数据源抽取数据,使用 Python 和 SQL 进行复杂清洗与一致性整合,最终形成统一的客户360视图。

• 数据质量监控体系搭建:设计并实施数据质量校验规则库,对关键业务表的完整性、准确性、及时性进行每日监控与告警,提前发现并修复多次潜在数据事故。

项目经验(可选,应届生或项目经历突出者可展开)

**基于Spark的电商用户行为分析系统(个人主导)**

技术栈:Spark SQL, Hive, Airflow, MySQL, ECharts

• 负责从原始日志中ETL出用户点击、加购、购买等行为事实表。

• 构建用户留存、商品热度等多维度聚合模型,并产出每日数据报表。

• 项目支撑了运营部门超过80%的日常数据需求。

专业技能

• 大数据处理:Spark (Core, SQL, Streaming), Hive, HDFS

• 数据管道与调度:Apache Airflow, Apache NiFi, Shell脚本

• 编程语言:Python (Pandas, NumPy), SQL (熟练), Java (了解)

• 数据库:MySQL, PostgreSQL, Redis

• 云服务:AWS (EC2, S3, Glue), 阿里云 (ODPS)

• 其他:Git, Linux, Docker, 数据建模

教育背景

**某某大学 | 计算机科学与技术 | 本科 | 2016.09 – 2020.06**

主修课程:数据库系统原理、数据结构、分布式计算

如何高效获得一份专业且个性化的ETL工程师简历?

有了范文参考,下一步是如何将其快速转化为属于自己的作品。传统下载Word模板再修改的方式,不仅耗时,且容易陷入格式调整的泥潭,更难以保证内容与目标岗位的高度匹配。

传统模板的局限与AI简历姬的解决方案

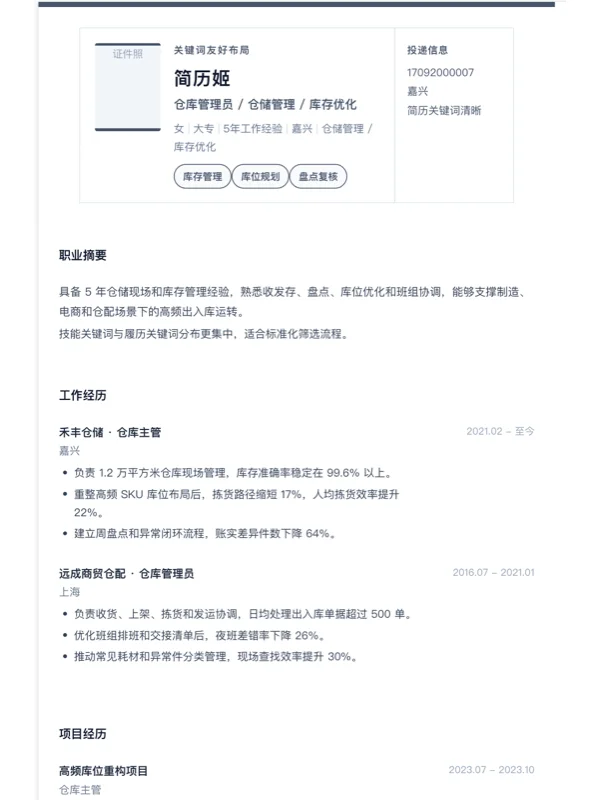

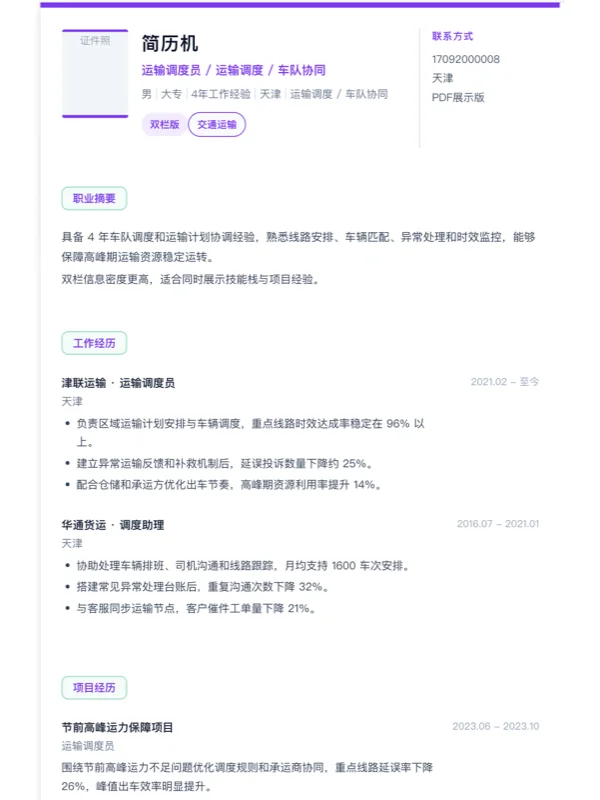

手动套用模板常面临三大痛点:格式排版繁琐、内容与岗位JD匹配度低、成果描述缺乏量化与结构化。为此,更高效的作法是使用 AI 简历姬 这样的智能求职工作台。

使用AI简历姬3分钟生成可投递初稿的核心步骤

其核心理念是“以岗位要求为中心”,让简历制作从“自说自话”变为“精准应答”。

1. 导入与解析:无论你有一份旧简历(PDF/Word皆可),还是从零开始,AI简历姬都能快速将其结构化,提取关键信息。

2. 核心动作:岗位要求关键词对齐:将你心仪岗位的JD(职位描述)粘贴入系统。AI简历姬会做两件关键事:一是分析JD,提取出“Spark优化”、“实时管道”、“数据质量”等技术与业务关键词;二是将你的经历与这些关键词逐条比对,生成匹配度评分与缺口清单,让你清晰知道优化方向。

3. 智能改写与生成:基于缺口分析,系统会引导你补充经历,并利用其量化改写与 STAR 结构化能力,将平淡的描述(如“负责ETL开发”)重写为成果导向的表达(如“设计Spark ETL流程,将日处理任务耗时降低40%,节省计算资源20%”)。整个过程围绕“过筛不秒挂”和“ATS友好”原则进行。

4. 导出与管理:一键导出ATS友好的PDF简历,确保机器可解析。系统支持“一岗一版”多版本管理,并可通过投递看板追踪进展,形成投递复盘闭环。

通过以上步骤,你获得的不仅是一个漂亮的模板,更是一份与目标岗位高度匹配、内容扎实、格式专业的个性化简历,从根本上提升简历筛选通过率。

总结

理解ETL工程师是什么及其简历范文的关键,在于把握其“数据处理与价值转化”的核心定位,并在简历中用具体项目、量化成果和清晰的技术栈来证明这一点。本文提供的概念解析、分步写作指南与完整范文,为你构建了坚实的参考框架。在2026年的求职环境中,效率与精准度至关重要。与其花费大量时间搜索和调整静态模板,更建议你按照上述简历优化思路,使用类似 AI 简历姬 这样的工具,快速完成从岗位分析到简历产出的闭环,让每一次投递都更加有的放矢,从而更快地拿到心仪的面试邀约。

常见问题(FAQ)

1. ETL工程师和数据工程师有什么区别?

两者的界限越来越模糊,但通常可以这样理解:ETL工程师更侧重于特定且核心的“抽取-转换-加载”工作流,是数据管道建设的关键执行角色。而数据工程师的范畴更广,除了ETL,还可能涉及数据架构设计、数据平台搭建、实时计算系统开发、数据运维体系建设等。可以说,一个优秀的ETL工程师是数据工程师的重要组成部分。

2. 对于转行想做ETL工程师的人,简历中最重要的部分是什么?

对于转行者,项目经验和技能清单比传统的工作经历更为重要。你需要在简历中突出:1)通过自学或培训系统掌握的核心技能(如SQL、Python、Spark基础);2)至少1-2个完整的、可演示的数据处理项目(可从Kaggle、天池等平台获取数据集),并在项目描述中清晰体现ETL的逻辑过程;3)任何与数据处理相关的原有工作经验(如使用Excel进行复杂数据分析、运维过数据库等),将其迁移到数据工程的语境下进行描述。

3. 你提供的这份ETL工程师简历范文,可以直接照搬使用吗?

绝对不可以照搬。范文提供的是结构、表述方法和专业度的参考。你必须根据自己的真实经历、技能和应聘的具体岗位来填充内容。简历的灵魂在于真实与匹配。建议使用范文作为框架,但每一个项目、每一条技能、每一个成果描述,都应是个人经历的忠实反映与针对性优化。

4. ETL工程师简历中,需要特别关注哪些ATS(申请人追踪系统)友好细节?

ATS友好是简历能进入人工筛选的前提。需注意:1)格式简洁:使用标准字体(如宋体、黑体)、避免复杂表格、文本框、图片和页眉页脚;2)关键词匹配:在技能、经历描述中自然融入岗位JD中的技术术语(如“Apache Spark”、“数据建模”、“Python”);3)文件格式:提交PDF时,确保是文本型PDF(可从Word另存为时选择“标准”PDF),而非扫描件或图片转换的PDF,以保证文本可被机器抓取。