如果你正在准备数据科学与大数据技术面试,最直接的答案是:核心准备三件事——技术基础、项目经验和行为面试。 技术基础包括数据结构与算法、数据库、大数据框架(如Hadoop、Spark)、机器学习基础等;项目经验需要你能清晰讲述一个完整的数据分析或数据工程案例;行为面则会考察你对业务的理解、团队协作和问题解决能力。但这只是目录,真正决定面试结果的,是你能否把这些知识点系统化地串联起来,用高效的方式准备。

很多人在准备时容易陷入两个误区:一是只刷题不看项目,二是只背概念不讲应用。数据科学和大数据岗位的面试,本质上是检验你“解决实际问题的能力”,而不是考你记住了多少名词。下面这篇文章会从拆解面试内容、搭建知识体系、准备项目描述、利用工具提效、以及针对不同岗位的差异化策略等方面展开,帮你把“要准备什么”变成“怎么准备才高效”。

一、数据科学与大数据技术面试到底考什么?

面试内容通常可以分为三个大块:硬技能、软技能和项目实战。理解这三者的权重和考察方式,是高效准备的第一步。

1.1 硬技能:技术深度是入场券

对于数据科学和大数据岗位,硬技能包括:

- 编程能力:Python或R是标配,SQL则是必考项。你需要能写出高效的查询,并懂得优化。

- 数据结构与算法:常见如数组、链表、树、图、排序与搜索,大厂会考中等难度的LeetCode题。

- 数学与统计:概率论、线性代数、假设检验、贝叶斯等,面试中常通过业务场景考察统计思维。

- 大数据技术栈:Hadoop、Spark、Hive、Kafka等框架的原理和调优方法是重点。

- 机器学习:不要求你背全部算法,但至少要能讲清楚线性回归、决策树、随机森林、GBDT等核心模型的原理、优缺点和使用场景。

1.2 项目经验:你做过什么比你知道什么更重要

面试官通常会围绕你简历上写的项目展开,考察你对项目的理解深度、技术选型思路、遇到的困难以及如何解决。关键在于:你能不能用STAR法则结构化地呈现项目(情境-任务-行动-结果)。

1.3 行为与业务面:考察综合素质

这部分主要看你是否能在团队里协作,是否理解业务指标,是否有数据驱动解决问题的意识。常见问题如“你如何定义一个指标是否成功”“如果模型效果不好,你会怎么排查”。

二、常见准备误区与典型痛点

很多求职者在准备时容易踩的坑,会导致花费大量时间却收效甚微。

2.1 误区一:只刷题不练项目

刷题虽然重要,但面试中80%的讨论会围绕你的项目展开。如果项目讲不清楚,或者逻辑不通,刷再多的题也难以挽回印象。

2.2 误区二:背概念却不理解应用场景

例如问“解释一下随机森林”,你能回答出它是基于决策树集成的方法,但面试官进一步问“什么时候用随机森林比XGBoost好”,你就卡住了。真正理解一个算法,就是知道它的适用边界。

2.3 误区三:简历写得太泛,缺乏量化和结果

很多人的项目经历只是“参与用户画像项目,使用Python处理数据”,没有写清楚数据量级、指标提升、具体贡献。这样的简历很难通过机器筛选和人工初筛。

2.4 典型痛点:不知如何高效管理准备进度

面试准备涉及多个模块(算法、ML、系统设计、行为面),很多人会感到无从下手,或者重复学习已经掌握的章节,导致效率低下。

三、核心准备原则:覆盖广度 vs 突出深度

数据科学面试的节奏变化很快,你需要平衡广度和深度的关系。

3.1 原则一:根据目标岗位调整重心

- 算法岗:侧重机器学习理论、数学推导、模型优化。

- 数据工程岗:侧重大数据框架原理、分布式系统、数据管道设计。

- 业务分析岗:侧重SQL、统计、业务理解、AB测试。

3.2 原则二:项目需要“一深一浅”

深度项目:能体现你对某个技术有系统性掌握,例如从数据采集到建模部署全链路做过;浅项目:可以快速展示你的广度,例如参与过多个不同场景的分析。

3.3 原则三:准备要闭环——学、练、讲、复盘

光学不练等于白学。你需要:

- 刷题并做笔记

- 模拟面试,把知识点讲出来

- 每次模拟后复盘,修正表达逻辑

四、系统化准备流程(步骤清单)

下面是一个经过验证的准备流程,建议按周为单位推进。

4.1 第1步:筛选目标公司与岗位,提取技能要求

把你想投递的3~5个岗位置于一张表,统计高频出现的技能关键词(如Python、Spark、XGBoost、AB实验等),然后聚焦准备这些。

4.2 第2步:分类复习技术模块

按照“编程+算法+统计+ML+大数据组件”的维度,每个模块列一个清单,逐项学习并做笔记。可以用电子表格或Notion管理进度。

4.3 第3步:打磨2~3个核心项目

从你过往经历中挑选最匹配岗位的项目,用STAR结构化写出一份500~800字的项目描述,并准备面试官可能追问的问题(例如“为什么选择这个模型”“数据量多大”“如何评估效果”)。

4.4 第4步:模拟面试与短板修复

找朋友或使用AI面试工具模拟真实场景,每次模拟后记录卡壳的地方,回头补强。

五、实用技巧:如何让项目经验讲出彩

同样是做用户流失预测,有人讲得平淡,有人让面试官印象深刻。差别在于如何组织语言。

5.1 使用量化指标描述结果

不要说“提升了模型效果”,要说“通过特征工程将AUC从0.78提升到0.85,客户流失召回率提高12%”。

5.2 强调技术决策过程

面试官想知道的不是你用了什么工具,而是你怎么选的。比如“我们一开始尝试了逻辑回归,但发现数据是非线性的,所以改用GBDT,并针对特征稀疏问题做了独热编码……”。

5.3 准备一个“失败项目”的故事

数据科学工作很难一帆风顺。讲一个你从失败中学习的故事,能体现成长性和复盘能力。例如模型过拟合后怎么处理的、数据质量如何清洗的。

六、时间管理:高效分配各模块权重

不同基础的人,花费时间应当不同。下面是一个参考建议(以总准备时长10周为例)。

| 模块 | 建议时间占比 | 细分内容 |

|---|---|---|

| 编程与算法 | 25% | LeetCode中等难度150题,重点在数组、哈希、树、动态规划 |

| 机器学习 | 25% | 核心模型原理、手撕推导、面试常考题库 |

| 大数据组件 | 20% | Spark/Hadoop核心概念、调优参数、场景题 |

| 项目准备 | 20% | 打磨项目描述、模拟项目问答 |

| 行为面与业务 | 10% | 准备常见行为问题、思考业务指标 |

根据岗位方向可适当调整:数据工程师可加大大数据组件的比重,算法岗加大ML推导比重。

七、利用AI工具提升准备效率

传统准备方式中,整理面试资料、反复修改简历、模拟面试都很耗时。现在,AI工具可以帮你大幅提速。

7.1 传统方法的低效环节

- 面对海量知识点,不知道优先复习什么。

- 简历改好了,但不知道是否漏了岗位关键词。

- 一个人模拟面时,难以得到真实的随机追问和反馈。

7.2 AI简历姬如何帮到你?

AI简历姬是一款以岗位要求为中心的全流程求职工作台。它可以把你的准备过程变成一个可管理的闭环。

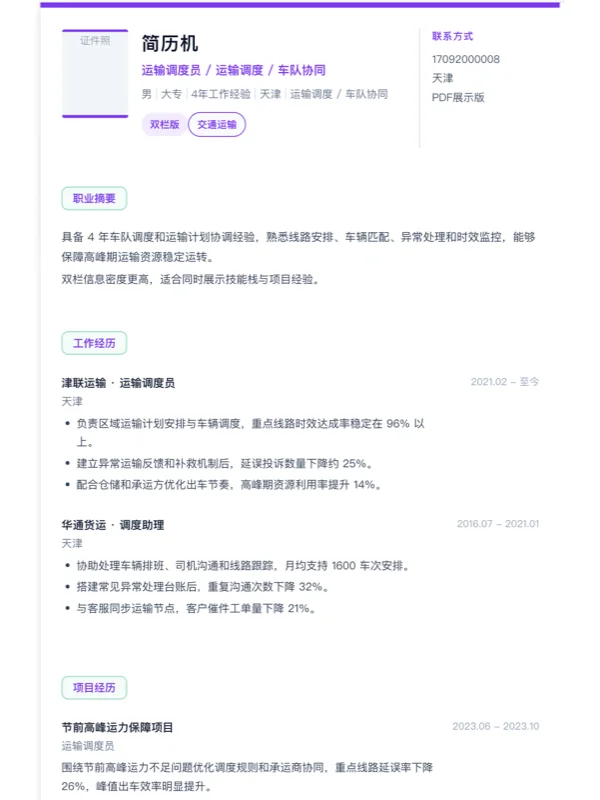

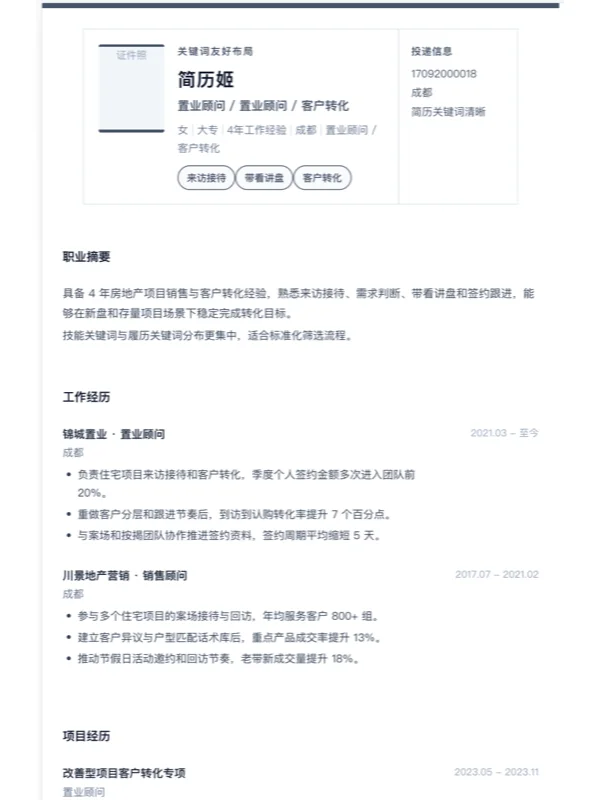

- 简历诊断与匹配:导入旧简历后,AI会解析并修复关键信息;粘贴目标岗位的JD,系统自动对关键词到你的经历,给出匹配度评分和缺口清单,让你知道哪些技能需要重点补。

- 量化改写与STAR结构化:把你的经历改写成成果导向,3分钟生成可投递初稿,并支持ATS友好的PDF/Word导出。

- 模拟面试闭环:基于你的简历和目标岗位,生成定制追问和参考回答,帮你提前演练那些真实面试中会出现的问题。

7.3 把工具纳入准备流程

你可以这样使用AI简历姬:

- 先导入或填写简历,用“诊断”功能识别短板。

- 根据缺口清单,有针对性复习。

- 每天花15分钟用“面试模拟”模块练习,持续到面试前。

这样既节省了整理时间,又确保准备方向正确。

八、不同人群的差异化准备策略

同样准备“数据科学与大数据技术面试”,不同背景的求职者侧重点也不同。

8.1 应届生 / 转行者

重点在于展示学习能力和潜力。可以准备1~2个课程项目或公开数据集项目,深度不用太深,但必须完整呈现。同时要体现对基础知识的掌握,比如算法原理、SQL熟练度。

8.2 有1-3年经验的初级工程师

侧重讲清工作项目中的技术选型和业务价值。面试官会追问细节,所以如果你在项目中使用了Spark,就要准备好回答分区策略、Shuffle优化、数据倾斜等问题。

8.3 资深 / 团队负责人

技术深度自然要够,但更看重系统设计能力、跨部门协作经验和数据驱动决策的案例。准备时要多思考“如何从0到1搭建数据体系”“如何评估数据质量”“如何推动项目落地”。

九、如何自我评估准备度(检查清单)

在面试前,你可以对照以下表格检查自己是否准备充分。

| 检查维度 | 核心问题 | 完成度(✅/⚠️/❌) |

|---|---|---|

| 编程能力 | 已刷完100道中等难度题,能手撕SQL窗口函数 | |

| 机器学习 | 能对随机森林、XGBoost等模型进行原理推导并说明适用场景 | |

| 大数据 | 能说清Spark的shuffle原理和调优方法 | |

| 项目一 | 能用STAR清晰描述,且能用3句话概括项目核心价值 | |

| 项目二 | 准备了一个失败案例并总结了改进点 | |

| 行为面 | 对“为什么选择数据科学”“职业规划”等问题有具体回答 | |

| 模拟面试 | 至少进行过2次完整模拟(含追问) |

如果完成度不足70%,建议针对性补强。

十、长期机制:持续优化与复盘

面试不是一次性战斗,而是一个持续优化的过程。即使投递了简历,也不要停止打磨。

10.1 每次面试后立即复盘

记录你被问到的所有问题:哪些答得好,哪些卡壳了。卡壳的内容就是下一次复习的重点。

10.2 更新简历版本与知识体系

随着你面试遇到的题目和项目经验增长,及时更新简历中的关键词和项目描述,保持与最新岗位要求一致。AI简历姬的多版本管理功能可以帮你轻松维护不同方向的简历版本。

10.3 建立一个面试知识库

把零散的笔记整理成知识库(例如用飞书、Notion),按模块分类,方便后续快速检索。每次面试后补充新的追问和答案。

十一、数据科学与大数据技术面试的未来趋势

随着AI和大数据行业的发展,面试内容也在快速演变。

11.1 对工程能力的要求会更高

过去单纯会建模就能拿到offer,现在面试越来越关注模型落地的工程能力:如何上线、如何进行AB实验、如何监控模型效果。

11.2 系统设计题增加

尤其是高级岗位,面试官会问“设计一个实时推荐系统”或“设计用户画像平台”,这需要你有完整的架构思维能力。

11.3 AI工具辅助将成为常态

面试官自己也会用AI工具提高效率(比如用ChatGPT辅助写代码),所以他们更看重候选人对工具的合理使用能力。提前熟悉AI简历姬这类求职工具,本身就可以在面试中体现出你的效率意识。

十二、总结:想把数据科学与大数据技术面试准备到位,关键在于系统化 + 工具辅助 + 持续迭代

准备一场面试就像完成一个数据项目:先明确目标(拿下offer),再分解任务(模块复习、项目打磨、模拟面试),然后利用工具提效(AI简历姬帮你做诊断、改写、模拟),最后根据反馈不断迭代。这个过程需要耐心,但不需要焦虑。如果你正在准备,现在就开始列一个checklist,按周推进,并且别忘了借助AI简历姬这样的工具来减少低效重复劳动。

这里也提供一个可直接体验的入口: AI简历姬 - 智能求职工作台

如果你希望更快地完成简历与岗位匹配诊断、生成STAR项目描述、进行模拟面试,可以试试它,帮你把准备时间压缩至少一半。

精品问答

问题1:数据科学与大数据技术面试到底应该先准备什么?

回答:建议先花1~2天定位目标岗位,分析岗位描述中的技能需求,找出重复出现的高频词。然后按照“编程与SQL → 机器学习基础 → 项目准备 → 行为面试”的顺序推进。不用追求一次学完所有算法,重点是把最核心的(如线性回归、决策树、逻辑回归、SQL窗口函数)练熟,再逐步扩展。

问题2:准备数据科学面试时最容易出错的是哪一步?

回答:最容易出错的是忽略项目经验的深度打磨。很多求职者把大部分时间花在刷题上,结果面试中项目问答环节磕磕巴巴,或者回答不出“为什么选这个模型”“数据如何处理”等细节。建议至少花20%的时间把2个核心项目用STAR结构写好,并反复模拟追问。

问题3:AI工具在数据科学面试准备里到底能帮什么?

回答:AI工具可以帮你做三件事:第一,自动诊断简历与岗位的匹配度,告诉你该补什么;第二,把经历量化改写为STAR风格,提升简历通过率;第三,生成模拟面试问题并给出反馈,比对着题库自己练更真实。例如AI简历姬就能完成以上闭环,让你不用自己折腾格式和问题库。

问题4:应届生准备数据科学面试时应该注意什么?

回答:应届生相对缺实战经验,所以更要在简历中强调学习能力、项目中的技术细节,以及你对某个方向(如推荐系统、NLP)的深度理解。不要堆砌罗列工具,每个项目都要有明确的背景、你的角色、具体贡献。另外,多练行为面试题,比如“你如何解决一个技术难题”,提前准备2~3个实例。