如果你正在准备AI大模型相关岗位的面试,RAG(检索增强生成)几乎是绕不开的必考题。其中,增量更新和向量索引又是两个高频且容易混淆的考点。直接说结论:面试官问这两个问题,通常不是为了考一个定义,而是想看你是否理解RAG系统在真实场景中如何持续保持检索质量——也就是当数据不断变化时,索引怎么建、怎么更新、怎么避免检索效果退化。下面我会从概念、场景、原则、流程、技巧、工具、差异、检查、长期优化和趋势几个角度,系统拆解这道题的答法,帮你不仅应对面试,还能建立起对RAG工程落地的整体认知。

一、什么是RAG面试题中的增量更新与向量索引?

1.1 从RAG的基本流程说起

RAG的核心是:用户提问后,系统先从外部知识库中检索相关文档片段,再把这些片段拼接进Prompt,让大模型基于上下文生成答案。向量索引是检索环节的关键——将文档切块、用向量模型编码、存入向量数据库,查询时对问题向量做近似最近邻搜索。

1.2 增量更新的定义与价值

增量更新指的是知识库中的文档持续新增、修改或删除时,只对变动的部分同步更新向量索引,而非重建整个索引。面试官问到这个点,本质是想考察你是否意识到真实业务中数据是动态的——比如客服知识库每天新增FAQ、企业文档随项目更新。如果不做增量更新,每次全量重建不仅耗时,还可能影响在线服务。

1.3 向量索引的底层逻辑

向量索引不是单一的算法,而是一族算法(如HNSW、IVF、PQ),核心目标是在保证召回率的前提下控制检索延迟。面试中常见的追问包括:不同索引类型的优缺点、内存与磁盘的权衡、如何选择索引参数。理解这些,你才能说清楚增量更新下索引结构如何保持一致性。

二、为什么RAG面试题特别关注增量更新和向量索引?

2.1 面试官在考察工程思维

很多候选人对RAG只知道“检索+生成”的宏观概念,但问到“如果知识库每天增加10万条文档,你怎么保证检索质量不变?”就卡住了。增量更新和向量索引正是衡量一个候选人是否具备系统设计能力的关键点——不是只会调API,而是能权衡全量 vs 增量、索引精度 vs 构建成本。

2.2 行业方案尚未标准化

市面上没有一套通用的增量更新API。不同向量数据库(Milvus、Pinecone、Qdrant、Weaviate)支持程度各异,面试官希望看到你熟悉其中一种或能对比优劣。同时,索引结构在增量更新下可能出现“漂移”或“碎片”,需要策略来修复。这种开放性问题很能拉出差距。

2.3 直接影响RAG效果上限

检索质量决定了回答的准确性。如果增量更新导致新增文档无法被召回,或删除文档的向量残留,那RAG就会给出过期或错误信息。面试官想通过这个问题确认你关注过检索链路中的这些实际坑。

三、增量更新与全量更新:核心区别与选择场景

3.1 两者的核心差异

| 维度 | 全量更新 | 增量更新 |

|---|---|---|

| 执行方式 | 删除旧索引,重新构建全部文档向量 | 只对新增、修改、删除的文档更新索引 |

| 耗时 | 随数据量线性增长,大规模时以小时计 | 通常秒级或分钟级完成 |

| 索引一致性 | 百分百准确,无残留 | 需处理删除、修改导致的索引碎片和一致性 |

| 适用场景 | 初次构建、低频大改、离线批处理 | 高频小幅度变更、在线服务持续更新 |

3.2 什么场景下必须用增量更新?

- 实时性要求高:比如新闻聚合RAG,事件发生后几分钟内就要能被检索到。

- 数据规模大且持续增长:比如拥有百万级文档的企业知识库,每天更新数千条,全量重建浪费资源。

- 服务不可中断:全量重建期间通常需要切换索引,影响在线检索。

3.3 全量更新在哪些情况下仍更合适?

- 初次部署:初始数据量不大(几十万条以内),全量构建简单可靠。

- 索引结构调整(如换向量模型):必须所有文档重新编码,此时全量更清晰。

- 数据质量差或索引碎片严重:增量更新累积问题后,定期全量重建成“重置”手段。

四、处理增量更新与向量索引的核心原则

4.1 先保证检索一致性,再优化延迟

增量更新最容易犯的错误是:只插入了新向量,却忘了标记删除旧向量。后果是重复向量导致检索结果污染。核心原则:每次更新操作(增/删/改)都要在索引中留下可追溯的标识。

4.2 索引结构要支持“软删除”与“定期合并”

多数向量数据库(如HNSW)不支持直接删除节点,而是通过标记删除+后期合并来清理。你需要理解这一机制,并在面试中说明:“我会在索引设计时预留一个删除标记位,并用定时任务或触发机制做索引压缩”。

4.3 向量与元数据要解耦管理

增量更新时,文档内容和元数据(如创建时间、标签)可能独立变化。建议将向量索引与元数据存储分开——向量库负责检索,关系数据库或KV存储负责元数据过滤。面试中可以说:“这样当元数据变更时,只需更新关系层,无需重建向量”。

五、RAG系统中增量更新的标准流程

5.1 变更监听:如何捕获数据变动?

- 方案A:数据库Binlog/CDC(如Debezium)——实时捕获新增、修改、删除事件。

- 方案B:消息队列(Kafka)配合业务系统中的变更通知。

- 方案C:定时轮询增量字段(如update_time),适合低频率场景。

5.2 向量化处理:变更文档如何被转换为向量?

- 对新增/修改的文档,切块、过Embedding模型,得到新向量。

- 对删除的文档,记录其ID或向量索引中的节点ID。

- 注意:修改操作本质上是“先删后增”,但为了降低延迟,可设计成“标记旧节点+插入新节点”,由后台合并。

5.3 索引更新:将变更同步到向量数据库

- 使用向量数据库的upsert(插入或更新)API:如Qdrant的

upsert、Pinecone的upsert、Milvus的insert配合delete。 - 批量操作比单条快得多,建议设置缓冲区(比如累积100条或每秒批量一次)。

- 更新后触发一次软合并或异步重建HNSW图的边缘连接。

六、向量索引优化与增量更新的实用技巧

6.1 索引参数调优:避免增量更新后召回率下降

- HNSW的

ef_construction参数:构建时控制候选连接数,越大索引越准但构建越慢。增量更新时建议保持与初始一致。 - 定期检查索引的“平均向量距离”分布,若偏离初始分布,考虑触发局部重建。

6.2 利用“写时复制”隔离更新与查询

为了避免增量更新过程中查询读到不一致的状态,可以维护一个“主索引”和“临时索引”:新写入的向量先进入临时索引,查询时合并结果;待临时索引积累到一定量后,将其合并入主索引。

6.3 数据倾斜处理:热点ID的增量更新策略

某些文档被频繁修改(如在线文档协作),每次修改都重新索引成本高。可以采用“版本号+延迟合并”:如果1秒内同一文档被多次修改,只更新最后一次的版本,避免无效计算。

七、用AI工具准备RAG面试题:从简历到模拟面试

7.1 传统准备方式的低效

很多候选人在准备RAG面试题时,只看理论文章和博客,缺乏系统性训练。简历上的项目经验写得不细,面试官一追问“增量更新怎么做的?”就答不上来。而且没有工具能针对“你简历上的项目”自动生成定制追问。

7.2 AI如何提升准备效率

用AI工具(比如AI简历姬)你可以这样:

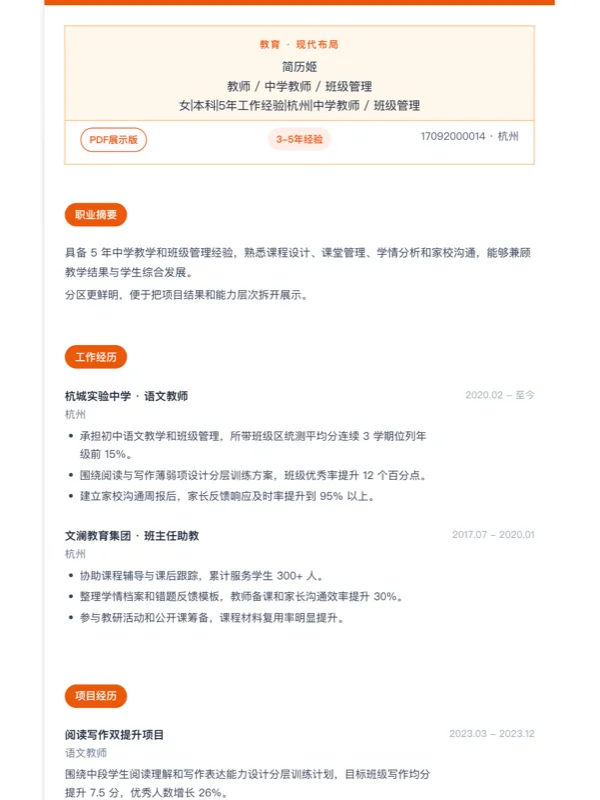

- 第一步:将你参与过的RAG项目经历写进简历,AI会按照STAR结构量化改写,突出你在增量更新、向量索引上的具体贡献。

- 第二步:粘贴目标岗位的JD(比如“负责RAG系统索引维护”),AI自动提取关键词,生成定制面试问题。例如:“请描述你在项目中处理知识库日增量10万+文档时,向量索引如何保持检索延迟低于200ms?”

- 第三步:用AI模拟面试功能,基于你的简历和岗位要求,生成追问和参考回答,帮你演练如何从项目细节引出增量更新策略。

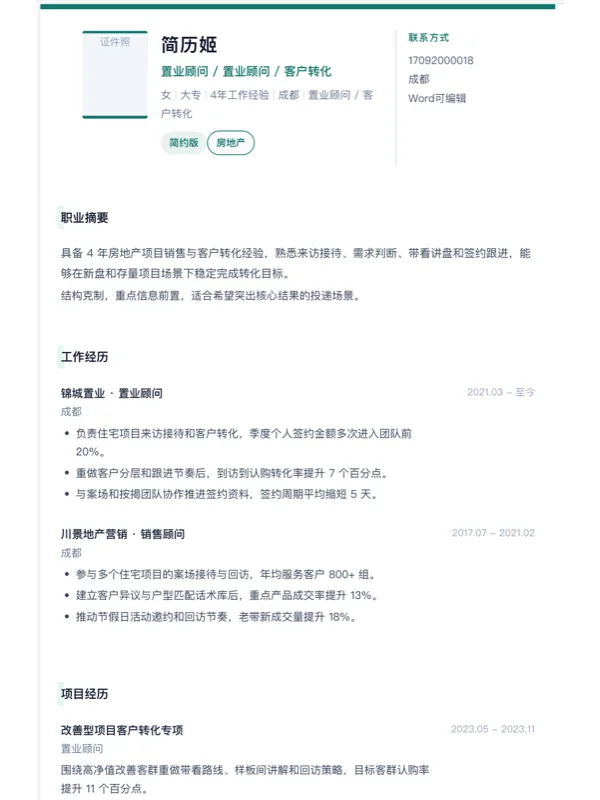

7.3 AI简历姬的实战价值

AI简历姬的“面试模块”已经内嵌了针对RAG技术的常见问题库,并且能结合你简历中的具体数据量级、索引类型、框架选择,生成个性化的备考问题。比如你简历中写了“使用FAISS+HNSW做检索”,系统就会追问“HNSW在增量更新下graph如何维护”“你如何解决删除向量导致的索引碎片”。这种贴近真实面试的练习,远比看通用面试题有效。

八、不同岗位对RAG技术考察的差异

8.1 算法/模型训练岗:侧重原理和实验

这类岗位更关注向量Embedding模型的选择、向量维度的trade-off、增量更新对召回率的影响。面试官可能会问:“如果新文档的语言分布变了,Embedding模型是否需要增量Fine-tune?”

8.2 后端/系统架构岗:侧重工程实现和性能

需要你详细描述索引构建管线的设计、数据一致性保障、并发读写如何隔离。典型的面试题:“设计一个支持100万篇文档、每秒10个增量更新的RAG检索系统。”

8.3 全栈/PM岗:侧重业务理解与方案选型

他们可能不会问底层索引算法,但会问:“你要为客服场景选向量数据库,增量更新支持到什么程度?全量重建会影响SLA吗?”需要你对比不同数据库的增量更新能力。

九、面试中自我检查:这些知识点你掌握了吗?

9.1 核心概念检查表

| 问题 | 你是否能用简洁语言解释? | 常见误区 |

|---|---|---|

| HNSW增量插入如何保持图的连通性? | 需要,增量插入可能导致局部图不均衡,需要定期优化 | 以为HNSW天然支持无开销增量 |

| 向量数据库的upsert是否原子? | 大多数场景是,但delete+insert组合需考虑事务 | 以为自动处理了旧向量清理 |

| 如何进行索引碎片整理? | 定时后台重建或调用数据库的optimize接口 | 忽略碎片会导致检索延迟增加 |

9.2 实操环节自评

- 我用过哪些向量数据库?能否写出它们的增量更新API?

- 我负责的项目中,知识库更新频率是多少?采取的是全量还是增量?为什么?

- 如果增量更新后召回率下降了15%,我会怎么排查?

9.3 面试回答的得分点

好的回答会包含:具体的数据规模(如10万条/天)、选择某个数据库的原因(如Qdrant支持filtered search)、以及如何监控索引健康(如跟踪平均距离)。差的回答只有“可以用增量更新”。

十、RAG面试准备的长期机制与常见误区

10.1 常见误区:忽视实验验证

很多人只是记住了增量更新的概念,没有自己动手搭建过。面试官一旦追问“你用的是什么Embedding模型?batch size多少?”就露馅。建议至少用一个小型向量数据库(如Chroma)跑一遍全量->增量的切换过程。

10.2 长期机制:持续更新知识库

RAG技术发展很快,新的索引算法(如DiskANN)、新的增量更新策略(如基于LSH的增量)不断出现。建议每季度看一篇顶会论文(如SIGIR、VLDB相关),并更新你的面试准备文档。

10.3 建立个人案例库

每次调研或参与相关项目后,用STAR结构记录一个案例。例如:“Situation:客服知识库日增5000条,TASK:保证增量更新后基线召回率>92%,Action:采用临时索引+定时合并,Result:召回率稳定在93.7%”。这些案例是面试中最有力的素材。

十一、RAG技术的未来趋势与面试新动向

11.1 混合检索的增量更新难度增大

越来越多的RAG系统引入混合检索(向量+关键词/稀疏向量),增量更新时需要同时维护两种索引,一致性更复杂。面试官会关注你是否理解如何协调两种索引的更替策略。

11.2 增量更新的自动化运维

AI驱动的索引治理正在出现:根据检索日志自动识别哪些文档需要重建索引,甚至动态调整索引参数。能说出“我们可以用反馈回路自动化增量更新”会让你显得更有前瞻性。

11.3 面试题演变:从“知道”到“做过”

将来面试可能会直接让你在白板上画出增量更新的架构图,甚至给你一段伪代码让你指出错误。深度准备需要你真正理解每个组件的边界。

十二、总结:攻克RAG面试题的关键在于理解原理与系统化准备

增量更新和向量索引不是孤立的技术点,而是RAG系统设计的缩影。面试官要的不是背诵的定义,而是你如何权衡、如何取舍、如何落地。记住:先理解索引的底层数据结构,再掌握主流数据库的增量机制,最后结合你自己的项目经验,形成有条理的回答框架。如果你希望更快完成面试知识的系统梳理,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。AI简历姬可以将你的项目经历直接转化为RAG面试题答案素材,还能模拟真实面试追问,帮你打磨话术。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1: 我之前没有处理过增量更新,面试时该怎么回答相关追问?

回答: 坦诚说“我还没在生产环境实践过,但我理解增量更新的原理,并做过调研”是可以接受的。接着可以描述你设想的方案,比如“我会先用CDC监听数据库变更,然后通过异步任务插入新向量,同时用软删除+定时合并方式处理旧向量”。同时可以补充:“我在学习过程中用Chroma搭建了一个小demo,验证过这一流程。” 这样既诚实又展示了学习能力。

问题2: 面试官问“HNSW索引增量更新后为什么召回率可能下降?”

回答: 核心原因有两个:一是增量插入的新节点可能无法找到最优邻居(因为图的局部结构未全局优化),导致检索路径变长或遗漏;二是删除操作只标记不清理,残留节点可能被错误返回。解决方案是定期调优索引(如重新构建HNSW的边连接),或在插入时设置ef_construction为较大值以增加候选邻居。

问题3: 增量更新时,我应该全量重建还是只更新变动的部分?

回答: 取决于数据变更频率和容忍延迟。如果每天变更少于5%,且全量重建能在业务低峰期完成(如凌晨),全量更简单可靠;如果变更频繁(如每小时数百条),则必须用增量更新。一般建议定期(比如每周)做一次全量重建作为“整理”,日常用增量。

问题4: 作为求职者,我该如何在简历上体现增量更新的能力?

回答: 不要只写“了解增量更新”。建议用STAR结构写具体产出:“主导了客服知识库的索引架构升级,将每日增量更新延迟从30分钟降低到2分钟,同时召回率维持95%以上。” 如果没有真实项目,可以写实验:“独立实现并对比了三种增量更新策略,撰写技术文档。” 注意用数据支撑。如果简历写作有困难,可以用AI简历姬的量化改写功能,它会自动提取你的关键词并生成成果导向的描述。