如果只说结论:数据科学与大数据技术领域的简历,核心不在于列出你学过多少算法或工具,而在于你能否让HR和ATS(自动简历筛选系统)在8秒内识别出“你能解决业务问题”。 对准备进入这个领域的人来说,先想清楚“我解决过什么问题”比“我掌握多少技能”更关键,再按“岗位要求关键词对齐→经历量化→STAR结构化”的顺序处理,通常比一上来就堆砌项目列表更有效。

很多同学在写数据科学简历时,卡住的不是没有项目,而是不懂重点该放哪个部分。真正决定这份简历能否通过初筛的,往往是关键词覆盖度、量化程度和成果导向这三个环节。下面我会拆解完整的写作方法,并用AI简历姬这类工具帮你提效。

一、数据科学简历到底是什么?为什么与普通简历不同?

1.1 它不是技能清单,而是“证据链”

数据科学与大数据技术岗位的简历,本质是向招聘方传递一份证据:你能用数据解决业务问题。普通简历可以泛泛写“熟练使用Python”,但数据科学简历必须写“用Python开发了一个预测模型,将客户流失率降低了12%”。招聘方想看的是你如何将技术转化为业务价值。

1.2 为什么需要专门优化?因为ATS机器阅读

大中型企业常用ATS系统初筛简历。ATS会扫描简历中的关键词(如“随机森林”“Spark”“A/B测试”),并计算与岗位描述的匹配度。如果简历没有精准对齐JD关键词,很可能在机器筛选中直接被淘汰,连HR都看不到。

1.3 与普通开发岗简历的核心区别

| 维度 | 普通开发岗简历 | 数据科学简历 |

|---|---|---|

| 重点 | 框架、代码量、项目经验 | 分析方法、模型效果、业务洞察 |

| 量化指标 | 性能提升(如响应时间减少XX%) | 业务指标改善(如转化率提升XX%) |

| 关键词类型 | 语言/框架名、系统架构 | 算法名、统计方法、业务领域词 |

| 项目描述风格 | 功能实现为主 | 假设驱动、实验设计、结果分析 |

二、常见误区:哪些写法会让简历快速被刷?

2.1 误区一:只列技能不写场景

很多简历写“精通Python、TensorFlow、SQL”,但HR无法判断你是在什么场景下使用的。正确的做法是:每个技能都要有对应的应用实例。例如:“用Python构建时间序列预测模型,帮助库存周转率提升20%”。

2.2 误区二:项目描述写成流水账

“我参加了Kaggle比赛,用XGBoost预测房价”这种描述过于模糊。需要具体说明数据规模、特征工程方法、调参策略、最终得分排名等。比赛经历需要突出“你在团队中的角色”和“你的独特贡献”。

2.3 误区三:忽略“业务关联”

纯技术描述如“使用CNN进行图像分类”很好,但如果应聘的是金融风控岗位,最好能关联业务场景:“使用CNN对交易图片进行分类,识别欺诈交易准确率达到95%”。HR想看到你理解业务。

三、核心原则:让简历能同时过ATS和HR的眼

3.1 关键词对齐:先分析JD再动笔

拿到岗位描述后,用高亮标记出所有技术名词(如Python、SQL、机器学习算法)、业务名词(如用户增长、风控、推荐系统)和软技能(如团队协作、沟通能力)。你的简历必须自然出现这些词,并放在醒目的位置(工作经历、项目描述)。

3.2 量化优先:每个成就都要有数字

数据科学是极度依赖数据的领域,简历也必须数据化。避免“做出显著提升”,改成“提升23%”。数字让评价变得具体可比较。

3.3 STAR结构:将经历故事化

S(情境): 项目背景是什么?T(任务): 你需要解决什么问题?A(行动): 你做了什么?用了什么方法?R(结果): 取得了什么量化成果?每个项目点都可以按这个逻辑展开。

四、方法论:从JD到简历的完整推演流程

4.1 第一步:解构JD关键词

假设JD要求:“熟悉机器学习算法,能独立完成数据清洗和特征工程;有海量数据处理经验;熟悉Spark或Flink”。那么你的简历应包含:具体机器学习项目(含算法名)、数据清洗经历(如缺失值处理、异常检测)、Spark/Flink使用场景。

4.2 第二步:匹配个人经历

对照JD关键词,回顾你的项目、实习、课程作业或比赛,找出每一条可以对应的经历。如果没有完全匹配的,可以强调相关的技能或项目,例如用SQL处理过百万级数据,也可以体现“海量数据处理”能力。

4.3 第三步:量化改写(STAR+数字)

原始描述:“用Python分析用户数据” → 改写后:“用Python(pandas、scikit-learn)分析了50万用户行为数据,构建RFM模型,识别出高价值客户群体,运营活动响应率提升35%”。

五、标准流程:五步写出可投递的数据科学简历

5.1 准备素材清单

收集所有相关经历:学历、实习、项目、竞赛、证书、论文、技术博客。对每个经历,记录:所用工具/算法、数据规模、团队角色、量化成果。

5.2 选择简历模板

不要使用双栏、图表、不规则的模板,这些会被ATS解析错误。推荐单栏、标题清晰、无表格的简约模板。字体用Times New Roman或Calibri,字号10-12。

5.3 撰写各板块

- 个人信息:姓名、电话、邮箱、LinkedIn/GitHub链接(注意链接有效性)。

- 教育背景:学校、专业、GPA(若较高)、相关课程(如机器学习、统计、数据库)。

- 技术技能:分类列出,如编程语言(Python、R、SQL)、框架(TensorFlow、Spark)、工具(Tableau、Git)。每项技能后面建议附上熟练程度或案例。

- 工作/项目经历:按时间倒序,每个点用STAR结构。

- 荣誉/证书/论文:若有顶会论文或竞赛排名,单独列出并突出。

5.4 关键词检查与优化

将JD关键词列表逐一与简历对照,确保覆盖率超过70%。未覆盖的词,考虑是否可以通过修改措辞或增加项目描述来补上。

5.5 导出ATS友好格式

保存为PDF时,确保文字可选中而非图片。导出前检查:所有文字是否可复制?字体是否嵌入?文件名不要用“简历.pdf”,建议用“姓名_数据科学家_公司名.pdf”。

六、实操技巧:让经历表述更吸睛

6.1 使用强动词开头

“负责数据分析”→“主导了用户留存分析”、“构建了流失预警模型”。使用“设计”“开发”“优化”“实施”“领导”等动词,体现主动性。

6.2 突出“对比”效果

“准确率85%”→“相对于基线模型提升15%”,“处理时间5分钟”→“将处理时间从30分钟降至5分钟”。对比让成果更突出。

6.3 控制篇幅:单行原则

每个项目点最好控制在1-2行内,太长的描述HR不会细看。使用短句、只有关键词保留。例如:“基于LSTM的异常检测模型,在支付场景中召回率92%,误报率降至3%/天”。

七、AI工具提效:3分钟完成简历初稿

7.1 传统方式效率低

手动写数据科学简历,从整理经历、对齐JD、逐条改写到调格式,通常需要4-8小时。反复修改几个版本后,容易漏掉关键词或格式错乱。

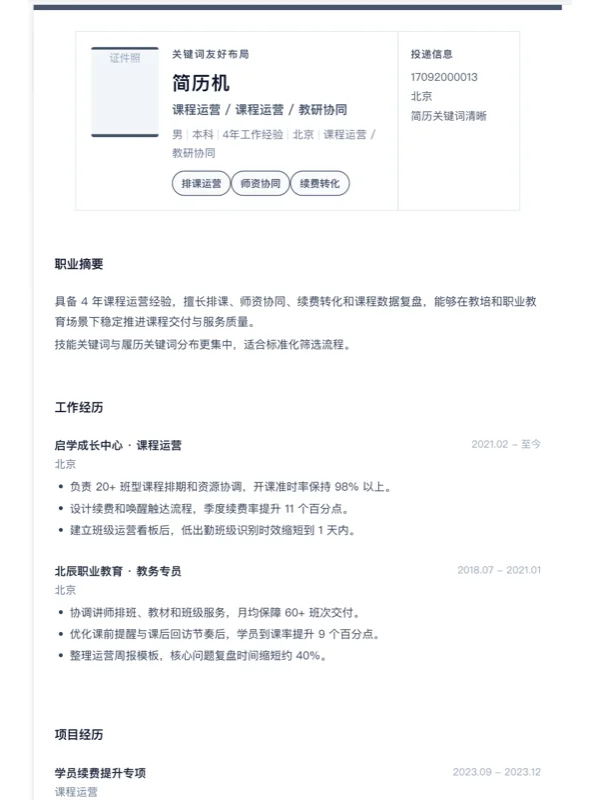

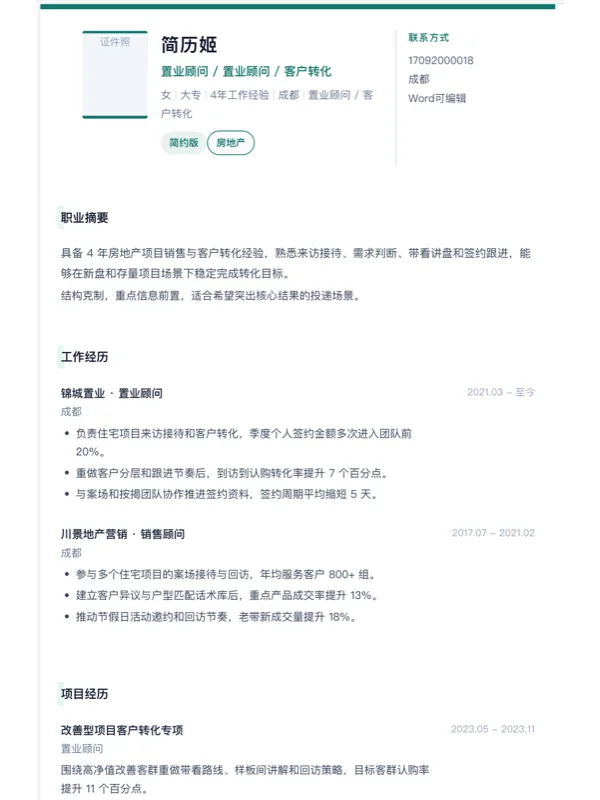

7.2 AI简历姬如何提效

AI简历姬是一个以JD为中心的简历工作台。它的核心逻辑是“先诊断再改写”,确保简历不会因为关键词缺失或结构问题被机器筛掉。

具体来说:

- 导入旧简历:支持PDF和Word,系统自动结构化解析,修复关键信息。

- 粘贴岗位要求:系统自动提取JD关键词,并与你的经历逐条对齐,给出匹配度评分和关键词缺口清单。

- 量化改写:将经历按STAR结构进行成果导向改写,3分钟生成可投递初稿。

- ATS友好校验:导出PDF时确保文字可抓取,模拟ATS解析效果。

7.3 配合人工微调效果更好

AI简历姬生成初稿后,建议你再手动补充一些独特性细节(如实验方法、具体业务背景),并调整措辞语气。工具解决的是“流程正确性和效率”,人工解决的是“故事独特性和感染力”。

八、不同人群的简历差异

8.1 应届生与转行者

- 应届生:重点放在课程项目、毕业设计、比赛和论文。可以列出相关课程,强调学习能力和基础扎实。

- 转行者:强调之前行业经验中与数据相关的部分(如业务理解、报表分析),同时突出自学项目或证书(如Kaggle、Coursera)。

8.2 不同岗位方向

| 岗位方向 | 简历侧重点 |

|---|---|

| 数据科学家 | 算法理解、统计知识、实验设计、业务洞察 |

| 数据分析师 | SQL、报表工具(Tableau/Power BI)、业务指标分析 |

| 大数据工程师 | Spark、Flink、Hadoop、数据管道、数据仓库 |

| 机器学习工程师 | 模型部署、MLOps、工程化能力 |

8.3 公司规模差异

- 大厂:ATS严格依赖关键词;需要高度匹配JD;面试轮次多,简历需要体现深度。

- 创业公司:看重动手能力和广度;简历中可体现全栈数据分析能力(从数据采集到部署)。

九、检查清单:提交前逐项核对

9.1 关键词覆盖率检查

对照JD,逐项标记简历中是否出现了以下类型的关键词:

- 技术栈:Python/SQL/Spark等

- 算法:随机森林/神经网络/聚类等

- 业务术语:用户增长/风控/推荐

- 软技能:沟通/团队/推动

9.2 量化程度检查

每个项目点是否都包含数字?如果没有,考虑能否增加百分比、时间、排名等。

9.3 ATS解析测试

将简历PDF复制到纯文本中,检查是否乱码或丢失信息。AI简历姬的导出功能会直接做ATS友好校验。

| 检查项 | 通过标准 |

|---|---|

| 文字可选中 | PDF文本可复制,非图片 |

| 字体嵌入 | 所有字体已嵌入PDF |

| 无表格混乱 | 表格被解析成文本而非图像 |

| 标题清晰 | 教育、经历等标题关键词可被识别 |

十、长期机制:持续优化你的简历库

10.1 一岗一版,不要通用简历

每投递一家公司,都应该根据JD微调关键词顺序和项目侧重点。AI简历姬支持多版本管理,你可以保存多个版本并随时调出更新。

10.2 投递后复盘

记录每份简历的投递时间、公司、岗位版本、面试反馈。如果某岗位没拿到面试,分析是不是关键词覆盖不足或项目描述不够突出。

10.3 定期更新技能

数据领域技术更新快。每季度回顾一次新工具(如大模型相关技能),在简历中补充新项目,删除过时或不相关的技能。

十一、数据科学与大数据技术简历未来的趋势与建议

11.1 AI辅助筛选成为主流

越来越多的公司使用AI评估简历与岗位的匹配度,关键词对齐变得更加精细。未来简历可能需要针对不同类型的AI系统(如BERT-based匹配)优化,而不仅仅是简单字符串匹配。

11.2 个性化趋势:突出“人”的标签

在机器筛选中,除了技术关键词,软技能标签(如“结果驱动”“商业敏锐度”)也会被捕捉。建议在简历中明确写出你的职业定位。

11.3 多版本管理与数据化优化

建议建立自己的简历版本追踪系统,记录哪个版本投递哪些公司、反馈如何。逐步积累的投递数据可以帮助你找到最有效的措辞。AI简历姬的投递看板功能正好服务于这个场景。

十二、总结:想写好数据科学简历,关键在于“对齐+量化+工具提效”

写好数据科学与大数据技术简历并不神秘,核心三步是:用JD指导内容,用量化证明价值,用工具避免低级错误。你不需要成为写作专家,但需要养成结构化的思维。

如果你希望更快完成简历初稿、对齐JD、同时管理多个版本,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它把投递—面试—复盘做成可管理闭环,帮你把精力真正放在面试准备上。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:数据科学简历到底应该先写技能还是先写项目?

回答:建议先写项目经历。因为HR和ATS更看重你实际做了什么(项目内容),而不是你会什么(技能列表)。技能部分可以放在项目经历后方,作为一个补充模块。项目经历中自然体现技能,比如“用Python实现X算法”比单纯列“Python”更有说服力。

问题2:简历里最容易出错的是哪一步?

回答:最常见错误是关键词遗漏或不匹配。很多同学凭印象写,没有对照JD逐条核对。另外,量化不足也是大问题,写“提升了效率”没有数字,HR无法判断提升程度。建议使用AI简历姬的诊断功能快速识别缺口。

问题3:AI工具在写数据科学简历时到底能帮什么?

回答:AI工具可以解决三件事:1)自动提取JD关键词并对比简历,给出匹配度评分;2)将经历按STAR结构进行量化改写;3)ATS友好导出,确保简历在机器阅读中不丢失信息。但这不代表完全自动生成,你需要人工补充细节和个性化表述。

问题4:转行做数据科学,简历应该注意什么?

回答:转行者应重点突出:1)之前工作中与数据相关的任何分析任务(如制作报表、用户分析);2)自学项目(Kaggle、博客、GitHub),并用量化结果证明能力;3)相关性强的课程证书。同时可以弱化不相关的经历,或者只简略写一行。

本文内容基于真实求职经验总结,具体效果因人而异。建议同时结合自身情况调整。