如果你正在准备AI大模型岗位的面试,一定会遇到一个高频考点——GQA,即Grouped Query Attention(分组查询注意力)。GQA是介于标准多头注意力(MHA)和多查询注意力(MQA)之间的一种高效注意力机制,目前已被LLaMA2、PaLM等主流大模型采用。对求职者来说,理解GQA不仅能帮你通过面试中的技术追问,更能体现你对大模型架构优化方向的深度认知。下面从概念、原理、区别、实战到工具提效,一步步拆解,让你用最少的时间掌握最核心的内容。

一、什么是GQA?Grouped Query Attention的核心定义

1.1 从多头注意力到分组查询的演化

标准多头注意力(MHA)中每个注意力头都有独立的Key、Query、Value投影,计算量和显存占用与头数成正比。多查询注意力(MQA)则让所有Query头共享同一组Key和Value,大幅减少显存但可能损失表达能力。GQA正是两者的折中:将Query分成若干组,组内共享Key、Value投影,每组仍保留一定数量的独立头。例如LLaMA2-70B使用了8组Key-Value头,对应64个Query头(每组8个Query头)。

1.2 GQA的数学表达与直观理解

设定查询头总数Hq,键值头总数Hkv,分组数G = Hq / Hkv。每个Key-Value头服务于G个Query头。在计算注意力分数时,每个Query头只与所属组的Key进行点积,然后加权Value。直观来说,GQA像是一个“团队协作”模式:一组Query头共用同一套Key-Value投影,既减少了参数冗余,又保留了组内头的多样性。

1.3 GQA解决的核心问题

大模型推理时,显存瓶颈主要在Key-Value缓存(KV Cache)的大小。MHA的KV Cache与头数成正比,随着序列长度增长会迅速膨胀。MQA虽然压缩了缓存,但可能让不同位置的学习能力下降。GQA在保持接近MHA的表达能力的同时,将KV Cache压缩到原来的Hkv/Hq比例,通常能降低50%-75%的缓存占用,显著提升推理吞吐量。

二、为什么GQA成为大模型面试高频题?

2.1 考察对模型优化方向的敏锐度

面试官问GQA,往往不只想听你背诵定义,而是想判断你是否关注大模型在工程落地中的显存与速度瓶颈。GQA这类方法体现的是“不做无谓的计算和存储”的设计思想,这正是工业界模型部署的核心诉求。

2.2 区分基础与深度的绝佳切入点

很多候选人能流畅说出MHA和MQA的区别,但对GQA的组数选择、对吞吐量和质量的影响往往答不上来。GQA恰好处于两者之间,需要你理解分组带来的精细权衡,这能有效区分不同层次的候选人。

2.3 与实际模型架构强相关

LLaMA2、PaLM、Gemini等代表性模型都使用了GQA。如果你在简历中写“熟悉LLaMA架构”或“参与过大模型推理优化”,面试官自然期望你了解GQA。缺少这部分知识,简历上的项目描述会显得不够扎实。

三、GQA与Multi-Head Attention、MQA的核心区别

3.1 参数与计算量的对比

下表清晰展示三种注意力机制在头数、KV缓存大小、计算量方面的差异(假设总隐藏维度d_model=4096,头维度d_head=128):

| 机制 | Query头数 | Key/Value头数 | KV缓存大小(每层) | 参数量(投影层) |

|---|---|---|---|---|

| MHA | 32 | 32 | 32 * seq_len * 128 | 3 * d_model * d_model |

| MQA | 32 | 1 | 1 * seq_len * 128 | (32+1+1) * d_model * d_head |

| GQA | 32 | 4(分组8) | 4 * seq_len * 128 | (32+4+4) * d_model * d_head |

可见GQA在KV缓存上远小于MHA,略大于MQA;参数量也介于之间。

3.2 推理速度与质量权衡

- MHA:质量最好,但解码阶段KV缓存占用大,batch size受限。

- MQA:推理速度最快(尤其长序列),但某些任务上质量有轻微下降。

- GQA:通常能在保持MHA 98%以上质量的同时,获得接近MQA的推理效率,是工程中的优选方案。

3.3 在主流模型中的实际选择

| 模型 | 使用的注意力机制 | 分组数 | 论文/报告出处 |

|---|---|---|---|

| LLaMA-1 | MHA | — | — |

| LLaMA-2 | GQA | 8组(70B版本) | LLaMA 2: Open Foundation and Fine-Tuned Chat Models |

| PaLM | MQA | — | PaLM: Scaling Language Modeling with Pathways |

| Gemini | MQA + GQA混合 | 不同规模不同 | Gemini: A Family of Highly Capable Multimodal Models |

通常参数量超过60B的模型更倾向使用GQA或MQA,以保证推理可行性。

四、GQA的原理与实现要点

4.1 分组索引与投影矩阵设计

实现GQA时,Key和Value的投影矩阵形状相同,但输出头数减少。例如d_model=4096,d_head=128,Hkv=4,那么Key投影的输出维度是4*128=512。在计算注意力时,需要将Query头(32个)按分组映射到对应的Key/Value头上。典型做法是将Query头均匀分为G组,每组内Query头共享同一个Key-Value投影。

4.2 前向传播中的关键步骤

- 对输入X分别做Query、Key、Value投影。Query投影输出维度 Hq * d_head;Key/Value投影输出维度 Hkv * d_head。

- 重塑为多头形状:Query为 [batch, seq_len, Hq, d_head];Key/Value为 [batch, seq_len, Hkv, d_head]。

- 对Key/Value在头维度上进行重复(repeat_interleave)以匹配Query的头数:将Hkv重复G次变为Hq,得到 [batch, seq_len, Hq, d_head]。

- 然后进行标准的多头注意力计算:Q·K^T → softmax → 与V相乘。

注意:重复操作只在计算时进行,并不增加KV Cache的存储大小。

4.3 分组数选择的影响

- 分组数G越大(Hkv越小),KV缓存越小,但可能损失表示多样性。实验表明G=8时(即每8个Query共享一组KV)效果与MHA几乎无异。

- 分组数G=1退化为MQA,G=Hq退化为MHA。实际选择需要根据模型规模、推理资源、质量要求来调优,通常G取4-8之间。

五、GQA在不同大模型中的应用

5.1 LLaMA-2:从MHA到GQA的升级

Meta在LLaMA-2的70B版本中首次引入了GQA(8组)。根据论文,该改动使推理时KV缓存减少约87.5%(相对于MHA),同时保持了与MHA几乎相同的评估分数。LLaMA-2-7B和13B由于参数量较小,仍沿用MHA。

5.2 PaLM与Gemini:MQA的极致与变体

Google的PaLM使用了MQA,因为其参数量高达540B,KV缓存压力极大。而Gemini则根据不同规模的模型混合使用MQA和GQA,在效率和效果间取得更精细的平衡。

5.3 Mistral与Falcon:更极致的分组

Mistral-7B使用了滑动窗口注意力+分组查询的混合机制,每层具有8个Query头和8个Key-Value头(即Hq=Hkv=8,分组数G=1,实际上是MQA的变体,但结合了其他技巧)。Falcon-40B则直接采用MQA。理解这些具体案例,能让你在面试中展现更广的视野。

六、GQA的优缺点与适用场景

6.1 优点总结

| 优点 | 说明 |

|---|---|

| KV缓存大幅减少 | 通常降低50%-75%,支持更大batch size和更长序列 |

| 推理吞吐量提升 | 减少显存搬运,解码速度接近MQA |

| 质量损失极小 | 多数任务上与MHA持平,优于MQA |

| 工程实现友好 | 只需修改投影层和索引,现有框架容易适配 |

6.2 缺点与局限

- 分组数需要手动调优,增加超参。

- 某些细粒度任务(如代码理解、长文档QA)可能会受到轻微影响,但通常不明显。

- 训练阶段与MHA相比,计算量并不减少(因为训练时需要反向传播,KV投影矩阵参数少,但Q投影不变),因此对训练加速帮助有限。

6.3 适合哪些场景

- 推理部署(尤其Web端、移动端等资源受限环境)

- 长上下文模型(如128K tokens)

- 需要高并发服务的场景

- 参数量在30B以上的大模型

七、借助AI工具高效准备GQA面试题

7.1 传统准备方式的痛点

很多面试者在准备GQA这类技术细节时,往往通读论文、整理笔记,然后死记硬背。结果面试时被问到“你的项目中如何体现对注意力优化的理解”就卡壳。问题的根源在于:简历上的项目描述和面试回答之间缺少结构化对齐,而且缺乏针对性的模拟练习。

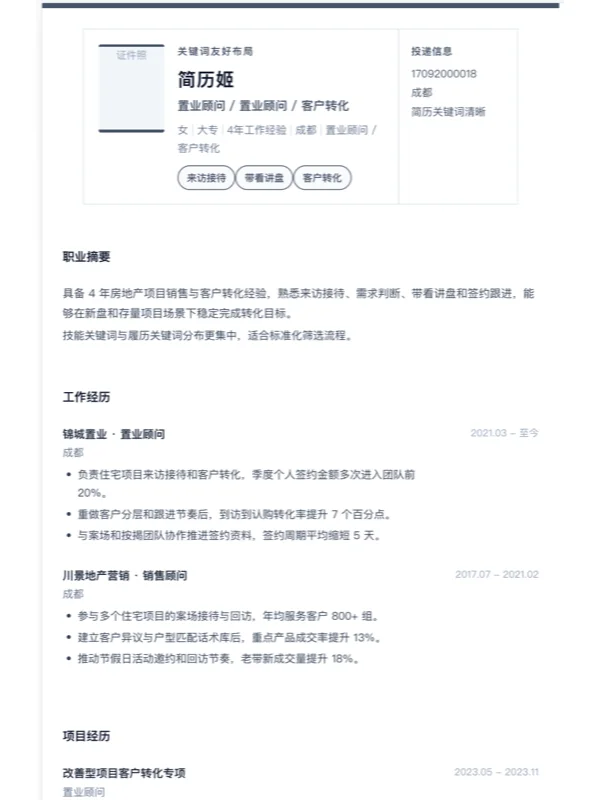

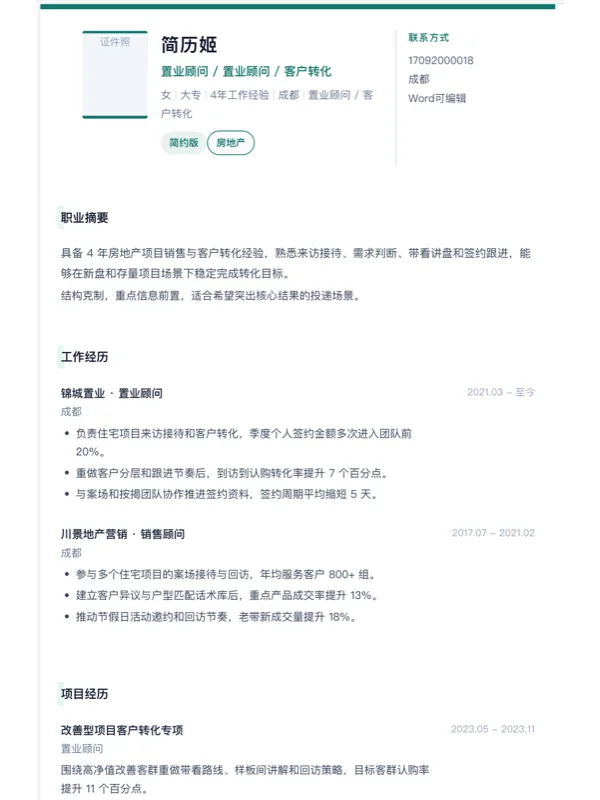

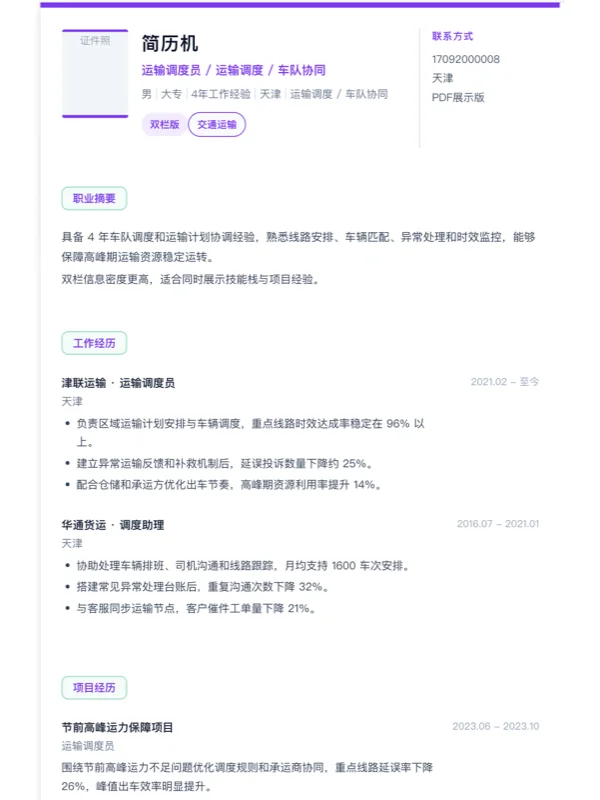

7.2 如何用AI简历姬系统化准备

AI简历姬是一款以岗位要求(JD)为中心的全流程求职工作台。你可以这样使用它:

- 导入你做过的大模型相关项目简历,系统会自动结构化解析并修复关键信息。

- 粘贴目标岗位的JD(例如“NLP算法工程师,要求熟悉GQA等高效注意力机制”),系统会逐条对齐你的项目经历,给出匹配度评分和关键词缺口清单。

- 针对“注意力机制优化”这类经历,使用STAR结构进行量化改写,比如将“使用GQA降低了推理延迟”改写为“在LLaMA基础上实现GQA,将KV缓存减少87%,推理速度提升40%”。

- 模拟面试模块:基于“你的简历+目标岗位”生成定制追问,比如“GQA的组数你是怎么确定的?部署时遇到过什么问题?”然后给出参考回答和反馈建议。

7.3 提效结果对比

| 准备方式 | 耗时 | 针对性 | 通过率影响 |

|---|---|---|---|

| 纯自学论文+手写笔记 | 3-5天 | 中 | 中等 |

| 使用AI简历姬结构化准备 | 30分钟生成初稿,2-3轮迭代 | 高(对齐JD) | 显著提升 |

通过将技术理解转化为简历上的具体亮点,再用模拟面试闭环练习,你能在短时间内把GQA相关知识变成面试中的加分项。

八、不同岗位对GQA考察的侧重点差异

8.1 研究型岗位 vs 工程型岗位

- 研究型(如研究员、算法科学):更关注理论基础,比如GQA的数学推导、与MHA的梯度差异、在长序列任务上效果对比。面试官可能会让你推导GQA的KV缓存大小公式,或讨论分组数对模型容量影响的理论依据。

- 工程型(如推理优化工程师、部署工程师):更关注实现细节和性能数据,如如何在PyTorch/TensorRT中高效实现GQA、与FlashAttention的兼容性、在特定硬件上的延迟测试结果。

8.2 不同模型产品团队的考察风格

| 团队类型 | 典型问题 |

|---|---|

| 基础模型团队 | “LLaMA-2为什么从MHA改成GQA?要改哪些组件?” |

| 应用产品团队 | “我们的AI助手需要支持128k上下文,你会推荐用GQA还是MQA?为什么?” |

| ASIC/芯片团队 | “GQA在计算和访存上的pattern是什么?如何优化硬件映射?” |

8.3 面试自我定位的建议

在回答GQA相关问题时,不仅要给出机制,还要结合自身经历。例如你说“我在实习中实现过GQA”,面试官立马追问细节。所以务必提前用AI简历姬梳理清晰你在这个方向上的真实贡献和量化结果。

九、GQA面试回答的检查清单与评分标准

9.1 回答核心要素清单

| 要素 | 是否掌握 | 面试官期待 |

|---|---|---|

| 定义与动机 | ✅ | 能清晰说出GQA是MHA和MQA的折中,目的是减少KV缓存且保持质量 |

| 与MHA/MQA对比 | ✅ | 能从参数、缓存、速度、质量四方面对比,最好有数据 |

| 分组数的含义 | ✅ | 知道组数G的选择对效果和效率的影响,举例常见设定 |

| 实现细节 | ✅ | 能描述prefill和decoding阶段的区别,知道repeat_interleave操作 |

| 模型实例 | ✅ | 至少举出LLaMA-2或PaLM的例子 |

| 缺点与局限 | ✅ | 知道训练阶段无加速、分组调优成本等 |

| 与自身项目结合 | ✅ | 能举例说明你如何用GQA优化了某个任务 |

9.2 常见扣分点

- 只背定义,不理解为什么分组能减少缓存(本质是共享Key/Value投影)

- 混淆GQA和MQA,说GQA就是多个MQA

- 回答过于理论,没有工程感知(比如不知道KV缓存大小对推理的影响)

- 无法与自己的简历项目关联(这在大厂面试中非常致命)

9.3 加分行为

- 主动提到GQA与FlashAttention配合使用时的注意事项

- 指出GQA在训练和推理阶段的不同影响

- 给出具体实验数据或开源实现链接

十、常见GQA误区与持续学习建议

10.1 误区一:GQA质量一定等于MHA

许多文章宣称GQA“几乎无损”,但实际上在极少部分任务(如需要细粒度位置感知的任务)可能有0.1-0.5%的下降。面试中要诚实说明这一点,并指出要根据实际Bleu/BERTScore等指标验证。

10.2 误区二:GQA实现就是简单的repeat

虽然PyTorch代码常用repeat_interleave,但更高效的实现应该直接在attention kernel层面支持广播,避免显式重复增大内存。比如vLLM等推理框架有专门的GQA kernel。

10.3 持续学习的路径

- 读原始论文:GQA来自Google的《Fast Transformer Decoding: One Write-Head is All You Need》和Meta的《LLaMA 2》相关章节。

- 读代码:Hugging Face Transformers中的LLaMA-2实现(module.py中的LLaMAAttention类)。

- 动手实现:用PyTorch从零写一个GQA模块,对比与MHA的显存差异。

- 跟踪新进展:如MLA(Multi-head Latent Attention)进一步压缩KV缓存。

十一、GQA等注意力机制的未来趋势

11.1 从GQA到MLA:更极致的缓存压缩

DeepSeek提出的Multi-head Latent Attention(MLA)用低秩分解进一步压缩KV缓存。MLA将Key和Value投影到低维隐空间,再还原,理论上可以达到比GQA更好的压缩比。未来面试中,GQA可能只是基准,更先进的MLA或其它变体会成为新高频题。

11.2 自适应分组与动态分组

未来的研究可能让模型自动选择最优的分组数,甚至在不同层、不同tokens上动态调整分组。这既能避免人工调参,又能从理论上逼近最优权衡。

11.3 与硬件加速的深度融合

NVIDIA、AMD等厂商已经在Tensor Core中直接支持GQA的硬件加速原语,例如NVIDIA Hopper架构中的FP8 Transformer Engine。掌握GQA知识有助于理解这些硬件的设计逻辑。

十二、总结:想把GQA面试题答好,关键在于“理论+实践+简历对齐”

GQA作为大模型面试中兼具理论与工程价值的知识点,你需要做到:第一,透彻理解概念与原理,能用一句话说清它与MHA、MQA的区别;第二,结合具体模型例子(如LLaMA-2),展现实际应用能力;第三,将GQA与自己的项目经历绑定,用量化成果证明你的思考。

如果你希望更快完成简历优化、面试模拟,也可以借助AI简历姬这类工具,大幅提升效率并减少反复修改成本。通过“简历诊断—量化改写—模拟面试”闭环,你可以在3天内把GQA这个知识点变成面试中的亮点。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

12.1 最后30天复习行动建议

- 第1-3天:读完本文,理解GQA全部要点,整理自己的语言描述。

- 第4-7天:用AI简历姬重构你的简历,确保项目描述包含GQA相关经验和量化数据。

- 第8-14天:使用模拟面试模块,每天练习3个GQA相关问题。

- 第15-30天:持续做几轮迭代,并跟踪最新进展。

12.2 心态调整

面试准备过程中难免焦虑,但请记住:GQA只是众多知识点之一,你不需要成为每个细节的专家。把精力放在最能体现你差异化竞争力的领域——即你如何在项目中实际应用了这些技术。用AI简历姬这样的工具解放重复劳动,把时间留给深度思考。祝你面试顺利!

精品问答

问题1:GQA到底应该从哪开始学?先看论文还是先看代码?

回答: 建议从“需求”开始。先问自己:为什么需要GQA?你可以找一个大的LLM模型推理时OOM的案例,直观感受KV缓存瓶颈。然后读LLaMA-2论文中有关GQA的章节(内容不多,15分钟读完)。接着打开Hugging Face上的LLaMA-2代码,对照关键函数(repeat_kv、apply_rotary_emb等),自己跑一个小demo验证显存变化。这样从实际问题出发,效率最高。

问题2:GQA里最容易出错的是哪一步?

回答: 最容易出错的是Key-Value头的重复操作。很多新手在实现时直接在投影前重复,导致KV Cache变大,失去了压缩意义。正确的做法是:投影到Hkv个头后再重复(repeat_interleave),这样存储的KV依然是Hkv个,但计算时每个Query头拿到对应的副本。还要注意重复时用view还是expand,后者不会额外分配内存,更高效。

问题3:AI工具在准备GQA面试题时到底能帮什么?

回答: AI工具的核心价值是“对齐+模拟”。对齐指将你的简历项目与JD关键词做结构化匹配,让面试官一眼看到你的相关经验。模拟指基于你的真实经历生成定制追问,并给出参考回答。例如AI简历姬可以这样帮你:你粘贴一段“在实习中优化了模型推理速度”的经历,系统会建议你补充GQA的具体实现方式、分组数、效果提升百分比,然后生成面试官可能问的问题:“你怎么确定分组数的?遇到过什么坑?”让你提前准备。

问题4:准备AI大模型面试的求职者,做GQA的准备时应该注意什么?

回答: 最重要的一点是避免“纸上谈兵”。很多候选人把GQA原理背得滚瓜烂熟,但被问到“你在实际项目里用过吗?”就露馅了。如果你确实没有生产环境经验,可以自己复现一个迷你LLM(比如只有两层),在Colab上跑一下带GQA和不带GQA的推理延迟对比,把结果记录在简历中。没有项目经验时,这样的动手实践同样有价值。同时,用AI简历姬把这些实践过程结构化整理,面试时能有理有据地展示。