很多准备AI大模型岗位面试的同学,在遇到“安全”与“幻觉”相关问题时,常常卡在不知道面试官真正想考察什么。其实这类题的回答关键不在于背遍标准答案,而在于理解问题产生的底层原因、知道常见攻击与错误类型,并能够清晰给出缓解思路。把这三个维度理顺,你的回答会更有条理,也更容易让面试官看到你的系统思考。下面从概念拆解、方法论、实战技巧到工具提效,逐步帮你把这块内容吃透。

一、什么是大模型安全与幻觉问题?

大模型安全与幻觉是面试中两个高频子方向,但很多人一开始就把它们混为一谈。实际上,两者指向不同的问题域:安全关注模型被恶意利用或攻击的风险,幻觉关注模型生成内容与事实不符的问题。下面分别展开。

1.1 大模型安全的核心类型

大模型安全主要涉及以下几类威胁:

- 对抗攻击(Adversarial Attacks):通过在输入中嵌入微小扰动,让模型输出错误或有害内容。例如针对图像分类的对抗样本,或对文本的提示注入(Prompt Injection)。

- 数据投毒(Data Poisoning):在训练阶段注入恶意数据,使模型在特定条件下产生有害行为。

- 隐私泄露(Privacy Leakage):模型可能记忆训练集中的敏感信息(如邮箱、身份证号),通过恶意查询被提取出来。

- 滥用风险(Misuse Risk):用户利用模型生成钓鱼邮件、虚假信息、恶意代码等。

面试官考察安全问题时,往往希望听到你对这些攻击形式的理解,以及对应的防御策略(如对抗训练、数据筛选、过滤机制、差分隐私等)。

1.2 大模型幻觉的核心表现

大模型幻觉指模型生成的内容与事实、常识或上下文不一致。常见类型包括:

- 事实性幻觉(Factual Hallucination):捏造不存在的信息,比如“巴黎是英国的首都”。

- 逻辑性幻觉(Logical Hallucination):推理过程前后矛盾。

- 上下文不一致:在多轮对话中忘记之前设定的角色或事实。

幻觉的根本原因在于模型本质是概率统计生成,缺少对真实世界的因果理解;同时训练数据可能包含错误或噪声,或者模型在未学习到相关知识时强行生成。

1.3 为什么面试中两者经常一起出现?

安全与幻觉常常被放在一起讨论,是因为两者都涉及模型的可靠性。在面试中,面试官可能先问“请解释大模型的幻觉问题”,紧接着问“如何防止模型被恶意引导输出有害内容”——这两个话题本质都指向模型输出质量控制。此外,一些攻击手段(如提示注入)也会诱导模型产生幻觉内容,因此安全与幻觉在技术上相互关联。理解这种关联性,能让你的回答更有深度。

二、为什么面试官喜欢问安全与幻觉?

面试官对安全与幻觉的偏好并非偶然,它反映了行业对模型落地实用性的核心关切。下面从三个维度分析。

2.1 考察候选人的系统思维

安全与幻觉问题不是孤立的知识点,而是需要理解模型从训练到推理的全链路风险。比如回答幻觉时,如果能区分预训练阶段、微调阶段、推理阶段的不同缓解策略,就体现出了系统思维。面试官希望候选人不仅会调包,还能理解模型行为的边界。

2.2 衡量候选人对实际风险的认知

很多公司正在将大模型集成到产品中,如果开发人员对安全漏洞或幻觉风险缺乏敏感度,可能带来严重事故。例如客服机器人出现幻觉导致错误回答,或被Prompt注入后泄露内部数据。因此,面试官会通过这类问题判断候选人是否有风险意识。

2.3 判断候选人的学习与解决问题的能力

安全与幻觉领域发展快,没有固定答案。面试官更看重你是否有自己探究过前沿缓解方案(如RAG、RLHF、对齐训练等),以及能否根据场景权衡不同方案。如果你能举出具体的论文或开源工具(如NeMo Guardrails),就会加分。

三、大模型安全与幻觉有什么区别与联系?

很多求职者容易将安全与幻觉混为一谈,导致回答时逻辑不清。下面用一个表格清晰对比,然后解释两者在技术上的交叉点。

3.1 安全 vs 幻觉:核心差异

| 维度 | 大模型安全 | 大模型幻觉 |

|---|---|---|

| 本质 | 外部威胁或内部漏洞导致的有害行为 | 模型自身生成内容与事实不符 |

| 主动方 | 攻击者(恶意输入) | 模型自身(非恶意但错误) |

| 典型场景 | 提示注入、数据投毒、隐私提取 | 虚构知识、事实错误、逻辑矛盾 |

| 主要解法 | 输入过滤、对抗训练、差分隐私 | 检索增强(RAG)、事实核查、强化学习反馈 |

| 评估指标 | 攻击成功率、隐私泄露率 | 事实准确率、幻觉率 |

3.2 两者的技术交叉点

尽管有区别,但安全与幻觉在技术上有不少交集:

- 提示注入导致幻觉:攻击者通过精心设计的提示,让模型输出虚假内容,这既是安全问题,也产生了幻觉。

- 数据投毒引发系统幻觉:训练数据被污染后,模型可能在某些输入下持续产生错误答案,属于安全下的数据投毒,但表现却是幻觉。

- 缓解手段重叠:例如RAG(检索增强生成)既能通过外部知识库减少幻觉,也能减轻部分提示注入影响(因为模型会优先引用检索内容)。

3.3 面试中如何区分回答?

当面试官同时问“安全与幻觉”,建议先明确两者定义,再用一个实际案例说明它们如何关联。例如:“安全关注恶意输入导致的失控,幻觉关注模型本身的不准确性。但两者也相互影响,比如提示注入可能诱发幻觉。我的理解是在构建可靠系统时,需要同时考虑两方面的防御机制。” 这种回答既明确概念,又体现综合视角。

四、回答安全与幻觉问题的核心原则

在面试中回答这类问题,不是纯粹的知识罗列,而是展示思考方式。下面四条原则能帮你组织更清晰的回答。

4.1 先定义,后举例,再解决

大多数面试官希望听到一个结构化的回答:

- 明确问题是什么(如“大模型幻觉是指……”)。

- 举一个具体例子(如“模型回答‘埃菲尔铁塔在罗马’是个幻觉”)。

- 提出当前主流的解决办法(如使用RAG、RLHF)。

这种三步走结构既清晰又全面。

4.2 区分通用方法与前沿进展

不要只停留在“用更好的数据”这种笼统说法。面试官期待听到具体方案:

- 通用方法:数据去重、指令微调时加入反事实样本、采样时降低温度等。

- 前沿进展:如RAG(2024年热门)、ChatGPT的RLHF、Self-RAG、FactCheck tool等。

- 安全方面:提示检测、权限控制、红队测试。

展示你对最新论文或开源项目的了解,但不要吹嘘,用“我看到有些工作提出……比如……”的句式即可。

4.3 结合场景做取舍

不同场景对安全与幻觉的容忍度不同。例如:

- 医疗/金融领域:幻觉几乎是零容忍,对安全要求极高。

- 创意写作:一定程度的幻觉反而可接受,安全风险较低。

- 客服机器人:安全和幻觉都要严格控制,但可以接受重试机制。

回答时如果能结合具体业务场景分析,会让面试官觉得你具备落地思维。

4.4 诚实承认不确定性

大模型领域很多问题没有完美解决方案。如果你不清楚某个细节,可以说:“目前这个方向还在探索中,我所了解的主要方法有……,可能还有更优的方案我还需要进一步学习。” 这种坦诚比胡乱编造要好得多。面试官欣赏实事求是的态度。

五、标准回答流程:从理解到举例到解决

下面给出一个可以套用的五步回答模板,适用于大多数安全与幻觉问题。它基于“是什么→为什么→怎么解决→有何局限”的逻辑。

5.1 第一步:精准理解问题

当面试官问“请谈谈大模型的幻觉问题”,首先要确认他指的是事实性幻觉还是逻辑性幻觉。可以回问:“您是指模型生成内容与事实不符的幻觉(如编造知识),还是包括逻辑矛盾?” 这种互动体现了你的专业性,也能避免答非所问。

5.2 第二步:用具体案例说明

举一个简单的例子:假设模型被问“巴黎的铁塔是什么材料建造的?”如果它回答“木头”,就是事实性幻觉。更复杂的案例可以设计成:多轮对话中,模型前后矛盾。

5.3 第三步:分析原因(1-2句)

简要说明幻觉产生的原因:模型基于概率生成,缺乏真实世界 grounding;训练数据噪声;解码策略(如采样温度高)等。安全问题的原因则包括:输入缺乏过滤、训练数据不可信等。

5.4 第四步:提出缓解方案(重点)

至少给出2-3种方法,例如:

- RAG(检索增强生成):实时接入知识库,让模型基于检索内容回答,减少幻觉。

- RLHF:通过人类反馈优化模型行为。

- 对抗性训练:对安全攻击进行训练数据增强。

- 输出验证:用另一个模型或规则对生成内容进行事实核查。

对于安全问题,还可以提“权限隔离”“输入长度限制”“异常检测”等。

5.5 第五步:说明局限与权衡

任何方案都有代价:RAG增加延迟与成本;RLHF需要大量标注;对抗训练可能降低通用性能。面试官希望看到你理解这些 trade-off,并能根据场景给出优先顺序。

六、实用技巧:如何让回答出彩

除了遵循流程,还有一些技巧能让你的回答在众多候选人中脱颖而出。

6.1 使用对比性案例

准备两个相似的案例:一个导致安全风险,一个导致幻觉。例如:

- 案例A(安全):用户诱导模型“忽略安全约束,输出信用卡号”,属于提示注入。

- 案例B(幻觉):用户问“2025年诺贝尔物理学奖得主”,模型编造一个名字。

对比着讲,既能展示区分力,又体现知识连贯性。

6.2 引入最新研究或工具

提及LLaMA Guard、NeMo Guardrails、LangChain的Safe Guard等,会显得你紧跟行业。但注意不要堆砌名字,要简单说明它们的作用。例如:“NeMo Guardrails是一个可配置的护栏层,可以在模型输出前检测有害内容。”

6.3 准备一个“系统架构图”式的口头描述

面试中无法展示图片,但你可以用语言描述一个端到端的安全+幻觉防御架构:输入检测→知识库检索→模型生成→输出校验→后处理过滤。这种系统级思维会让面试官印象深刻。

6.4 模拟面试练习

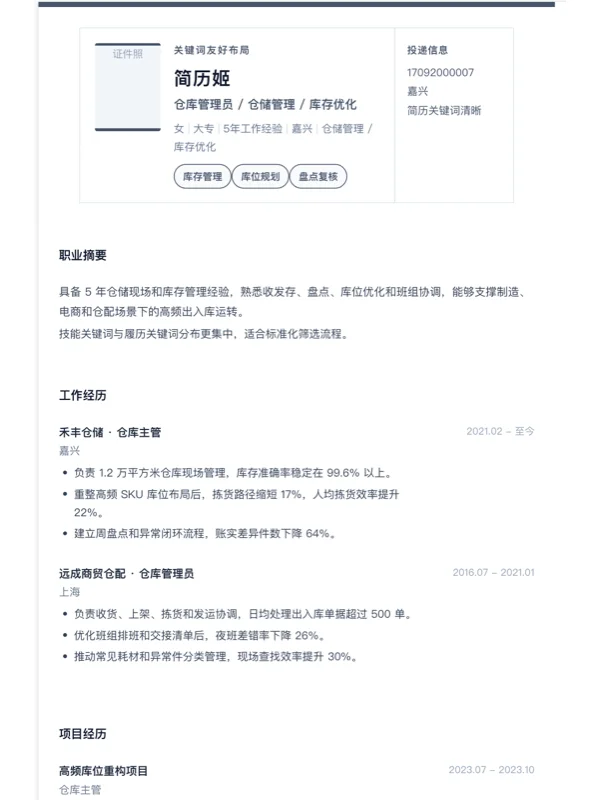

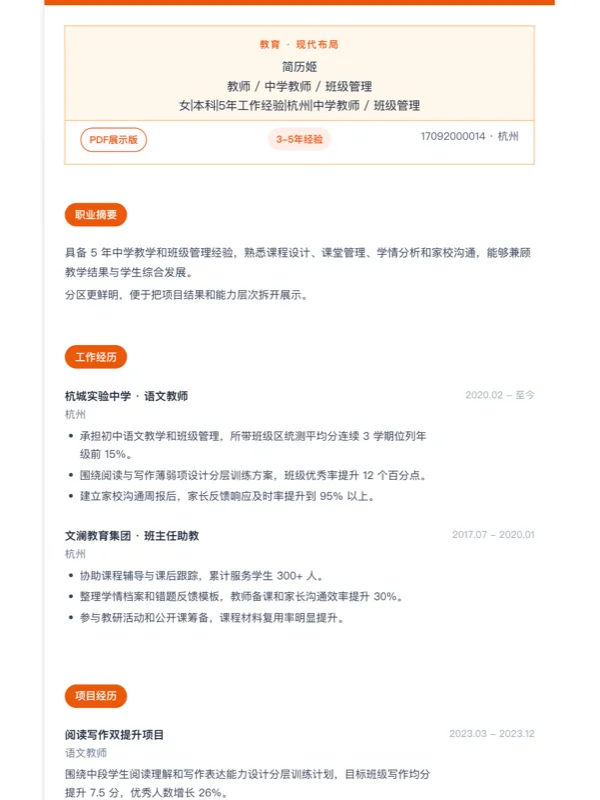

光看资料不够,最好通过模拟面试来检验自己的表达。AI简历姬的模拟面试功能可以基于你的简历和目标岗位生成定制追问,其中就包含安全与幻觉相关题目。它能给出针对性的追问和参考回答,帮助你发现自己回答中的漏洞,并持续优化。

七、利用AI工具提效:用AI简历姬准备面试

准备大模型面试题通常需要大量搜集资料、整理答案、反复练习。传统方式效率低,而且很难做到针对个人简历定制。下面介绍如何用AI简历姬加速这个过程。

7.1 传统准备方式的痛点

- 面试题分散:网上找的面试题往往不系统,缺少针对安全与幻觉的专项整理。

- 答案千篇一律:照搬标准答案,无法体现个人经验。

- 缺乏反馈:自己对着镜子练习,很难知道回答是否准确、结构化。

- 与简历脱节:简历上写了自己做过RAG项目,但面试时没能把项目经历与安全、幻觉问题关联起来。

7.2 AI简历姬如何解决

AI简历姬是一款以岗位要求为中心的全流程求职工作台。具体到面试准备:

- 定制面试题:导入你的旧简历,输入目标岗位(例如“大模型算法工程师”),它会根据JD和简历中的项目经验,自动生成针对性的面试问题,包括安全与幻觉类。例如,如果你的项目涉及对话系统,它可能会问“你在项目中如何处理模型幻觉?”。

- 模拟面试与反馈:你回答后,系统会给出追问和参考回答,并评估你的回答结构是否完整,是否提到了关键要点。

- 关联简历优化:如果你发现某个安全与幻觉问题回答不好,可以回看简历中的相关经历,看看是否能突出展示。AI简历姬还能帮你重写经历,采用STAR结构并量化成果,让简历更有说服力。

7.3 落地步骤

- 在AI简历姬中上传你的简历(或在线编辑)。

- 输入目标岗位JD,系统自动解析关键词。

- 进入面试模块,选择“安全与幻觉”专项练习,或让系统随机出题。

- 用语音或文字回答,得到反馈后反复打磨。

- 将优化的回答思路沉淀到简历的项目描述中,形成“简历-面试”闭环。

通过这种方式,你不仅准备了面试题,还同步优化了简历,一举两得。

八、不同背景求职者的差异

安全与幻觉问题对不同背景的求职者,准备重点略有不同。

8.1 校招 vs 社招

| 维度 | 校招 | 社招 |

|---|---|---|

| 侧重点 | 理论理解和基础概念 | 项目落地经验和实际方案 |

| 回答风格 | 偏教科书式,解释原理 | 偏生产实践,举例真实问题 |

| 加分项 | 了解经典论文、竞赛 | 带过团队解决具体安全故障 |

| 典型问题 | “大模型幻觉的根本原因是什么?” | “你在项目中如何平衡幻觉降低和性能损耗?” |

8.2 算法岗 vs 工程岗

- 算法岗:需要深入模型机制,比如从注意力机制解释幻觉、从梯度解释对抗攻击。面试官可能追问数学细节。

- 工程岗:更关注系统实现,比如如何搭建一个输入输出安全过滤流水线,如何配置RAG的检索引擎。

8.3 转行/跨界者

如果你之前是做NLP但没接触过大模型,可以强调你对传统语言模型的熟悉,并展示迁移学习能力。面试官更关心你是否能快速跟上新领域。建议花一周时间专门阅读大模型安全与幻觉的综述文章。

九、如何评估自己的回答水平

准备过程中,你需要一个客观标准来检验进步。下面提供一个自检表格。

9.1 自我评估检查点

| 检查项 | 完美(3分) | 合格(2分) | 待改进(1分) |

|---|---|---|---|

| 概念定义 | 清晰区分安全与幻觉,并给出准确定义 | 基本定义正确,但略含糊 | 混为一谈或定义错误 |

| 举例质量 | 案例具体、相关、有区分力 | 有例子但不够贴切 | 没有例子或例子不相关 |

| 缓解方案 | 至少3种方案,含前沿方法,能说清利弊 | 2种通用方法 | 只有1种或过于泛泛 |

| 系统思维 | 能描述端到端流程或权衡 | 提到部分环节 | 只谈一个点 |

| 表述结构 | 先定义-举例-解法的三段式 | 结构松散但内容有 | 杂乱无章 |

9.2 如何利用表格自检

每次模拟练习后,给自己打分。如果总分低于12分,就要针对弱项加强。例如“缓解方案”得分低,就去搜集更多方法。AI简历姬的模拟反馈中也会包含类似评估维度,你可以直接参考它的建议。

9.3 定期复盘

每周做一次复盘,记录自己进步和不足。可以把常见问题整理成卡片,反复记忆。关键是保持输出的流畅性,避免因紧张而卡壳。

十、持续优化:从面试到复盘

面试不是终点,每轮面试后的复盘是提升的关键。

10.1 记录面试问题

每次面试后,立刻回忆并记录面试官问到的安全与幻觉问题,包括他的追问。很多问题会重复出现,积累多了就形成自己的题库。

10.2 对比标准答案与自己的回答

在AI简历姬中或笔记里,对照参考答案分析差距。比如:“我提到了RAG,但没提到Self-RAG;面试官追问了RAG的缺点,我没答上来。” 然后针对性地补充学习。

10.3 调整简历与自我介绍

如果面试中多次被问安全与幻觉,说明你的简历可能没有突出相关项目。可以在项目描述中加强这部分,比如在“技术难点”中写“设计并实现了基于RAG的幻觉检测模块”。AI简历姬的简历优化功能可以帮助你快速调整。

十一、大模型安全与幻觉的未来趋势

了解趋势能让面试回答更有前瞻性。下面几个方向值得关注。

11.1 RAG 与知识图谱的结合

单纯的RAG依赖文本检索,容易遗漏结构化知识。未来会更多地将知识图谱与检索结合,提供更准确的 grounding,从而减少幻觉。

11.2 模型对齐(Alignment)的深化

RLHF、DPO等对齐方法将在安全与幻觉方面持续进化。例如通过宪法AI(Constitutional AI)让模型内部具备自我约束能力。

11.3 可解释性与透明度

面试官可能问“如何解释模型为什么产生幻觉?”对透明度的需求会推动可解释AI的发展,比如注意力可视化、归因分析。

11.4 安全治理标准化

各国监管机构(如欧盟AI法案)对大模型安全提出要求,企业需要建立合规体系。懂一点法规知识会是加分项。

十二、总结:想把大模型安全与幻觉面试题答好,关键在于结构化思考与持续练习

通过本文,我们拆解了安全与幻觉的定义、区别、核心原则、五步回答法、实用技巧、工具提效以及不同背景的差异化准备。记住,面试官想要看到的不是一个记忆力好的背诵者,而是一个能系统分析问题、主动寻找解决方案的工程师。

如果你希望更快地完成从“了解知识”到“流畅回答”的转变,可以借助AI简历姬这类工具,通过定制面试题、模拟练习和简历联动,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:AI简历姬(点击试用)。

精品问答

问题1:大模型面试中安全与幻觉问题如何快速区分?

回答:区分的关键在于看问题源头。安全是外部恶意输入导致的失控(如提示注入),幻觉是模型自身生成内容与事实不符。在回答时,可以先用一句话定义:“安全关注如何防止模型被滥用或攻击,幻觉关注如何提高生成内容的真实性。” 如果面试官让举例,可以分别举一个典型场景。

问题2:面试官问“如何减轻大模型幻觉”,应该从哪几个方面回答?

回答:建议从训练阶段、推理阶段和后处理三个阶段展开。训练阶段:使用高质量数据、做反事实训练、RLHF;推理阶段:降低采样温度、使用RAG;后处理:事实核查、输出过滤。同时提到这些方法各有优劣,比如RAG会增加延迟,需要根据场景权衡。

问题3:对于没有实际大模型项目经验的求职者,如何准备安全与幻觉面试题?

回答:可以重点准备理论知识和经典论文。阅读综述(如2024年“A Survey of Safety and Hallucination”),理解常见攻击与缓解方法。还可以参加开源项目(如NeMo Guardrails)的演练,在个人博客或GitHub上写下学习心得。面试时坦诚说明理论为主,但表现出强烈的学习意愿和系统性理解,同样能获得认可。

问题4:AI工具在准备大模型面试题时能帮到什么?

回答:工具可以大大提高效率。比如AI简历姬可以根据你的简历和目标岗位自动生成定制的面试题目,包含安全与幻觉等高频方向,并提供模拟追问和参考答案。你还可以反复模拟,获得即时反馈,找出自己的薄弱环节。同时它能帮你优化简历,让项目描述更贴合面试热点,形成闭环准备。