如果只说结论,RoPE(旋转位置编码)是当前大模型面试中几乎必考的位置编码技术,它的核心价值在于用旋转矩阵优雅地同时编码绝对位置和相对位置,让模型具备更好的长文本外推能力。对于准备AI大模型岗位面试的求职者来说,理解RoPE的原理、优势和实现细节,不仅是为了应对面试题,更是深入理解LLaMA、GPT-NeoX等主流模型设计思路的关键。这篇文章会从RoPE是什么开始,逐步拆解它的数学直觉、与其它位置编码的区别、面试中如何回答、以及如何借助工具高效准备。

很多人在复习RoPE时容易陷入两个误区:一是只记公式不理解旋转为什么能表示位置差;二是把绝对位置编码和相对位置编码的概念搞混。文章后续会逐一理清这些难点,并给出每一环节的可执行方法。

一、RoPE旋转位置编码是什么?为什么大模型面试常考?

1. 定义:旋转位置编码(Rotary Position Embedding)

RoPE是一种将位置信息编码到注意力机制中Query和Key向量的方法。具体来说,它通过对每个token的Query和Key向量施加一个与位置相关的旋转矩阵,使得两个token之间的注意力分数只与它们的相对位置差有关。这种编码最早由苏剑林等人提出(RoFormer),后被LLaMA、Mistral等模型广泛采用。

2. 为什么大模型面试常考RoPE?

面试官考察RoPE通常有三个层次:第一层是问“你了解哪些位置编码”,此时RoPE是相对位置编码的代表;第二层是问“如何实现长文本外推”,RoPE的旋转频率设计天然支持外推;第三层是问“旋转位置编码的数学细节”,考察候选人对线性变换的理解深度。可以说,RoPE是连接理论(位置编码原理)和工程(模型性能)的最佳案例。

3. 从面试官视角看,回答RoPE应展现什么?

面试官希望听到的不是单纯的背诵公式,而是:能讲清楚为什么旋转可以编码相对位置、能对比RoPE和绝对位置编码的差异、能指出RoPE在长文本场景下的优势边界。如果你还能结合LLaMA源码的具体实现,那就更好了。

二、面试高频问题:RoPE如何解决位置编码的痛点?

1. 绝对位置编码的局限性

原始Transformer使用sin/cos函数给每个位置加入绝对位置向量。这种方式无法捕捉两个token之间的相对位置关系,而且当序列长度超过训练时的最大长度时,位置向量外推困难,性能急剧下降。很多面试者会提到这一点,但忽略了本质:绝对位置编码缺乏平移不变性。

2. 相对位置编码的改进与代价

为了解决绝对位置编码的问题,相对位置编码(如T5的偏置、Shaw等人的方法)直接在注意力分数中加入相对位置的偏置,从而让模型学到位置差的信息。但这种方法通常需要修改注意力计算结构,增加了复杂度,而且不同的实现有不同的设计。

3. RoPE的优雅解决方案

RoPE同时融合了绝对位置编码和相对位置编码的优点:它通过给Query和Key向量施加旋转矩阵,使得内积结果自然地依赖于位置差,不需要修改注意力计算公式。更关键的是,旋转矩阵的参数(旋转频率)可以设计为随着维度递增而递减,从而实现类似Sinusoidal的远程衰减性质,让模型能够处理远超训练长度的序列。

| 位置编码类型 | 核心机制 | 相对位置能力 | 长文本外推 | 计算复杂度 |

|---|---|---|---|---|

| 绝对位置编码(sin/cos) | 加性位置向量 | 弱 | 差 | O(n) |

| 相对位置编码(T5 bias) | 偏置项 | 强 | 中 | O(n²) |

| RoPE | 旋转矩阵 | 强(自然表示) | 优秀 | O(n) |

三、RoPE与其它位置编码的区别?常见混淆点

1. RoPE与绝对位置编码的本质区别

绝对位置编码是将位置向量加到embedding上,位置向量本身不参与注意力计算的内在结构;而RoPE是通过旋转矩阵作用于Query/Key,位置信息成为内积的一部分。很多初学者误以为RoPE也是加法,其实是乘法(矩阵旋转)。

2. RoPE与ALiBi的区别

ALiBi(Attention with Linear Biases)是一种给注意力分数加上线性偏置的相对位置编码,简单但外推效果也很好。面试中常被问:“RoPE和ALiBi哪个好?”答案依赖于场景:RoPE在数学上更优雅,支持复杂的长期依赖;ALiBi实现更轻量,适合资源受限场景。

3. 常见混淆:RoPE到底是绝对位置还是相对位置?

严格来说,RoPE是相对位置编码的一种实现方式。因为旋转矩阵的作用使得两个位置的Query-Key内积只依赖于它们的差值。但它的参数是绝对位置(每个位置都有一个唯一的旋转角度),所以也带有绝对位置编码的痕迹。理解这一点,才能回答“RoPE是绝对还是相对”的陷阱题。

四、理解RoPE的核心原则:旋转矩阵与复数域

1. 核心数学直觉:旋转表示位置差

RoPE的数学基础是:在二维空间中,旋转一个向量相当于改变了它的角度,而两个向量的夹角与它们的角度差有关。推广到高维,RoPE将每个位置的向量分成若干2维子空间,分别施加旋转,旋转角度与位置索引成比例。这样,两个向量的内积实际上等于它们在各个子空间角度差的余弦之和——完美体现了相对位置。

2. 关键公式拆解

对于位置m和n的向量q和k,施加RoPE后的内积为:

⟨RoPE(q, m), RoPE(k, n)⟩ = Σᵢ Re[ qᵢ * kᵢ' * e^{i(m-n)θᵢ} ]

其中θᵢ是预设的频率(通常取1/10000^{2i/d})。这个公式直接显示结果只依赖于位置差(m-n)。

3. 如何记忆与理解?

不必死记公式,记住一句话:RoPE就是把位置信息编码成一组旋转角度,Query和Key的夹角自然携带了相对位置信息。而旋转的频率设计借鉴了sin/cos的指数衰减,使得短距离位置敏感,长距离逐渐平滑。

五、面试中如何回答RoPE相关问题的标准步骤?

1. 先讲清位置编码的必要性

“Transformer本身不具备位置感知能力,因为自注意力操作是置换不变的。所以需要引入位置编码告诉模型每个token在序列中的位置。”

2. 解释RoPE的基本思想

“RoPE不是把位置向量加到embedding上,而是对Query和Key向量做旋转,维度越高旋转越慢。旋转的角度与位置索引成正比,这样两个向量的内积只与它们的相对位置差有关。”

3. 强调优势

- 长文本外推:由于频率设计,即使位置超过训练长度,旋转操作仍然有定义,模型可以外推。

- 线性注意力兼容:去除softmax后,旋转不改变线性性质,可用于线性注意力变体。

- 统一框架:同时提供了绝对与相对位置的信息。

4. 补充模型应用实例

“LLaMA系列、Mistral、Qwen等模型都使用RoPE。在LLaMA源码中,位置编码通过预计算的cos/sin值直接施加在q和k上。”

5. 可能的扩展问题

如果面试官问“如果训练序列长度是4096,但推理时遇到8192怎么办?”可以回答:RoPE直接外推往往也能工作,但更好的做法是进行位置插值(Position Interpolation),相当于把新的位置映射到原来的频率范围。

六、实操技巧:准备RoPE面试问题的复习方法

1. 动手推导2维情形的旋转矩阵

从2维出发,写出旋转矩阵R(θ)=[cosθ -sinθ; sinθ cosθ],然后将q和k分别旋转,计算内积就会发现等于原始内积旋转θ1-θ2,非常直观。理解了2维,高维就是把多个2维子空间拼起来。

2. 阅读LLaMA或Mistral源码中的RoPE实现

PyTorch官方实现可以参考Hugging Face的LLaMA模型,重点看apply_rotary_emb函数。你会发现实际计算并没显式构建旋转矩阵,而是通过torch.polar或cos/sin直接做乘法,效率高很多。

3. 对比不同位置编码的代码实现

准备一个速查表:实现sin/cos绝对位置编码只需要几行;RoPE需要先计算cos/sin然后对q、k做旋转;ALiBi则直接加线性偏置。这样面试时可以快速说出各自代码层面的区别。

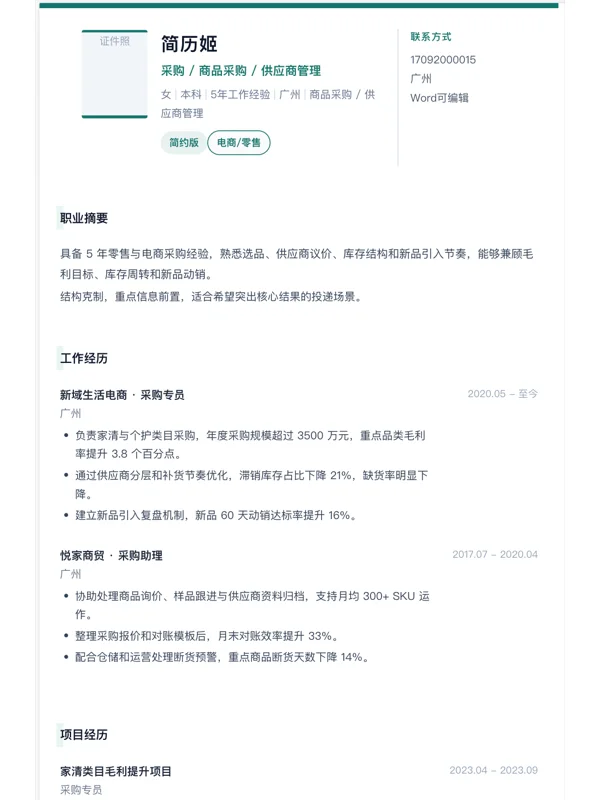

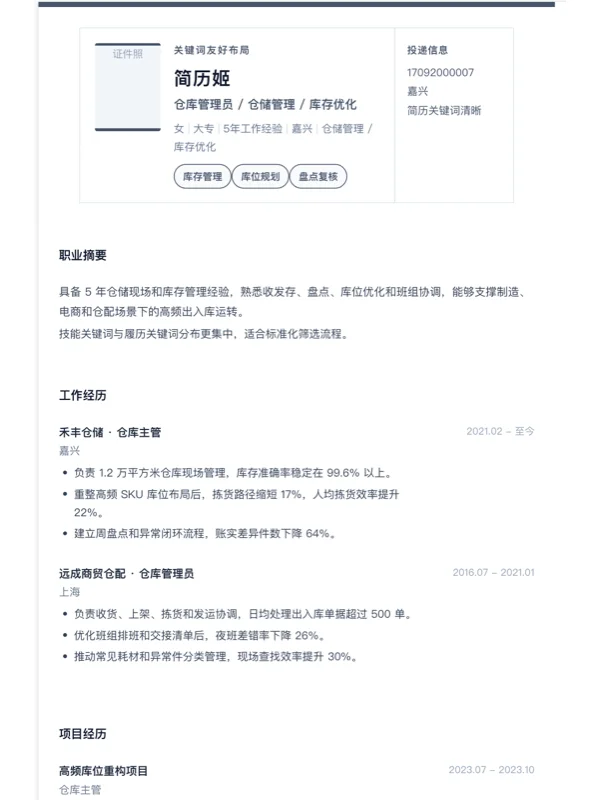

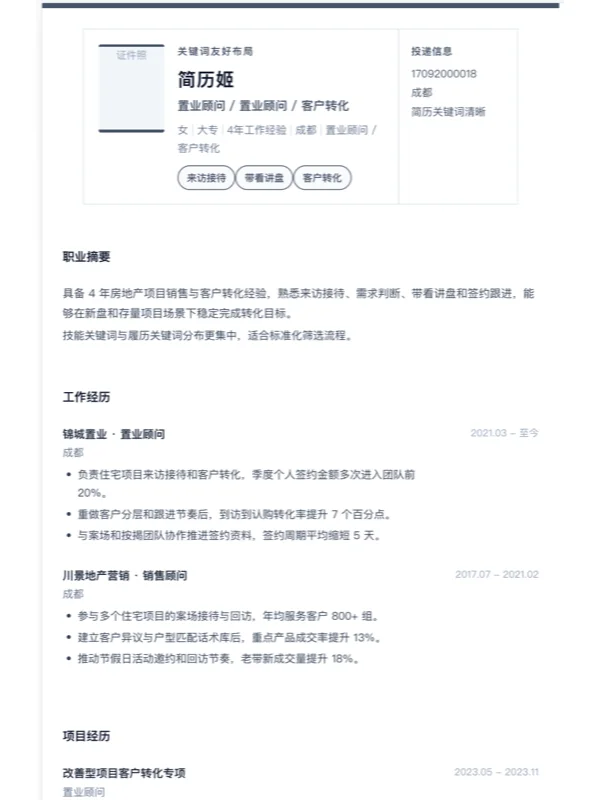

七、AI工具提效:用AI简历姬优化面试准备流程

1. 传统准备方式的痛点

很多求职者在复习技术面试题的同时,还要花大量时间调整简历,确保项目经验与目标岗位(例如AI大模型方向)匹配。而且简历中的项目描述往往过于笼统,无法体现自己对RoPE等技术的实际应用。如何把“用过RoPE”转化为成果导向的描述(如“改进了长序列推理效率”)是很多人的短板。

2. AI简历姬如何帮助技术面试准备

AI简历姬的核心逻辑是“以岗位要求为中心”。你可以先把目标岗位的JD(比如“熟悉Transformer位置编码机制”)粘贴进去,系统会自动提取关键词,与你的简历内容逐条对齐。如果你的简历中提到了相关项目,AI简历姬会给出关键词覆盖率评分和缺失项提示,并按照STAR结构帮你量化改写。例如把“实现了旋转位置编码”改为“通过引入RoPE,使模型在长度1024的序列上准确率提升3%,并支持2倍长度外推”,这样更符合技术面试官对成果的期待。

3. 模拟面试模块:针对RoPE等高频问题定制追问

AI简历姬的面试模块基于你的简历和岗位信息,自动生成可能的追问。比如你简历里有“使用RoPE进行长文本理解”,系统可能会生成:“请解释RoPE为什么能外推?你遇到了什么挑战?”你可以预先练习这些回答,避免面试时被问倒。

八、不同目标岗位对RoPE考察的差异

1. 算法研究员岗位:偏理论推导与数学细节

面试官会期待你从头推导旋转矩阵的公式,解释频率为什么取倒数10000的指数,以及如何保证正交性。需要准备更深入的数学背景。

2. 工程落地岗位:偏实现性能与优化

会问RoPE在Transformer层中能否与其他优化(如FlashAttention)结合?旋转操作是否增加显存?如何用CUDA加速?你可以回答:RoPE只改变q和k的表示,对注意力计算的复杂度几乎没有影响,且可以融入FlashAttention。

3. 应用层岗位:偏原理理解与选型

偏向于问“我们的模型需要处理长文档,应该选哪种位置编码?为什么?”你需要能对比RoPE、ALiBi、xPOS等,给出实际建议,比如推荐RoPE因为综合性能好,且有大量预训练模型支持。

| 岗位类型 | 考察重点 | 需要准备的内容 |

|---|---|---|

| 算法研究员 | 数学原理、公式推导 | 旋转矩阵、复数表示、频率设计 |

| 工程师 | 实现细节、性能、兼容性 | PyTorch代码、内存与速度分析 |

| 应用/产品 | 对比选型、业务影响 | 各编码优劣、长文本场景经验 |

九、检查指标:如何判断自己是否真正掌握了RoPE?

1. 能无参考写出核心公式

你可以尝试在纸上写出2维RoPE的内积表达式,并指出它只依赖于位置差。如果写不出来,说明数学直觉还没建立。

2. 能解释远程衰减现象

面试官可能会问:“为什么RoPE在序列很长的两端反而注意力变小?”你需要回答:因为高频维度对短距离敏感,低频维度对长距离敏感,但整体是衰减的,符合直觉(重要信息通常来自附近位置)。

3. 能手动实现一遍RoPE

用PyTorch写一个简短的RoPE实现,并验证其内积仅依赖于位置差。代码不到30行。如果能做到,基本可以应付大部分实现问题。

十、长期机制:持续追踪位置编码的演进

1. 从RoPE到xPOS、位置插值

xPOS(extended Positional Encoding)是RoPE的改进,通过调整频率实现更好的外推;位置插值则是通过缩放位置索引来适应更长的序列。面试中可能会问:“除了RoPE,你还知道哪些改进?”你可以自然带出这些变体,体现你的技术广度。

2. 保持阅读技术博客的习惯

推荐关注苏剑林的博客(Kexue.fm)、Hugging Face的官方博客,以及一些优质的微信公众号(如“机器之心”)。定期整理位置编码的最新进展,形成知识卡片。

3. 建立系统的知识图谱

不要只盯着RoPE,要理解位置编码的大类:绝对编码、相对编码、可学习编码、旋转编码、线性偏置。面试时能够从抽象层面解释不同方法的优缺点,会让面试官觉得你很有深度。

十一、RoPE旋转位置编码未来的趋势与建议

1. 位置编码与长文本处理的融合

随着模型上下文长度扩展到128K甚至1M,位置编码的设计越来越重要。RoPE结合位置插值已成标配,未来可能出现自适应的频率选择方法。

2. 在非Transformer架构中的应用

Mamba、RWKV等状态空间模型中,位置信息需要以不同方式编码。RoPE的原理(旋转映射)也被尝试引入这些模型。

3. 对求职者的建议

不要孤立的背“RoPE面试八股”,要把它放在更宽的语境里:大模型为什么需要更好的位置编码?训练和推理时有什么不同的要求?这样面试时才能灵活应对。同时,借助AI简历姬这样的工具,把技术知识转化为简历上的亮点和面试准备的具体行动,会让你的整体竞争力更上一层楼。

十二、总结:准备RoPE面试题,关键在于理解旋转位置编码的数学直觉与工程价值

回顾整篇文章,我们从RoPE的定义、原理、面试策略、实操到未来趋势,逐一拆解。RoPE不只是一个公式或一个实现,它代表了一种通过变换携带位置信息的优雅思想。在面试中,即使你一时记不住所有细节,只要能把“旋转矩阵使内积依赖于位置差”这个核心讲清楚,再配合一个具体的例子,就能让面试官认可你的理解。

最后,技术面试准备除了攻克难点,也要确保简历能准确传达你的经验。如果你希望更快完成简历与目标岗位的匹配,并获得定制化的面试追问练习,可以借助AI简历姬这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:面试RoPE时,最容易犯错的是哪一步?

回答:最容易犯的错误是把RoPE当作绝对位置编码来说,或者混淆了旋转向量的顺序。很多候选人只记得“位置编码给每个token加上位置信息”,但没意识到RoPE是通过乘法作用于q/k,而非加法。另一个常见错误是,解释远程衰减时只说“低频维度覆盖远距离”,却没说清楚为什么是衰减而不是周期性波动。建议在准备时,亲手推导2维旋转后的内积,并画出不同频率下的注意力图,这样记忆会更牢固。

问题2:准备RoPE面试题,是应该先看原理还是先看代码?

回答:建议先看原理,至少理解旋转为什么能表示相对位置。然后再看代码,因为代码中会用工程技巧(如预计算cos/sin)来优化,如果你直接看代码可能会被绕晕。原理部分推荐苏剑林的原始博客(RoFormer),代码部分看LLaMA的Hugging Face实现,两者配合。

问题3:AI工具在准备RoPE这类技术面试题时到底能起什么作用?

回答:AI工具可以通过两件事帮助你:一是简历匹配,将你过去的项目经验精准对齐到岗位要求的RoPE等关键词,生成成果导向的描述;二是模拟面试,基于你的简历生成定制化的追问,比如“请具体解释你在项目中使用RoPE解决了什么问题”。AI简历姬的模拟面试模块正好提供这样的闭环,让你在真实面试前就能暴露盲区。

问题4:如果我只理解RoPE的直觉,但不熟悉推导,面试会被淘汰吗?

回答:这取决于你的岗位层级。对于初级工程师或研究员,仅理解直觉可能不够,因为面试官期望你具备扎实的数学基础,至少能写出2维的矩阵形式。对于高级职位,如果你能结合工程经验(比如如何在分布式环境中使用RoPE),即使推导不太熟也可能过关。但无论如何,理解直觉是底线,推导是加分项。建议你至少花一天时间把主要公式推一遍,然后把关键结论记牢。