如果只说结论,QLoRA与NF4双重量化是大模型面试中的高频考点,它本质上是参数高效微调(LoRA)与模型量化(NF4)的结合,同时通过双重量化进一步压缩显存占用。对求职AI大模型岗位的候选人来说,先理解“为什么要量化”和“怎么用更少的资源微调大模型”,再掌握NF4精度与双重量化机制,比死记硬背公式更有效。面试官往往更关注你是否能讲清楚原理、局限性和应用场景,而不是纯背诵流程。

很多人在准备这类面试题时,会先扎进论文公式里,结果越看越焦虑。其实更关键的是理清三个维度:为什么需要QLoRA?NF4比特数到底怎么工作?双重量化解决了什么实际问题? 把这三个问题串起来,你就能在面试中自然地展开回答。下面这篇文章会从概念拆解、面试高频问题、技巧、工具提效到未来趋势,帮你系统梳理。

一、QLoRA与NF4双重量化到底是什么?——概念拆解

1.1 QLoRA:在大模型微调中“省显存”的核心思路

QLoRA(Quantized Low-Rank Adaptation)是2023年提出的一种微调方法,它在LoRA的基础上引入了量化技术。LoRA本身通过低秩矩阵分解减少参数量,但权重还是全精度(FP16或BF16)。QLoRA则将预训练模型的部分权重量化到4bit,从而大幅降低显存占用。面试时,你需要说明LoRA和QLoRA的根本区别:前者只减少训练参数量,后者同时压缩了权重存储。

1.2 NF4精度:为什么是4bit,而不是INT4?

NF4(Normal Float4)是一种专门为模型量化设计的数据类型,它通过正态分布分位数分配数值,比普通INT4更符合大模型权重的分布特性。面试官可能会问“为什么QLoRA不用INT8而用4bit?”,回答要点是:4bit量化能进一步降低显存,而NF4的设计让精度损失控制在可接受范围内。

1.3 双重量化:再省一笔显存的双保险

双重量化(Double Quantization)是QLoRA中的关键优化:在对模型权重做一次NF4量化后,再对量化参数(scale)本身做一次量化,进一步节省显存。简单说就是把“量化的工具”也压缩了。面试时你可能被问到“双重量化具体怎么省显存的?”,回答思路是:它把原本占用的额外参数(如缩放因子)从FP32降到8bit或更低位,从而总体显存再降10%-20%。

二、为什么大模型面试中频繁考QLoRA与双重量化?

2.1 公司需要能实际部署大模型的人才

现在很多业务场景需要本地或边缘端部署大模型,全参数微调(Full Fine-tuning)需要的显存太高(如7B模型需要约56GB显存)。面试QLoRA相关知识,是为了考察候选人是否理解如何用有限的资源做微调。这直接关系到企业的落地成本。

2.2 区分候选人是否真正理解“量化”的本质

很多候选人知道“量化就是压缩”,但说不清NF4和INT4的区别、双重量化的动机。面试官用这个知识点来判断你是“调包侠”还是“懂原理的人”。如果你能结合论文里的关键实验(如QLoRA与LoRA在相同任务上的效果对比),会加很多分。

2.3 与近年开源生态强相关

Hugging Face的Transformers库、PEFT库、Bitsandbytes库都内置了QLoRA支持。面试官会假设你用过这些工具,或者至少了解工作机制。这个问题能自然引出你对开源工具链的熟悉度。

| 面试意图 | 常见提问角度 | 考察能力 |

|---|---|---|

| 理解压缩原理 | 为什么NF4比INT4更适合 | 数值分析基础 |

| 工程应用 | 双重量化省了多少显存? | 模型部署知识 |

| 系统设计 | 如果显存足够,你会用QLoRA吗? | 权衡思维 |

三、QLoRA、NF4与普通LoRA、INT8量化有什么区别?

3.1 参数高效方法对比:LoRA vs QLoRA

- LoRA: 冻结预训练权重,只训练低秩矩阵,参数量减少99%,但权重仍用FP16,显存占用大约是一半。

- QLoRA: 再对冻结权重做NF4量化,显存占用从约32GB(7B FP16)降到约8GB(7B NF4)。

面试中要能说出典型数字,但不要编造,可以说“根据论文,7B模型QLoRA微调仅需8GB显存”。

3.2 精度对比:NF4 vs INT8 vs FP16

INT8量化虽然精度损失小,但显存节省只有50%左右。NF4节省75%,但需要更精心的量化策略。双重量化则是在NF4基础上再节省约0.5-1GB。可以用表格让面试官一目了然。

| 方法 | 精度 | 显存节省 | 主要应用 |

|---|---|---|---|

| FP16 | 全精度 | 0% | 基线 |

| INT8 | 8bit | 50% | 推理加速 |

| NF4 | 4bit | 75% | QLoRA微调 |

| Double Quantization | NF4 + 量化scale | 80-85% | QLoRA优化 |

3.3 常见理解误区

- 误区一:认为QLoRA只能用于推理,实际上它用于训练(微调)过程。

- 误区二:以为双重量化会大幅降低精度,实际实验表明在大多数数据集上效果与LoRA持平。

- 误区三:把NF4和INT4混为一谈。NF4是专门设计的分布自适应格式,INT4是均匀量化。

四、掌握这些概念需要哪些核心原则?

4.1 先理解量化为什么可行:权重分布特性

大模型的权重通常近似正态分布,NF4利用分位数来映射,使得量化后信息丢失最小。你得明白“非线性量化”比“线性量化”更适合这种情况。

4.2 理解“显存-速度-精度”三角权衡

QLoRA牺牲了一点前向计算时间(因为dequantize),但大幅度降低显存。面试官会问你是否愿意用10%的速度换取75%的显存节省,回答要体现出你能根据场景做判断。

4.3 从论文结果中提炼关键结论

QLoRA论文中有一张表显示,在多个benchmark上,QLoRA(NF4+双重量化)的效果与LoRA几乎一致,但显存大幅降低。面试时可以引用这个结论,但不要编具体数值,可以说“论文实验表明,在GSM8K等任务上,QLoRA的准确率与LoRA的差值在1%以内”。

五、如何在面试中回答QLoRA与双重量化?——标准流程

5.1 第一步:主动拆解问题

如果面试官问“说说QLoRA”,不要直接背流程,先确认他关心的角度:是原理?应用?还是代码实现?你可以反问:“您希望我从论文原理、工程实践还是优缺点角度展开?”这会显得你思路清晰。

5.2 第二步:用“三段式”回答

- 核心思想:QLoRA通过NF4量化+低秩适配,让大模型微调在小显存设备上成为可能。

- 关键创新:NF4数据格式和双重量化。

- 实际效果:在保持效果的前提下,显存需求降低到原来的1/8-1/10。

5.3 第三步:主动指出局限性和适用条件

回答完优点后,补充QLoRA的局限:训练速度稍慢(因为反量化开销)、对批大小敏感、极其适合单卡微调但不能简单扩展到多卡。这种辩证思考会让面试官觉得你务实。

六、大模型微调面试中的常见实用技巧

6.1 善用类比让面试官理解量化

可以用“用高清原版图片(FP16) vs 压缩成JPEG(NF4)”来比喻量化。面试官可能非技术背景,类比能快速建立共识。

6.2 手写伪代码展示理解深度

面试中如果让你在白板上说明QLoRA的前向过程,可以写三步:

- 从量化权重(NF4)加载到计算单元,解量化成FP16;

- 加上LoRA适配器的低秩矩阵(FP16)更新;

- 计算结果再经过解量化损失函数。

这样展示了你对工程细节的理解。

6.3 提前准备一个你调试过的实际案例

如果你真的使用过QLoRA微调过模型(如Alpaca或ChatGLM),可以准备一个具体数据:任务、显存占用、训练时间、效果。即使只是实验性质,也能极大增强说服力。

七、利用AI工具高效准备大模型面试(自然植入AI简历姬)

7.1 传统准备方式的低效

很多求职者会花大量时间查论文、看视频,自己整理面试题,但没有针对目标公司职位的重点。而且简历上写“熟悉QLoRA”,却无法在面试中结合实际项目展开,导致被质疑。

7.2 AI如何帮助系统化准备

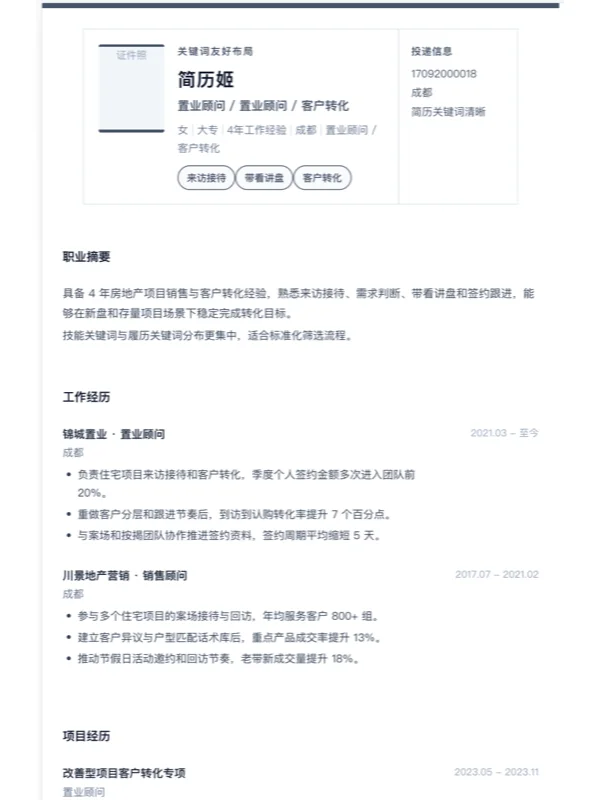

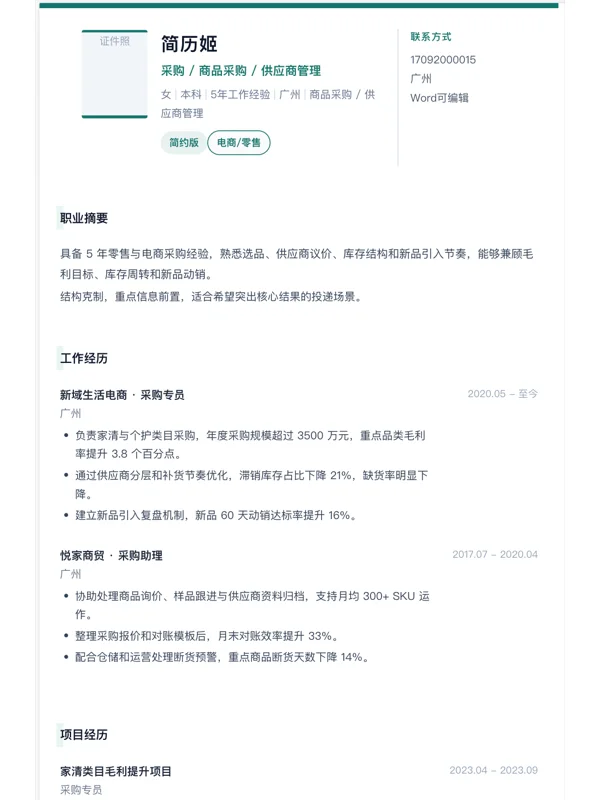

借助AI简历姬这样的求职工作台,你可以:

- 导入旧简历,自动解析你已有的技术经历,比如“使用QLoRA微调7B模型进行对话生成”,系统会帮你结构化描述并量化效果;

- 粘贴目标岗位JD(比如“大模型算法工程师”),它会提取JD中的关键词(如QLoRA、微调、部署),然后给你的简历做匹配度评分,并列出缺口清单;

- 生成面试模拟:基于你的简历和目标岗位,AI会生成针对性的追问,比如“请详细说明你如何使用双重量化节省显存”,并提供参考回答框架。

7.3 AI简历姬的具体落地价值

当你准备大模型面试时,最宝贵的不是信息,而是把抽象问题转化成个人经验。AI简历姬的模拟面试模块能够结合你简历中的项目,定制化输出追问和反馈,让你在真实面试前就熟悉可能的考点。同时,它的ATS友好功能确保你投递的简历能被HR系统正确解析,帮你获得更多面试机会。

八、不同背景求职者的差异应对

8.1 算法研究型:更关注数学原理

如果你是做NLP或CV算法的,面试官可能追问NF4的量化公式、双重量化的Scale共享策略。你需要准备论文细节,比如Normal Float的分位数计算过程。

8.2 工程部署型:更关注实际落地

如果你是做推理优化的,面试官会问:为什么QLoRA的推理速度比原生FP16慢?如何通过算子融合加速?你最好提前了解Bitsandbytes库中的CUDA kernel实现。

8.3 转行或初学者:先理解动机,再补细节

对于从传统机器学习转大模型的人,面试官不指望你推导公式,但需要你讲清楚核心动机:为什么需要量化?为什么用4bit而不是2bit?把故事讲顺比背数字更重要。

| 背景类型 | 面试考察重点 | 建议准备方向 |

|---|---|---|

| 算法研究 | NF4数学原理、双重量化效果 | 论文精读、实验复现 |

| 工程部署 | 显存分析、速度优化、工具链 | 调库经验、工程笔记本 |

| 转行/入门 | 整体流程理解、场景判断 | 类比解释、项目案例 |

九、如何判断自己是否真正理解了这些概念?——自检指标

9.1 能否用自己的话解释给非技术朋友听

如果你能用“用更小的空间存储模型,就像压缩照片”这种类比让朋友点头,那说明你抓住了本质。如果只能复述论文术语,还需要加深理解。

9.2 能否推导NF4量化的基本步骤

不要求默写公式,但你能说出“先计算权重分布的分位数,然后每个值映射到最近的4bit索引”。如果漏掉“解量化时需要查表”,说明理解有漏洞。

9.3 能否预判面试官的追问点

比如你提到双重量化节省显存,面试官可能接着问“那为什么不进行三次量化?”你需要能说出“因为再量化scale的scale带来的收益递减,且增加计算复杂度”。能预判追问说明你已经建立系统认识。

十、长期学习与持续优化建议

10.1 定期阅读最新量化论文

QLoRA之后又有GPTQ、AWQ、SmoothQuant等方法。面试官可能会问“你知道除了QLoRA还有哪些量化微调方法吗?”可以回答“GPTQ用于后训练量化,AWQ通过激活感知可以保护重要权重”。

10.2 动手实验是最好的学习方式

在Hugging Face上找一个开放模型(如Llama-2-7B),用bitsandbytes+peft尝试NF4+双重量化微调,记录显存占用和效果。这个实验本身就能成为你面试项目经历的一部分。

10.3 建立自己的面试题库并持续复盘

每次面试后,把被问到的问题和你的回答记录下来。如果发现某个概念每次都会被问倒,就针对性补强。AI简历姬的“投递看板”功能也可以帮你管理面试进度,复盘问题。

十一、QLoRA与双重量化技术的未来趋势

11.1 更极致的低位量化:2bit、1.58bit?

越来越多的研究探索1bit甚至二值化大模型(如BitNet),但在微调场景中,NF4仍是主流。未来面试可能会问“你是否了解1.58bit模型及其与QLoRA的异同”,可以提前准备。

11.2 端侧微调成为现实

随着QLoRA等技术的成熟,手机或边缘设备也能微调大模型。面试题可能会涉及“如何在树莓派上微调小模型”,这要求你理解NF4和双重量化在极端资源下的表现。

11.3 与多模态、Agent系统的结合

大模型不再只是文本,图像、视频多模态模型也需要微调。QLoRA的方法可以迁移到多模态(如LLaVA),面试可能会扩展到跨模态量化。

十二、总结:把大模型面试题准备做好,关键在于理解原理与工程结合

想要在大模型面试中从容应对QLoRA、NF4、双重量化这类问题,不能只靠死记硬背。你需要从“为什么这样做”开始,延伸到“怎么在实际中应用”,最后能辩证地分析优缺点。

对求职者来说,一个实际有效的建议是:把你真实做过的项目(即使只是实验)结构化地展示在简历上,并且针对每个职位JD做优化。 如果你希望更快完成简历优化和面试模拟,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它能帮你把技术经历量化、匹配职位,并生成定制化面试追问。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

(AI简历姬是一款以岗位要求为中心的求职工作台,支持简历解析、JD匹配、量化改写、ATS友好、模拟面试等功能。)

精品问答

问题1:QLoRA与LoRA相比,在面试中我应该重点强调哪个?

回答:如果面试官没有指定,建议优先介绍QLoRA,因为它代表了更前沿的“低资源微调”思路。你可以先说LoRA作为基础,再引出QLoRA的改进点(量化与双重量化),这样既能展示你的知识广度,又能体现关注最新进展。但注意要强调两者思路是一脉相承的。

问题2:NF4和INT4哪种更好?面试时如何回答?

回答:NF4是专门为模型权重分布设计的,通常比INT4精度损失小,但实现更复杂。面试时可以说“NF4在保持相似精度的前提下,对异常值更友好,所以QLoRA选择了NF4。但INT4也有其优势,比如硬件支持更成熟。”不要贬低一方,体现你的权衡思考。

问题3:双重量化具体是怎么省显存的?能举个数值例子吗?

回答:假设你有一个7B参数模型,用NF4量化后参数本身占约3.5GB(7B×4bits)。但是NF4需要额外的scale参数来存储每个块的最大值,如果每64个权重共享一个scale,scale本身用FP32存,大约需要7B/64×32bits≈0.43GB。双重量化就是将这0.43GB再量化成8bit,变成0.11GB,从而省下约0.32GB。虽然绝对数字不大,但对于显存耗尽时这很关键。

问题4:准备大模型面试时,AI工具具体能帮上什么忙?

回答:首先,AI简历姬可以帮你把项目经历写成量化成果,比如“使用QLoRA微调7B模型,在单卡RTX 4090上将显存占用从48GB降到8GB”。其次,模拟面试模块会针对你简历中的QLoRA项目生成追问,比如“你在双重量化时如何选择块大小?”并给出优化回答。最后,它还能帮你管理多条投递记录,避免遗漏。

本文内容基于公开论文和常见面试经验总结,如有具体数值引用,请以原论文为准。祝大家面试顺利,早日拿到心仪的offer!