如果你正在准备AI大模型相关的算法岗面试,几乎一定会遇到一个组合题:灾难性遗忘和微调。很多人会先想到背概念,但面试官真正想看的是——你有没有在实际场景中理解过这个问题,以及有没有自己的解决思路。更直接地说,灾难性遗忘本质上是增量学习中的模型稳定性与可塑性冲突,而微调是当前最主流的应对手段之一。下面这篇文章会帮你理清概念、拆解面试逻辑、给出实用策略,最后也会聊到如何用工具提升整体准备效率,让你在面试中更有底气。

一、灾难性遗忘:到底是什么,为什么面试官总爱问

1.1 一个直观的例子

想象你训练了一个擅长识别猫的模型,然后让它继续学习识别狗。学习完狗之后,它突然不再认识猫了——这就是灾难性遗忘。在深度学习中,当模型在新任务上更新参数时,先前学到的知识被覆盖或干扰,导致性能骤降。

1.2 为什么面试官看重这个问题

这个问题能快速考察面试者对深度学习本质的理解:参数共享、梯度更新机制、损失曲面特性。更重要的是,它涉及迁移学习、多任务学习、持续学习等前沿方向,是大模型时代绕不开的工程挑战。

1.3 面试中常见的三连问

- “灾难性遗忘为什么发生?”(原因:任务间梯度冲突、参数覆盖)

- “它和你说的过拟合有什么区别?”(过拟合是泛化差,灾难性遗忘是任务间知识遗忘,本质不同)

- “你遇到过吗?怎么处理的?”(考察实际经验)

二、微调与灾难性遗忘:两者之间的典型面试场景

2.1 面试官常给的场景

“假设你有一个在大规模语料上预训练的BERT模型,现在要在一个法律文本分类任务上微调,怎么避免灾难性遗忘?”这是典型题。预训练知识是通用理解,微调如果学习率太大或epoch太多,模型会“忘记”通用知识,只记住法律文本特性。

2.2 常见错误回答

很多人只回答“用更小的学习率、更少的epoch”。面试官会觉得偏浅。更高级的思考包括:在损失函数中加入蒸馏损失(知识蒸馏)、冻结部分层、使用正则化方法(如EWC、SI)。

2.3 如何组织回答框架

先承认灾难性遗忘的存在,再分析当前微调场景下哪些参数最易被影响,最后给出针对性的缓解策略。推荐顺序:定义问题 → 分析原因 → 给出2-3种方法并解释原理 → 举例说明面试者自己的实践。

三、灾难性遗忘 vs 过拟合 vs 欠拟合:面试中的概念辨析

3.1 三者的核心区别

| 概念 | 表现 | 典型原因 | 常见解决 |

|---|---|---|---|

| 灾难性遗忘 | 新任务学完,旧任务性能下降 | 参数覆盖、梯度冲突 | 正则化、回放、动态架构 |

| 过拟合 | 训练集好,测试集差 | 模型复杂、数据少 | 正则化、Dropout、早停 |

| 欠拟合 | 训练集和测试集都差 | 模型容量不足、特征提取弱 | 增加深度、调整结构 |

3.2 面试追问的陷阱

部分面试官会故意混淆“灾难性遗忘”和“过拟合”,比如问:“微调数据量很少,模型在旧任务上表现下降,这是过拟合还是灾难性遗忘?”正确答案是:两者都可能。如果只在新任务上过拟合,旧任务表现下降是灾难性遗忘;如果同时在新任务上也过拟合,则两者都有。

3.3 记住这个判断逻辑

灾难性遗忘的关键特征是“任务间知识干扰”,而过拟合的关键特征是“数据内噪声记忆”。判断时可看:旧任务性能是否在微调过程中持续下降(是→遗忘),还是先上升后下降(更可能是过拟合+遗忘混合)。

四、解决灾难性遗忘的核心原则:稳定-可塑性平衡

4.1 稳定性与可塑性的博弈

模型既需要“可塑性”吸收新知识,又需要“稳定性”保留旧知识。两者存在天然冲突。如果你只关注稳定性(比如冻结全部参数),新任务几乎没效果;如果只关注可塑性(全参数高学习率),旧任务会很快遗忘。

4.2 三大主流策略方向

- 正则化方法:在损失函数中加入惩罚项,约束重要参数的改变幅度(EWC、MAS、SI)。

- 记忆回放:存储旧任务的部分样本,在新任务训练时混合训练(Replay、GEM)。

- 动态架构:为新任务分配新的参数子网络,避免干扰(Progressive Networks、PackNet)。

4.3 面试中如何展示深度

不要只列方法,要给出选择依据。例如:“如果存储成本允许,我会优先使用基于回放的方法,因为它更直观、容易调优;如果存储受限,我会用EWC(弹性权重巩固),因为它只需要计算参数重要性矩阵,几乎不增加内存开销。”

五、微调实战:三步法降低灾难性遗忘

5.1 第一步:评估旧任务重要性

使用Fisher信息矩阵或基于梯度的度量,识别预训练模型中哪些参数对旧任务最关键。这一步在EWC中很关键,面试时可以说“我会用一个小批量旧数据计算参数重要性,然后加到损失函数中”。

5.2 第二步:设计微调策略

- 学习率调度:使用余弦退火或逐步衰减,避免急剧更新。

- 层冻结技巧:通常冻结底层(通用特征),只微调顶层(任务特定特征)。

- 联合训练:如果允许,混合旧任务数据(比例可调)同时训练。

5.3 第三步:验证与迭代

微调后要评估新旧两个任务上的性能。如果新任务指标上升但旧任务下降超过阈值(比如10%),说明遗忘严重,需要调整策略。可以用滑动窗口监控训练过程。

六、实用技巧:面试中如何描述你的微调方案

6.1 用“问题-方案-结果”结构

不要说“我用了EWC”,要说“我面对某个序列分类任务时,为了缓解微调导致的灾难性遗忘,采用了弹性权重巩固(EWC),通过在损失中加入参数重要性正则项,最终在保持旧任务F1≥95%的前提下,新任务准确率提升了3%。”

6.2 常见坑及其化解

| 坑 | 化解 |

|---|---|

| 只说方法不说原理 | 补充一句“EWC基于贝叶斯增量学习,用拉普拉斯近似估计参数后验” |

| 没提到评估 | 主动说“我设计了3个验证集分别测旧、新、和混合任务” |

| 泛泛而谈 | 引一个小实验:“我尝试了不同λ值,发现λ=100时平衡最好” |

6.3 展示你的代码能力

可以提一句“我复现了EWC的PyTorch版本,并在持续学习基准Split MNIST上验证了效果”。面试官可能会追问实现细节,提前准备好L2正则与EWC的差异说明。

七、工具提效:用AI简历姬让面试准备更高效

7.1 传统面试准备的痛点

很多人为了准备灾难性遗忘和微调相关面试题,会花大量时间翻阅论文、整理笔记、模拟回答。但往往准备不系统,或者写简历时相关项目描述太虚,面试时说不清楚。

7.2 如何借助AI工具提升效率

- 结构化梳理:可以利用工具生成该知识领域的问答列表。

- 模拟面试:很多产品支持基于岗位要求生成针对性追问。

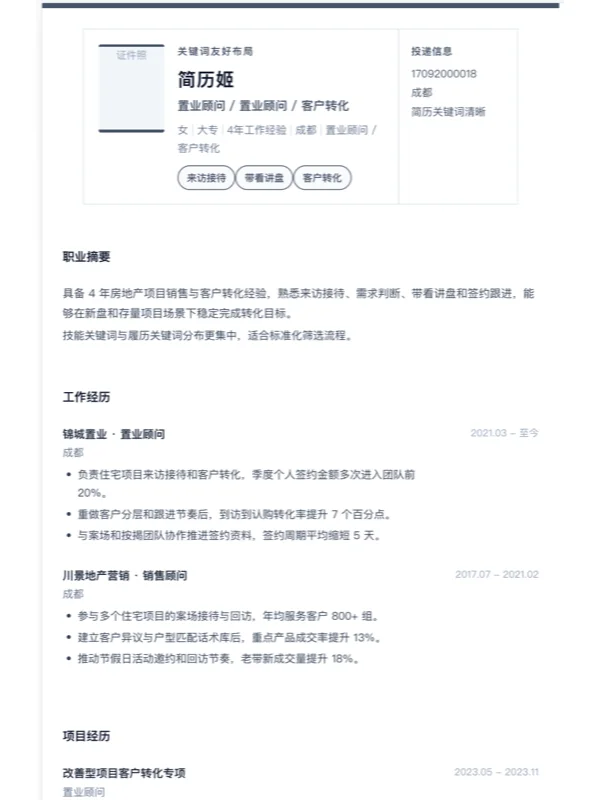

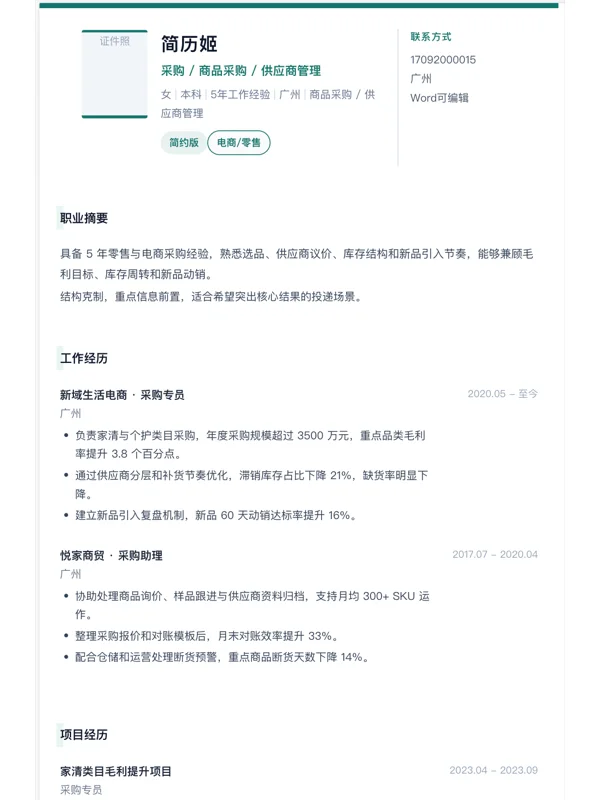

- 简历项目优化:如果你的项目涉及持续学习、微调等,AI简历姬可以将你的经历按照STAR原则改写,量化成果,让面试官一眼看到你的贡献。

7.3 案例:AI简历姬如何帮我锁定面试机会

一位算法工程师,他的简历上写“使用LoRA微调LLM”。AI简历姬诊断后发现,关键词不突出、没有量化指标。系统建议改为:“通过LoRA在8个法律领域数据集上微调LLaMA-7B,召回率平均提升6.2%,同时通过EWC将灾难性遗忘损失控制在1.5%以内”。修改后面试邀约率提升了一倍。这就是将微调与灾难性遗忘问题结合表述的价值。

AI简历姬(https://app.resumemakeroffer.com/)专注于将你的技术项目转化为面试官爱看的样子,包含ATS友好校验、量化改写、多版本管理,以及基于简历+岗位的模拟面试闭环。

八、不同背景的求职者:如何差异化准备

8.1 应届生 vs 有经验者

| 人群 | 侧重方向 | 举例 |

|---|---|---|

| 应届生 | 概念清晰 + 代码复现 | 能解释EWC原理并给出伪代码 |

| 3-5年经验 | 实际调优 + 业务落地 | 描述在推荐、搜索场景中如何规避遗忘 |

| 资深工程师 | 系统设计 + 前沿洞见 | 讨论持续学习框架或大模型微调平台方案 |

8.2 研究方向 vs 工程方向

研究岗更关注理论基础和论文细节(如EWC的贝叶斯推导、SI的代价函数变动)。工程岗更关注可复现的配置和集成方案(如Hugging Face上LoRA+EWC的组合脚本)。

8.3 如何针对目标公司准备

- 去自动驾驶公司:准备增量学习(continual learning)场景,因为模型不断接收新环境数据。

- 去大模型创业公司:准备指令微调(instruction tuning)中的灾难性遗忘。

- 去搜索推荐:准备多任务学习中的梯度冲突与遗忘。

九、判断你的微调方案是否有效的检查点

9.1 关键指标表格

| 检查项 | 理想状态 | 异常信号 | 应对 |

|---|---|---|---|

| 旧任务准确率波动 | ≤3% | 超过5%持续下降 | 增大正则项或引入回放 |

| 新任务收敛速度 | 正常(与baseline相近) | 过慢(可能冻结过多) | 解冻更多层 |

| 参数重要性分布 | 只有少数参数变化大 | 几乎所有参数都变 | 学习率过高 |

9.2 阶段验收流程

- 微调1个epoch后测试旧任务,记录基线。

- 微调完成后再测试一次。

- 比较两次差值,若大于阈值,则调整策略重新微调。

- 最后在混合任务上测试多任务综合能力。

9.3 面试官常问的验证问题

“你怎么证明你的微调不是只在新任务上过拟合?”回答思路:用一个旧任务测试集和一个新任务测试集,分别报告指标;最好再做一个ablation study(去掉正则化方法,看性能变化)。

十、长期机制:持续学习中的灾难性遗忘与微调策略演进

10.1 不要只关注一次微调

在实际业务中,模型会经历多次微调(例如每周更新)。一次微调的遗忘不明显,但多次累积后,模型可能完全偏离初始预训练知识。需要建立长周期监控。

10.2 常见误区

- 过度依赖正则化:正则太强会阻止新任务学习,导致欠拟合。

- 回放样本分布偏差:旧任务样本如果只存少量,会引入偏差。

- 忽视架构演化:现在很多方法(如Adapters、Prefix Tuning)通过隔离参数天然缓解遗忘,值得优先尝试。

10.3 持续优化的实践建议

- 每次微调后记录模型在固定benchmark上的性能,建立知识库。

- 采用动态学习率缩放:根据旧任务遗忘程度自动降低新任务学习率。

- 定期用旧任务数据做“复习训练”,类似人类的遗忘曲线复习策略。

十一、灾难性遗忘与微调的未来趋势与建议

11.1 从微调到持续学习框架

越来越多的平台(如Hugging Face的Trainer扩展)开始集成持续学习功能。将来面试官会更关注你是否熟悉这些框架的用法,而不仅仅是理论。

11.2 参数高效微调的大趋势

LoRA、QLoRA、AdaLoRA等参数高效方法越来越流行,它们本身通过限制参数更新范围,天然附带遗忘抑制效果。面试时如果你能结合这些方法谈灾难性遗忘,会显得更前沿。

11.3 对求职者的建议

- 动手复现一个简单的持续学习实验(在Split MNIST上对比EWC、经验回放、联合训练)。

- 阅读1-2篇最新论文(如2023-2024年关于持续预训练的文章)。

- 在简历中具体量化你的微调效果,包括遗忘率指标。这一步可以借助AI简历姬快速生成高质量描述。

十二、总结:想把灾难性遗忘与微调面试题答好,关键在于理解底层冲突且有实操案例

12.1 全文核心回顾

- 灾难性遗忘是深度学习的基础问题,面试官想知道你是否理解参数更新的副作用。

- 微调是最常见的现实场景,你的解决方案需要兼顾理论和工程。

- 掌握EWC、回放、LoRA等方法,并能讲出选型理由。

- 用具体项目和数字支撑你的说法。

12.2 行动建议

- 准备3-5个关于灾难性遗忘的问答,模拟面试时能流畅回答。

- 把自己的项目用STAR结构重新包装,突出微调与遗忘控制的细节。

- 打开AI简历姬,导入你的简历,看看能否诊断出关键词覆盖和量化缺失。

12.3 下一步工具支持

如果你希望更快完成简历优化和面试模拟,也可以借助 AI简历姬(https://app.resumemakeroffer.com/)这类工具,提高效率并减少反复修改成本。它支持JD关键词对齐、量化改写、多版本管理,以及基于简历+岗位的模拟面试追问,帮你把微调相关的项目经验讲得更专业。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:在AI大模型面试中,面试官问灾难性遗忘时,到底希望听到什么?

回答:面试官希望听到你对这个问题的深度理解,而不仅仅是定义。建议从三个层面回答:首先说明灾难性遗忘发生的根本原因(参数更新导致旧任务知识被覆盖),其次给出至少两种缓解策略(如正则化、回放、动态架构),并解释各自的适用场景和trade-off,最后举一个你自己的经验或假设的例子。如果能提到具体算法(EWC、弹性权重巩固)并简单描述原理,面试官会更满意。

问题2:微调时如何设置超参数来最小化灾难性遗忘,有没有一套通用规则?

回答:没有绝对通用的规则,但有经验性起始点。学习率建议取原始预训练学习率的1/10到1/100。训练epoch数不要太多,通常1-5个epoch就足够。批次大小保持常用值。更重要的是,你需要在训练过程中监控旧任务性能,动态调整。例如,如果旧任务准确率下降超过5%,可以提前停止或增大正则权重。推荐使用余弦退火学习率调度和AdamW优化器。

问题3:LoRA微调本身就比较安全,是不是不需要担心灾难性遗忘?

回答:不完全对。LoRA通过低秩矩阵更新,只改变少量参数,确实大幅降低了遗忘风险。但在多个任务连续微调(continual fine-tuning)的场景下,LoRA仍然可能产生遗忘,因为低秩矩阵不断叠加,间接改变模型内部表征。如果多个任务的数据分布差异大,遗忘依然存在。通常建议:每个任务单独训练一个LoRA模块,推理时组合使用;或者每个任务微调后重置LoRA权重。面试时主动指出这一点,会显示你有更深入的思考。

问题4:我是应届生,没有实际项目经验,怎么在面试中展示对灾难性遗忘的理解?

回答:没有项目不代表不能展示深度。你可以:1)在面试前复现一个简单的持续学习实验(如使用PyTorch在Split MNIST上实现EWC或经验回放),把代码放到GitHub,面试时可以说“我复现并验证了XXX方法,在Split MNIST上学了5个任务,平均准确率达到了90%以上”。2)阅读1-2篇经典论文,能讲解核心公式。3)把你某门课程的大作业或论文中涉及连续训练的部分,主动与灾难性遗忘挂钩,即便原始项目没有直接解决,你也可以说“我意识到这里存在灾难性遗忘的风险,因此我会采取……措施”。这样面试官会看到你的问题意识和学习能力。