如果你正在准备AI大模型相关岗位的面试,有一类问题几乎绕不开——RLHF(Reinforcement Learning from Human Feedback,基于人类反馈的强化学习)和PPO(Proximal Policy Optimization,近端策略优化)。不少候选人会把它们当作两个独立知识点去背,但面试官真正想考察的,往往是你理解这两个概念之间的技术脉络、实现细节以及背后的工程权衡。结论是:RLHF是训练对齐人类偏好的框架,PPO是其中用来稳定优化策略的算法;搞懂RLHF如何采集人类反馈、PPO如何约束策略更新步长,才算真正掌握了大模型微调的核心逻辑。下面从概念拆解、面试考察点、实操流程到提效工具,帮你把这部分内容理清,同时也能更从容地应对面试。

很多准备面试的朋友会陷入一个误区:把RLHF和PPO当作两套独立的“背诵题”,但实际面试中更常见的是结合场景追问,比如“为什么RLHF里用PPO而不是其他算法?”“奖励模型过拟合怎么办?”如果你只记住了公式,回答就会变得僵硬。下文会逐步覆盖这些深水区,也会在工具提效部分自然引入AI简历姬如何帮你把这些技术理解转化为简历上的项目和面试中的表达。

一、什么是RLHF与PPO?大模型面试中的核心概念

1.1 RLHF的核心:让大模型学会人类偏好

RLHF本质上是将人类对文本质量的评判引入模型训练过程。传统监督微调(SFT)只是让模型模仿高质量答案,但很难区分“正确但有害”和“正确且友好”这类细腻的偏好。RLHF通过三个步骤解决:先收集人类对模型生成结果的排序数据,训练一个奖励模型来模拟人类的判断,再用强化学习算法(通常是PPO)让大模型在这个奖励信号下优化。面试中,你需要讲清楚为什么需要奖励模型——因为人类无法实时为每一句话提供反馈,奖励模型就是替代品。

1.2 PPO的定位:策略优化中的“稳健派”

PPO不是RLHF专属,它是强化学习里最常用的策略梯度算法之一。在RLHF场景下,大模型是策略网络,奖励模型给出奖励值,PPO负责更新模型的参数。PPO的核心创新在于“裁剪”(clip)机制——限制每次更新的步长,避免策略骤变导致“遗忘”原有语言能力。面试官往往关注你能否解释“为什么PPO能稳定训练”,而不是仅仅背出目标函数。

1.3 为什么面试官总把这两个概念放在一起问

因为RLHF框架本身不规定必须用哪种强化学习算法,但实践证明PPO最常用也最有效。面试官想知道你是有框架意识还是只会记结论。常见追问包括“如果用A2C或DQN代替PPO行不行?”“奖励模型训练数据不均衡怎么办?”这背后考察的是你对算法适用性的判断力。

二、为什么面试必问RLHF与PPO?考察点与常见场景

2.1 岗位类型决定了考察深度

算法研究岗通常要求你推导PPO的目标函数,并分析clip参数的影响;算法工程岗更关注RLHF的数据构建流程和训练效率;而产品岗则需理解RLHF如何影响模型输出的风格和安全性。面试前明确自己岗位的侧重点,能节省大量时间。

2.2 典型面试场景:项目复盘与技术追问

面试官会先让你简述RLHF流程,然后突然插入细节:“奖励模型训练时,有人用pairwise loss,有人用pointwise loss,你倾向哪种?”或者“你遇到PPO训练时KL散度爆炸怎么处理?”这些场景化问题要求你不仅知道原理,还要有实际调试经验。即使你没有做过完整的RLHF项目,也可以通过公开论文或开源项目(如DeepSpeed Chat、trl库)的学习经历来回答。

2.3 常见陷阱:过度简化与混淆概念

不少候选人把RLHF等同于PPO,或者认为RLHF只是“人工标注打分”。面试官会纠正:RLHF的核心是迭代对齐,奖励模型需要和策略模型同步更新以防止“撒谎”。另一个陷阱是忽略PPO中的重要性采样和优势函数,只讲clip。你需要把三个要素(重要性采样、clip、优势估计)都交代清楚,才算是完整回答。

三、RLHF与PPO的核心区别与联系

| 维度 | RLHF | PPO |

|---|---|---|

| 本质 | 一个训练范式/框架 | 一个具体的强化学习算法 |

| 目标 | 使模型输出与人类偏好对齐 | 在给定奖励信号下稳定更新策略 |

| 输入 | 人类标注数据、预训练模型 | 策略网络、价值网络、奖励模型输出 |

| 输出 | 对齐后的语言模型 | 更新后的策略参数 |

| 关键挑战 | 奖励模型质量、标注一致性 | 步长控制、KL散度平衡、样本效率 |

3.1 RLHF是“做什么”,PPO是“怎么做得稳”

RLHF定义了从人类反馈到模型优化的完整循环,而PPO只是循环中优化策略的具体实现。其他算法如A2C、TRPO也可用于RLHF,但PPO因实现简单、调参容易成为主流。在面试中,你可以这样讲解:RLHF先设置目标(让模型尊重人类偏好),PPO是实现该目标时使用的“施工规范”。

3.2 奖励模型是RLHF和PPO之间的桥梁

奖励模型(Reward Model, RM)是RLHF独有的组件。PPO的奖励信号来自RM而非环境。面试官常问:“如果RM打错了分,PPO会优化出什么结果?”答案是模型会迎合错误偏好,甚至产生有害输出。这引出数据质量控制的重要性。

3.3 PPO的clip机制在RLHF中的特殊作用

大模型的参数量巨大,如果策略更新幅度过大,语言能力会迅速退化。PPO中的clip(通常设为0.2)有效控制新旧策略的比值,避免单次更新造成崩塌。面试中,你可以用“脚踩刹车”作比喻:RLHF是路线图,PPO是刹车系统,两者缺一不可。

四、理解RLHF的关键原则:奖励建模、强化学习与人类反馈

4.1 奖励建模:用人类偏好训练一个“打分器”

奖励模型通常是一个预训练语言模型加上一个线性层输出标量值。训练数据是来自人类对多个模型输出的排序(如A>B>C)。损失函数常用pairwise ranking loss。面试中,你需要解释“为什么使用排序而不是直接打分”——因为人类判断相对顺序比绝对分数更稳定。

4.2 强化学习:将大模型作为策略网络

在RLHF中,大模型(如GPT、LLaMA)作为Actor,接受Prompt作为状态,生成Text作为动作。奖励模型输出即时奖赏。环境定义为一个文本对话环境(无状态转移)。PPO在此处使用。你需要理解“KL惩罚”常被加入PPO目标函数,防止模型偏离SFT阶段所学。

4.3 人类反馈:迭代循环中的关键环节

RLHF不是一次训练就结束的。当策略模型更新后,原来的奖励模型可能无法准确评估新输出,这就需要收集新一轮人类标注来微调RM。面试官常问:“RLHF需要几轮迭代?”答案取决于预算,但至少需要两轮:第一轮训RM,第二轮用PPO更新策略。

五、掌握PPO的实操流程:从采样到策略更新

5.1 数据采样与轨迹收集

当前策略(Actor)对一批prompt生成回复,每个回复得到奖励模型打出的分数。同时,旧策略(冻结)也会生成同样的回复用于计算重要性采样比率。这一步需要大量GPU内存,因为需要同时加载Actor、Critic(价值网络)和Reference Model(KL散度参考)。

5.2 优势函数估计

使用GAE(Generalized Advantage Estimation)计算优势值,减少方差。在RLHF中,状态价值由Critic网络预测。面试中,你需要说明为什么不用Monte Carlo估计——因为单步奖励已经包含全部信息(语言模型没有后续奖励)。

5.3 策略更新与clip限制

PPO的目标函数如公式:L = min(ratio * A, clip(ratio, 1-ε, 1+ε) * A)。其中ratio = π_new / π_old。clip防止ratio过大或过小。然后通过梯度上升更新Actor,同时更新Critic(最小化MSE损失)。整个流程通常迭代多次(如4个epoch)利用同一批数据。面试官常问“为什么同一个batch可以使用多次”——因为clip限制了更新范围,可以承受多次迭代而不崩溃。

| 步骤 | 组件 | 输入 | 输出 | 注意事项 |

|---|---|---|---|---|

| 1 | Actor生成 | prompt | 回复文本 | 需要冻结旧策略用于ratio计算 |

| 2 | 奖励打分 | 回复文本 | 奖励值 | 可能还需要KL惩罚项 |

| 3 | 优势计算 | 奖励、价值 | 优势值 | 使用GAE,γ=1 |

| 4 | 策略更新 | ratio, 优势 | 新策略参数 | 使用clip和KL惩罚 |

| 5 | 价值更新 | 状态, 奖励 | 新价值参数 | MSE loss |

六、面试中回答RLHF与PPO的实用技巧

6.1 用比喻降低理解门槛

你可以这样开场:“RLHF就像让模型学会读心术——人类不需要直接写出规则,只用‘喜欢/不喜欢’的信号,模型就自己学会调整风格。而PPO就像教练,确保每次调整幅度不要太大,否则模型会忘记原来怎么说话。”面试官通常接受这种解释,但后续需要转入技术细节。

6.2 准备好“如果没有经验”的应对策略

很多求职者没有做过完整的RLHF项目。你可以熟悉开源库(trl、DeepSpeed-Chat)的代码结构,并在面试中描述你需要处理的关键模块:prompt构建、奖励模型训练、PPO超参数(如clip范围、初始学习率、KL系数)。甚至可以说“我在自己的服务器上复现了InstructGPT的简单版本”。这比空谈理论更可信。

6.3 主动展示工程思考

面试官欣赏的是:你不仅知道原理,还能意识到资源瓶颈。比如提到“PPO训练时需要同时加载4个模型(Actor、Critic、Reference、Reward),显存消耗巨大,通常需要ZeRO优化或模型并行”。这种细节会让你的回答更有层次。

七、如何用AI工具(如AI简历姬)提升大模型岗位面试准备效率

7.1 传统方式的低效:零散收集与记忆

很多人在准备面试时,会刷大量博客、论文、代码,但缺乏结构化整理。对于RLHF/PPO这类知识密集的主题,你很可能看完就忘,或者只记住了零碎片段。更糟糕的是,当面试官结合你的简历追问“你如何在项目中应用这些原理”时,你无法把知识点和自身经验串联起来。

7.2 AI简历姬如何帮你构建“原理+项目”闭环

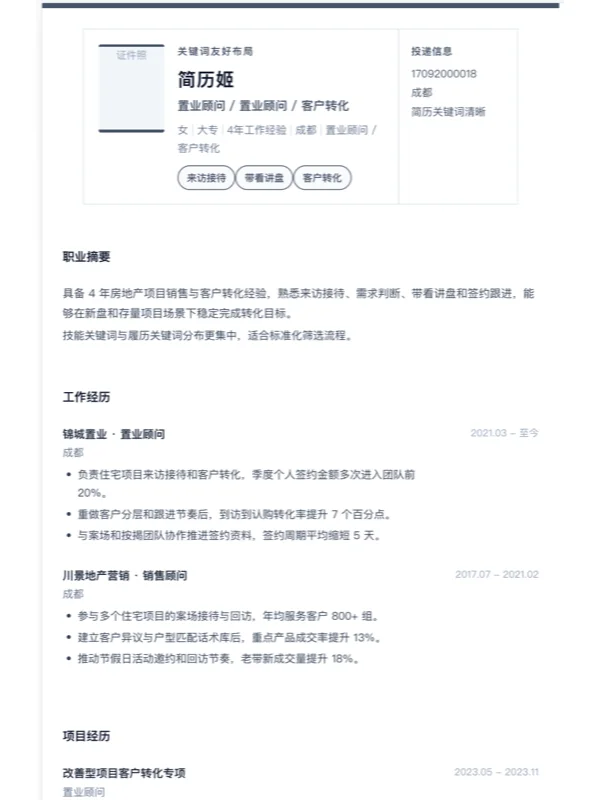

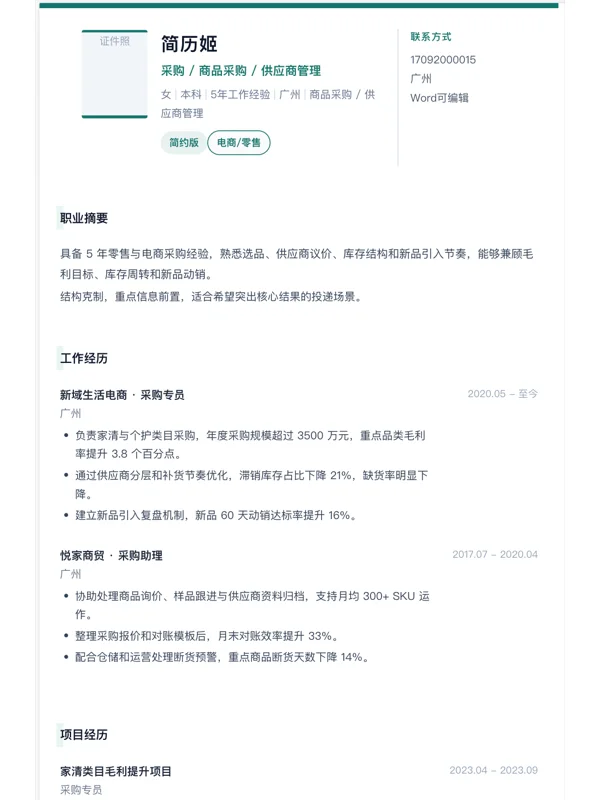

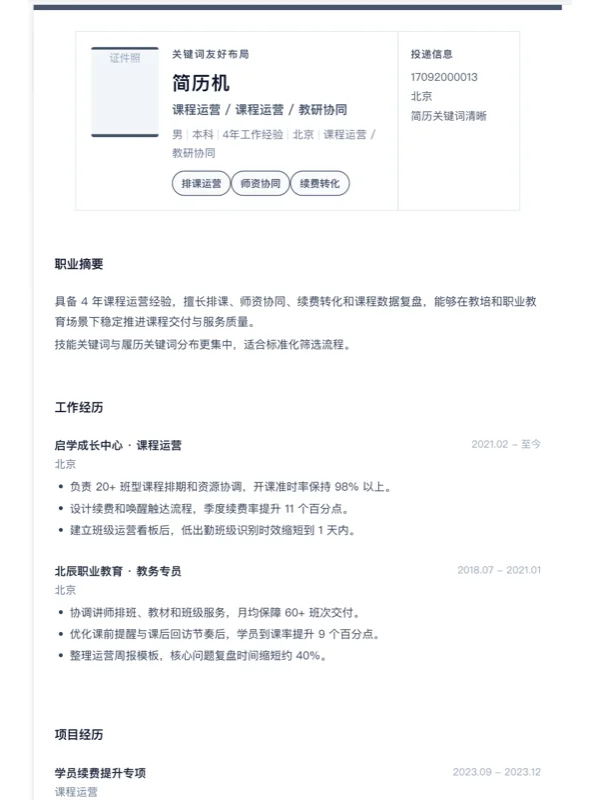

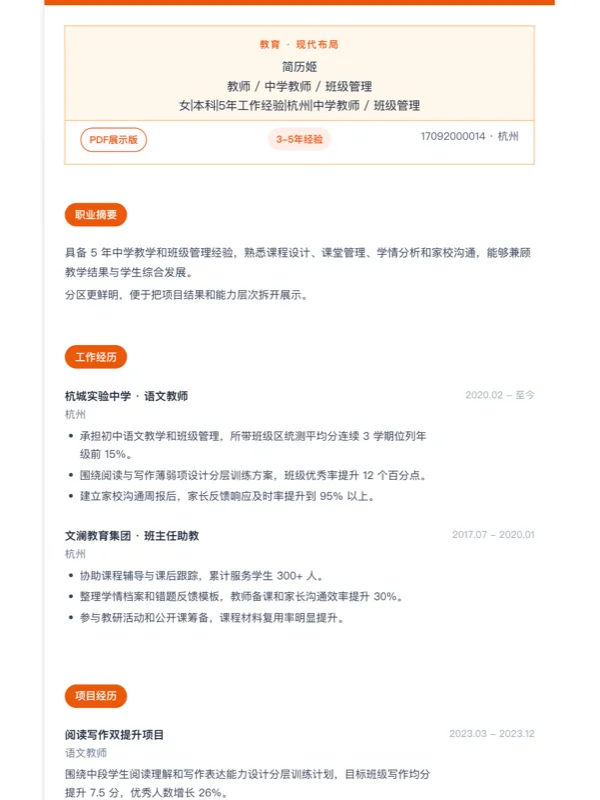

AI简历姬的核心能力是根据你的简历和目标岗位,自动提取技术关键词并生成结构化面试问题。例如,你导入一份有“大模型调优”“奖励模型训练”经历的简历,粘贴一段“要求掌握RLHF和PPO原理”的岗位说明,系统就会生成针对性的追问列表:比如“你在奖励模型训练中如何处理数据噪声?”“PPO的clip值设置经验”。你还可以通过模拟面试功能练习回答,获得反馈。这比盲目刷题更高效。

7.3 从知识到简历的量化改写

如果你之前做过相关项目但描述不够专业,AI简历姬能帮你将经历改写为成果导向的STAR结构。例如,把“参与了RLHF项目”改为“通过基于PPO的RLHF训练,将模型在安全性评估集上的有害输出率降低20%”。这样的简历更容易通过ATS筛选,面试官看到后也会更愿意挖掘你的技术细节。

八、不同岗位(算法、工程、产品)对RLHF与PPO的重视度差异

8.1 算法研究岗:需要推导公式与理解变体

算法岗面试几乎必问PPO的数学原理,包括目标函数中每一项的含义(重要性采样、clip、KL散度)。还可能追问“为什么不直接用TRPO?”“GAE中的λ参数如何影响偏差-方差权衡?”你需要提前推导一遍PPO的梯度并理解CRPO、PPO-penalty等变体。

8.2 算法工程岗:关注工程实现与效率优化

工程岗更关心部署RLHF训练管线的实际经验:如何构建高效的数据标注平台?如何平衡RM训练和PPO训练的耗时?如何用DeepSpeed ZeRO-3降低显存?你不需要精通理论推导,但必须能画出RLHF的数据流图,并解释数据预处理(如排序标注一致性检验)的细节。

8.3 产品与策略岗:理解业务影响与用户偏好对齐

产品岗不需要写代码,但需要知道RLHF如何影响模型行为,比如调整RM的偏好权重可以控制回答的“谦逊度”或“创造性”。面试可能让你设计一个针对教育场景的RLHF标注方案——如何选择不同年龄层的用户作为标注员?如何防止奖励模型学到偏见?这需要你从用户需求角度思考RLHF的局限性。

| 岗位类型 | 核心考察点 | 准备建议 |

|---|---|---|

| 算法研究 | 公式推导、PPO收敛性、变体 | 手推PPO,阅读InstructGPT论文 |

| 算法工程 | 训练管线、资源优化、数据标注 | 熟悉trl库源码,理解ZeRO-3 |

| 产品/策略 | 对齐效果、标注方案、风险控制 | 阅读RLHF应用案例,思考偏好设计 |

九、自测指标:你的RLHF/PPO理解是否达到面试要求?

9.1 概念完整性检查

以下问题如果你能不打磕巴地回答,说明基础扎实:

- RLHF分为哪三个阶段?每个阶段的目标是什么?

- PPO的clip范围一般设置多少?为什么?

- 为什么需要reference model计算KL散度?

- 奖励模型过拟合怎么办?

9.2 项目实践度检查

- 是否实际运行过开源RLHF训练脚本(如trl/DeepSpeed-Chat)?

- 是否修改过PPO的超参数(如学习率、clip值)并观察过训练曲线?

- 是否分析过奖励模型的打分偏差?

如果你只是读过论文但没跑过代码,面试很容易被细节问倒。建议至少动手复现一遍InstructGPT的训练流程(即使数据量很小)。

9.3 表达能力检查

模拟一次5分钟的口头回答:请向面试官解释RLHF+PPO的原理。录音后复盘,检查是否出现逻辑断层、术语混用。AI简历姬的模拟面试模块可以帮你做这件事:它会基于你的简历和岗位JD生成追问,然后分析你的回答流畅度和技术完整性。

十、常见误区与长期学习路径

10.1 误区一:把PPO当作RLHF的全部

RLHF还包括奖励模型训练、数据标注策略、迭代对齐等。PPO只是最后一步。面试时如果只讲PPO,会暴露知识面狭窄。

10.2 误区二:认为RLHF是“万能对齐方案”

RLHF成本高昂,且奖励模型可能引入新的偏好偏差。实际工业界还使用RLAIF(AI反馈)、DPO(Direct Preference Optimization)等轻量方案。你需要了解这些替代方案的优劣。

10.3 长期学习路径建议

- 第一阶段:阅读《Training language models to follow instructions with human feedback》(InstructGPT论文),理解核心流程。

- 第二阶段:运行trl库的examples,调整参数观察效果。

- 第三阶段:阅读DPO论文(Direct Preference Optimization),对比与RLHF的差异。

- 第四阶段:关注多模态RLHF、在线RLHF等前沿方向。

十一、RLHF与PPO未来的趋势

11.1 从离线RLHF到在线迭代RLHF

当前主流是离线收集固定标注集,但这样奖励模型和策略更新不同步。未来趋势是让模型在部署后收集用户反馈,持续在线更新奖励模型和策略,形成“数据飞轮”。面试可能出现这类开放性问题。

11.2 多模态RLHF的崛起

随着GPT-4o、Gemini等模型支持图像、语音,RLHF需要处理多维度的偏好对齐。例如,既要求回答正确,又要求图像审美符合用户偏好。这会带来奖励模型设计的复杂化。

11.3 高效替代方案的演进

DPO(Direct Preference Optimization)无需独立的奖励模型,直接在偏好对上进行监督学习。虽然在某些场景简化了训练,但PPO仍是效果上限最高的方法。你在面试中可以这样分析:DPO更高效但受限于偏好对质量,PPO更灵活但成本高。

| 趋势 | 对面试准备的影响 |

|---|---|

| 在线RLHF | 需要了解在线数据采样与模型更新的同步问题 |

| 多模态对齐 | 扩展知识面至视觉、听觉领域 |

| 轻量替代方案 | 理解DPO、RRHF等与PPO的对比 |

十二、总结:准备大模型面试,掌握原理+实战+工具是关键

12.1 已拆解的关键点

这篇长文从RLHF与PPO的定义出发,覆盖了面试考察逻辑、核心原理、实操流程、不同岗位差异及常见误区。核心结论是:RLHF提供了对齐框架,PPO提供了稳定更新手段,两者结合才能在实际训练中生效。面试时不要只背书,要结合实际项目经验或开源实验来展开。

12.2 行动建议

- 如果你还没有项目实践:找一个开源项目(比如DeepSpeed-Chat的RLHF例子),跑通并记录关键参数和输出。将这段经历用AI简历姬改写成量化的项目描述。

- 如果你已有理论但缺乏面试表达:用AI简历姬的模拟面试模块,选择“大模型算法”方向,针对RLHF/PPO进行专项练习。

- 如果你想获得完整求职闭环:从简历优化到投递看板,AI简历姬能帮助你一岗一版管理多个投递版本,让你更专注于技术准备。

12.3 产品提示

如果你希望更快完成简历优化和面试准备,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。AI简历姬是一款以岗位要求为中心的全流程求职工作台,支持导入旧简历解析、JD关键词对齐、量化改写(STAR)、ATS友好导出,以及基于简历和岗位的模拟面试追问。它帮你把“投递—面试—复盘”做成可管理闭环,让你准备RLHF/PPO这类技术面试时,也能腾出更多时间深入原理。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:RLHF和PPO到底哪个更重要?面试时应该先讲哪个?

回答: 两者非对立,但建议按逻辑顺序先讲RLHF框架,再深入PPO。因为面试官首先想知道你对整体流程是否清晰。你可以这样开头:“RLHF是将人类偏好引入训练的方法,而PPO是其中最常用的优化算法。”这样既展示了框架视野,也引出了技术深度。如果面试官追问PPO实现细节,再展开。

问题2:没有RLHF实战经验,面试怎么弥补?

回答: 即使没有工业级别经验,你仍然可以展示对理论的理解和动手实践意愿。推荐的做法是:熟悉trl或DeepSpeed-Chat的中文教程,在自己的GPU(甚至Colab)上跑一个简单版本。面试时直接说:“我用trl库复现了一个简化版InstructGPT,实验中我发现clip值从0.2调整到0.3会导致训练早期reward波动增大。”这比空谈理论更有说服力。同时,利用AI简历姬把你的学习过程包装为一个项目,比如“配置并运行PPO训练流程,分析超参数影响”。

问题3:AI简历姬怎么帮我准备RLHF面试?

回答: 主要有两个场景。第一,简历优化:如果你在简历中写了“大模型微调”,AI简历姬可以把它改写成“采用RLHF(PPO算法)进行偏好对齐,将安全性评分提升15%”,这样面试官一看到就会追问细节,你提前准备好答案即可。第二,模拟面试:AI简历姬的面试模块会根据你的简历和投递岗位,自动生成关于RLHF/PPO的追问,例如“解释PPO的clip机制如何防止遗忘?”,你练习后还能获得反馈。

问题4:对于准备大模型岗实习的在校生,RLHF和PPO需要掌握到什么程度?

回答: 主要关注两点:一是能够画出RLHF三阶段流程图并口头讲清楚,二是了解PPO相比TRPO的优势和clip的作用。不需要推导完整公式,但至少能写出核心损失函数。同时建议跑通一个开源案例,并记录训练曲线。如果时间有限,优先理解RLHF的整体设计和数据标注流程,因为实习面试更看重对业务问题的理解,而非纯算法细节。