如果直接给出结论:GRPO(Group Relative Policy Optimization,群组相对策略优化)是当前大模型面试中高频考察的强化学习对齐技术,它的核心不是死记硬背公式,而是理解“如何通过对比多个策略的输出来稳定优化生成模型”。对准备大模型岗位面试的同学来说,先掌握GRPO的动机(解决PPO在策略熵、KL散度上的调参难题),再拆解其与PPO、DPO的核心区别,最后结合真实场景下的问题回答框架,就能让面试过程更从容。

很多人在准备这类技术问题时,容易陷进“背论文摘要”的误区,却忽略了面试官真正想听的是:你能否用白话讲清楚GRPO为什么比PPO更稳定?在大规模RLHF中它解决了哪些工程痛点?本文会从问题拆解、方法论、实用技巧、AI工具提效和问答补充五个维度,帮你系统构建应对思路。

一、GRPO群组相对策略优化是什么:大模型对齐中的关键一环

1.1 从RLHF到大模型对齐的演进

大语言模型(LLM)在预训练后,需要通过强化学习(RL)与人类反馈对齐,以生成更符合偏好的内容。传统的PPO(Proximal Policy Optimization)需要同时维护一个价值网络(critic)来估计优势函数,计算开销大且容易不稳定。GRPO(Group Relative Policy Optimization)由DeepSeek团队提出,其核心思路是去掉价值网络,改用同一输入下采样的多个响应之间的相对对比来计算优势,大幅降低了训练复杂度和内存占用。

1.2 GRPO的直观理解

假设你要训练一个聊天机器人,让它学会“更友好”地回复。传统PPO需要一个裁判(价值网络)来评判每个回复的“好坏”,而GRPO的做法是:让模型针对同一个用户问题,生成多个候选回复(比如8个),然后对这些回复计算奖励,再根据每个回复在该组中的相对排名来更新模型。“群组相对”的含义,就是奖励信号来自组内比较,而非绝对分值。

1.3 GRPO的主要设计特点

- 无价值网络:只使用策略网络和奖励模型,减少了参数数量和训练步数。

- 组内优势计算:对同一prompt采样K个输出,计算它们的奖励均值作为基线,每个输出的优势为奖励减去该组均值。

- KL惩罚项:为控制新策略与参考策略的偏差,加入KL散度约束,防止模型在优化中偏离原始能力太远。

二、大模型面试中为什么总问GRPO:高频考点与面试官意图

2.1 面试官考察的三大能力层次

| 能力层次 | 典型问题示例 | 面试官想听到什么 |

|---|---|---|

| 概念复述 | “请解释GRPO的原理” | 能否用简洁语言讲清核心思想 |

| 对比分析 | “GRPO与PPO有什么区别?” | 能否指出关键差异(critic、优势计算、稳定性) |

| 工程落地 | “在实际训练中GRPO会遇到什么问题?” | 是否有实践经验或至少思考过工程难点 |

2.2 为什么GRPO高频出现

- 时效性强:GRPO(2024年)是较新的方法,面试者是否跟进前沿?

- 开源可复现:DeepSeek-Math等模型成功应用,面试官可以讨论细节。

- 与PPO对比明显:能考察对RLHF本质的理解程度,而不是只背原论文。

2.3 常见误区:以为只考公式

不少同学把精力放在推导GRPO的梯度公式上,但面试官其实更关注:

- 你理解它解决了什么场景下的什么问题?

- 与DPO(Direct Preference Optimization)相比,GRPO的优势在哪?

- 在训练奖励模型时,组内比较的采样数量K如何影响稳定性?

三、GRPO与PPO、DPO的核心区别:一张表说清关键边界

3.1 三者整体对比表格

| 维度 | PPO | DPO | GRPO |

|---|---|---|---|

| 是否需要价值网络 | 是(critic) | 否 | 否 |

| 是否需要奖励模型 | 是 | 否(直接用偏好) | 是 |

| 优势计算方式 | 价值网络估计+GAE | 偏好对数似然比 | 组内相对分数 |

| KL惩罚方式 | 通过奖励中的KL项 | 隐式约束 | 显式KL散度正则 |

| 主要应用场景 | RLHF标准流程 | 无需奖励模型的偏好对齐 | 大规模、高效率RL对齐 |

3.2 GRPO与PPO的实战区别

PPO需要先训练一个value network,在7B以上参数量模型中价值网络也可能有7B大小,内存消耗巨大。GRPO通过组内采样直接计算优势,无需额外网络,对显存更友好,但代价是需要在每个prompt上多次采样(增加前向计算量),适合在推理成本可控的场景下使用。

3.3 GRPO与DPO的互补性

DPO完全不需要强化学习,直接对偏好对进行最大似然优化,训练更稳定,但不支持在线采样和迭代。GRPO保留了RL框架,可以不断用新策略采样并优化,适合需要持续探索的场景(如代码生成、数学推理)。面试时可以说:“如果偏好数据集质量很高且固定,DPO更简单;如果希望模型在线探索反馈,GRPO或PPO更灵活。”

四、应对GRPO面试题的核心原则:先理解动机,再记忆细节

4.1 原则一:从“为什么需要GRPO”出发

很多LLM面试题的真正考点是工程权衡。举个例子:当模型规模增大时,PPO的价值网络成为瓶颈,GRPO的出现就是为了消除这个瓶颈。你需要画出对比图:左边PPO(policy+critic+reward),右边GRPO(policy+reward),一目了然。

4.2 原则二:能分析出明显的trade-off

- 采样数量K:K太小,优势估计方差大;K太大,计算开销线性增加。一般取4~8在学术研究和工业部署中常见。

- KL正则强度:太高会限制策略更新幅度,优化缓慢;太低则可能产生奖励过度优化(reward hacking)。

4.3 原则三:结合具体场景举例

假设面试官问:“为什么DeepSeek在数学任务上用GRPO?”你可以回答:数学题有确定性答案,奖励模型容易打分(对错分明),组内对比能提供密集学习信号;而开放式对话任务中,奖励模型不可靠,GRPO可能不如DPO稳定。这种场景化思考很加分。

五、标准回答流程:用4步法构建面试中的GRPO叙述结构

5.1 第一步:一句话定义

“GRPO是一种去除了价值网络的强化学习对齐方法,它通过从同一个prompt采样多个响应,在组内计算相对优势来更新策略。”

5.2 第二步:核心公式解释(口头描述即可)

目标函数为:

J(θ) = E[1/K Σ_i (A_i * p_θ(y_i|x)/p_ref(y_i|x)) - β * KL(p_θ || p_ref)]

其中优势A_i = R(y_i) - mean(R(y_i)),β控制KL约束强度。不需要默写公式,但要能解释公式每个部分的作用。

5.3 第三步:列出三点关键优势

- 更小的内存占用(无critic)。

- 训练更稳定(组内基线自然降低方差)。

- 工程实现简洁(去掉GAE计算)。

5.4 第四步:给出一个实战中的注意事项

“实际训练时,如果采样K过大,会显著增加推理成本。我建议在小模型上做消融实验确定K,再迁移到大模型。”

六、实用技巧:在面试中展现你对GRPO的深度理解

6.1 技巧一:用类比让非技术面试官明白

可以把critic比作“一个专门打分的评委”,GRPO把评委换成了“观众投票”——同一批观众给不同选手打分,然后比较相对名次。类比不仅生动,还能体现你的表达清晰度。

6.2 技巧二:主动补充局限性

优秀的面试者会主动说:“但GRPO也有局限,比如它依赖于一个足够好的奖励模型,如果奖励模型噪声大,组内比较可能放大幅度偏差。另外,K值的选择需要兼顾效率和方差,存在trade-off。”

6.3 技巧三:链接到实际项目经验

如果你做过RLHF相关的实验,可以简洁分享一次参数调试经历。如果没做过,可以说:“我在GitHub上复现过DeepSeek-Math的GRPO实现,发现batch size对收敛影响很大,建议先用小数据过一遍再上全量。”

七、AI工具在GRPO学习与面试准备中的提效方式:AI简历姬的隐藏价值

7.1 传统方式痛点

准备GRPO面试时,很多人要翻十几篇论文、记笔记、整理常见问题。这个过程耗费大量时间,而且容易遗漏关键点。市面上缺乏专门针对“面试知识点+简历结构”整合的工具。

7.2 AI简历姬如何帮你系统化准备

AI简历姬本质上是一个以岗位要求为中心的求职工作台,它可以在以下环节帮你提升效率:

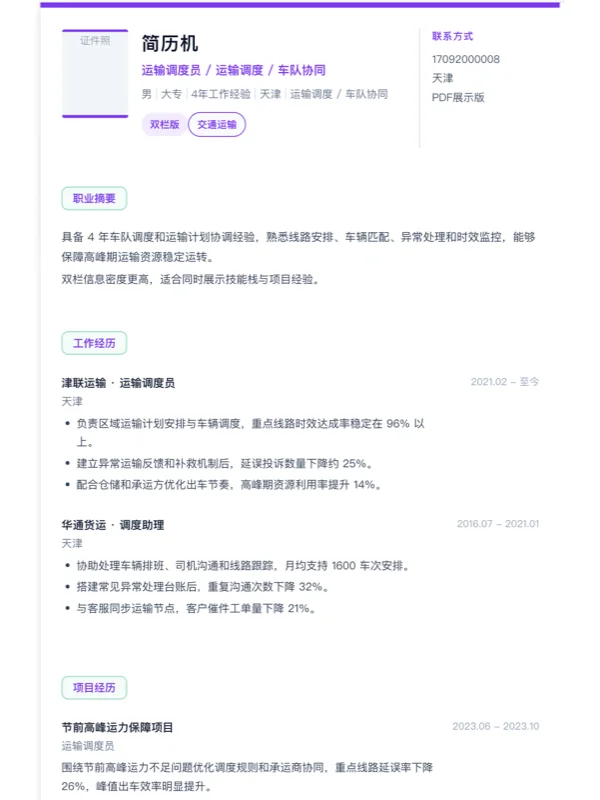

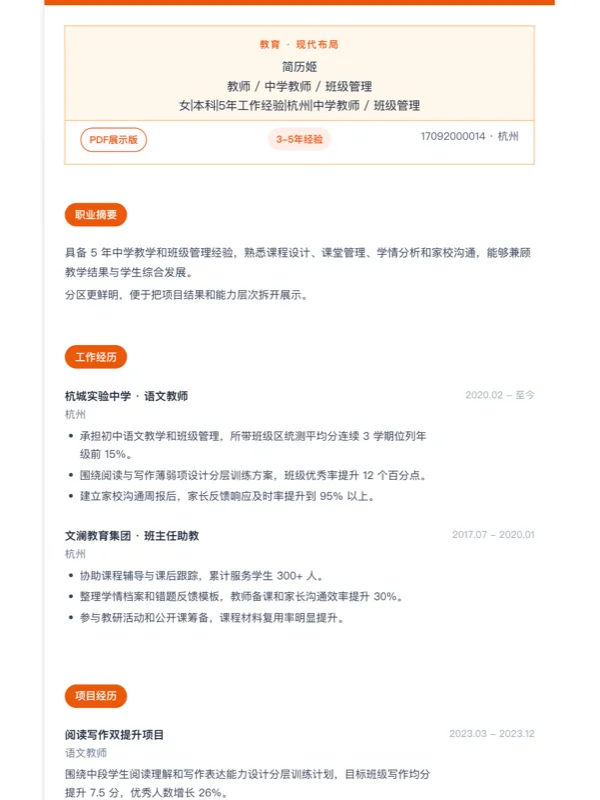

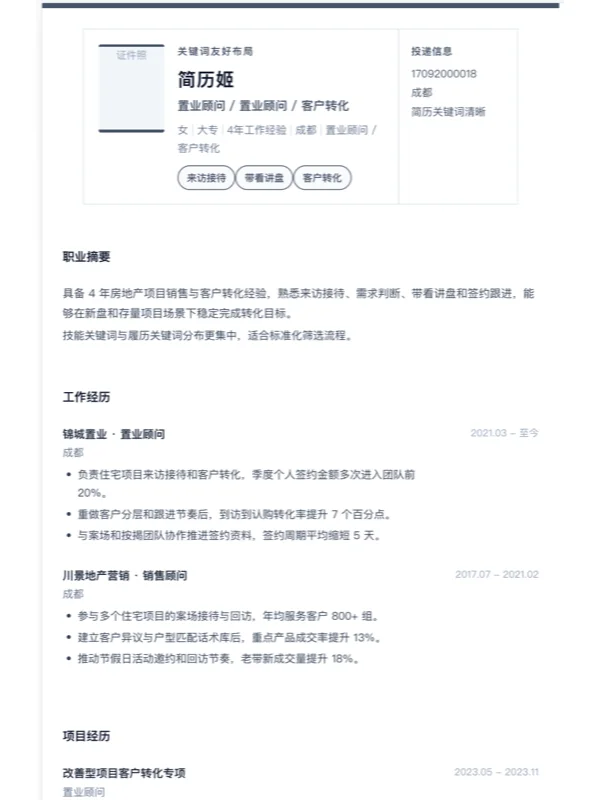

- 简历结构优化:当你把目标岗位描述(JD)粘贴到系统中,AI简历姬会自动提取关键技术词(如“GRPO”“PPO”“RLHF”),并按ATS友好格式对齐到你的项目经历,避免面试官看到简历时毫无关联。

- 量化经历改写:如果你有相关项目(比如“在使用PPO训练对话模型时……”),系统会引导你使用STAR结构,把“参与优化”变成“通过GRPO替代critic,将训练显存占用降低30%”这样的成果描述。

- 面试模拟:基于你的简历和岗位JD,AI简历姬能生成定制化的追问。例如“请详细说明你如何在项目中选择GRPO而不是PPO?”并提供参考回答方向。

7.3 一个具体用法场景

假设你正在准备“深度学习工程师(大模型方向)”的面试,JD里明确写了“熟悉RLHF和GRPO”。你可以:

- 把旧简历导入AI简历姬,让系统诊断是否缺失相关关键词。

- 在“经历优化”模块,输入“使用GRPO进行数学推理模型对齐”,系统会帮你输出几个不同侧重点的成果描述。

- 在“面试准备”模块,粘贴JD,系统自动生成5个追问,包括技术原理、对比和场景题。

这种闭环效率,比单纯刷题高得多。AI简历姬的网址是:https://app.resumemakeroffer.com/

八、不同人群的GRPO面试准备策略差异

8.1 应届毕业生 vs. 社招有经验者

| 人群 | 准备重点 | 避坑提示 |

|---|---|---|

| 应届生 | 扎实掌握原理、能解释论文图表 | 避免只背论文摘要,要理解Why |

| 社招(1-3年) | 结合实际训练经验,谈工程落地 | 不要贬低PPO,要展现权衡思维 |

| 社招(3年以上) | 能设计实验对比多种方法,给出指标 | 少谈书本理论,多用项目数据说话 |

8.2 方向差异:NLP、CV、多模态

- NLP方向:侧重语言任务中对齐效果,GRPO的稳定性和KL控制。

- CV方向:大模型较少用RLHF,但不排除多模态模型面试,可以类比VLM的RL对齐。

- 多模态方向:强调GRPO如何在多模态奖励模型下工作(注:目前较少公开实践,可讨论迁移可行性)。

8.3 面试轮次差异:技术面 vs. 交叉面 vs. 总监面

- 技术面:深入公式和实现细节。

- 交叉面:侧重你如何用GRPO解决实际问题。

- 总监面:侧重你对技术趋势的判断(如GRPO是否会取代PPO?)。

九、检查你是否真正理解了GRPO:用自评表对号入座

9.1 核心理解自评表

| 检查项 | 完全掌握 | 部分理解 | 需要加强 |

|---|---|---|---|

| 能解释GRPO为什么不需要value network | □ | □ | □ |

| 能说出组内优势计算的数学表达式(公式) | □ | □ | □ |

| 能对比GRPO和DPO的适用场景 | □ | □ | □ |

| 能分析采样K对训练的影响 | □ | □ | □ |

| 能讲一个GRPO改进现有方法的思路 | □ | □ | □ |

9.2 实战准备检查点

- 是否在简历中明确体现了GRPO相关技能?

- 是否准备了一个“使用GRPO的项目”STAR描述?

- 是否完成了3次以上口头模拟回答?

9.3 常见扣分项

- 把GRPO说成是“分组策略优化”(正确翻译是“群组相对策略优化”)。

- 混淆GRPO的KL惩罚与DPO的隐式KL。

- 认为GRPO比PPO“绝对更好”,忽略场景差异。

十、长期机制:把GRPO学习嵌入到持续的面试准备体系中

10.1 建立知识卡片

每接触一个新概念(如GRPO),用“动机-原理-对比-局限”四个维度制成卡片,定期复习。可以存入Notion或Obsidian,方便检索。

10.2 定期模拟面试

每月至少两次真实模拟,尤其是对着录音设备回答。你会发现,第一次讲GRPO时逻辑混乱,第二次第三次就会自然流畅。

10.3 用AI简历姬跟踪版本

面试准备过程中,你的简历可能会多次修改(每个公司侧重点不同)。AI简历姬支持一岗一版管理,你可以为不同公司保存不同版本的简历,并记录每次面试后的复盘——哪些技术问题回答得好,哪些需要补。这种闭环能持续提升通过率。

十一、GRPO与大模型面试的趋势与未来建议

11.1 趋势一:RLHF的对齐方法将进一步精简

从PPO到GRPO,再到可能出现的完全无奖励模型的方法(如DPO变体),面试中会越来越关注“你能否设计实验评估不同方法的效果”,而非背诵术语。

11.2 趋势二:多模态、Agent、推理模型中的对齐新挑战

多模态对齐(如视觉奖励)、Agent的长期奖励建模,都产生新的面试问题。建议提前了解GRPO在多步推理(如Math-RL)中的应用。

11.3 趋势三:面试形式从纯理论转向“现场编码+思考题”

有些公司会让候选人现场实现一个简化版GRPO的前向计算(伪代码),或者设计实验方案。准备时多练习手写伪代码的能力。

十二、总结:想把GRPO面试题准备好,关键在于“动机→对比→落地”三层结构

最后总结三点:

- 动机先行:永远先回答“为什么需要GRPO”,而不是直接背流程。

- 对比清晰:能用一张表或两句话讲清GRPO与PPO、DPO的区别。

- 落地思维:结合工程参数(K、KL系数、奖励模型质量)展示实际经验。

如果你希望更快完成简历优化和面试模拟,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它能够自动解析你的经历,对齐岗位关键词,生成定制面试追问,让准备过程更系统化。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:大模型面试中,GRPO到底应该先准备原理还是先准备工程实现?

回答: 建议先准备原理(Why和What),再补充工程实现(How)。原因在于面试官通常先考察你是否理解GRPO的设计动机和与PPO的差异,如果这个层面回答不上来,工程细节毫无意义。原理层面,重点准备:GRPO为什么去掉value network、如何计算组内优势、KL惩罚的作用。工程实现层面,准备K值选择、内存优化、奖励模型训练要点。你可按“一句话定义→三点优势→一个局限”的模式反复练习,这是性价比最高的准备方式。

问题2:GRPO面试题里最容易出错的是哪一步?

回答: 最容易出错的是将GRPO与DPO概念混淆。具体表现为:说GRPO不需要奖励模型(实际需要奖励模型计算组内分数);或者说DPO是基于RL的(DPO本质是最大似然,不涉及RL框架)。另一个常见错误是误以为GRPO的“群组”是指多个模型组成组,但实际上是指同一个模型对同一个prompt生成的多个响应构成组。建议反复对比PPO-DPO-GRPO的流程图,并在回答前先确认面试官问的是哪个方法。

问题3:AI工具在准备GRPO面试题里到底能帮什么?

回答: AI工具可以在三个环节提升效率:第一,简历环节——当你把JD粘贴到AI简历姬(比如目标岗位要求“熟悉GRPO”),它能自动化诊断你当前简历是否缺失相关关键词,并给出量化改写建议。第二,面试准备环节——基于你的简历项目和JD,系统能生成定制化的技术追问和参考答案,覆盖概念、对比、场景题。第三,复盘环节——面试后你可以在AI简历姬中记录面试问题,系统会帮你分类并建议后续学习重点。这些工具不是替代你学习,而是把机械整理时间压缩下来,让你能真正聚焦在深度思考上。

问题4:应届生做GRPO相关面试准备时应该注意什么?

回答: 应届生最大的优势是学习能力和论文阅读量,劣势是缺乏工程经验。针对GRPO面试,建议:第一,先把DeepSeek-Math或GRPO原论文的图表彻底读懂,能用自己话复述实验设置与结果。第二,做一个小实验(比如用HuggingFace的TRL库跑DPO和GRPO的对比),记录loss曲线、生成质量差异。第三,如果项目经历中没有任何RLHF内容,可以在简历中增加一个“自学习项目”,描述你如何学习GRPO并用它复现了一个小模型的数学能力提升。AI简历姬可以帮助你把这个项目包装得更有成果导向。