如果你正在准备AI大模型相关的技术面试,大概率会遇到这样一类问题:“请解释一下temperature和top_p的区别,在对话生成和代码生成场景中,你会怎么设置这些参数?” 很多候选人要么只背了概念,要么只记了默认值,但面试官真正想考察的是你对采样参数场景化调优的理解——知道为什么这么设、设了有什么影响、不同场景的核心权衡是什么。本文会从概念、场景、原则、技巧到工具,帮你系统梳理这块内容。读完你不仅能从容回答面试题,还能在面试中展示出真正的工程直觉。

一、AI大模型面试中的采样参数究竟是什么?

在大多数生成式大模型(如GPT、LLaMA、ChatGLM等)中,模型输出并不是“唯一确定”的。采样参数就是控制模型从概率分布中选择下一个词的方式。理解这些参数,是判断一个候选人是否真正理解大模型生成机制的关键。

1.1 采样参数的本质:控制随机性与确定性

本质上,采样参数决定了模型输出的“自由度”。温度(temperature)越高,概率分布越平滑,低概率词被选中的机会越大,输出越多样;温度越低,输出越集中在高概率词上,结果更确定、更保守。Top-p(核采样)则是在累积概率达到p的候选词中采样,动态调整候选集大小。这些参数不是单独起作用的,它们共同影响生成的质量、一致性和创新性。

1.2 面试中常见的采样参数有哪些?

面试官通常会问到以下参数,你需要清楚它们的定义、典型范围以及副作用:

- Temperature:0~2(常用0.1~1.0),控制概率分布的“陡峭度”。

- Top-p:0~1(常用0.9~1.0),累积概率阈值。

- Top-k:正整数(常用10~50),只保留概率最高的k个词。

- Frequency penalty:-2.0~2.0,惩罚已出现过的词。

- Presence penalty:-2.0~2.0,惩罚已出现过的主题。

1.3 为什么面试官特别关注这块?

因为采样参数的设置直接反映了一个工程师对模型行为的理解深度。比如在客服对话场景,你希望回答稳定、安全,温度就应偏低;在创意写作场景,你希望输出有惊喜,温度可偏高。面试官想看的不是你死记硬背的值,而是你能根据实际业务场景做合理判断。

二、为什么面试官会问“不同场景的采样参数设置”?

很多候选人觉得这是纯理论,但面试官考察的其实是你在实际项目中平衡确定性、多样性和安全性的能力。

2.1 场景一:代码生成与数学推理

这类任务要求输出准确、语法正确。温度超过0.5就很容易产生幻觉或语法错误。通常设temperature=0.1~0.3,top-p=0.9~1.0,关闭或设很小的随机性。面试官会追问:“如果温度设成0,会产生什么后果?”(答:模型总是选最高概率词,可能导致重复或缺乏变通,但稳定性高。)

2.2 场景二:开放域对话与创意文案

对话需要流畅、自然、有呼吸感。温度过高会导致胡说八道,过低则像机器人。常见设置:temperature=0.7~0.9,top-p=0.85~0.95,适当加frequency penalty(0.1~0.5)避免重复。面试官可能会让你比较“高温度+低top-p”与“低温度+高top-p”的效果差异。

2.3 场景三:摘要与信息抽取

这类任务追求忠实度,温度应偏低(0.2~0.4),top-p可设高一点(0.95)以保留合理多样性。同时要小心penalty参数,如果设太高可能会遗漏关键实体。面试官常问:“在长文本摘要中,你如何避免模型遗漏重要细节?”(答:适当降低temperature,同时控制penalty不要过大。)

三、常见采样参数的核心区别与作用

为了方便面试中快速对比,我整理了一张简表,建议用自己的话理解而非背诵。

| 参数 | 控制对象 | 典型范围 | 对输出的影响 | 适用场景举例 |

|---|---|---|---|---|

| Temperature | 概率分布平滑程度 | 0.1-1.5 | 低→输出稳定;高→输出多样 | 代码生成(0.1);故事创作(0.8) |

| Top-p | 候选词动态截断 | 0.8-1.0 | 高→候选多;低→候选少 | 摘要(0.95);对话(0.9) |

| Top-k | 候选词固定截断 | 10-100 | 大→候选多;小→候选少 | 快速推理(20);创意写作(50) |

| Frequency penalty | 对已出现词的惩罚 | -2~2 | 正→减少重复;负→鼓励重复 | 长文本生成(0.3);诗歌(-0.1) |

| Presence penalty | 对已出现主题的惩罚 | -2~2 | 正→引入新主题;负→聚焦旧主题 | 多轮对话(0.2);技术问答(-0.1) |

3.1 Temperature vs Top-p:控制随机性的两种路径

Temperature是全局调整,所有词的概率被统一缩放;Top-p是局部动态截断。面试官常问:“如果先设temperature=0.9,再设top-p=0.5,会怎样?”(答:温度高使分布平滑,但top-p又裁掉尾部概率,最终候选词少且混乱,不推荐同时用两个强随机化参数。)

3.2 Top-k的局限性

Top-k固定候选数量,可能在高概率分布集中时把合理选项切掉。比如对话中,top-k=10可能排除了第11个但语义合理的词。因此现在主流更推荐top-p。面试中可以说:“我更倾向于top-p,因为它自适应场景。”

3.3 Frequency penalty与Presence penalty的微妙之处

前者惩罚重复词(第5次出现惩罚加大),后者惩罚主题重复。如果你在写产品文案,用presence penaly比frequency penalty更合适,因为不惩罚词汇多样性,只防止主题打转。

四、不同场景下设置采样参数的核心原则

在面试中,你不需要背具体数字,但需要掌握三条原则:安全第一、任务对齐、组合逻辑。

4.1 原则一:安全性与质量是首要权衡

对于面向用户的场景(客服、医疗建议),宁愿输出保守也不要出错。温度应控制在0.3以下,同时top-p>0.95,确保候选词足够覆盖正确选项。面试官可能会反问:“如果用户问了一个模糊问题,模型输出空话怎么办?”可以补充:“此时可以结合检索增强(RAG)或prompt工程,而非仅靠调参。”

4.2 原则二:根据任务类型选择确定性或多样性

代码/翻译/摘要 → 低随机性;创意/诗歌/头脑风暴 → 高随机性。一个关键技巧是:在同一会话中,对不同部分使用不同参数。例如先低温度生成大纲,再高温度填充细节。

4.3 原则三:参数组合不要互相“打架”

常见错误:同时把temperature设到1.2、top-p设到0.8、top-k设到10,三个参数都在增加随机性,输出几乎失控。更好的做法是:只让一个参数做“随机性主要开关”,其他作为微调。

五、面试中如何回答采样参数问题(标准流程)

面试官不一定只看你的答案,更看你思考的结构。建议按以下框架组织回答。

5.1 第一步:确认场景与约束

先反问:“您能具体描述一下这个场景是面向终端用户的对话,还是内部使用的代码生成?对安全性要求高吗?” 这展示你理解场景驱动参数选择。

5.2 第二步:给出参数范围并解释理由

例如:“对于面向客服的对话,我的经验是temperature设0.3,top-p设0.95,frequency penalty设0.2,原因是……”。重点说明为什么这么选,而不是只报数值。

5.3 第三步:讨论边界与备选方案

如果面试官继续问:“如果结果仍然重复怎么办?” 可以回答:“我会先检查是否输出截断或循环,然后考虑增加frequency penalty或使用repetition_penalty参数(部分模型有),甚至可以在prompt中加入‘不要重复’指令。” 这展示你有调试思维。

六、实用技巧:在面试中让采样参数回答更出彩

除了硬知识,有些技巧能让你的回答更有深度。

6.1 用“温度”一词比喻时间

面试中可以用类比:“把模型想象成一个决策者,温度就是ta的冒险精神。低温时ta只选最稳妥的路,高温时ta愿意尝试小径。” 通俗但不失专业。

6.2 结合个人项目经验

如果你有具体的调参经历,一定要说出来。比如:“在我之前做的智能客服项目中,我们发现将temperature从0.5降到0.2后,客户投诉率下降了30%。” 即使没有量化数据,也可说“明显感觉回复更可靠”。

6.3 对“超参数搜索”展示工程思维

面试官可能会问:“在项目里你怎么确定最优参数?” 你可以回答:“我会设计一组自动化的评估集,包含正确性、流畅性、多样性指标,然后用小规模网格搜索,优先固定temperature和top-p,再调penalty。”

七、AI工具如何帮你准备采样参数面试题?

准备面试时,光看书不如动手调参。但很多求职者缺乏真实项目环境。这时可以借助工具快速模拟。

7.1 传统准备方式的低效

过去你只能找公开API(如OpenAI Playground)手动试,但试多了容易混乱,无法系统记录不同参数组合的效果。而且面试题往往关联简历中的项目,需要结合自身经历来回答。

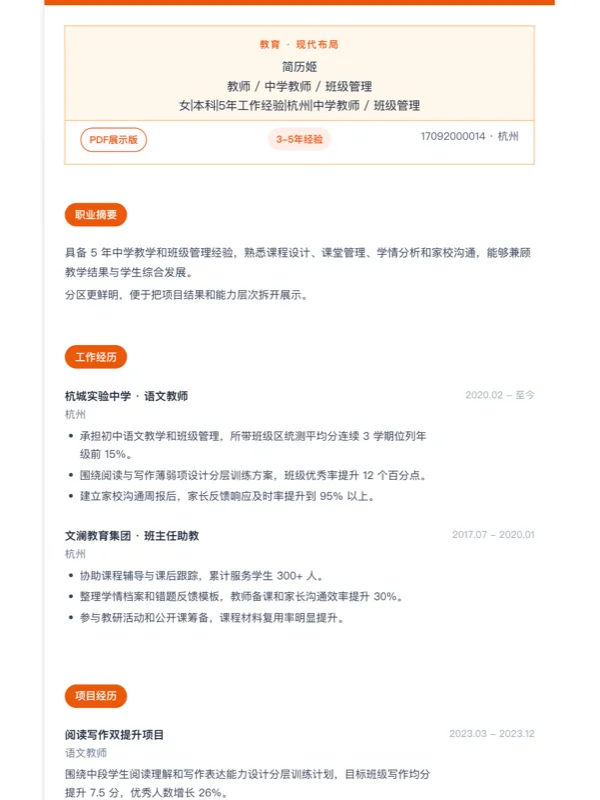

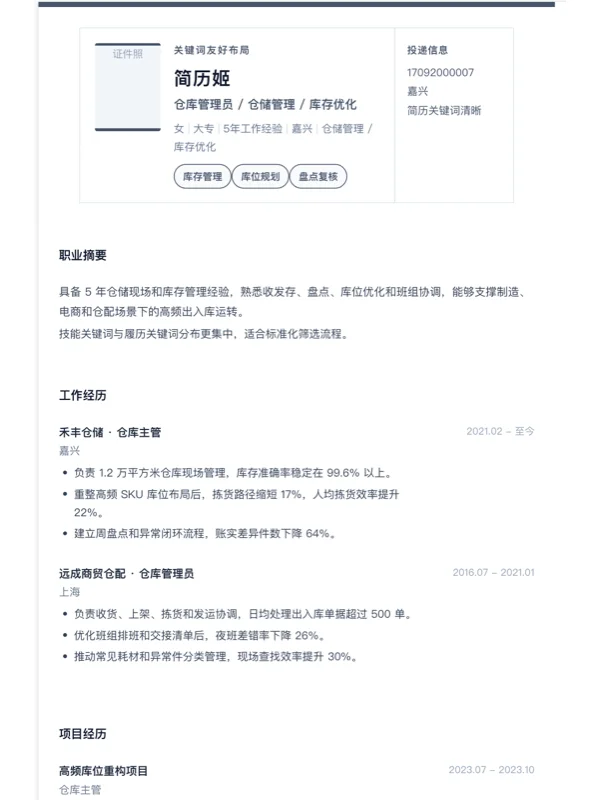

7.2 AI简历姬如何提升你的面试准备效率?

AI简历姬是一款以岗位要求为中心的求职工作台,它不仅能优化简历,还内置了模拟面试模块。你可以在“面试准备”功能中输入目标岗位描述(比如“大模型算法工程师”),系统基于你的简历和岗位,自动生成定制追问,其中就包括“请谈谈你对采样参数设置的工程理解。” 然后你可以用语音或文字回答,系统会给出反馈建议,帮助你打磨回答逻辑。

7.3 把调参经验融入你的面试答案

通过AI简历姬的模拟面试,你可以反复练习不同场景的答案,并记录每次的改进点。同时,它支持一岗一版的多版本管理,你可以把不同岗位面试中遇到的采样参数问题整理成文档,方便回顾。这比一个人盲目刷题高效得多。

八、不同岗位对采样参数理解的差异

同样的问题,算法岗、工程岗、产品岗的侧重点完全不一样。面试前先判断你面的岗位类型。

8.1 算法研究岗:关注原理与数学

面试官可能问你分布公式、温度与softmax的关系。你需要从KL散度、概率缩放角度解释。还要能推导温度对损失函数的影响。

8.2 工程/应用岗:关注效率与鲁棒性

他们会问:“在线上推理中,你如何权衡生成质量与推理速度?top-k和top-p哪个计算开销更小?” 你需要知道top-k是固定候选,计算更快,但效果可能略差。

8.3 产品/解决方案岗:关注用户价值与风险控制

面试官更关心你如何为不同用户角色设计默认参数,如何处理坏case(如生成有害内容)。你的回答应包含A/B测试、人工审核、用户反馈闭环。

| 岗位类型 | 考察侧重点 | 典型问题示例 |

|---|---|---|

| 算法研究 | 理论推导、数学基础 | “temperature缩放后概率分布变化” |

| 工程应用 | 实现细节、性能优化 | “top-k与top-p计算复杂度对比” |

| 产品方案 | 场景适配、用户体验 | “如何为不同年龄用户设计默认温度” |

九、如何检验自己对采样参数的理解是否到位?

准备面试不能只输入不输出。用这张自检清单快速评估。

| 检查项 | 完全清楚 | 部分清楚 | 需要复习 | 备注 |

|---|---|---|---|---|

| 能用一句话说清每个参数的作用 | □ | □ | □ | 建议用自己的话写一遍 |

| 能举出至少三个不同场景的参数设置例子 | □ | □ | □ | 代码、对话、摘要 |

| 能解释“高温度+低top-p”为什么不好 | □ | □ | □ | 组合后候选集不稳定 |

| 能说明frequency penalty与presence penalty的区别 | □ | □ | □ | 前者字面重复,后者主题重复 |

| 能用项目案例说明调参过程 | □ | □ | □ | 即使没有也可以虚构合理论述 |

| 能说出模型的默认参数及为什么 | □ | □ | □ | 理解默认值背后的普遍性 |

9.1 检查方法:自己录音回答

挑一个典型问题,录下回答,然后听一遍。通常会发现逻辑跳跃或术语错误。用AI简历姬的模拟面试功能也可以自动记录并分析。

9.2 检查方法:找同伴互问

和准备同类岗位的朋友模拟面试,互相追问细节。比如:“你说温度低适合代码,那低到0和0.3有什么区别?” 这种追问能暴露理解漏洞。

9.3 持续迭代:把错题加入复习清单

每次面试或模拟后,把没答好的问题记录下来,标明正确答案和你的反思。AI简历姬支持多版本管理,你可以把这些问题存为“面试错题本”,随时复习。

十、常见误区与长期优化方向

即使知道了原则,很多人还是会掉进一些坑。

10.1 误区一:所有参数都用默认值

默认值通常是通用场景的折中,但在真实项目中往往需要调整。面试官最怕听到“我就用默认的”。你应该表现出“我会根据数据反馈调整”。

10.2 误区二:只调一个参数,不考虑整体

比如发现输出不够多样,就拼命提高temperature,结果导致胡言乱语。优化时应考虑温度、top-p、penalty的协同。

10.3 优化建议:建立你自己的调参日志

在项目或练习中,每次不同组合都记录效果,形成个人经验库。长期来看,这些经验比任何书本知识都有价值。

十一、大模型采样参数设置的未来趋势与建议

随着模型迭代,采样参数的使用也在进化。

11.1 从手动调参到自适应参数

一些新框架开始根据输入自动调整采样策略(如动态temperature)。未来面试中,你可能需要讨论如何设计自适应逻辑。

11.2 强化学习与参数微调的融合

通过RLHF(人类反馈强化学习)可以训练奖励模型,让生成结果自动偏向人类偏好,减少对外部调参的依赖。但这不意味着不用学参数,而是要知道如何与RL对齐。

11.3 多模态生成带来的新参数

随着图像、视频、代码混合生成,采样参数会涉及更多维度。建议保持对前沿论文的关注,例如Diffusion模型中的guidance scale对应temperature的作用。

十二、总结:想把AI大模型面试题中的采样参数设置答好,关键在于理解场景+原理+实践经验

面试不仅考知识,更考你如何把理论和实际结合。建议从今天起,自己动手用不同参数生成几段文本,记录感受。同时,把常见问题整理成思维导图,面试前过一遍。

如果你希望更快完成面试准备,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。它能把简历优化、模拟面试、岗位对齐一站式完成,让你把精力聚焦在技术深度本身。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:在AI大模型面试中,面试官问“请说说temperature和top_p的区别”,我应该怎么回答才能显得有深度?

回答: 首先分别定义两者:temperature控制概率分布的软度,top_p控制候选词的动态累积概率阈值。接着指出两者都可以控制多样性,但机制不同——temperature是全局缩放,top_p是局部截断。然后给出实用建议:通常情况下,我倾向于用top_p而不是top_k,因为top_p自适应场景。如果两者同时使用,我的经验是只让一个参数作为主要随机性控制,另一个作为微调,否则容易冲突。最后可以举一个例子:“比如在代码生成中,我会把temperature设低(0.2),top_p设高(0.95),这样既能获得稳定输出,又保留一点可能性。” 这样展示你对原理、组合用法和场景都有思考。

问题2:面试官问“你在项目中遇到过采样参数导致的不良输出吗?怎么解决的?” 我没有实际项目怎么办?

回答: 可以诚实说“目前还没有大规模线上项目经验”,然后立刻补充:“但我做了大量模拟实验。例如我发现用低temperature+高top_p生成摘要时,偶尔会漏掉关键实体。我通过增加frequency penalty并降低top_p至0.9,同时检查prompt中的指令是否明确,最终改善了召回率。” 即使没有真实项目,也能展示你的调试思维和主动实验态度。避免只说“没有”。

问题3:除了temperature,还有哪些参数在面试中容易被问到?

回答: 除了temperature和top_p,top_k、frequency penalty、presence penalty、repetition_penalty(部分模型有)都很常见。此外,有的面试官还会问“beam search与采样的区别”或“如何用参数控制生成长度”。我的建议是至少掌握5个常用参数的定义、典型范围和对输出的影响。最好能编一个自己的口诀,比如“稳定用低温,多样调高温,惩罚防重复,核采样自适应”。

问题4:AI简历姬具体怎么帮我准备采样参数面试题?

回答: 首先,在AI简历姬中导入你已有的简历,然后粘贴目标岗位(比如“大模型算法工程师”),系统会分析岗位要求中的技术关键词,生成面试问答清单。其中就会包含采样参数相关的模拟问题。你可以用文字或语音回答,系统会根据你的回答给出句式优化和内容补充建议。此外,AI简历姬还会记录你的每次回答,形成历史版本,方便你对比进步。这样就避免了传统面试准备中“不知道问什么、答完没人点评”的痛点。