如果你正在准备AI大模型岗位的面试,尤其是涉及知识库问答(QA)系统的部署与优化,那么QPS(每秒查询数)、TTFT(首token生成时间)以及A100 GPU的选型一定是绕不开的硬核知识点。很多候选人把精力花在模型原理的背诵上,却忽略了实际部署中的性能指标和硬件配置,而这恰恰是面试官考察工程落地能力的关键。本文将从面试官视角拆解这些概念,梳理准备策略,帮你避开常见误区,把技术词汇变成真正的面试加分项。

对于正在求职的大模型算法或工程岗位朋友来说,理解这些概念不是为了应付提问,而是为了证明你具备“从模型到服务”的完整视野。下面我们会先讲清楚每个指标的含义,再结合部署场景分析优化方法,最后用工具提效的思路帮你快速梳理面试答案。

一、什么是知识库问答部署中的核心性能指标?

在AI大模型面试中,面试官问QPS、TTFT往往不是考你背诵定义,而是考察你是否理解这些指标在实际服务中的意义。

1.1 QPS(每秒查询数)的业务视角

QPS反映系统承载并发请求的能力。在知识库问答场景里,它决定了多少个用户能同时提问而不出现排队延迟。面试官通常会问:“如果你们的QA系统要支持1000人同时使用,QPS需要达到多少?”你需要知道的是,QPS不是越高越好,而是要与业务峰值匹配。常见的误区是把离线评测的吞吐当成在线QPS,忽略了网络传输、预处理和后处理的开销。

1.2 TTFT(首token生成时间)的用户体验影响

TTFT指的是从用户发送请求到模型生成第一个token的时间。在对话式知识库问答中,用户对延迟极其敏感——超过2秒的TTFT就会明显降低体验。面试中常出现的问题包括:“如何降低TTFT?”“TTFT和TPOT(每个输出token的时间)有什么区别?”关键在于理解TTFT主要受模型加载、显存分配、上下文预填充(prefill)阶段影响,而TPOT则更依赖解码策略和硬件算力。

1.3 A100 GPU在部署中的角色

A100是当前大模型推理最常用的GPU之一,其80GB显存版本可以加载70B参数的模型(配合量化)。面试官可能会问:“为什么选择A100而不是V100或H100?”答案要点是显存容量、带宽(每秒2TB)以及对FP8/INT8量化的原生支持。另外,A100的多实例GPU(MIG)功能允许将一块GPU切分为多个隔离实例,提升资源利用率,这是面试中的加分点。

二、面试中常见的知识库问答部署痛点

很多候选人虽然知道概念,但在面对实际部署问题时容易卡壳。下面三个典型场景几乎每次面试都会被问到。

2.1 上下文长度对性能的影响

知识库问答往往需要将检索到的文档片段拼接成很长的上下文(例如8K、32K tokens)。长上下文会显著增加TTFT,因为prefill阶段需要计算所有key-value缓存。面试官会追问:“你是如何控制上下文长度的?”一个常见做法是限制检索结果数量或对文档进行摘要压缩,但要注意不影响答案质量。

2.2 并发请求下的资源竞争

当多个用户同时发送请求时,GPU显存和计算单元会被争抢。如果不对请求做排队或批处理,TTFT会急剧上升。面试会关注你是否了解动态批处理(dynamic batching)、连续批处理(continuous batching)等策略。实际部署中,通过推理框架(如vLLM、TGI)可以有效管理并发。

2.3 模型量化与精度取舍

为了在A100上部署更大的模型或提升QPS,量化几乎是必须的。常见的量化方法有GPTQ、AWQ、FP8等。面试官会问:“你做过量化吗?量化后准确率下降了多少?”你需要准备一张对比表(至少定性的),比如INT8量化往往能保持95%以上的任务准确率,但不同任务敏感度不同。

三、QPS、TTFT、A100三者的核心关系

这三个指标不是孤立的,面试官经常用一个综合问题来考察你的系统性思维。

3.1 QPS与TTFT的权衡

高QPS通常意味着系统需要处理更多并发,每个请求分配的计算资源减少,导致TTFT增加。优化目标是在满足TTFT服务等级协议(SLA)的前提下最大化QPS。常见的优化手段包括:增加GPU数量以减少单卡负载、使用异步推理、以及请求缓存。

3.2 A100如何影响这两个指标

A100的高带宽(HBM2e 2TB/s)能够快速搬运模型参数,加速prefill阶段,从而降低TTFT;同时其大显存允许同时装入多个模型副本或更大的批处理大小,提升QPS。面试中如果能对比A100与V100的显存带宽差异(V100只有900GB/s),会显得准备充分。

3.3 实际部署中的典型配置

| 场景 | 模型尺寸 | GPU配置 | 目标QPS | 目标TTFT | 量化方式 |

|---|---|---|---|---|---|

| 企业内部知识库 | 7B ~ 13B | 1×A100-80G | 50~100 | <1s | FP16/INT8 |

| 客服QA系统 | 70B | 4×A100-80G | 20~50 | <2s | INT8/FP8 |

| 开放域问答 | 13B | 1×A100-40G | 30~80 | <1.5s | FP16 |

四、准备知识库问答部署面试的核心原则

掌握概念只是第一步,面试官更看重你的分析路径。

4.1 从实际案例出发,不要背理论

网上有很多教程讲QPS计算公式,但面试官希望你结合自己的项目经历的数值。例如:“我之前部署的13B模型在A100上,单卡QPS能达到30,TTFT约1.2秒。”如果没做过部署,可以基于公开资料(如vLLM的benchmark)给出合理区间并说明推理框架的影响。

4.2 理解系统瓶颈的判断方法

面试常问:“如何定位QPS上不去的原因?”回答时应该给出诊断流程:先看GPU利用率(是否达到100%),再看显存带宽利用率,然后检查CPU预处理或后处理是否成为瓶颈。可以补充说“用NVIDIA Nsight或PyTorch Profiler做性能分析”。

4.3 区分离线评测与在线部署

离线评测通常忽略网络延迟和并发冲突,而在线部署必须考虑这些。面试官可能会设置一个陷阱:“我的模型在评测时TTFT只有500ms,为什么上线后变成了2秒?”你需要指出在线服务中的请求分割、批量处理、以及前处理tokenization等额外开销。

五、知识库问答部署面试的标准准备流程

下面这套流程可以帮助你在面试中系统性展示能力。

5.1 第一步:明确面试岗位的侧重点

算法岗更关注模型层面的优化(量化、蒸馏),工程岗更关注框架选型和资源管理。在面试前,通过职位描述判断方向,然后重点准备对应内容。例如,如果岗位要求“熟悉vLLM或TGI”,就要准备好对比不同推理框架的优劣。

5.2 第二步:构建知识树,覆盖从模型到部署

按照“模型选型→量化→推理框架→硬件配置→监控调优”的链路梳理知识点。每个环节准备一个你熟悉的例子(即使来自开源项目)。比如:用vLLM部署Llama 3 8B,开启continuous batching后QPS提升2倍。

5.3 第三步:模拟面试,用STAR法则组织回答

面试官问“你如何优化TTFT”时,不要直接说“用量化”,而是用背景-任务-行动-结果的结构:

- 背景:之前负责一个文档问答系统,用户反馈首屏响应慢

- 任务:目标是将TTFT从2.5秒降到1秒以内

- 行动:先分析发现在prefill阶段占用了70%时间,然后改用FP8量化,并将批处理大小从1提到4

- 结果:TTFT降至0.8秒,QPS提升了3倍

六、提升面试回答质量的核心技巧

很多候选人答得出来但分数不高,原因在于缺乏对比和定量思考。

6.1 多用对比,展示深度

当被问及QPS时,可以主动对比不同框架的表现:vLLM的continuous batching比TGI的dynamic batching在同等硬件下QPS高30%。这种对比说明你做过实际调研。

6.2 量化预估,避免模糊表述

不要只说“提高QPS”,要给出具体数值范围:“在A100-80G上,使用FP16推理7B模型,单卡QPS通常在30~50;如果使用INT8量化,可以到80~120。”这些数据可以从公开benchmark或官方文档获取。

6.3 关联业务场景,增强说服力

例如面试官问“TTFT重要吗?”你可以说:“对于知识库问答这种实时交互场景,用户认知中2秒是临界点;如果TTFT超过2秒,用户可能认为系统卡死。因此我们的SLA设定为TTFT<1.5秒。”这体现了工程思维。

七、利用AI工具高效准备面试答案

手工整理面试知识点耗时且容易遗漏,尤其当你需要针对每个岗位定制回答时。传统做法是刷面经、记笔记,但很难做到“简历+岗位”精准对齐。

7.1 传统准备方式的局限

很多求职者花大量时间背诵通用答案,却忽略了面试官其实更关注你简历中的项目经验与岗位要求的关系。例如,你简历上写“部署了LLM问答系统”,面试官就会追问细节。如果你事先没有把自己的经历与QPS、TTFT这些指标关联起来,回答就会显得笼统。

7.2 AI如何提升面试准备效率

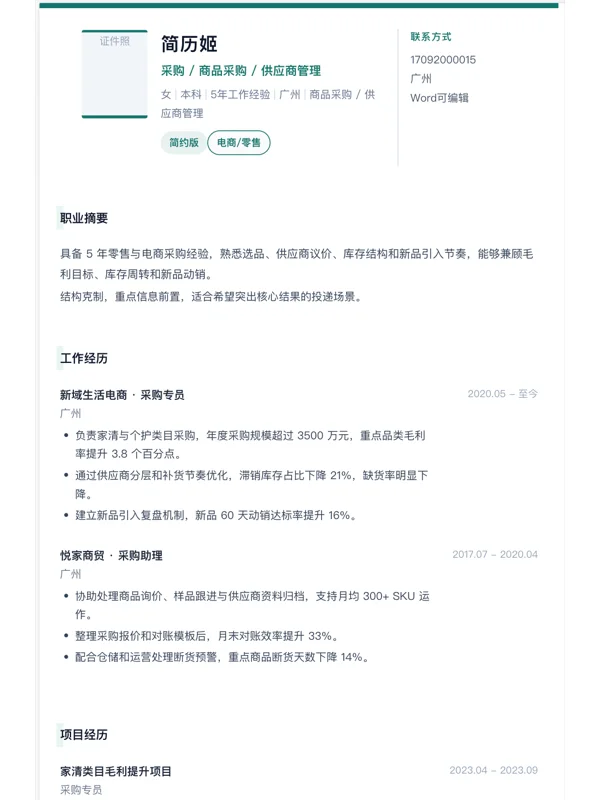

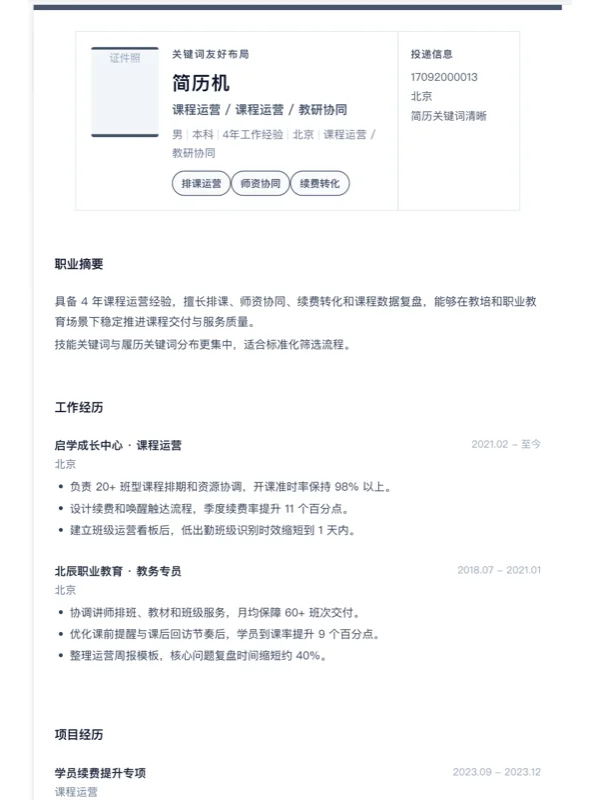

AI工具可以帮你自动分析简历中的技术栈,并生成针对岗位的模拟面试题。例如,AI简历姬的模拟面试模块,会根据你的简历内容(比如“使用vLLM部署7B模型”)和目标岗位(比如“大模型部署工程师”),自动追问部署细节、性能指标、优化方法。这比你自己猜测面试问题要精准得多。

7.3 落地:用AI简历姬做针对性练习

使用AI简历姬的面试准备功能:粘贴你的简历和目标岗位描述,系统会生成5~10道定制追问,覆盖你简历中的技术点。你可以尝试用STAR法则回答,然后对照系统提供的参考回答和反馈建议进行改进。这种方式能帮你把零散的知识点整合成连贯的面试话术,同时节省大量时间。

八、不同背景求职者的准备差异

面试准备不能一刀切,根据你的技术背景,侧重点完全不同。

8.1 算法工程师 vs 系统工程师

| 岗位类型 | 面试侧重点 | 典型问题 |

|---|---|---|

| 算法工程师 | 模型量化、蒸馏、长上下文优化 | “如何在不牺牲准确率的情况下压缩模型?” |

| 系统工程师 | 推理框架、资源调度、监控告警 | “如果QPS突然下降,你会排查哪些地方?” |

| 全栈/MLE | 端到端流程 | “描述一下从上传文档到用户得到答案的完整请求链路。” |

8.2 应届生 vs 有经验者

应届生更需要展示学习能力和基础理解,比如能正确解释TTFT与TPOT的区别。有经验者则要展示实际案例,如“我们在生产环境中用A100部署了8个模型实例,通过Kubernetes自动扩缩容,实现了QPS从50到200的弹性。”

8.3 跨行业转行者

如果你从CV转NLP,要强调迁移能力:比如图像检测中的推理延迟优化经验同样适用于LLM部署。可以类比“之前优化YOLO的推理时使用TensorRT,现在我理解类似思路可以用于LLM的量化”。

九、判断面试回答质量的检查清单

在面试前,用下面这个表格自检你的回答是否完整。

| 检查维度 | 合格标准 | 你的回答是否覆盖 |

|---|---|---|

| 定义准确 | 能用自己的话解释,不背定义 | 是/否 |

| 量化支撑 | 给出合理数值或量级 | 是/否 |

| 对比意识 | 比较不同方案优劣 | 是/否 |

| 场景链接 | 关联到知识库问答实际场景 | 是/否 |

| 工具了解 | 提及vLLM、TGI、TensorRT-LLM等 | 是/否 |

| 问题诊断 | 能列出常见瓶颈和解决步骤 | 是/否 |

十、长期提升面试能力的机制

面试不是一次性考试,而是持续迭代的过程。

10.1 建立个人的技术知识库

每次面试后,把被问到的问题和你的回答记录下来,标注可以改进的地方。使用AI简历姬的多版本管理功能,可以为不同岗位保存不同的面试准备笔记,方便复盘。

10.2 跟随社区动态更新

大模型领域变化很快,半年前的优化方案可能已经过时。订阅NVIDIA官方博客、Hugging Face的推理专栏,定期关注vLLM新版本的特性(如最新的speculative decoding)。面试官可能会问“你了解最新的推理加速技术吗?”。

10.3 动手实践,保持手感

即使不工作,也可以在个人项目或云GPU上部署微调。例如用AutoDL租一台A100,部署Llama 3 8B,测试不同量化下的QPS和TTFT,并把结果记录成技术博客。这会成为面试中的硬通货。

十一、大模型知识库问答部署面试的未来趋势

了解趋势能帮助你在面试中展现出前瞻性视野。

11.1 更强调端到端效率

面试官不再只问模型推理,而是关注整个pipeline:检索(RAG)的延迟、文档预处理的耗时、后处理格式化的开销。你需要对全链路有认知。

11.2 多模态与大上下文成为标配

知识库问答不再仅限于文本,图片、表格、视频都可能出现。面试可能涉及“多模态模型的部署与性能”,例如如何平衡CLIP与LLM的推理资源。

11.3 硬件异构与云原生部署

单一A100集群逐渐被混合部署(CPU+GPU+NPU)和cloud-native架构替代。面试中可能讨论Kubernetes + GPU共享调度、以及Serverless推理的冷启动问题。

十二、总结:想把知识库问答部署面试答好,关键在于系统性思维与实战案例结合

面试官不是要你背诵参数,而是想看到你理解每个指标背后的工程权衡。准备时,不妨把自己想象成一个部署系统的负责人,而你做的每一个选择都需要有理由。从概念到动手,从理论到案例,再加上针对性的模拟练习,你就能在面试中脱颖而出。

如果你希望更快地完成面试准备,模拟真实的追问场景,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。它可以帮助你基于你的简历和目标岗位生成定制化面试题,并提供参考回答与反馈建议,让准备更高效、更有针对性。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:AI大模型面试题中,QPS和TTFT哪个更重要?

回答:这个问题没有绝对的答案,取决于业务场景。对于实时交互的知识库问答,TTFT的SLA通常更严格,因为用户直接感知到首屏延迟;而对于后台批量处理(如离线问答生成),QPS可能更关键。面试时建议先表明“视场景而定”,然后举例:面向客服的场景TTFT应小于1.5秒,用户量不大的情况下QPS不是首要优化对象;如果面对高并发,则要优先提升QPS。最好能补充一个你经历过的真实案例。

问题2:在A100上部署大模型,如何平衡QPS和TTFT?

回答:平衡的关键是合理利用显存和计算资源。常见做法是结合连续批处理(continuous batching)和模型量化。例如,使用vLLM框架时,可通过调整最大批处理大小来权衡:较大的batch size能提升QPS,但会显著增加每个请求的TTFT(因为要等队列)。可以在一定范围内做A/B测试,选择满足TTFT SLA下的最大batch size。另外,采用FP8或INT8量化可以减少模型大小和计算量,让相同显存下支持更大的batch,从而同时提升QPS和降低TTFT(前提是精度损失可接受)。

问题3:我是算法背景,面试大模型部署岗需要注意什么?

回答:算法背景的优势在于对模型结构的理解,但部署岗更看重工程落地能力。建议重点补充以下三方面:1)熟悉至少一个推理框架(vLLM、TGI、TensorRT-LLM)的配置和调优参数;2)能解释模型量化原理,并给出自己实践中的精度损失数据;3)了解基本的运维知识,如GPU监控(nvidia-smi)、性能分析工具(Nsight)、容器化部署(Docker + K8s)。面试时尽量把你之前的算法工作与部署指标挂钩,例如“我优化的蒸馏模型比原模型参数量减少40%,在A100上QPS提升2倍,TTFT降低50%”。

问题4:AI工具如何帮助我准备这些面试题?

回答:传统准备方式靠刷面经和记笔记,但缺少针对性。AI工具可以自动分析你的简历和目标岗位,生成定制化面试题。例如,AI简历姬的面试准备模块:你只需导入自己的简历(描述你部署过的模型和框架),粘贴岗位描述(如“熟悉LLM推理优化”),系统就会生成追问,覆盖你简历中的每一项技术点。你可以用STAR法则作答,并对照系统提供的参考回答和反馈进行优化。这样做比泛泛准备更有针对性,也能帮你发现知识漏洞。

产品信息:AI简历姬是一款以岗位要求(JD)为中心的全流程求职工作台,主打“过筛不秒挂 + 面试更稳”。它可以将你的旧简历结构化解析并修复关键信息;粘贴岗位要求后,系统自动对齐关键词、给出匹配度评分和缺口清单,并基于STAR结构进行量化改写,3分钟生成可投递初稿。同时支持ATS友好导出、多版本管理和投递看板。面试模块基于简历和岗位生成定制追问与参考回答,帮助提升面试通过率。欢迎访问 AI简历姬官网 体验。