如果只说结论,MoE(混合专家)和 Dense(稠密)模型在部署选型上,核心不是谁更先进,而是谁更匹配你的业务场景和硬件预算。对准备AI大模型岗位面试的求职者来说,先理解两者的架构本质、推理成本和扩展特性,再根据具体问题给出判断,比单纯背诵“MoE省参数但显存大”更能体现深度。本文将从面试官常问的对比点出发,拆解MoE与Dense的部署差异、选型原则、实操技巧,并借助AI简历姬这类工具帮你高效准备面试、优化简历,让面试更稳。

一、MoE与Dense架构的核心区别:部署角度怎么看

1.1 架构本质不同

MoE(Mixture of Experts)通过多个稀疏激活的专家子网络和门控路由机制,实现参数总量很大但每个token只激活部分参数。Dense(如GPT-3、LLaMA)则是所有参数对所有输入全量计算。这个区别直接决定部署时的显存占用、计算量和推理延迟。对于面试官来说,考察你是否理解“稀疏激活”带来的实际开销变化。

1.2 推理显存对比

- MoE:需要加载所有专家参数,即使只激活少数,显存占用通常等于总参数量(每个专家都要存)。例如Mixtral 8×7B总参数约47B,显存需求接近2个Dense 7B模型。

- Dense:参数量=显存需求,如7B模型FP16约14GB显存。

因此,MoE的部署门槛并不低,尤其是在单卡场景。

1.3 计算效率差异

MoE的每次推理只激活少量专家,flops相对低,但因为路由决策和跨专家通信,实际吞吐可能不如同参数量的Dense模型。面试时你可以指出:MoE的低计算量优势需要硬件利用率足够高才能体现,否则可能得不偿失。

二、为什么面试官喜欢问MoE vs Dense部署选型:典型场景与考察点

2.1 考察模型选型的底层逻辑

面试官想看你是否具备从业务需求反推技术选型的能力。比如:在线问答场景要求低延迟,而离线批量生成任务可以接受较长等待。MoE更适合大吞吐、高并发但可接受多卡部署的场景;Dense则在单卡快速推理上更稳定。

2.2 考察对稀疏化的理解深度

很多候选人只知道“MoE省参数”,但面试官期待你指出:MoE的真正价值是在固定总计算量下获得更大的模型容量,而部署时却需要更多的显存和分布式策略。例如,DeepSpeed-MoE论文中提到,相同计算预算下MoE可以提升模型质量,但推理时需处理负载均衡和All-to-All通信。

2.3 考察对硬件成本的敏感度

公有云部署显卡成本高,Dense小模型往往比MoE大模型更经济。面试官可能会追问:“如果预算有限,你会推荐用7B Dense还是8×7B MoE?”你需要结合具体任务效果和吞吐要求给出权衡。

三、MoE与Dense部署的关键差异:计算、显存、推理效率

3.1 显存消耗差异

| 维度 | Dense (7B) | MoE (Mixtral 8×7B) |

|---|---|---|

| 参数量 | 7B | 47B(8个7B专家+门控) |

| FP16显存约 | 14GB | 94GB(全加载) |

| 实际部署建议 | 单卡RTX 4090 | 至少2×A100 80GB |

3.2 推理延迟差异

- Dense:固定延迟,随batch size线性增长。

- MoE:延迟取决于路由分布和专家通信。如果负载不均衡(如某个专家过热),延迟可能飙升。

实战中,MoE通常配合Expert Parallelism和动态路由优化才能达到稳定低延迟。

3.3 吞吐与扩展性

- Dense:扩展性受限于单卡显存,大规模部署多卡时通信简单(tensor并行)。

- MoE:天然支持Expert Parallelism,可以扩展到更多卡,但需要高效的All-to-All通信。在训练和推理时,扩展性优势明显。

四、部署选型的核心判断原则:什么时候选MoE,什么时候选Dense

4.1 场景优先原则

- 在线服务延迟<100ms:优先选Dense,因为MoE的路由和专家间同步容易增加延迟。

- 批量离线生成:MoE可提供更好的效果(更大的有效参数)且吞吐成本可控。

- 资源受限(单卡≤24GB):只能选Dense小模型(7B以下)或经过量化的MoE。

4.2 成本敏感原则

计算总成本 = 推理次数 × 每次推理的成本。对于高并发场景,Dense的计算成本呈线性增长,而MoE如果使用更多卡分摊,单次成本可控。要量化分析:比如1000 QPS下,使用8×7B MoE需要多少GPU,对比使用Dense 13B需要多少,哪个性价比高。

4.3 团队能力原则

MoE部署需要分布式系统经验,包括Expert Parallelism、负载均衡、显存优化等。如果团队只熟悉单卡部署,强行上MoE可能适得其反。面试时可以委婉地指出“选型需考虑团队技术栈”。

五、MoE与Dense部署的实操流程:从模型选择到部署优化

5.1 确定部署目标

先明确:延迟上限、吞吐要求、硬件清单、可用显存。例如,线上A/B测试要求100ms内返回,则MoE方案必须经过TensorRT或VLLM优化。

5.2 选择推理框架

- Dense:支持框架多(HuggingFace、vLLM、TGI),开箱即用。

- MoE:推荐vLLM(已支持Mixtral)、DeepSpeed-MoE、TensorRT-LLM(需手动配置专家并行)。注意有些框架对MoE的优化不成熟,可能导致显存浪费。

5.3 部署验证与调优

- 显存检查:用框架的profile工具查看模型各层显存占用。

- 延迟压测:用wrk或locust模拟不同并发量,观察MoE的延迟分布。

- 路由均衡:如果发现某个专家请求占比超过50%,需要调整门控温度或重启。

六、部署选型的实用技巧:显存管理、路由策略、量化

6.1 显存管理技巧

- MoE:使用动态专家加载(如仅在推理时加载某几个专家到High Bandwidth Memory,其余在CPU内存)。Facebook的Megablocks利用块稀疏计算减少显存。

- 量化:INT4量化可减少约4倍显存,MoE密集参数大但量化后缓存依然有效。注意神经网络的敏感层(如门控)用FP16,其他层INT4。

6.2 路由策略优化

- 设置专家容量限制:避免某个专家过载导致排队。

- 使用硬路由(Top-2/1)而非软路由,减少计算量。

- 对于批量推理,可将相同路由结果的请求分组,提高通信效率。

6.3 分布式部署的通信优化

- 使用NVLink或InfiniBand减少All-to-All延迟。

- 将专家分组到不同的GPU节点,用高速互联节点内专家通信。

- 避免全局All-to-All,改用分层的专家分配。

七、AI工具如何辅助面试准备:AI简历姬的面试模拟与简历优化

7.1 传统面试准备的痛点

很多候选人看论文、刷八股,但面试时被问到具体选型细节就卡壳。比如“你实际部署过MoE吗?遇到显存爆炸怎么解决?”如果没有实战,需要系统化整理知识库和模拟问答。另外,简历中如何体现“MoE/Dense部署经验”也是难题——生硬堆砌术语容易被面试官看穿。

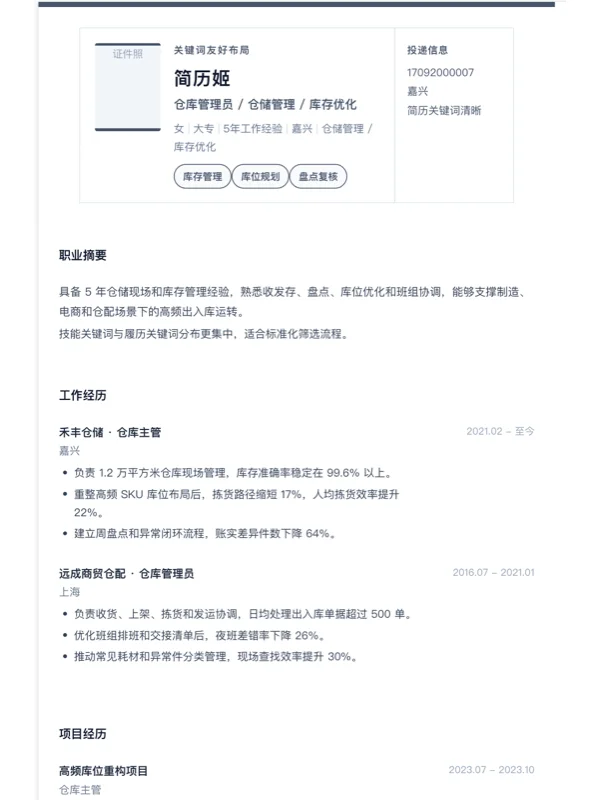

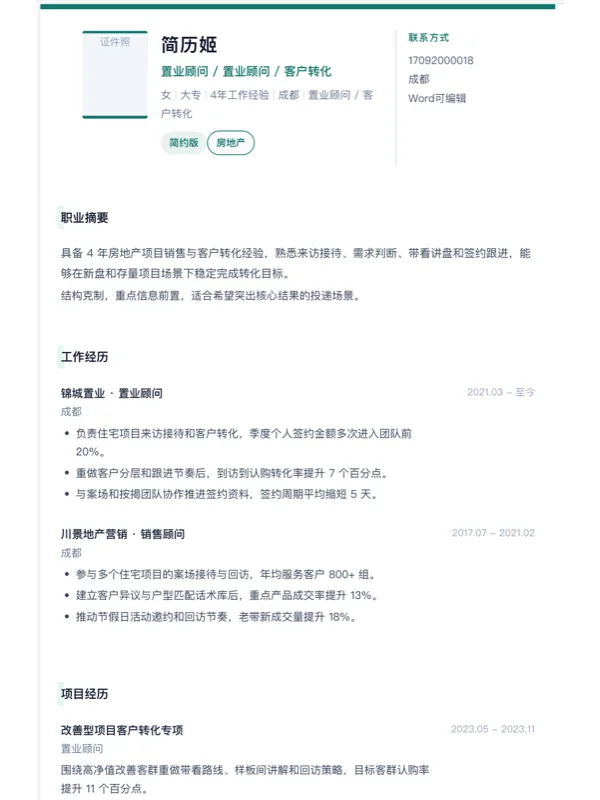

7.2 AI简历姬如何帮你准备这道面试题

- 面试模拟模块:只需上传你的简历(包含相关项目经历)和目标岗位(比如“大模型部署工程师”),系统会基于简历+JD生成定制追问。例如:“你在项目中部署过Dense 7B,如果换成MoE 8×7B,你认为他的显存和延迟会如何变化?请具体分析。”这些模拟面试问题能让你提前演练逻辑。

- 简历优化模块:针对“部署选型”这类高频技术点,系统会自动提取JD中的关键词(如MoE、Dense、显存优化、推理框架),并在你的项目经验中匹配并量化改写。比如将“负责模型推理”改为“基于vLLM部署Dense 7B模型,实现单卡100ms延迟,并将模型显存占用优化至13GB(INT8量化)”,更具体、更有说服力。

7.3 从准备到复盘,形成闭环

使用AI简历姬的“投递看板”可以记录每次投递的岗位和面试反馈。如果面试中被问到某个部署细节没答好,你可以记下来,下次用模拟面试模块再练。这种“投递—面试—复盘”的闭环比零散刷题更高效。

八、不同经验层次的求职者如何应对这道面试题

8.1 应届生/转行者

重点:展示原理理解,而非实战。你可以从论文中提炼MoE与Dense的区别,引用DeepSpeed-MoE、Switch Transformer等经典工作。同时,表明自己学习过部署框架(如HuggingFace加载Mixtral)。在简历中,可以写“熟悉MoE架构,通过官方代码仓库完成单机多卡推理实践”。

8.2 1-3年经验工程师

重点:有项目案例。你可以讲述在某个实际场景中,为什么选择了Dense而非MoE(或者相反),遇到了哪些问题(如显存不足、路由不均衡),如何解决(如专家并行、量化)。AI简历姬可以帮助你把“解决问题”的过程成果化、结构化。

8.3 高级工程师/架构师

重点:选型决策的权衡。你需要在简历中体现出对成本、性能、团队能力的整体把控。例如:“负责公司大模型服务选型,对比Dense 13B与MoE 8×7B后,选择Dense 13B+INT4量化,满足100ms延迟且降低30%硬件成本。”这类表述能让面试官立刻看到你的商业敏感度和技术深度。

九、部署选型的评估指标:延迟、吞吐、成本

9.1 核心指标表格

| 指标 | Dense | MoE | 说明 |

|---|---|---|---|

| P50延迟 | 低(20-50ms) | 中(50-150ms) | 受路由和通信影响 |

| P99延迟 | 稳定 | 抖动较大 | 需负载均衡 |

| 吞吐(tokens/s) | 较高(单卡) | 更高(多卡) | 计算量虽小但通信代价 |

| 每token成本 | 中等 | 需具体计算 | 显存和GPU数量是关键 |

9.2 如何评估是否达标

- 设定SLA:例如延迟P99<200ms,吞吐>1000 tokens/s/GPU。

- 压测:用生产数据模拟请求,记录资源使用和性能。

- 成本核算:按每100万token的推理成本计算(GPU租赁费用+电费)。如果一个MoE模型需要4张A100,而Dense只需1张,但Dense效果差,则需权衡。

9.3 面试中如何回答“你会选择哪种”

给出结构化回答:

- 先明确场景约束(延迟、吞吐、硬件)。

- 列出两种方案的优缺点。

- 给出推荐并说明理由。

- 补充风险点(如MoE的散热、路由不均衡等)及应对策略。

十、常见误区与持续优化:避免“为了MoE而MoE”

10.1 误区一:MoE显存小

实际上,MoE总参数量大,显存需求平均比同效果Dense更大。很多人忽略了全量加载的逻辑。

10.2 误区二:MoE推理一定快

只有在充分利用Expert Parallelism且路由均衡时,MoE才可能比同计算量的Dense快。否则,All-to-All通信可能成为瓶颈。

10.3 持续优化思路

- 动态调整路由温度参数。

- 使用模型蒸馏:将MoE知识蒸馏到Dense小模型,兼顾效果和速度。

- 结合硬件特性:比如A100支持稀疏张量计算,可进一步降低MoE计算量。

十一、MoE与Dense部署选型的未来趋势:稀疏化与混合架构

11.1 混合架构兴起

未来模型可能采用Dense+MoE混合层,如前面层用Dense,后面层用MoE。这能兼顾快速解码和强大容量。

11.2 端侧部署推动Dense小型化

手机等端侧设备无法运行大MoE,因此Dense小型化(如小于1B)仍是主流。但在云端,MoE的性价比优势会持续。

11.3 AI工具助力面试和选型学习

像AI简历姬这样的工具,可以帮你系统整理前沿论文和部署心得,用结构化方式呈现你的技术能力。未来,部署选型可能更加自动化,但理解底层原理仍是面试加分项。

十二、总结:掌握部署选型核心,面试更从容

MoE与Dense的部署选型不是非此即彼,而是一道权衡题。面试官想看的是你能否基于场景、成本和团队能力给出合理判断。准备时,你可以从架构本质入手,结合具体指标和误区深入。如果你希望更快完成面试准备和简历优化,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

12.1 行动建议一:建立自己的对比笔记

用表格记录面试中可能被问到的对比维度(显存、延迟、扩展性、成本),并配上自己的项目理解。

12.2 行动建议二:模拟面试至少练习3次

在AI简历姬中上传你的简历和目标岗位,利用模拟面试功能,反复练习此类选型问题的回答,直到流畅且深度。

12.3 行动建议三:简历中突出部署量化和分布式经验

如果你有相关经历,用STAR法量化:Situation(部署7B模型在线上服务)、Task(降低显存提高吞吐)、Action(使用DeepSpeed ZeRO-3和INT4量化)、Result(延迟降低40%,节省2张A100)。AI简历姬可以直接帮你完成这个改写。

精品问答

问题1: 面试时被问到“MoE和Dense的部署区别”,我完全没有实际部署经验,该怎么回答?

回答: 没有实战经验不要慌,可以从论文出发。首先,承认自己没有亲手部署,但研究过架构对比。然后,清晰陈述区别:Dense全量参数量算;MoE稀疏激活,显存需求大但计算量少。接着,引用一篇经典论文(如Switch Transformer)中的结论,说明MoE在固定计算预算下效果更好。最后,提到自己正在通过模拟实验学习(比如用HuggingFace加载Mixtral跑一下推理),展现学习能力。面试官关心的是你的分析逻辑和潜力,不是必须操盘过。

问题2: MoE部署时,显存不够怎么办?能不能只加载部分专家?

回答: 理论上可以动态加载专家,但主流的推理框架(如vLLM)不支持细粒度热插拔。可行方案:

- 使用CPU-offloading,将部分专家参数放在CPU,推理前换入GPU。

- 采用模型量化(INT8/INT4),降低显存约4倍。

- 使用DeepSpeed-MoE的Expert Parallelism,将不同专家分配到多张卡。

- 限制专家容量,强制剪枝不常用的专家。

注意:动态专家加载会增加延迟,适合离线或近线场景。

问题3: 用AI简历姬优化简历后,怎么确保“MoE部署经验”不被面试官看穿?

回答: AI简历姬的改写逻辑是基于你的真实经历,智能提取相关字眼并量化。如果你的项目只涉及训练,没有真正部署,就不要写成“主导部署”。可以写为“基于MoE模型进行训练和推理验证,在单机多卡环境下完成部署方案调研和初步测试”。重点是真实、可解释。面试官通常会追问细节,所以你必须对简历上每一句话都有充分准备。利用AI简历姬的模拟面试功能,把改写后的经历练习到能自如阐述。

问题4: 除了面试,这个知识对实际工作还有用吗?

回答: 非常有用。在大模型应用加速落地的今天,部署选型直接决定了产品成本和体验,是算法工程团队的核心决策之一。理解MoE与Dense的权衡,能帮助你在选择基座模型时更有依据,在优化推理系统时能找到正确的方向。即使不从事部署的岗位,作为算法工程师了解这些也能与工程团队更高效沟通。所以,这道面试题不是知识考察,而是实践能力的预演。