如果你正在准备AI大模型方向的面试,或者在实际落地中需要选择量化方案,GPTQ和AWQ几乎是绕不开的两个关键词。直接给结论:它们都不是万能药——GPTQ更适合离线部署、追求极致压缩的场景;AWQ在保留关键权重精度上更聪明,对在线推理更友好。选择哪个,取决于你的模型大小、硬件限制和延迟要求。下面从原理到实操,帮你一次理清。

一、GPTQ与AWQ是什么?各自解决什么问题?

1.1 GPTQ:基于最优脑手术的经典量化

GPTQ(Generative Pre-trained Transformer Quantization)是一种后训练量化方法,它通过近似二阶梯度信息(类似最优脑手术),在量化过程中最小化输出误差。核心思路是:逐层量化、逐列自适应,用海森矩阵感知权重重要性。

1.2 AWQ:感知激活值的权重保护量化

AWQ(Activation-aware Weight Quantization)的思路更直接:不依赖梯度,而是用激活值的大小来判断哪些权重更重要。它对“关键通道”(激活值大的权重)保留FP16精度,其余用低比特,从而避免精度崩塌。

1.3 两者对面试官意味着什么?

面试官问你“GPTQ和AWQ的区别”,其实是在考察你是否理解量化背后的代价权衡。GPTQ全局均匀量化,依赖计算补偿;AWQ混合精度,依赖数据统计。回答关键:不能只说原理,要能讲清适用场景。

二、为什么AI求职者必须理解这种技术对比?

2.1 面试高频题:量化选型背后的逻辑

无论是大模型部署岗还是算法工程岗,量化一直是热门考点。GPTQ和AWQ对比几乎成为标准问题,面试官期望你不仅能背区别,还能结合实际项目说明。

2.2 实际项目中的决策成本

选错量化方法可能导致推理速度慢或精度损失过大。如果你刚入职一家公司,需要把7B模型部署到手机端,选AWQ可能更稳;如果目标是4-bit极致压缩跑在服务器上,GPTQ更成熟。

2.3 简历上的技术深度体现

在简历里写“熟悉GPTQ和AWQ”很容易,但能写出对比分析和工程踩坑经验,才是区别。很多求职者在这里翻车,因为只懂理论,不懂落地。

三、GPTQ vs AWQ:核心区别与判断标准

| 维度 | GPTQ | AWQ |

|---|---|---|

| 原理基础 | 二阶梯度近似(OBQ改进) | 激活感知(关键通道保留精度) |

| 数据需求 | 需要少量校准数据集 | 需要校准集(更少) |

| 量化策略 | 全局均匀低比特 | 混合精度(关键部分高比特) |

| 硬件兼容性 | 依赖特定CUDA内核 | 更通用,部分边缘设备友好 |

| 精度损失 | 中等,大模型上表现好 | 更小,尤其对下游任务 |

| 推理速度 | 快(因统一位宽) | 略慢(混合精度需调度) |

| 部署便利性 | 成熟,HuggingFace支持好 | 较新,社区正在扩展 |

3.1 本质区别:误差补偿 vs 重要性保留

GPTQ认为所有权重可以被均等量化,然后用补偿算法弥补误差;AWQ则认为有些权重天生重要,必须保留高精度。这个哲学差异决定了后续一切。

3.2 如何快速判断?三问法

- 你的模型多大?(<7B可以考虑AWQ,>13B推荐GPTQ)

- 你的硬件有限吗?(边缘设备首选AWQ,云端多卡服务器优先GPTQ)

- 你容忍精度下降多少?(任务敏感选AWQ,通用生成场景GPTQ足够)

3.3 常见误解:AWQ一定比GPTQ好?

不一定。AWQ在特定任务上精度更高,但推理延迟不稳定;GPTQ在大模型上精度已接近无损,且生态更全。没有绝对好坏,只有场景适配。

四、核心原则:量化选型的决策逻辑

4.1 以目标设定为先

先问自己:是要减少显存占用(比如把70B模型放到单卡A100)?还是加速推理(降低首token延迟)?还是为了端侧部署?目标不同,量化路径完全不同。

4.2 以任务评估为尺

量化后一定要做任务级评估,不只是perplexity。比如对话任务、分类任务、代码生成任务,对量化的敏感度差异极大。AWQ在代码生成上通常比GPTQ更稳。

4.3 以硬件约束为界

如果你的推理框架只支持GPTQ的量化格式,那AWQ再优秀也没用。实际工程中,兼容性往往优先于理论精度。常见情况是:先试GPTQ(因为现成),如果精度不够再换AWQ。

五、实操流程:从选型到部署的标准化步骤

5.1 第一步:准备校准数据集

GPTQ和AWQ都需要少量校准数据(约128-256条样本)。从任务数据中均匀抽样,注意不要用训练集,避免过拟合。

5.2 第二步:运行量化并对比基线

用AutoGPTQ库量化GPTQ,用mit-han-lab/awq库量化AWQ。分别保存两个版本的量化模型,并与FP16基线做对比(perplexity+下游任务指标)。

5.3 第三步:实测延迟和吞吐

量化完一定要在生产环境的推理框架中测试实际延迟。有时候理论快但实际调度开销大。例如AWQ的混合精度可能导致碎片化,在batch size大时反而略慢。

六、实用技巧与优化建议

6.1 校准数据集的质量比数量更重要

很多人随便找几百条英文维基百科当校准集,但如果你做中文对话模型,效果会很差。最好从你的下游任务中收集50-100条典型样本。

6.2 与量化感知训练结合

如果后训练量化效果不理想,可以尝试量化感知训练(QAT)。但成本较高,仅在大模型高精度要求场景下推荐。

6.3 边缘部署的特别注意事项

Edge设备上,AWQ需要重写部分算子的硬件映射。建议先用XX-NPU厂商提供的工具链验证,否则可能无法运行。

七、用AI工具提效:量化选型中的智能辅助

7.1 传统方法的低效痛点

以前做量化对比,需要手动查找论文、拼凑代码、对比结果,往往花一周只能对比两三种方法。而且面试准备更是难上加难,要整理大量技术细节。

7.2 AI如何加速?

现在可以用一些AI辅助分析工具,输入你的硬件和任务要求,自动推荐量化方案并生成评估脚本。但更直接的是求职场景:面试官问量化对比时,你需要清晰流畅地回答逻辑。

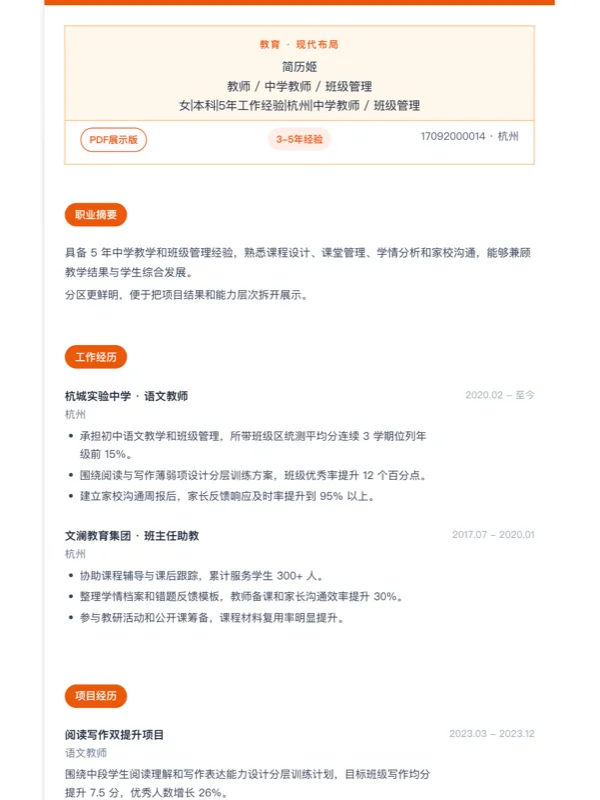

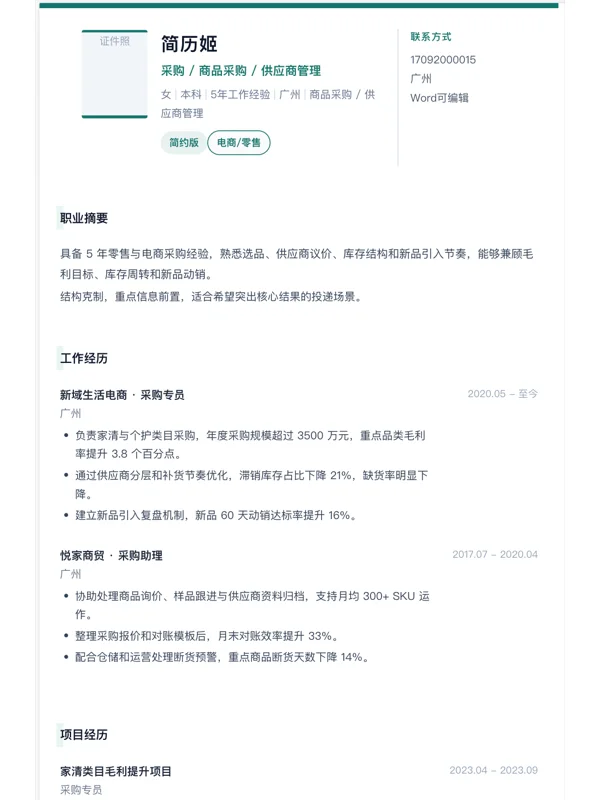

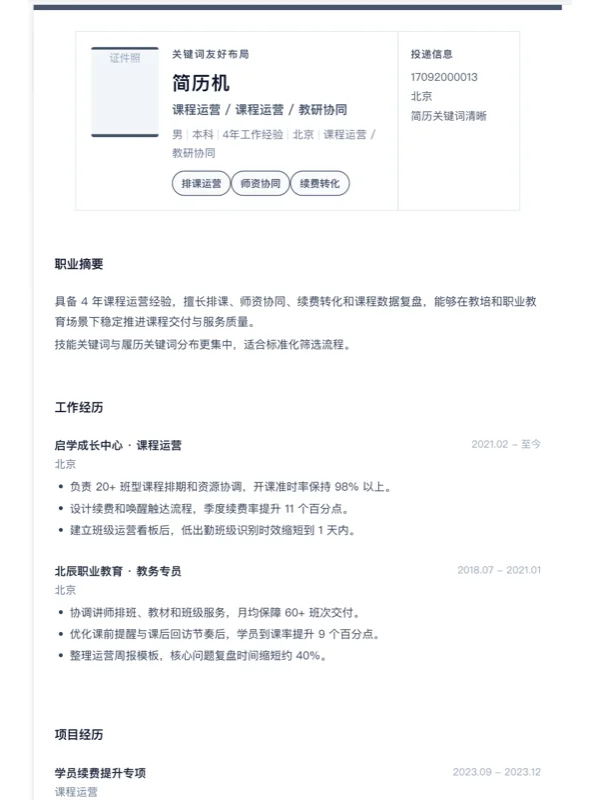

7.3 AI简历姬:让面试准备更高效

如果你正在准备AI大模型岗位的面试,AI简历姬的模拟面试模块可以帮你。

只需导入你的简历,输入目标岗位描述(比如“大模型部署工程师”),系统会自动生成相关技术追问,包括GPTQ与AWQ对比的模拟问题。它会基于你的简历亮点和岗位要求,生成定制化的回答框架,并给出反馈建议。这样你可以在面试前针对性地练习,而不是死记硬背。

AI简历姬的核心能力之一就是“简历+岗位”驱动的面试准备,把“量化对比”这类技术问题变成可演练的场景。节省你的面试准备时间,把精力放在真正需要深度思考的地方。

八、不同人群的量化选型差异

| 用户类型 | 关注点 | 推荐策略 |

|---|---|---|

| 算法研究员 | 精度与可解释性 | 优先AWQ,做详细任务评估 |

| 工程部署工程师 | 延迟与吞吐 | 优先GPTQ(生态成熟),必要时混合 |

| 端侧AI开发者 | 兼容性与实时性 | AWQ优先,需做硬件适配 |

| 面试准备者 | 概念清晰与实践案例 | 两者都学,重点理解选型逻辑 |

8.1 对面试者:理解why比知道what更关键

面试官不会只让你背诵区别,更想听你讲“为什么在这个情景下选A而不选B”。准备时,围绕一个自己熟悉的模型(如LLaMA 7B)演练两种方案。

8.2 对创业者:量化是降本关键

小团队资源有限,量化能显著降低推理成本。先试用GPTQ,精度够用就不折腾;如果客户要求高准确率,再上AWQ。

8.3 对工业界:量化正成为标配

几乎所有大模型API都内嵌了量化层。作为从业者,掌握至少一种量化工具链(AutoGPTQ或AWQ)是基本要求。

九、量化效果评估指标与检查点

9.1 核心指标表

| 指标 | 说明 | 理想值 | 注意事项 |

|---|---|---|---|

| PPL(困惑度) | 语言模型拟合程度 | 与基线差异<1 | 不一定代表下游任务好 |

| 任务准确率 | 具体下游任务(如分类、生成) | 接近基线 | 最可靠指标 |

| 显存占用 | 模型加载所需显存 | 越低越好 | 注意峰值与平均值 |

| 首token延迟 | 推理首字生成时间 | 低 | 对交互场景敏感 |

| 吞吐量 | tokens/s | 高 | batch size影响大 |

9.2 如何建立检查清单?

- 校准集是否与下游任务分布一致?

- 是否做了多组实验(不同量化位宽)?

- 是否在生产框架中测试?

- 是否有对比基线(FP16/INT8)?

- 是否评估了极端输入下的表现?

9.3 防止“过量化”陷阱

有时追求极致压缩(如3-bit)反而导致模型输出混乱。建议从4-bit开始,如果任务允许再降低。

十、长期机制与持续优化

10.1 量化模型的更新维护

模型版本升级后,需要重新做量化评估。建议建立自动化量化流水线(CI/CD),每次新模型发布自动跑一遍对比。

10.2 常见误区复盘

- 盲目追求最低位宽:3-bit以下风险高

- 忽视校准集:随便拿一小段文本可能导致灾难

- 只测PPL不测任务:PPL掉0.5但任务准确率掉10%很常见

10.3 持续优化方向

- 尝试自适应量化(不同层不同位宽)

- 结合稀疏化+量化联合压缩

- 关注新方法(如QuIP、NormQ)

十一、GPTQ与AWQ量化的未来趋势与建议

11.1 混合精度与动态量化成为主流

未来量化方法不会是固定位宽,而是根据输入动态调整。AWQ的混合精度思路被印证有效,后续方法会继承并优化。

11.2 硬件厂商原生支持将加速部署

NVIDIA、Qualcomm等正在为AWQ提供硬件指令优化,GPTQ的独家性在降低。选择时需评估未来生态。

11.3 求职市场中量化技能需求增长

如果你正在准备面试,建议不仅会讲两种方法,还要能写Demo。可以用AI简历姬的“模拟面试”模块演练技术追问,提升表达流畅度。

十二、总结:想把量化对比做透,关键在于理解权衡

选GPTQ还是AWQ,没有标准答案。关键是理解:量化不是黑盒操作,而是一个精度-速度-硬件兼容性的三角权衡。先明确你的业务目标,再根据本文章的方法论做实验。

如果你希望更快完成面试准备或技术项目落地,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它不仅能帮你模拟面试中的量化问题,还能用ATS友好简历和结构化面试准备提升你的求职成功率。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:GPTQ和AWQ哪个在面试中更容易被问到?

回答:两者出现的频率都很高。如果你应聘的是大模型部署或算法岗,面试官通常会要求你对比。建议用“场景-原理-选型”三步法回答,比如:“我项目里用GPTQ主要是因为HuggingFace生态好,压到4-bit后PPL只涨0.3,部署简单。如果任务对精度要求更高,我会用AWQ做混合精度。”这样既展示深度又显真实。

问题2:做量化对比时最容易忽略的是什么?

回答:最容易忽略的是校准数据集的主题匹配。很多人直接用wiki数据集,但部署的是代码模型,结果PPL好看但实际代码生成质量崩了。正确做法是用你自己的下游数据抽128条做校准。另外,一定要在生产环境测延迟,框架差异可能让结果反转。

问题3:不会写量化代码,如何在面试中展示理解?

回答:你可以说自己用过AutoGPTQ或AWQ的Python库,虽然没深入改内核,但清楚每个接口的参数含义(如bits、group_size、desc_act)。更关键的是能解释为什么group_size减少会提升精度但带来开销。也可以提你用AI简历姬准备了这些技术问题的模拟演练,说明你注重结构化表达。

问题4:AI工具在量化技术面试准备中到底能帮什么?

回答:AI工具可以帮你快速生成模拟问答、整理技术要点,但代替不了深度思考。比如AI简历姬的面试模块会根据你的简历和岗位生成追问,让你发现自己知识盲区。它还能把“量化对比”这类问题拆解成多个子问题,帮你形成答题框架。最终,你仍然需要自己填充真实案例和逻辑论证。