如果只说结论,大模型量化面试(PTQ、QAT)远不是让候选人背诵“什么是量化”,而是考察你能否在部署场景中做出精准的技术判断——什么场景该用PTQ,什么场景必须上QAT,量化后精度损失如何补偿。对准备AI大模型岗位的候选人来说,先把PTQ和QAT的技术边界、适用条件摸透,再结合具体模型(如LLaMA、ChatGLM)的量化实战案例来组织回答,通常比单纯刷理论题更有效。

很多人在准备这类面试题时,容易被大量公式和论文绕晕。其实面试官真正关心的只有三个维度:你能不能讲清楚量化误差的来源,你能不能给出精度与速度的工程权衡方案,以及你是否了解不同量化位宽(INT8、INT4、FP8)在实际部署中的表现。下文会从这三点展开,帮你系统地梳理PTQ与QAT的核心知识点、面试常见陷阱以及高效备考方案。

一、大模型量化面试到底在考什么?

1.1 量化面试的本质:不是背概念,而是比工程判断

面试官问“PTQ和QAT有什么区别”,往往不是为了听你复述“PTQ是训练后量化,QAT是量化感知训练”。他们更想听到的是:在什么情况下你不必费劲做QAT?什么情况下PTQ一定失效?你对Calibration数据集、量化粒度(per-tensor vs per-channel)有没有实操经验?

1.2 高频考点:三类问题的底层逻辑

第一类:基本原理类。包括量化公式(scale、zero-point)、对称量化和非对称量化的适用场景。面试官会追问“为什么LLaMA用per-channel量化效果更好”。

第二类:差异对比类。PTQ和QAT的核心区别在于是否在训练过程中模拟量化噪声。QAT通常能保住更多精度,但代价是训练成本高。

第三类:工程落地类。给定一个推理延迟要求,你会选择哪种量化方式?这时候需要结合硬件支持(如NVIDIA Tensor Core对INT8的加速)、模型敏感度分析来回答。

1.3 面试官期待的能力模型:从“知道”到“会用”

面试官通常会通过一个开放性问题来考察:比如“你对一个70B的模型做INT4量化,发现准确率掉了5个点,怎么排查和修复?”你需要回答:先检查Calibration数据集是否覆盖了关键分布,再尝试per-group量化,如果还不行,考虑QAT或混合精度。这个链条展示的是系统化的调优思路。

二、为什么PTQ和QAT成为面试高频考点?

2.1 大模型部署的刚需:量化是降低推理成本的核心手段

目前主流的大模型参数量动辄几十B甚至上百B,直接FP16推理需要大量显存。量化到INT8或INT4可以降低显存占用到原来的1/2到1/4,推理速度提升2-4倍。几乎所有AI公司在模型上线前都会做量化,因此面试必问。

2.2 PTQ和QAT代表了两种典型的技术路线

PTQ(Post-Training Quantization)因为操作简单、无需重新训练,成为大多数场景的第一选择。但它在小模型或低比特(INT4以下)时精度下降明显。QAT(Quantization-Aware Training)可以通过在训练中嵌入量化操作来逼近全精度效果,但需要额外计算资源和训练数据。面试官就是想看你能否在成本和收益之间做出权衡。

2.3 典型的用户痛点:不知道选哪个,也不知道怎么回答

很多候选人在简历上写了“熟悉模型量化”,却分不清PTQ和QAT的适用边界。面试时一被追问细节就卡壳。这篇内容就是帮你系统梳理,避免“面试造火箭,工作拧螺丝”的尴尬。

三、PTQ与QAT的核心区别是什么?

3.1 技术流程差异

| 维度 | PTQ | QAT |

|---|---|---|

| 训练后是否需回传梯度 | 否 | 是 |

| 是否需要完整训练数据 | 仅需少量Calibration数据 | 需要大量训练数据或合成数据 |

| 精度损失 | 较大(尤其是低比特) | 小(可接近全精度) |

| 训练成本 | 极低 | 高(相当于重新训练一部分) |

| 适用场景 | 精度要求不高、数据受限 | 精度要求极严、硬件支持 |

3.2 精度损失的根源:量化误差的不同来源

PTQ的误差主要来自权重和激活值的截断误差,以及Calibration数据分布与真实数据分布不一致。QAT通过前向传播模拟量化、反向传播直通估算器(STE)来更新权重,让模型自适应量化噪声,因此能有效降低精度损失。

3.3 面试常见混淆点:什么时候用PTQ,什么时候用QAT

一个常见的错误是认为QAT永远比PTQ好。实际上,如果模型本身对量化不敏感(如卷积网络),PTQ就能达到接近全精度的效果。如果模型在低位宽下精度急剧下降,才优先考虑QAT。面试官可能会追问:“你如何判断一个模型是否对量化敏感?”你可以回答:做逐层敏感度分析,观察每一层权重的数值范围和分布,或者用少量数据跑一次PTQ,比较输出logits的距离。

四、面试中如何回答量化相关问题?

4.1 从“答案”到“框架”的升级

举例:当被问“说一下QAT的原理”时,不要只回答“QAT是量化感知训练”。更好的回答框架是:先把QAT放在“训练后量化精度不足”这个背景下,解释为什么需要它;然后说明核心操作(前向模拟量化、反向STE);最后给出适用条件和局限性。这样体现了结构化思维。

4.2 用案例来佐证你的理解

你可以说:“我上次对BERT-base做INT8量化,先用PTQ发现GLU任务掉2个点,换成QAT后只掉0.3个点,但训练时间增加了2天。这个案例说明,如果业务对精度要求不苛刻,PTQ是性价比更高的选择。”这种经验性描述远比空谈理论有说服力。

4.3 常见话术与忌讳

忌讳:说“我只会使用PyTorch自带量化接口”但讲不清背后的原理。建议话术:“PyTorch的量化工具提供了手动量化、FX量化等多种方式,但实际部署时通常需要自己写校准脚本,因为默认的集合参数可能不合适。”

五、大模型量化面试的常见题型与解法

5.1 原理推导类

题目:“推导INT8对称量化的公式,并说明scale和zero_point的作用。”解法:写出公式,解释对称量化假设数据分布对称,适用于权重;非对称量化适用于ReLU后的激活值。

5.2 工程实现类

题目:“在推理引擎中,如何用INT8矩阵乘法替代FP32矩阵乘法?”需要回答:反量化输入,计算INT8乘法,再量化回输出。注意溢出问题。

5.3 性能权衡类

题目:“如果模型在INT4下精度下降严重,你会怎么做?”解法:首先尝试per-group量化,增大group size;其次尝试混合精度(敏感层保留FP16);最后考虑QAT或蒸馏。

六、面试官常挖的坑:量化精度与速度平衡

6.1 典型的陷阱问题

问题:“INT8量化后推理速度为什么可能反而变慢?”很多候选人不假思索回答“因为INT8计算更快”,但实际可能因为数据搬运开销、反量化操作、或者硬件优化不充分导致延迟增加。回答时应强调“理论加速依赖于硬件支持,实际需要profile”。

6.2 如何证明你做了真正的权衡

面试官希望看到你意识到“精度和速度的Pareto前沿”。你可以说:“我通常先跑一组实验,记录不同量化策略下的精度和延迟,然后根据业务要求选择合理点。”

6.3 实际项目中的约束

量化不仅仅是算法问题,还受限于部署框架。例如TensorRT对Transformer模型的某些结构支持不佳。面试时可以提及你在哪些框架中踩过坑。

七、用AI简历姬辅助面试准备:简历到模拟面试

7.1 简历中如何有效突出量化经验

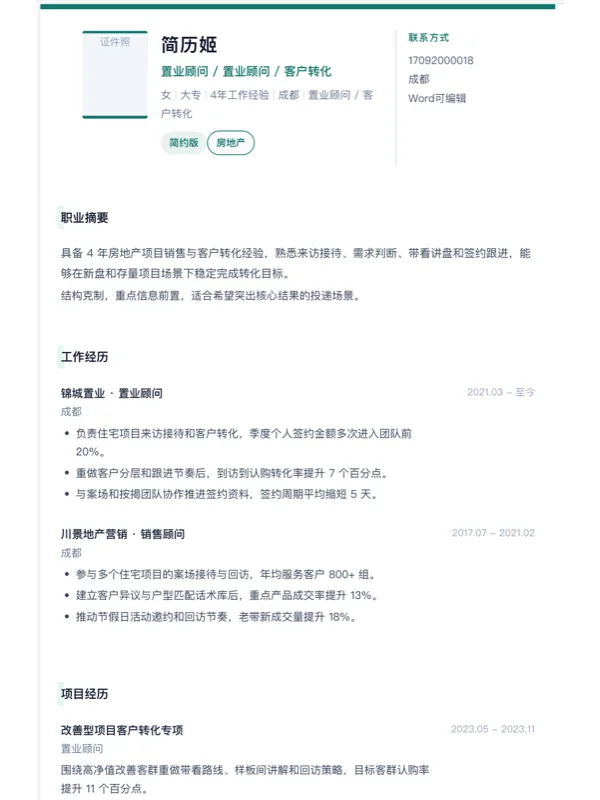

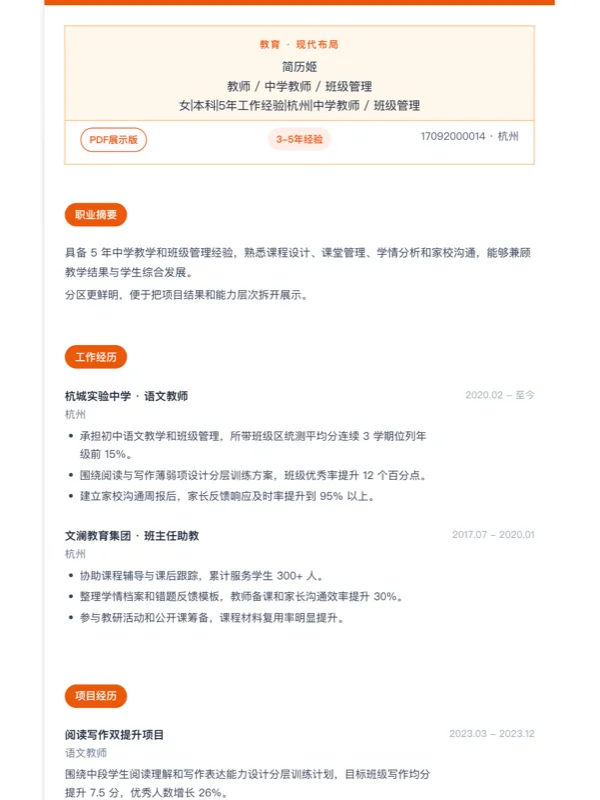

很多候选人写在简历上的“熟悉模型量化”过于笼统。AI简历姬可以根据岗位JD提取关键词,比如“PTQ、QAT、INT8”,然后帮你把量化经验以STAR结构量化改写。例如把“负责模型部署”改成“对LLaMA-7B实现INT8 PTQ,推理速度提升2.3倍,精度损失<1%”。这样面试官一眼就能看到你的实际成果。

7.2 模拟面试环节:量化技术专项训练

AI简历姬的面试模块基于你的简历和目标岗位,生成定制追问。例如针对你写的“PTQ经验”,可能会问:“你如何选择Calibration数据集?用多少样本?”你可以提前准备,系统也会给出参考答案。这能帮你发现知识盲区——比如很多候选人从来没考虑过Calibration数据代表性问题。

7.3 从投递到面试的全流程闭环

在AI简历姬中,你可以建立一个“大模型岗位”看板,每个岗位对应一版简历。投递后记录面试反馈,复盘量化知识点上的薄弱环节。比如如果被问到“QAT的反向传播如何实现”没答好,就把这个问题添加到知识库,下次面试前重点复习。

八、不同岗位对量化知识的要求差异

8.1 算法研究员 vs 算法工程师 vs 部署工程师

| 岗位 | 量化知识重点 | 面试关注点 |

|---|---|---|

| 算法研究员 | 量化误差的理论分析、新量化方法(如LLM.int8()) | 能够推导公式、提出新方案 |

| 算法工程师 | 常用工具使用、调优经验 | 能否独立完成PTQ/QAT全流程调优 |

| 部署工程师 | 推理框架集成、性能Profiling | 能否解决部署中的兼容性和延迟问题 |

8.2 对应届生与转行者

对于应届生,建议从PTQ入手,熟悉一套标准流程。对于转行者,重点展示学习能力和迁移能力,比如“我在实习中做过CV模型的量化,现在迁移到NLP模型”。

九、量化知识掌握程度的自我检查清单

9.1 技术深度检查表

| 检查项 | 是否掌握 | 急需强化 |

|---|---|---|

| 能写出量化/反量化公式 | ☐ | ☐ |

| 理解per-tensor/per-channel区别 | ☐ | ☐ |

| 知道Calibration的常见方法(MSE、KL散度) | ☐ | ☐ |

| 能解释STE的原理 | ☐ | ☐ |

| 有至少一个量化项目经验 | ☐ | ☐ |

9.2 如何用清单查漏补缺

每个检查项对应一个面试问题。例如“理解per-tensor/per-channel区别”对应的面试题是:“为什么LLaMA常用per-channel量化?per-tensor在什么情况下失效?”如果你答不上来,就说明这个知识点需要补。

十、面试后如何复盘并持续优化知识结构

10.1 建立自己的量化面试题库

每次面试后,把没答好的问题记录下来,标注知识点(如PTQ、Calibration)。AI简历姬的投递看板可以附带笔记功能,方便你追踪重复出现的问题。

10.2 深度复盘:不只是记住答案

比如面试官问“为什么INT4量化更难”,不要只记住答案“因为精度损失大”。要深入理解:低位宽下量化噪声的信噪比更低,且激活值动态范围大,截断误差更严重。下次面试你就能从底层原理出发解释。

10.3 持续跟进行业最新方案

量化技术在快速发展,比如GPTQ、AWQ、SmoothQuant等。每周花半小时阅读相关论文或实践博客,保持知识更新。

十一、大模型量化技术的未来趋势与面试方向

11.1 更低比特、更高精度

4-bit量化已经成为主流,2-bit量化也在探索中。面试官可能问:“你对2-bit量化的可行性怎么看?”你需要了解相关算法(如QLoRA)。

11.2 模型量化与稀疏化的结合

量化和剪枝、蒸馏结合使用,可以进一步压缩模型。这是面试中的加分项。

11.3 量化工具的自动化

AutoML在量化中的应用,例如自动搜索最优量化配置。了解AutoPTQ之类的工具会让你显得更有前瞻性。

十二、总结:把大模型量化面试准备做好,关键在于系统性+实操性

从PTQ与QAT的核心区别,到面试官爱挖的陷阱,再到不同岗位的知识要求,准备大模型量化面试需要覆盖原理、工程和前沿三个层面。不要停留在背概念,而是通过项目实践和模拟面试反复打磨。

如果你希望更快地将自己的量化经验整理成一份高匹配度简历,并通过模拟面试发现知识盲区,可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它不仅能帮你诊断简历中量化关键词的覆盖率,还能根据岗位生成定制面试题,让你在真实面试前就做好准备。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:大模型量化面试到底需要先准备什么?

回答:先做三件事:一是把量化公式和PTQ/QAT的流程推导一遍,确保能出口成章;二是找一个开源模型(如LLaMA-7B)自己动手做一次INT8 PTQ,记录精度变化;三是整理一个项目案例,包含你选的量化方案、实验结果和优化过程。这三步做完,面试中八成分数就稳了。

问题2:PTQ和QAT里最容易犯的错误是什么?

回答:最常见的问题是Calibration数据集选择不当。很多人随便抓几百条数据,导致量化后的模型在真实分布上精度骤降。正确做法是选择与推理数据分布一致的样本,或者使用合成数据覆盖更多模式。另一个坑是忽视per-group量化对推理速度的影响,没有做profiling就直接上线。

问题3:AI工具在大模型量化面试准备中到底能帮什么?

回答:AI工具可以从两个层面帮助:一是简历优化,让它能突出量化技能并与JD对齐;二是模拟面试,AI简历姬能基于你的简历和岗位生成定制问题,比如追问“你使用的Calibration方法为什么选MSE而不是KL散度”,让你提前暴露弱点。面试后还能把错题加入知识库,形成闭环。

问题4:转行做AI大模型部署,量化面试应该注意什么?

回答:转行者重点展示学习能力和迁移经验。比如你可以说:“我在CV领域做过YOLO的INT8量化,现在迁移到LLM,虽然网络结构不同,但量化原理相通。”另外,多关注开源工具(如auto-gptq、TensorRT),面试时能展现你对生态的了解。不要害怕承认暂时不会的东西,但要表现出快速学习的态度。