如果只说结论,准备AI大模型面试时,AWQ(Activation-aware Weight Quantization)中的激活异常值保护是区分你是否真正理解量化算法的核心考点之一。很多候选人能背出量化公式,却解释不清为什么需要保护异常值、如何检测异常值、以及在推理时如何高效处理——这种知识断层往往在面试追问中暴露无遗。

这篇文章会帮你把“AWQ激活异常值保护”这个看似冷门的技术概念,拆解成面试官真正想考察的三个维度:原理逻辑、实现方法、工程权衡。无论你是算法岗、工程岗还是应届生,读完都能在30秒内组织出清晰的回答框架,同时知道如何利用工具把技术深度转化为面试优势。

一、什么是AWQ激活异常值保护?面试官为什么总问这个?

1.1 一句话定义

AWQ(Activation-aware Weight Quantization)是一种基于激活值分布来指导权重量化的方法。而“激活异常值保护”是指在量化过程中,对那些会导致输出严重偏离的异常激活通道(outlier channels),单独保留高精度(如FP16)或采用特殊缩放策略,避免量化精度崩塌。

1.2 面试官的真实意图

面试官不是要你背论文,而是考察你是否理解:

- 为什么普通量化在LLM上效果差?本质原因是激活值存在少数几个通道数值极大(异常值),它们对模型输出影响巨大。

- 你怎么识别这些异常值?基于激活值统计分布(如KL散度、百分位阈值)。

- 保护策略有哪些?混合精度、重参数化、动态缩放。

1.3 常见的理解误区

很多人误以为AWQ只是对权重做处理,实际上它核心是针对“激活值”的观察。更常见的是把异常值保护等同于“直接跳过量化”,但其实更优雅的做法是通过per-channel scaling factor来吸收异常值影响。

二、面试中高频出现的场景:激活异常值保护与量化的矛盾

2.1 落地部署场景

大模型部署在边缘设备上时,必须压缩到INT4甚至更低bits。但如果没有异常值保护,模型困惑度(perplexity)可能飙升超过5%,导致回答质量不可接受。

2.2 面试中的经典追问链

- 第一问:你是怎么处理量化中的异常值的?

- 第二问:如果不用混合精度,还有别的方法吗?

- 第三问:动态缩放会增加多少推理延迟?

这三个问题分别考察你对技术方案、算法变体、工程代价的理解。

2.3 常见错误回答

“我直接用了SmoothQuant的思想,把所有异常值抹平。”—— 这个回答暴露了你没有理解SmoothQuant的本质是迁移,而不是抹除。面试官会追问:迁移后权重如何保证精度?

三、AWQ激活异常值保护与普通量化的核心区别

3.1 对比维度

| 对比维度 | 普通量化(如MinMax量化) | AWQ + 异常值保护 |

|---|---|---|

| 核心依据 | 权重的全局范围 | 激活值的通道重要性分布 |

| 异常值处理 | 截断到量化范围 | 保留高精度或特殊缩放 |

| 推理效率 | 高,但精度损失大 | 稍低,但精度维持 |

| 适用模型 | 小模型(<1B) | 大语言模型(7B+) |

3.2 本质差异

普通量化假设权重和激活值分布均匀,而大模型的激活值呈现“少数量化敏感通道”的特性。AWQ通过收集少量校准数据,计算每个输入通道的激活值分布,然后对异常通道的权重进行保护性量化。

3.3 面试中如何对比说明

直接给出以下结构:

- 相同点:都做weight-only或weight-act量化。

- 不同点1:异常值识别标准不同。

- 不同点2:保护策略不同。

- 不同点3:部署复杂度不同。

四、理解AWQ激活异常值保护的核心原理与关键点

4.1 原理三步走

- 校准数据前向:输入少量文本,记录每层每个通道的激活值(activation)。

- 重要性计算:对每个通道的激活值取平均或最大值,反映该通道的重要性。

- 保护策略:对重要性高的通道,在量化时保留更高bit-width,或乘以一个scaling factor后量化。

4.2 关键代码逻辑(伪代码)

def awq_quantize(weights, calib_activations, alpha=0.5):

channel_importance = torch.mean(torch.abs(calib_activations), dim=0)

threshold = torch.quantile(channel_importance, 0.99)

outlier_channels = channel_importance > threshold

quantized_weights = quantize(weights, bit=4)

quantized_weights[outlier_channels] = quantize(weights[outlier_channels], bit=8)

return quantized_weights

4.3 面试中能体现深度的细节

- 校准数据的数量:一般128-512条就够了,过多可能过拟合。

- 如何选择异常值阈值?90%、99%还是动态?常见做法是看perplexity变化曲线。

- 是不是所有层都需要保护?通常只在前几层和中间层敏感。

五、面试中如何清晰回答AWQ相关问题?实操步骤

5.1 第一步:定义问题

“AWQ激活异常值保护要解决的问题是:在大模型量化过程中,少数激活值异常大的通道会占据绝大部分量化误差,如果不做保护,即使平均误差很小也会导致推理质量崩盘。”

5.2 第二步:给出方案框架

“常见的解决方案有三类:

- 混合精度量化:异常通道保持FP16,其余INT4;

- 重参数化:像SmoothQuant那样将异常值从激活迁移到权重;

- 动态异常值保护:在推理时动态识别当前token的异常通道并临时调高精度。”

5.3 第三步:量化收益与代价

“混合精度通常增加5%-10%的模型大小,但推理速度几乎不变(因为异常通道很少)。动态保护则增加额外的runtime开销。”

六、应对面试的实用技巧与表达框架

6.1 黄金表达框架:问题→原因→方案→权衡

- 问题:大模型量化后精度下降。

- 原因:激活异常值。

- 方案:AWQ的保护机制。

- 权衡:精度vs延迟/模型体积。

6.2 用比喻帮助理解

“你可以把异常通道想象成班级里的特长生——普通考试(均一量化)让他们发挥失常,而AWQ就是给他们单独出卷(保护),让整体成绩(模型精度)更高。”

6.3 避坑指南

- 不要说“我直接用SmoothQuant就行”——评委可能追问你对SmoothQuant原理的理解。

- 不要把“校准”和“训练”混淆。

- 提到实际部署时,要意识到KV Cache的异常值也需要保护。

七、用AI工具高效准备AWQ面试题,让简历更有说服力

7.1 传统准备方式的痛点

自己收集资料、整理知识点、模拟面试往往耗时低效。尤其对于技术岗位,面试官需要看到你对知识点的系统理解,而不是孤立记忆。

7.2 AI工具如何提效

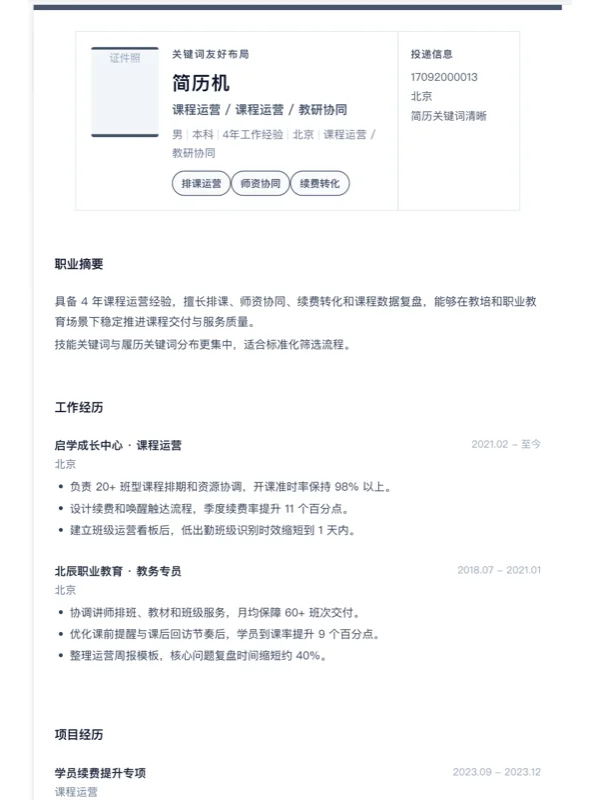

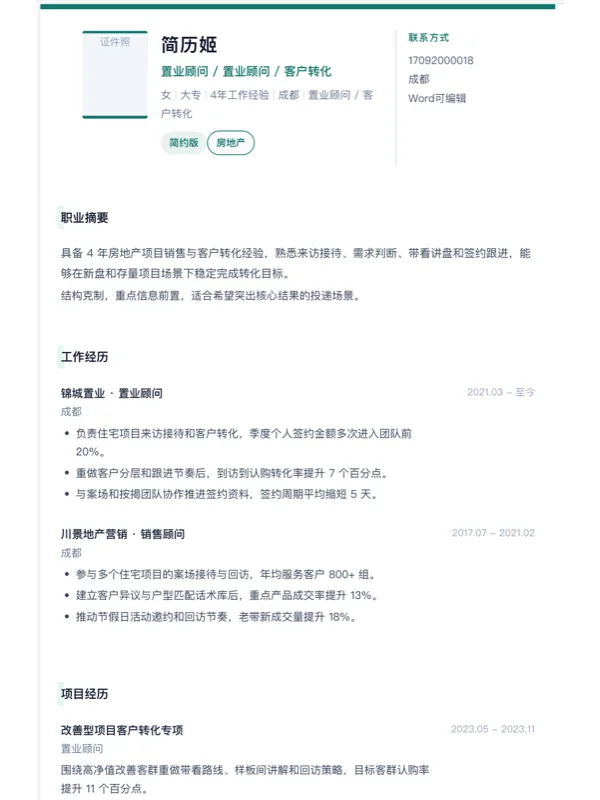

使用AI简历姬的“模拟面试”模块,你可以:

- 粘贴目标岗位(如“大模型量化工程师”)的招聘JD,系统自动提取关键词(如AWQ、GPTQ、SmoothQuant)。

- 针对你的简历经历,AI会生成基于JD的技术追问列表,比如“你在项目中用AWQ量化时,如何处理激活异常值?”

- 给出参考回答框架与个性化反馈,帮你训练回答的逻辑闭环。

7.3 从简历到面试的闭环

很多候选人不知道如何把技术深度体现在简历上。AI简历姬可以把你理解的“AWQ异常值保护”转化为项目经历中的成果描述,比如“设计异常通道检测机制,使模型在4-bit量化下perplexity仅上升0.3%”,让HR一眼看到价值。

推荐体验:注册AI简历姬,将你的简历与目标技术岗位对齐,系统会自动生成面试提问清单。

八、不同背景候选人面对AWQ问题的差异与应对

8.1 算法岗 vs 工程岗

| 用户类型 | 面试侧重点 | 优秀回答示例 |

|---|---|---|

| 算法研究员 | 数学原理与论文对比 | “AWQ与GPTQ本质区别在于异常值处理策略……” |

| 工程部署 | 落地实现与性能 | “我们在Triton上实现了per-channel的异常保护……” |

| 应届生 | 基础概念与学习潜力 | “我复现过AWQ论文的权重量化部分……” |

8.2 有经验者如何突出差异化

如果你有落地经验,可以强调你在某个场景(如移动端推理)遇到了异常值问题,并设计了简单的启发式保护方案。不必追求完美,面试官看重的是你解决问题的能力。

8.3 转行者如何切入

从其他领域(如计算机视觉)转行做大模型,可以类比VIT量化中的patch embedding异常值,展示迁移学习能力。

九、判断自己是否真正理解:自查清单

9.1 你能否回答以下问题?

| 检查点 | 不能(需要重点复习) | 能(基本掌握) | 能+能解释原理(精通) |

|---|---|---|---|

| 为什么大模型异常值通道更多? | ✓ | ✓ | ✓ |

| AWQ和SmoothQuant的核心区别? | ✓ | ✓ | ✓ |

| 如何选择校准数据集? | ✓ | ✓ | ✓ |

| 异常值保护后的推理加速比? | ✓ | ✓ | ✓ |

9.2 模拟面试实战

打开AI简历姬的“模拟面试”模块,选择“大模型量化”方向,让AI随机提问。如果你的回答每次都能涵盖“问题-原因-方案-权衡”,说明你已经完全掌握。

9.3 写作层面的自我验证

尝试用简洁的语言给非技术人员解释什么是AWQ异常值保护。如果对方能听懂,说明你真正理解。

十、持续优化:从一次面试题到深度学习系统

10.1 面试后复盘

每次技术面试后,把面试官追问的问题记录下来,分类到“原理”、“实现”、“工程”三个维度。分析自己哪一块卡住。

10.2 构建知识体系

AWQ只是量化技术的一环。你需要建立完整量化知识树:

- 量化类型(weight-only vs weight-act)

- 量化粒度(per-tensor vs per-channel vs group)

- 异常值保护(动态 vs 静态)

- 推理引擎(TensorRT-LLM, vLLM, llama.cpp)

10.3 利用AI简历姬持续迭代

将每次面试复盘到的知识点更新到“技能库”中,AI简历姬会根据新信息重新优化你的简历描述,并推荐下一步学习方向。求职不是一次性冲刺,而是持续迭代的过程。

十一、AWQ及模型量化的未来趋势与建议

11.1 更精细的异常值保护

未来研究可能从静态保护转向动态自适应保护,根据输入token实时调整异常阈值。

11.2 多bit混合量化

同一模型内不同层、不同通道使用不同bit-width成了标准做法。这与AWQ的思路一脉相承。

11.3 基于Agent的自动量化

autoAWQ等工具已经出现,未来面试可能提问“你会设计一个自动找最优量化方案的Agent吗?”需要你理解搜索空间与奖励函数。

十二、总结:把技术面试题转化为能力展示

把“AWQ激活异常值保护”准备透彻,不是背一套话术,而是建立“理解问题→分析根因→提供方案→评估权衡”的思维习惯。这种思维方式在任何技术岗位面试中都通用。

如果你希望更快完成简历与目标岗位的匹配,并针对技术面试进行模拟训练,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

12.1 核心行动建议

- 立即动手:把本文中的自查清单过一遍。

- 实战检验:用AI简历姬模拟一次AWQ相关面试。

- 持续记录:面试复盘比面试本身更重要。

12.2 心态提醒

求职面试是一场信息战,也是一场心态战。技术概念不理解是正常的,一点点拆解、练习,你就能在面试中从容表达。不要焦虑,每一步积累都会在面试官追问的那一刻闪光。

精品问答

问题1:面试官问“你如何保护大模型量化中的激活异常值?”应该先回答什么?

回答:首先明确异常值的来源——大模型激活值中少数通道数值远高于平均值,这些通道对输出影响巨大。然后按照三步结构回答:1)先通过校准数据统计激活分布,标记出top 1%的异常通道;2)对这些通道单独使用高精度(如FP16)或特殊缩放策略;3)最后评估精度与推理速度的trade-off。最后可以补充一个具体例子,比如你在某次项目中验证了该方案将perplexity提升控制在0.5%以内。

问题2:AWQ和SmoothQuant处理异常值的方式有什么区别?

回答:核心区别在于处理位置。AWQ保留异常通道的高精度,在量化时单独对待;SmoothQuant则通过可学习的缩放因子,将异常值从激活迁移到权重中,使所有激活通道分布更均匀,这样整体量化可以采用更统一的bit-width。AWQ更适合保留模型容量,SmoothQuant更适合统一部署加速。面试时最好能提到两种方法各自的量化误差分析。

问题3:作为应届生,完全没有量化项目经验,怎么在面试中回答AWQ问题?

回答:诚实承认没有实战经验,但展示学习能力。可以说:“我阅读了AWQ论文并复现了它的核心代码逻辑(可以简述),了解到它通过收集校准数据计算通道重要性,然后对重要通道做保护。虽然我没有落地经验,但我深刻理解了异常值保护是解决大模型量化精度损失的关键区别点。如果有机会,我会先跑通开源的autoAWQ,并在实际设备上测试推理速度与精度。”这种回答体现了主动性和理解深度。

问题4:AI简历姬怎么帮我准备这种技术面试?

回答:AI简历姬的核心能力是“岗位对齐”和“模拟追问”。你输入目标岗位(如“大模型量化研究员”),它会自动提取技术关键词(AWQ、GPTQ、KV Cache量化等)。然后,它结合你简历中的项目描述,生成个性化的面试问题,比如“你提到的量化方案中,如何处理激活异常值?”并提供回答框架。你还可以多次模拟,系统会自动记录你的进步点。这比盲目刷题高效得多。