如果你正在准备大模型方向的算法面试,大概率会遇到一个问题:“讲讲混合精度训练中INT8和FP4量化的区别?”很多人第一反应是背概念,但面试官真正想听的并不是定义,而是你对精度、速度、硬件适配和实际落地场景的理解。

简单说:INT8和FP4都是低精度量化技术,但INT8适用于推理加速,FP4更激进地压缩模型参数,用于训练阶段的显存节省。两者的核心差异在于数值表示范围、硬件支持度、以及精度损失的控制方式。下面我会从面试官视角出发,拆解这个问题背后的考察点、常见误区、以及如何系统准备相关面试题。

一、混合精度训练中的INT8与FP4是什么?

在深度学习中,混合精度训练指的是在训练或推理过程中混合使用不同精度的数据类型(如FP32、FP16、BF16、INT8、FP4等),以平衡计算速度与模型精度。INT8和FP4是其中两种典型的低精度格式。

1.1 INT8量化:8位整数量化

INT8将浮点数的权重或激活值映射到-128到127的整数范围,通过缩放因子和零点对齐。核心原理是线性量化或对称量化,实现简单、硬件支持广泛(如NVIDIA TensorRT、Intel OpenVINO)。主要用在推理阶段,能实现2-4倍的吞吐量提升,精度损失通常在1%以内。

1.2 FP4量化:4位浮点数量化

FP4是一种更激进的低精度格式,用4位表示一个浮点数,通常包含1位符号位、若干指数位和尾数位(如E2M1或E1M2)。与INT8相比,FP4的表示范围更窄、精度更低,但能极大减少模型存储和通信开销。适用于训练阶段的梯度压缩或端侧部署,但需要专门的硬件或自定义算子支持。

1.3 混合精度训练中的角色差异

混合精度训练通常以FP16或BF16为主精度,INT8和FP4则作为辅助。INT8用于量化推理(如部署时对激活值量化),FP4用于训练时激活/梯度压缩(如微软的FP4训练框架)。面试官问这个问题,往往想考察你是否理解不同精度在训练/推理流程中的位置。

二、为什么面试官会问INT8和FP4?

大模型面试题中,混合精度量化是一个高频考点,因为这是实际部署和训练绕不开的工程问题。面试官关心的是:你能否从原理到落地讲清楚。

2.1 考察底层数值表示理解

浮点数的符号、指数、尾数如何影响取值范围和精度?INT8的均匀量化与FP4的非均匀量化有什么区别?这些决定了量化策略的选择。例如,INT8适合权重分布均匀的情况,而FP4的指数位能更好处理动态范围大的激活值。

2.2 考察工程权衡能力

选INT8还是FP4?不是越低位越好,需要权衡精度损失、硬件支持、开发成本。面试官想看你能否针对不同场景给出合理建议。比如:当模型部署在数据中心(有NVIDIA GPU支持INT8 Tensor Core)时,优先INT8;当需要在移动端或IoT设备上运行百亿参数模型时,FP4可能更合适。

2.3 考察对前沿趋势的敏感度

FP4是2023-2024年学术界和工业界热门的低精度方向,代表工作如DeepSpeed的FP4训练、MIT的PACT量化等。面试官想了解你是否关注这些进展,并能评估其优劣。

三、INT8与FP4的核心区别与适用场景

本节用表格直观对比两者的关键差异。

| 维度 | INT8量化 | FP4量化 |

|---|---|---|

| 位宽 | 8 bit | 4 bit |

| 表示方式 | 整型(均匀量化) | 浮点型(非均匀量化) |

| 数值范围 | 固定(-128~127) | 可变(取决于指数位分配) |

| 精度损失 | 通常较小(<1%) | 较大(可能>2%) |

| 硬件支持 | 广泛(GPU/CPU/边缘设备) | 有限(需专用IP或仿真) |

| 主要用途 | 推理加速 | 训练压缩、端侧部署 |

| 代表工具 | TensorRT、ONNX Runtime | DeepSpeed、定制硬件 |

3.1 精度与范围的权衡

INT8表示范围有限,需要做截断或缩放;FP4因为有指数位,能表示更宽的范围,但精度离散化更粗糙。面试中常问:当数据分布出现长尾异常值时,哪种量化更稳定?答案是FP4的指数位可适应大值,但量化误差可能更大。

3.2 硬件依赖度

INT8已成大多数AI加速器的标配,而FP4目前只有少数芯片(如苹果Neural Engine、高通骁龙AI Engine)原生支持。面试时你可以补充:如果硬件不支持FP4,可以用INT8+混合精度蒸馏模拟。

3.3 训练 vs 推理的偏好

在训练阶段,为了减小通信开销,FP4更常见(如ZeRO++)。在推理阶段,INT8因成熟度高被广泛采用。面试官可能会追问:为什么训练不用INT8?因为梯度分布更复杂,整数量化容易引起不收敛。

四、面试回答的核心原则:从原理到应用

回答这类开放性问题时,要遵循“结构清晰、原理优先、场景落地”的原则。

4.1 先讲数值表示原理

不要一开始就罗列优缺点。先解释INT8是线性量化,FP4是浮点表示,写出各自的比特分配。例如:FP4的典型格式E2M1(2位指数,1位尾数),取值范围约为±240,精度步长非线性。这样能体现基础扎实。

4.2 再讲实际应用场景

接着说明在什么场合用哪种。比如:大语言模型推理常用INT8(W8A8),而训练时为了节省显存可能用FP4对激活值量化。最好结合你的项目经历,比如“我在XX模型部署中,将FP16的Bert模型转为INT8,在保持97%精度的前提下推理延迟降低2.5倍”。

4.3 最后给一个判断框架

总结一套选择策略:

- 如果目标是推理速度,且硬件支持INT8 → 优先INT8

- 如果目标是极致压缩(如百亿参数模型放到手机),且可以容忍精度损失 → 尝试FP4+蒸馏

- 如果在训练阶段需要减少通信,用FP4梯度压缩

这样面试官会觉得你有系统思维。

五、如何系统准备混合精度量化面试题

准备不能只背概念,要分模块建立知识体系。

5.1 夯实数值基础

理解IEEE 754浮点数标准,掌握FP16/BF16/FP4/INT8的表示范围、精度、符号位分配。会手动计算一个小数的量化误差。比如:将3.14量化成INT8,缩放因子0.1,零点0,得到31,反量化后3.1,误差0.04。这种计算题面试常考。

5.2 熟悉主流量化框架

至少了解两种:PyTorch的量化工具(torch.quantization)、NVIDIA TensorRT、Hugging Face Optimum、DeepSpeed。能说出它们各自支持的精度、量化策略(动态/静态/量化感知训练)。面试官可能会问“你用过哪个量化框架?遇到什么问题?” 准备一个真实案例。

5.3 练习典型简答题

以下三个是高频题目:

- 为什么混合精度训练能加速?答:减少内存带宽占用 + 利用Tensor Core。

- INT8和FP4在分布式训练中的通信加速原理?答:梯度压缩为低精度后,通信数据量减半或更多。

- 量化后模型精度下降如何补救?答:量化感知训练(QAT)、蒸馏、逐层校准。

六、高频面试题实用回答技巧

面试时不只要正确,还要有逻辑、有重点。

6.1 用“三明治”结构回答

第一层:一句话定义(INT8是……FP4是……)

第二层:2-3个关键区别(精度、范围、硬件)

第三层:一个实际例子(比如我用FP4压缩梯度,通信量减少75%)

6.2 预判追问方向

问完“INT8和FP4区别”后,面试官常追问:

- “那你会选哪个?” 答:取决于场景(推理选INT8,训练梯度压缩选FP4)。

- “FP4训练时如何保证收敛?” 答:通常配合混合精度(主权重BF16)+随机量化。

- “解释一下量化参数calibration?” 答:使用少量校准数据计算缩放因子和零点。

准备充分就不会卡住。

6.3 展示自己踩过的坑

面试官喜欢有实战经验的候选人。可以讲:“我曾经在做LLaMA-2 13B的INT8部署时,发现某些激活值分布不对称导致精度骤降,后来改用逐通道量化解决。” 这种细节比背100个定义更有价值。

七、用AI工具高效准备面试

准备面试需要大量知识梳理和模拟练习,传统方式是自己做笔记、找朋友对练,效率偏低。AI工具可以帮你大幅提效。

7.1 传统准备方式的痛点

- 知识点零散,没有体系(100篇博客看到头晕)

- 模拟面试难找到合适的人(朋友不一定懂混合精度)

- 简历上项目经历的量化描述不够专业(面试官看不出你做了什么)

7.2 AI如何帮你系统梳理

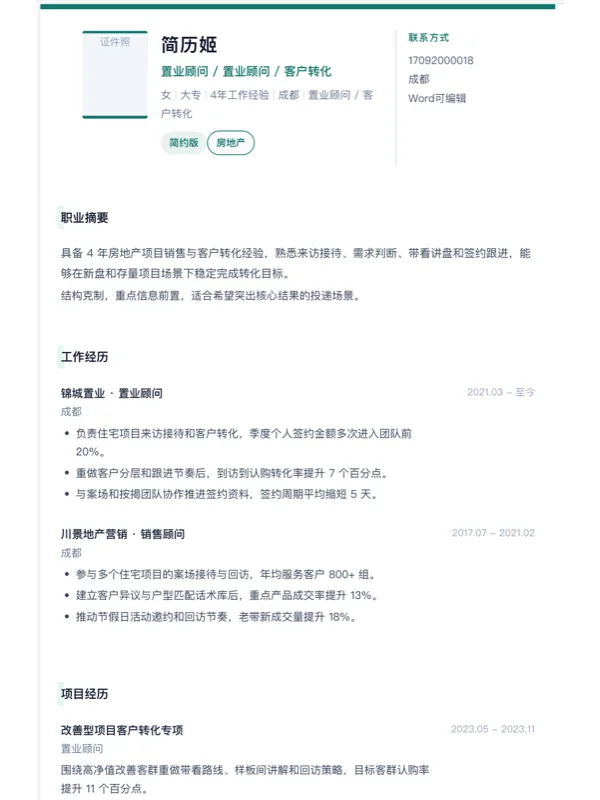

使用AI面试陪练工具(如AI简历姬的模拟面试功能),你可以:

- 输入目标岗位(比如“大模型算法工程师”),系统自动生成基于“混合精度量化”的面试题,包括原理、代码、场景题。

- 模拟面试后,它会分析你的回答逻辑、遗漏点、改进方向。

- 针对你简历中相关的项目(比如“使用DeepSpeed进行FP4训练”),AI能生成更量化的STAR描述,让面试官一眼看到你的贡献。

7.3 AI简历姬实战场景举例

假设你简历上写着“负责模型压缩,提升了推理速度”。这太模糊。用AI简历姬的JD对齐功能,粘贴一个目标公司的大模型部署岗JD,系统会自动提取关键词“INT8量化”“TensorRT部署”“延迟降低50%”,然后帮你改写为:“基于TensorRT实现BERT模型的INT8动态量化,在CV任务中推理延迟从120ms降至48ms,精度仅损失0.3%。” 同时,AI简历姬的面试模块会根据这个经历追问:“你用的校准集有多少数据?碰到了哪些困难?” 让你提前准备。

八、不同背景求职者的备考策略差异

不同经验水平的候选人,回答侧重点不同。

8.1 应届生 / 转行者

重点:讲清楚原理和基本流程。不要硬套项目(没有就是没有),但可以展示你的学习能力:例如“我复现了论文《ZeroQuant: Efficient and Affordable Post-Training Quantization for Large Transformers》并对比了INT8和FP4效果”。加分。

8.2 有1-3年经验的人

重点:结合具体工作。比如“我在XX公司负责推荐模型部署,广告CTR模型从FP32转INT8后,QPS(每秒查询数)提升3倍,收入没有下降”。要突出量化后业务效果。

8.3 资深工程师 / 架构师

重点:系统设计能力。比如“我设计了一套混合精度量化方案,在训练时用FP4压缩梯度,推理时用INT8 + KL散度校准,支撑了千亿参数模型的在线服务”。需要描述落地方案、选型理由、效果对比。

| 人群 | 核心切入点 | 常见误区 |

|---|---|---|

| 应届生 | 原理+开源代码复现 | 只背名词解释,没有代码验证 |

| 中级 | 业务场景+效果数据 | 忽视硬件兼容性 |

| 高级 | 架构设计+权衡决策 | 忽略迁移成本和维护性 |

九、自查清单:你的量化知识掌握到哪了?

在面试前,你可以对照以下表格检查自己是否覆盖了关键点。

| 知识领域 | 需要掌握的内容 | 是否掌握(✅/❌) |

|---|---|---|

| 数值表示 | FP32/FP16/BF16/INT8/FP4的格式与范围 | |

| 量化原理 | 均匀量化 vs 非均匀量化、校准方法 | |

| 混合精度训练 | 为什么梯度用FP16、权重用FP32 | |

| INT8推理 | TensorRT/ONNX动态静态量化、精度损失补救 | |

| FP4训练 | DeepSpeed FP4、梯度压缩、通信减少 | |

| 硬件适配 | GPU Tensor Core、CPU VNNI、移动端NPU | |

| 代码实践 | 至少用PyTorch做过一次量化并对比精度 | |

| 前沿论文 | ZeroQuant、LLM.int8()、FP4训练相关 |

9.1 查漏补缺方法

如果发现自己有空白,优先补齐“原理”和“代码实践”,因为面试最容易问到。

9.2 实战模拟策略

找几个IO密集型重点:写出量化前向传播伪代码、计算不同精度的内存占用。这些题面试官喜欢出。

9.3 自我评估信号

如果你能轻松回答“为什么FP4比INT8更适合训练时的梯度压缩”,说明你基本过关。

十、常见误区与持续学习路径

很多人学习量化时陷入误区,浪费了时间。

10.1 误区一:以为位宽越低越好

实际上位宽降低往往伴随精度大幅下降,且需要特殊硬件。选择应基于成本收益分析,而不是一味追求低位。

10.2 误区二:只关注INT8,忽视FP4

FP4在2024年已有不少工业应用(如Apple Intelligence),不关注会显得知识陈旧。

10.3 以面试为驱动的学习路径

- 阶段1(1-2周):学习浮点数表示、量化原理(推荐《A Survey of Quantization Methods》)

- 阶段2(1周):用PyTorch官方教程做一个INT8量化demo

- 阶段3(1周):阅读DeepSpeed FP4的论文和技术博客

- 阶段4(持续):刷面试题,用AI简历姬模拟面试并复盘

十一、大模型量化技术的未来趋势

混合精度量化正在从粗粒度向细粒度、从固定位宽向混合精度自适应演进。

11.1 自适应混合精度量化

未来的框架可能动态决定每层用INT8还是FP4,或更精细的2-8位混合。比如微软的Mixed-Precision-Parameter训练。

11.2 硬件与算法的协同设计

芯片厂商(如NVIDIA H100的FP8 Tensor Core、Apple M4的4位支持)正在催生新格式。算法层需要适应新硬件,比如FP4的精度损失可以通过蒸馏弥补。

11.3 端侧大模型的必然选择

随着AI手机、AI PC普及,百亿参数模型必须依赖低位量化。FP4可能是决定性技术之一。面试准备时应多关注端侧部署方案。

十二、总结:AI大模型面试中量化知识的关键在于理解本质

无论是INT8还是FP4,它们都是在精度和效率之间寻找最佳平衡的工具。面试官想看你是否真正理解这点,并能灵活应用于不同场景。不要陷入死记硬背,而是从数值表示、硬件支持、工程实践三个维度构建体系。

在准备过程中,如果你希望更快地梳理知识体系、优化简历中相关项目的描述,或者进行针对性的模拟面试,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。AI简历姬是一个以岗位要求(JD)为中心的求职工作台,它能帮助你将量化相关经历以成果导向的方式呈现,同时提供面试追问模拟,让你提前适应面试压力。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:混合精度训练中的INT8和FP4量化,面试时应该先讲哪个?

回答:建议先讲INT8,因为受众更熟悉。然后过渡到FP4:“INT8是主流,但近期FP4在训练压缩中越来越重要。” 这样既覆盖经典又体现前瞻性。

问题2:FP4量化在训练中具体怎么用?会不会导致模型不收敛?

回答:通常只在梯度通信阶段使用FP4压缩,主权重仍保留FP16或BF16。DeepSpeed的FP4训练利用随机舍入和动量补偿来缓解精度损失,实验显示收敛性接近BF16。

问题3:我应该在简历项目里写“使用INT8量化”还是“使用FP4量化”?

回答:看公司偏好。如果是互联网大厂(注重部署),写INT8更合适;如果是芯片公司或前沿研究方向,写FP4更能吸引眼球。核心是写清楚问题-方案-效果。AI简历姬可以帮你自动提取JD里的关键词来优化措辞。

问题4:除了原理,面试官还会考什么?

回答:常考手写量化伪代码、计算压缩比、推导精度损失公式。比如:假设一个FP16模型4 GB,用INT8权重量化(权重占80%)后模型多大?答:40.80.5 + 4*0.2 = 2.4 GB。这类题要会。