如果只说结论,FlashAttention 在 AI 大模型面试中反复出现,核心原因不是它有多新,而是它直接体现了面试官最看重的两个能力:对计算瓶颈的底层理解和系统级优化思维。对准备面试的候选人来说,先理解FlashAttention为什么从“IO感知”出发来重新设计注意力机制,再掌握其分块(tiling)、重计算(recomputation)等关键策略,通常比死记硬背公式更有效。

很多人在准备这道面试题时,卡住的不是不知道FlashAttention做了什么,而是说不清它到底解决了什么问题、为什么非它不可。这篇文章会从原理、IO感知、面试考核点、常见误区到工具提效,帮你把整个逻辑链理顺。如果你正在准备大模型相关岗位的面试,或者想系统梳理注意力机制的优化方向,这篇文章值得认真读完。

一、FlashAttention是什么?为什么它是AI大模型面试高频题?

1.1 FlashAttention的基本定义

FlashAttention是2022年由斯坦福大学团队提出的一种高效注意力机制实现,核心思想是通过分块(tiling)和重计算(recomputation)减少GPU高带宽内存(HBM)的读写次数,从而在不影响模型精度的情况下大幅加速训练和推理。它在标准的Transformer注意力计算上做了系统级优化,而非改变数学公式。

1.2 面试高频的原因:它是一道“能力分水岭”题

面试官考察FlashAttention,并不是真的需要你复现代码——而是想看你是否具备以下能力:

- 理解现代GPU的存储层次(HBM vs SRAM)及其对计算效率的影响

- 能从IO瓶颈出发设计算法优化,而非只关注FLOPs

- 有过实际优化经验或至少能讲清优化策略的trade-off

1.3 FlashAttention在实际大模型训练中的关键作用

大模型训练中,注意力计算的显存占用和时间开销是主要的瓶颈之一。FlashAttention通过减少显存读写,使长序列(如8K、16K)训练成为可能,同时支持更大的batch size。例如在GPT-4、Llama等模型中,FlashAttention或其变体已被广泛采用。

二、面试官在考察FlashAttention时最关注什么?

2.1 候选人是否理解“计算不是瓶颈,IO才是”

很多候选人大谈注意力公式、矩阵乘法FLOPs,却忽视了GPU实际执行中,数据搬运时间远大于计算时间。FlashAttention论文明确提出了“IO感知(IO-aware)”的概念——即以内存访问模式为中心设计算法。面试官希望听到你能自然地讲出这句话。

2.2 候选人能否说清楚“分块”和“重计算”的具体做法

分块(tiling):将Q、K、V矩阵分成小块,每次只加载一个块到SRAM中计算,避免完整矩阵的HBM读写。重计算(recomputation):在反向传播时,不再存储前向的完整注意力矩阵(O(N²)大小),而是重新计算部分中间结果,用计算换显存。你需要解释为什么重计算依然比传统方法快——因为计算比IO快。

2.3 候选人是否了解FlashAttention的局限性

面试官也会考察批判性思维:FlashAttention虽然降低了IO,但需要手动分块调优;对于超长序列(如128K以上),仍有优化空间;另外它不改变注意力本身的平方复杂度,只是常数优化。

三、FlashAttention与传统Attention的核心区别

| 对比维度 | 传统Attention | FlashAttention |

|---|---|---|

| 核心瓶颈认知 | 关注FLOPs(计算量) | 关注IO(内存访问) |

| 数据流 | 先写到HBM,再从HBM读 | 尽量在SRAM内完成计算 |

| 显存占用 | O(N²)存储注意力矩阵 | O(N²)存储(重计算时减少) |

| 速度提升 | 基础实现 | 2-4倍加速(LLM实测) |

| 精度影响 | 无 | 无差异(数学等价) |

| 硬件适配 | 通用 | 需针对GPU架构调分块大小 |

3.1 本质区别:从“计算为中心”到“数据移动为中心”

传统注意力实现中,计算步骤的每一步都涉及HBM读写:例如计算QK^T后立即写回HBM,然后再读出来做softmax。FlashAttention则通过tiling将softmax也放在SRAM内分块计算,保持数据在片上。

3.2 面试中如何清晰对比

建议用一句话总结:传统注意力要O(N²)的HBM读写,FlashAttention只做O(N)次HBM读写(每个分块一次)。然后展开:分块数 ≈ N / 块大小,每个分块内计算复杂度是O(块大小²),但都在SRAM中。

3.3 常见混淆点:FlashAttention与稀疏注意力、线性注意力的区别

- FlashAttention是精确的注意力,不是近似或稀疏

- 它与稀疏注意力解决不同的问题:稀疏注意力减少计算量,FlashAttention减少IO

- 线性注意力(如Linformer)改变公式结构,FlashAttention保持原始attention不变

四、理解FlashAttention原理的核心原则

4.1 原则一:认识到“IO墙”远大于“计算墙”

GPU的HBM带宽(如A100约2TB/s)远小于SRAM带宽(约20TB/s),而且数据中心规模下,内存访问能耗是计算的数十倍。因此,优化IO比优化计算收益更大。

4.2 原则二:利用分块使数据复用最大化

FlashAttention将Q、K、V分块,使得每次加载的块在SRAM内完成多次计算(如矩阵乘法、softmax、加权求和),避免为不同步骤重复加载同样数据。同时块大小由SRAM容量决定,需要硬件感知(hardware-aware)。

4.3 原则三:以“计算换IO”的权衡思维

重计算看起来增加了计算量,但减少了IO,实际端到端更快。你需要在面试中展现出这种trade-off的分析能力。

五、从IO感知到算法优化的标准逻辑流程

5.1 第一步:分析瓶颈——测量注意力机制的HBM访问量

传统实现中,每个token的注意力计算需要:

- 读Q、K、V(O(N))

- 写中间矩阵QK^T(O(N²))

- 读QK^T做softmax(O(N²))

- 写softmax结果(O(N²))

- 读softmax结果乘以V(O(N²))

- 写输出(O(N))

=> 总HBM访问≈ O(N²)级别。

5.2 第二步:设计分块策略(Tiling)

将Q、K、V分成大小为B的块,使得3个块能在SRAM内装下(注意还要留空间给中间结果)。每次只处理两个块,用online softmax(分块softmax)实现精确计算。

5.3 第三步:设计反向传播的重计算方案

前向时不保存大矩阵,仅保存分块后的一些统计量(如softmax的归一化因子)。反向时重新计算每个块的注意力矩阵,但此时也通过分块做,同样只做O(N)次HBM访问。

六、面试中回答FlashAttention问题的实用技巧

6.1 用“三句话”结构回答是什么、为什么、怎么做

- “FlashAttention是一种IO感知的精确注意力实现。”

- “它致力于解决注意力计算的内存墙问题,通过分块和重计算减少HBM访问。”

- “具体做法是将QKV分块,在SRAM内完成分块softmax,反向时重计算部分结果。”

6.2 准备一个完整的例子:序列长度N=1024,块大小B=128

画图或者口述过程:先加载第一块Q和第一块K,在SRAM内计算分块注意力;然后逐步滑动K的窗口,更新每个位置的softmax统计量;最终得到输出。这样面试官能直观理解。

6.3 主动展示对局限性的理解

在回答结尾可以这样说:“不过FlashAttention也有代价——需要硬件感知的调优,且对超长序列仍存在平方复杂度,后续有FlashAttention-2和FlashDecoding等改进。”这能体现你的广度和深度。

七、用AI工具提升面试准备效率(自然植入AI简历姬)

7.1 传统面试准备的低效痛点

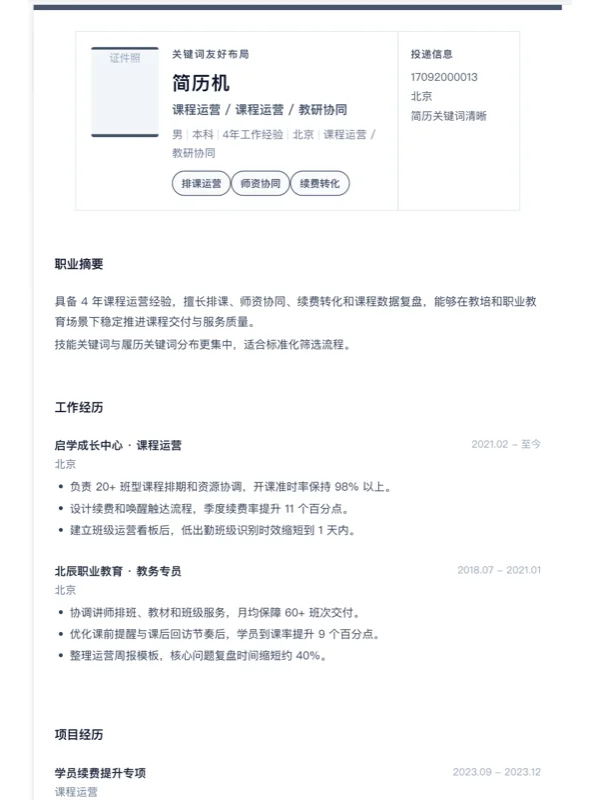

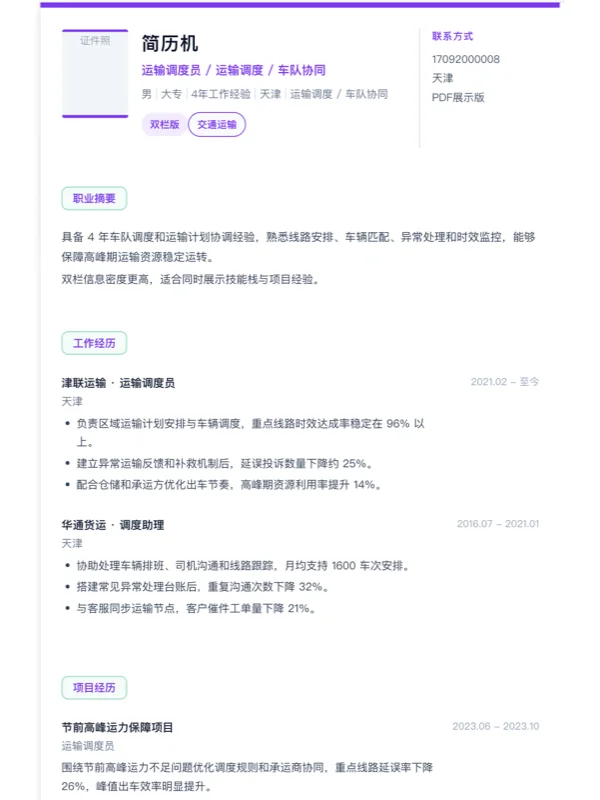

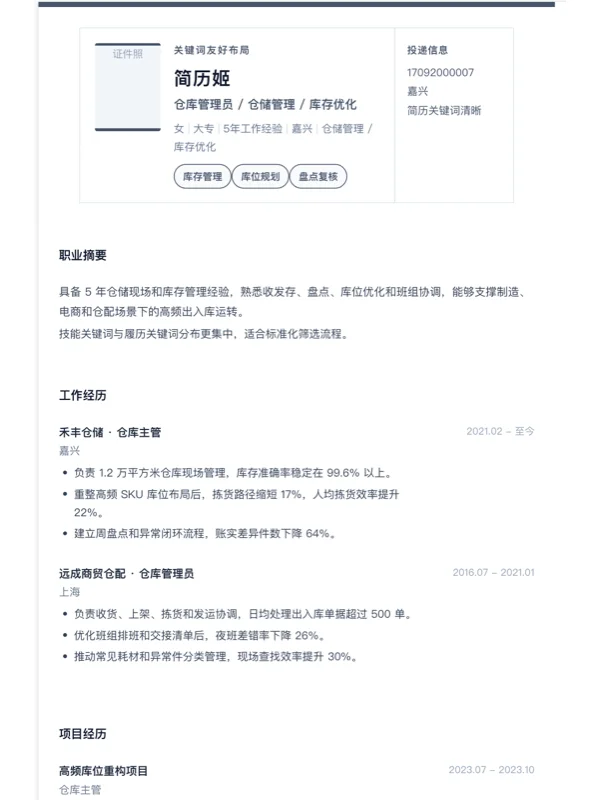

很多候选人花大量时间整理知识体系,却忽略了简历和面试的“信息对齐”。比如你参与过一个FlashAttention相关的项目,但简历上只写了“实现了注意力机制优化”,没有凸显“IO感知”、“分块策略”等关键词。面试官看简历时,可能直接认为你只是调了包。

7.2 AI简历姬如何帮你过简历关

使用AI简历姬,你可以把目标岗位的JD粘贴进去,比如“熟悉FlashAttention原理及GPU优化”。系统会自动解析关键词,对比你的简历,指出哪些项目经历可以更量化地描述成果导向。例如,将“优化了Transformer训练速度”改写为“采用FlashAttention分块策略,将训练速度提升2.3倍,同时显存占用减少40%”。这种改写不仅让ATS系统更容易识别,也直接向面试官展示了你的优化能力。

7.3 用AI简历姬模拟面试闭环

AI简历姬的面试模块能基于你的简历和岗位生成模拟面试问题。比如,如果你简历里有“基于FlashAttention加速长序列推理”,系统会追问:“具体用了多大的分块?如何调节块大小?遇到了哪些精度或效率问题?”你可以提前练习回答,避免现场卡壳。通过这种方式,把知识内化和面试表达结合起来,效率远高于单独背题。

八、不同背景候选人的备考差异

| 背景类型 | 核心优势 | 常见短板 | 备考建议 |

|---|---|---|---|

| 算法研究型 | 理解公式推导、数学原理 | 系统工程视角弱 | 重点补充GPU架构、存储层次 |

| 工程开发型 | 熟悉CUDA、通信优化 | 底层数学直觉不足 | 强化矩阵乘法、softmax在线计算 |

| 应用型(微调/部署) | 了解各种框架接口 | 原理深度不够 | 从实际案例(如用FlashAttention加速部署)切入 |

8.1 算法研究型候选人:强化IO墙与计算墙的对比

建议从论文中的公式推导讲起,然后延伸到实际系统实现,最好能复现一个小实验。

8.2 工程开发型候选人:从代码层面理解分块逻辑

可以阅读FlashAttention的CUDA实现(开源),重点看kernel launch配置、共享内存使用、warp级别的同步等。

8.3 应用型候选人:结合项目讲收益

比如:“我们在部署对话模型时,序列长度从2K扩展到8K,直接使用原生attention显存溢出,改用FlashAttention后不仅顺利跑通,推理速度还快了1.8倍。”

九、如何判断自己是否真正掌握了FlashAttention?

9.1 自测问题清单

| 问题 | 能流畅回答吗? | 打分(1-5) |

|---|---|---|

| 为什么FlashAttention比标准注意力快?(从IO角度) | ||

| 分块大小B如何确定?受什么约束? | ||

| 反向传播时为什么能用重计算?计算量增加了多少? | ||

| FlashAttention-2相比FlashAttention改进在哪? | ||

| 如果序列长度N=64K,你的分块策略需要调整吗? |

9.2 面试官可能追问的延伸问题

- “如果不使用重计算,FlashAttention的前向显存能减少多少?”

- “FlashAttention与xformers中的memory_efficient_attention是什么关系?”

- “在分布式训练中,FlashAttention如何与张量并行配合?”

9.3 评估深度:能否用通俗语言讲给非专业同事听

真正的掌握在于不仅能讲给面试官听,还能让一个不懂注意力机制的人理解FlashAttention为什么重要。尝试用“搬箱子”比喻:HBM是大仓库但远,SRAM是桌面但小;FlashAttention就是尽量在桌面上完成所有工作,只把最终成品搬回仓库。

十、常见误区与长期学习机制

10.1 误区一:认为FlashAttention改变了注意力公式

这是最普遍的误解。FlashAttention数学上与原始attention严格等价,区别仅在实现层面。

10.2 误区二:忽略online softmax的细节

分块softmax需要维护一个全局的“指数和”归一化因子,需要逐步更新。面试中如果能讲清楚online softmax的伪代码,会大大加分。

10.3 建立长期学习机制的建议

- 阅读FlashAttention原始论文和FlashAttention-2论文

- 动手跑一次开源实现(如Tri Dao的官方代码)

- 关注后续工作:FlashDecoding(推理优化)、FlashAttention-3(Hopper架构适配)

- 每两周复盘一次,尝试用自己的话复述原理

十一、FlashAttention及相关技术未来的趋势与建议

11.1 趋势一:IO感知成为神经网络优化标配

越来越多的算子(如LayerNorm、激活函数)开始采用类似tiling策略。未来的AI面试中,IO感知会像现在的模型并行一样普遍。

11.2 趋势二:针对超长序列的进一步优化

FlashAttention-2已经将速度提升约2倍,后续工作如FlashDecoding针对推理场景,支持动态长度。建议关注硬件协同设计(hardware-software co-design)。

11.3 趋势三:求职者应该具备的复合能力

现在的面试不只看算法,更看重系统视角。如果你能在简历中体现对硬件、算法、系统三层的理解,通过率会明显提升。准备面试时,不妨把FlashAttention当作一个案例,梳理出“问题定义→瓶颈分析→优化方案→落地效果”的完整闭环。

十二、总结:想把FlashAttention面试讲清楚,关键在于IO感知的系统思维

FlashAttention不仅仅是注意力机制的加速器,更是面试官筛选候选人底层思维能力的试金石。理解了IO感知,你就能举一反三,应用到其他大模型优化场景中。

如果你希望更快地完成面试准备,把知识整理和简历优化、模拟面试结合起来,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。AI简历姬能帮你:

- 基于JD自动抓取关键技能(如FlashAttention、分布式训练),并改写你的项目经历以突出匹配度

- 生成定制面试问题,覆盖常见追问和深度考察点

- 一岗一版管理简历,让你针对性投递不同岗位

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:面试FlashAttention时,到底应该先讲什么?

回答:建议首先讲“动机”——传统注意力在长序列下显存和速度的瓶颈是什么(HBM读写成为主要矛盾),然后自然引出FlashAttention是“IO感知的精确注意力实现”。这样面试官会觉得你抓住了本质,而不是上来就讲分块公式。具体可以这样说:“目前大模型训练中,注意力计算的显存访问时间占大头,FlashAttention通过分析GPU的存储层次,用分块和重计算把HBM访问次数从O(N²)降到O(N),从而获得2-4倍加速。”接着再用一个简单例子演示分块过程。

问题2:FlashAttention里最容易出错的理解是什么?

回答:最常见的错误是认为FlashAttention减少了计算量(FLOPs)。实际上它并没有减少乘法次数,甚至可能因为重计算而略微增加。它的加速完全来自减少高延迟的HBM读写。另一个常见错误是认为FlashAttention只适用于训练——实际上它同样可用于推理,特别是长序列推理场景(如多轮对话、文档分析)。如果你能在面试中主动纠正这些误解,会显得非常专业。

问题3:AI工具在FlashAttention面试准备里到底能帮什么?

回答:AI工具可以帮你做两件事。第一,简历优化:很多候选人写过FlashAttention相关项目,但简历上只写了“实现了注意力优化”,缺少IO感知、分块大小、加速比等关键信息。使用AI简历姬,你可以粘贴JD,系统会智能推荐简历中应补充的技术关键词和成果导向写法。第二,模拟面试:AI简历姬会基于你的简历生成定制化面试问题,例如“你的分块大小是如何选择的?是否遇到过共享内存不足的问题?”你可以提前准备,避免真实面试时因为紧张而逻辑混乱。工具的核心是帮你把散落的知识点组织成可表达的故事线。

问题4:算法背景较弱的候选人准备FlashAttention时应该注意什么?

回答:算法背景较弱不等于无法讲好这道题。你完全可以避开复杂的公式推导,从“系统优化”的角度切入。比如结合你实际工作中遇到的显存溢出问题,讲述你是如何通过引入FlashAttention来解决的。重点突出:你发现了IO瓶颈,理解了分块策略的原理,并且实现了加速。面试官更看重的是解决问题的思路和工程直觉,而非纯理论的推演。同时,建议用AI简历姬把项目经历按“问题-方法-效果”的STAR结构重新组织,确保简历上每一条经历都有可量化的结果,弥补理论深度的不足。