如果你正在准备AI大模型方向的面试,尤其涉及LLM(如LLaMA、PaLM等)的面试题中,SwiGLU激活函数几乎是一个绕不开的考点。很多候选人会因为记不住公式、不理解门控机制或无法说清与其他激活函数的区别而被扣分。本文不仅会帮你彻底搞懂SwiGLU的公式和原理,还会给出面试场景下的标准回答框架、代码实现要点以及如何借助工具(如AI简历姬的模拟面试模块)高效准备——让你从理解到表达,一步到位。

一、SwiGLU激活函数是什么?——从GLU到SwiGLU的演进

1.1 门控线性单元(GLU)的基本概念

SwiGLU是“Swish + GLU”的缩写,由Google在PaLM论文中提出。理解它需要先了解GLU(Gated Linear Unit)。GLU是一种门控机制,将输入通过两个线性变换,其中一个经过sigmoid激活后作为门控信号,与另一个线性变换的结果逐元素相乘。公式为:

GLU(x) = (xW1 + b1) ⊗ σ(xW2 + b2)

其中⊗表示逐元素乘法,σ为sigmoid函数。这种方式能让网络通过门控动态控制信息流,提升长序列建模能力。

1.2 Swish激活函数的特点

Swish是Google在2017年提出的自门控激活函数,定义为 x * σ(x)。它具备无上界、有下界、平滑、非单调等特性,在深层网络中往往优于ReLU。但Swish的计算成本稍高(需要计算sigmoid)。

1.3 SwiGLU:将Swish融入GLU的门控设计

SwiGLU用Swish替代GLU中的sigmoid作为门控激活函数。公式变为:

SwiGLU(x) = (xW1 + b1) ⊗ Swish(xW2 + b2)

其中 Swish(x) = x * σ(x)

这种设计结合了Swish的平滑非饱和特性与GLU的门控能力,在LLaMA等模型中表现优异。关键在于:门控信号不再是二元开关(sigmoid输出接近0或1),而是带有平滑软开关的特性,让梯度更易传播。

二、为什么SwiGLU成为大模型首选?——面试官考察点分析

2.1 性能优势:比ReLU/GELU更优的收敛与效果

在PaLM论文中,SwiGLU相比ReLU、GELU在相同训练步数下困惑度更低,尤其在深层Transformer中。原因是门控机制允许每层特征有选择地通过,减少了噪声传递。

2.2 与Transformer结构的天然适配

大模型(如LLaMA)通常在前馈网络(FFN)中采用SwiGLU。标准的FFN结构是“升维 → 激活 → 降维”,而SwiGLU FFN变为“两个线性变换 → 门控 → 降维”,参数增多但效果更好。面试官常问:SwiGLU会带来多少额外参数?如何设计降维矩阵?

2.3 面试高频问题背后的意图

面试官考察SwiGLU并非只考记忆,而是想了解你对激活函数设计原则(平滑、门控、计算效率)的深度理解,以及你是否能对比不同激活函数在Transformer中的适用场景。因此,回答时除了公式,还要提到为什么门控在大模型中有效,以及Swish为什么比sigmoid更合适。

三、SwiGLU与ReLU、GELU、GLU的核心区别

3.1 激活函数对比总览

下面从定义、计算复杂度、梯度特性、常见模型等维度列出对比:

| 激活函数 | 公式 | 门控? | 计算复杂度 | 常用模型 |

|---|---|---|---|---|

| ReLU | max(0,x) | 无 | O(n) | BERT早期 |

| GELU | x*Φ(x)(近似) | 无 | O(n) | BERT, GPT |

| GLU | (xW+b)⊗σ(xV+c) | 是 | O(2n²) | 部分NLP模型 |

| SwiGLU | (xW+b)⊗Swish(xV+c) | 是 | O(2n²) | LLaMA, PaLM |

注意:GLU和SwiGLU需要两个权重矩阵,参数量翻倍,但通过降维策略可控制总参数。

3.2 关键区别:为何门控优于非门控

非门控激活函数(ReLU/GELU)对所有输入使用相同函数,而门控机制允许网络对每个元素独立调节信息流。在大模型中,门控可以帮助模型更好地处理长距离依赖和稀疏激活。

3.3 Swish vs Sigmoid作为门控的优劣

Sigmoid输出范围(0,1),门控信号饱和区域梯度极小,容易引发梯度消失。Swish在x<0时输出为负且下界,在x>0时近似线性,梯度更健康。因此SwiGLU训练更稳定。

四、SwiGLU公式拆解:数学原理与计算流程

4.1 完整公式与符号含义

给定输入 x∈ℝᵈ,SwiGLU FFN子层(如LLaMA)的计算流程:

- 线性变换:x₁ = xW₁ + b₁,x₂ = xW₂ + b₂ (W₁,W₂∈ℝᵈˣ⁸ᵈ, 通常中间维度为8d)

- 门控激活:g = Swish(x₂) = x₂ * σ(x₂)

- 逐元素相乘:h = x₁ ⊗ g

- 输出线性变换:y = hW₃ + b₃ (W₃∈ℝ⁸ᵈˣᵈ)

4.2 参数量分析

相比单激活的FFN(参数=2d4d=8d²),SwiGLU FFN需要三个权重矩阵:W₁,W₂,W₃。若保持中间维度为8d/3左右(如LLaMA使用8/3*d),总参数量与标准FFN接近,但效果更好。面试中常问“为什么SwiGLU不增加太多参数?”答案就是降维因子。

4.3 梯度流计算

反向传播时,门控信号g的梯度会作用于x₁和x₂。由于Swish的导数∂Swish/∂x = σ(x) + xσ(x)(1-σ(x)),复杂度略高于ReLU,但现代GPU可高效并行。

五、面试中如何推导和解释SwiGLU?——标准回答框架

5.1 第一步:先讲动机,再讲公式

面试官问:“请介绍一下SwiGLU。”你应这样回答:

“SwiGLU是一种基于门控机制的激活函数,由Swish和GLU组合而成。它的设计动机是为了在Transformer的前馈网络中引入可学习的门控,让每一层能自适应地选择信息流,提高模型的表达能力。公式是……”

5.2 第二步:手推计算图(可口头描述)

描述两个线性分支,Swish门控,逐元素乘,最后输出线性变换。指出中间维度一般为8d/3。如果面试官要求你写出具体矩阵形状,要能准确说出。

5.3 第三步:对比其他激活函数(表格呈现)

| 维度 | ReLU | GELU | SwiGLU |

|---|---|---|---|

| 门控 | 无 | 无 | 有 |

| 平滑性 | 否 | 是 | 是 |

| 参数量 | 低 | 中 | 高(可压缩) |

| 大模型效果 | 一般 | 好 | 最好 |

5.4 第四步:总结适用场景

适合深层LLM,尤其是需要稀疏激活和长程依赖的场景。同时指出计算成本略高,但已被LLaMA等验证有效。

六、SwiGLU的代码实现与工程优化技巧

6.1 PyTorch简洁实现

import torch

import torch.nn.functional as F

class SwiGLUFFN(torch.nn.Module):

def __init__(self, d_model, d_ff):

super().__init__()

self.w1 = torch.nn.Linear(d_model, d_ff, bias=False)

self.w2 = torch.nn.Linear(d_model, d_ff, bias=False)

self.w3 = torch.nn.Linear(d_ff, d_model, bias=False)

def forward(self, x):

x1 = self.w1(x)

x2 = self.w2(x)

gate = x2 * torch.sigmoid(x2) # Swish

return self.w3(x1 * gate)

6.2 工程优化:融合算子与量化

实际训练时,可将两个线性层合并为一个大矩阵,用分段计算提高利用率。推理时可对Swish使用近似表或INT8量化,减少计算。

6.3 常见实现错误

- 将两个线性层的输出维度设成一致(应该两个分支独立),或者忘记激活函数后的门控相乘顺序。

- 降维因子计算错误,导致参数量非预期增加。

七、用AI工具辅助面试准备:从简历到模拟问答

7.1 传统准备方式的效率瓶颈

很多求职者在准备SwiGLU这类技术面试题时,只能靠零散地搜博客、翻论文、记笔记。缺乏系统性的针对性练习,特别是无法在模拟面试中自然回答出公式推导和对比分析。同时,简历中如何突出对激活函数的理解也是一个痛点。

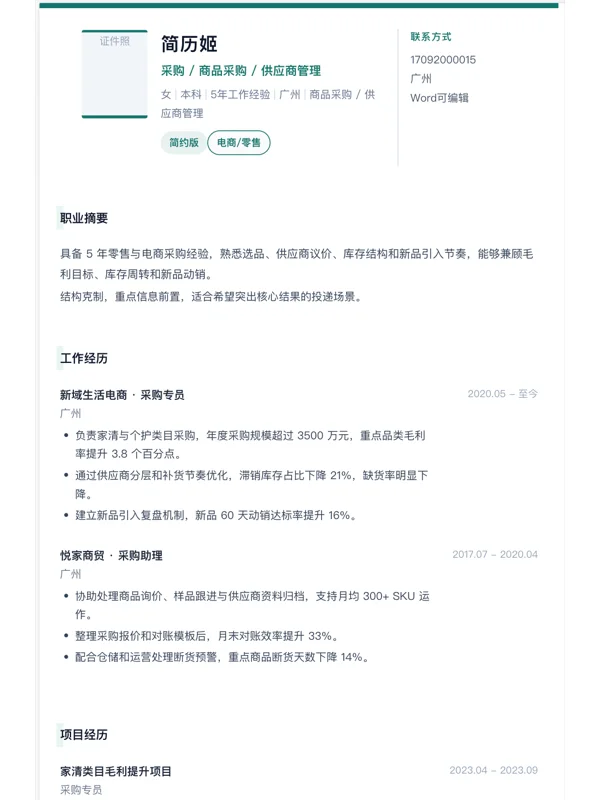

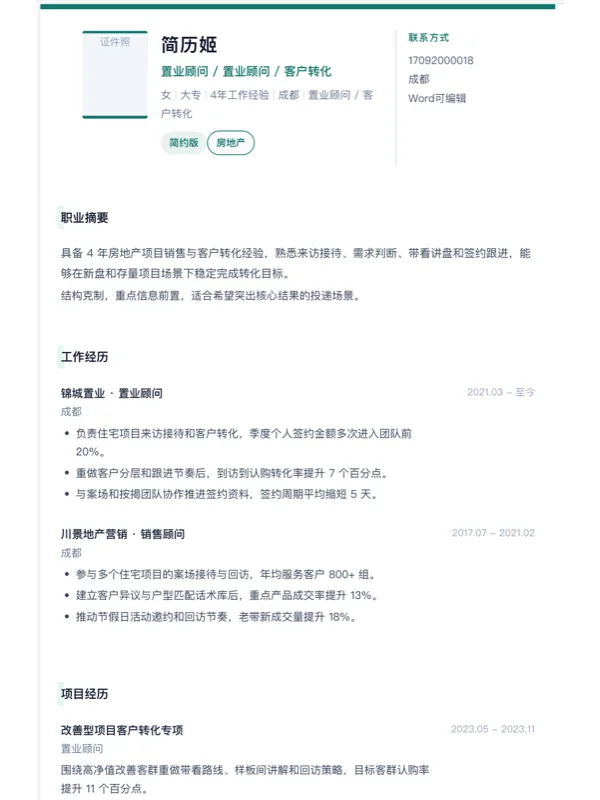

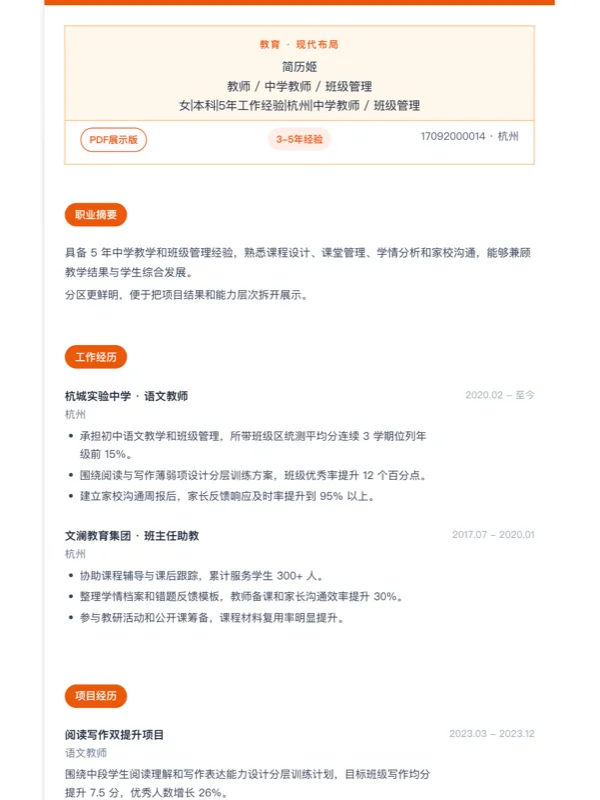

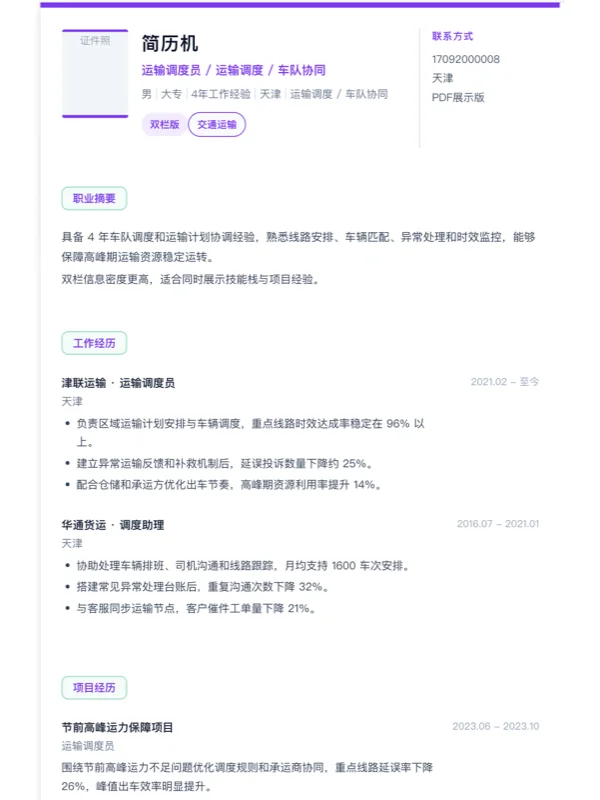

7.2 AI简历姬的模拟面试功能如何帮你突破

AI简历姬不只是一款简历优化工具,它的“模拟面试”模块可以基于你的简历和目标岗位,自动生成包含技术问题的模拟问答。例如,你可以在简历中写上“熟悉LLaMA中的SwiGLU实现”,然后AI会针对这一条追问你:“请详细解释SwiGLU的公式和为什么LLaMA选择它。”整个过程接近真实面试,帮你查漏补缺。

7.3 从理解到表达的高效闭环

通过AI简历姬的面试辅助,你可以先学习知识卡片(内置常见技术问题的标准回答框架),然后进行语音模拟回答,系统会对你的回答进行反馈(如是否包含公式、是否对比了其他激活函数)。这种“输入-输出-反馈”的学习方式,比单纯看书效率提升明显。而且,所有记录可复盘,确保面试前覆盖所有关键点。

八、不同岗位对SwiGLU理解的侧重点

8.1 算法研究员:侧重理论动机与论文比较

你需要能比较SwiGLU与其他门控变体(如GeGLU、GLU variants),说明在什么条件下选择SwiGLU。还会涉及训练稳定性、消融实验等。

8.2 工程/推理优化工程师:侧重实现与性能

关心实现细节:如何融合计算、量化后精度损失多大、CUDA kernel如何优化。面试中可能会让你手写一个高效的SwiGLU kernel(仅伪代码)。

8.3 应用开发/调参工程师:侧重实际效果与权衡

你需要知道SwiGLU在中等规模模型上的收益是否显著,以及如何根据资源限制选择合适的中间维度。重点不是推导,而是应用经验。

九、自检清单:面试前你该掌握的SwiGLU知识点

9.1 知识扫盲清单

| 检查项 | 是否掌握 | 备注 |

|---|---|---|

| 写出SwiGLU完整公式 | ☐ | 含两个线性变换和门控 |

| 手绘计算图 | ☐ | 从输入到输出 |

| 计算参数量与标准FFN比较 | ☐ | 会用降维因子 |

| 说出Swish比Sigmoid优势 | ☐ | 梯度特性 |

| 清楚SwiGLU首次提出论文 | ☐ | PaLM |

| 对比SwiGLU与ReLU/GELU | ☐ | 至少三个维度 |

| 能写出PyTorch代码 | ☐ | 无bug |

| 了解LLaMA中具体实现(维度等) | ☐ |

9.2 表达流畅度检查

用手机录音模拟回答以下问题:“Please explain SwiGLU and why it is used in LLMs.” 回听是否自然,公式是否说错,是否遗漏关键点。

9.3 实战练习建议

在AI简历姬中创建一份目标为“大模型算法工程师”的简历,填写相关项目经验,然后用模拟面试功能选择“激活函数与Transformer”主题,进行3次模拟问答,改正错误后记录最佳版本。

十、常见误区与长期学习建议

10.1 误区一:认为SwiGLU就是Swish+GLU的简单叠加

事实是,SwiGLU是门控结构使用Swish作为激活函数,而GLU使用sigmoid。两者在数学上虽有形式上的相似,但门控信号的性质完全不同。

10.2 误区二:只背公式,不理解动机

很多候选人能写出公式,但被问到“为什么不用GELU?”时答不上来。答案在于门控机制提供了额外自由度,而Swish的门控梯度更好。

10.3 长期学习路径

- 阅读PaLM、LLaMA论文中关于FFN的章节。

- 关注后续论文如GeGLU、SwiGLU变体。

- 动手实现一个完整Transformer,并用不同激活函数对比收敛曲线。

- 在AI简历姬的知识库中记录笔记,形成自己的面试素材库。

十一、激活函数与门控机制的未来趋势

11.1 从手工设计到自动化搜索

未来可能通过NAS自动找到更优的门控变体,但SwiGLU作为基准仍会持续使用。

11.2 硬件适配的激活函数设计

针对GPU/TPU的硬件特性,设计更少访存的激活函数(如矩阵乘法+门控融合),SwiGLU已经在这方面有优势(一次计算两个线性层)。

11.3 稀疏与量化友好的门控

为降低推理成本,门控信号可能被二值化或近似,但需要保证精度。SwiGLU可能被轻量级变体取代,但核心思想不变。

十二、总结:拿下SwiGLU面试题的关键三步

12.1 第一步:深度理解公式与原理

本文已经帮你拆解了公式和动机,但你还应该自己动手推导梯度,并尝试用不同的中间维度做实验。

12.2 第二步:构建标准回答框架

记住“动机→公式→对比→实现→效果”这个链路,在面试中自然展开。使用第四节和第五节的框架即可。

12.3 第三步:借助工具反复练习

自己一个人很难发现回答中的逻辑漏洞。你可以先用AI简历姬生成一个包含SwiGLU描述的项目经历,然后利用它的模拟面试功能进行多轮练习,并复盘录音中的不足。将简历、面试、复盘闭环,你会发现准备技术面试其实可以更从容。

如果你希望更快完成简历优化和面试模拟,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:SwiGLU的公式和GLU公式有什么区别?

回答:GLU公式为 (xW₁+b₁)⊗σ(xW₂+b₂),门控使用sigmoid。SwiGLU使用Swish作为门控,即Swish(x)=xσ(x)。区别在于门控函数:sigmoid输出(0,1),容易饱和;Swish输出可负且非单调,梯度更健康。因此SwiGLU在深层模型中训练更稳定,效果更好。注意SwiGLU中的两个线性变换权重是独立的。

问题2:面试官问SwiGLU如何减少参数量?

回答:标准FFN有2个权重矩阵(升维和降维),中间维度一般设为4d。SwiGLU FFN需要3个权重,但通过设置中间维度为8d/3(例如LLaMA使用约2.67d),总参数量与标准FFN几乎持平。例如d=512时,标准FFN参数约25122048=2.1M,SwiGLU FFN参数约3512(8*512/3)=2.1M。这样既获得门控好处,又不增加过多计算量。

问题3:AI工具在准备SwiGLU面试题中到底能帮什么?

回答:AI工具(如AI简历姬)主要有三个帮助:一是将你对激活函数的理解结构化地写入简历项目描述中,提高简历筛选通过率;二是通过模拟面试功能生成定制化技术问题,让你针对性地回答;三是对回答进行录音和分析,指出遗漏点。相比自己背题,这种互动式学习能更快建立表达信心。

问题4:目标用户做SwiGLU面试准备时应该注意什么?

回答:首先不要只记公式,要理解为什么门控在大模型中有效。其次要准备好对比表格,面试官常会问“与GELU有何不同”。最后要练习手写简单代码,面试中可能要求写伪代码。如果能结合一个实际项目(如你优化过模型的FFN层)来谈,会更有说服力。推荐使用AI简历姬的项目描述模块,用STAR法则将你的经验表述清楚,这样面试时可以直接引用。