如果只说结论,没有残差连接的深度神经网络将难以训练,梯度消失或梯度爆炸会让几十层以上的网络几乎无法收敛,模型性能不仅不会随着深度增加而提升,反而可能比浅层网络更差。对正在准备AI大模型面试的求职者来说,理解这个结论背后的机制,比背一道面试题答案更重要。下面从原理、区别、面试技巧、工具提效等角度系统展开,帮你把这个知识点真正内化为自己的竞争力。

一、残差连接是什么?为什么它是深度学习的基石?

1.1 残差连接的起源与基本形式

残差连接(Residual Connection)最早由何恺明等人在2015年提出的ResNet中引入,核心思想是在网络层中增加一个“捷径”(shortcut),让输入直接绕过若干层加到输出上。数学形式为 $y = F(x) + x$,其中$F(x)$是要学习的残差映射。这种设计让网络可以轻松学习恒等映射,从而支持极深的网络结构(如ResNet-152)。

1.2 残差连接解决了什么问题?

在深度网络中,梯度反向传播时逐层衰减,层数越深,靠近输入层的梯度越小,导致权重几乎不更新,即梯度消失。同时,某些情况梯度也可能爆炸。残差连接提供了一个“梯度高速通道”,让梯度可以直接流向浅层,有效缓解这两个问题。

1.3 为什么说它是“基石”?

从ResNet开始,几乎所有现代深度神经网络——包括Transformer、BERT、GPT系列、ViT等——都采用了残差连接或其变体(如Pre-Norm残差)。没有它,我们可能无法训练出超过几十层的有效模型,大模型(LLM)的“大”也就无从谈起。

二、没有残差连接,深度网络会遇到哪些核心问题?

2.1 梯度消失/爆炸导致训练失败

在没有残差连接的纯前馈网络中,梯度随层数指数级减小或增大。例如,100层的网络,若每层梯度衰减0.9,最终梯度接近0.9^100≈0.000027,几乎为零。训练无法收敛,loss居高不下。

2.2 模型性能随深度饱和甚至退化

实验表明(如ResNet原文的对比),没有残差连接的plain网络,层数增加后训练误差和测试误差反而上升,而非下降。这不是过拟合,而是优化困难导致的退化(degradation)问题。残差连接通过恒等映射让深层网络至少不差于浅层网络。

2.3 深层网络的表达能力受限

理论上,深层网络应能表示更复杂的函数。但如果没有残差连接,优化器很难找到有效解,实际表达能力大打折扣。Transformer中的自注意力层叠加同样依赖残差连接来保持信息流动。

| 问题类型 | 具体表现 | 对模型的影响 | 残差连接的缓解方式 |

|---|---|---|---|

| 梯度消失 | 浅层权重几乎不更新 | 网络无法学习底层特征 | 梯度通过捷径反向传播 |

| 梯度爆炸 | 权重更新过大,参数发散 | 训练不稳定,loss NaN | 捷径本身不放大梯度,配合BN更稳定 |

| 退化问题 | 深层网络性能不如浅层 | 增加层数无意义 | 恒等映射保证深层至少不差 |

三、残差连接与普通连接的关键区别

3.1 信息路径不同

普通连接的信息逐层传递,每层都会对输入进行非线性变换;残差连接增加了一条信息高速公路,输入可以绕过一层或多层直接加到后面。

3.2 梯度流动特性不同

在普通网络中,梯度必须逐一通过每个非线性层,衰减严重;残差网络中,梯度可以通过捷径直达浅层,保持较大的幅度。

3.3 对网络深度容忍度不同

普通网络通常最多二三十层就很难训练;残差网络可以轻松扩展到上百层甚至千层(如ResNet-1001)。

| 特性 | 普通连接 | 残差连接 |

|---|---|---|

| 信息路径 | 串联 | 串联+并联捷径 |

| 梯度传输 | 逐层衰减 | 直通捷径,大幅保留 |

| 最大有效深度 | ~20层 | 1000+层 |

| 典型代表 | VGG(19层) | ResNet(152层) |

四、理解残差连接的核心原则:恒等映射与梯度流动

4.1 恒等映射的价值

残差连接让网络可以“跳过”不必要的层,学习到恒等映射 $y=x$。当某些层不需要时,网络可以将其权重置零,不影响整体表现。这种柔性使得深度网络更容易优化。

4.2 梯度流动的“高速公路”

假设每层的梯度衰减因子为 $\alpha$,经过n层后梯度为 $\alpha^n$。有了残差连接,梯度可以抄近路,衰减降为 $\alpha$ 甚至更少(如果跳过中间层)。这就是深层网络仍能训练的核心原因。

4.3 设计残差块的常见变体

- 原始ResNet块:$y = F(x) + x$

- Pre-Norm残差:$y = x + F(Norm(x))$(Transformer常用)

- 瓶颈残差:先用1x1降维,再3x3,再用1x1恢复维度(减少参数量)

- 带Dropout的残差:在$F(x)$中加入Dropout防止过拟合

五、在面试中如何回答“没有残差连接会怎样”?

5.1 先点明核心结论

回答的第一句话应该直接给出判断:没有残差连接,深层网络将无法有效训练,梯度消失/爆炸会导致模型性能退化。

5.2 从梯度角度解释原因

接着解释梯度传播机制:层数增加后,连乘效应使得梯度指数级缩小或放大。残差连接通过捷径保持梯度幅度,是保证深层网络可训的关键。

5.3 引用经典实验结果

可以举例:ResNet论文中对比了34层plain网络和ResNet,plain网络训练误差更高,而ResNet表现更好。这证明了退化问题的存在以及残差连接的有效性。

5.4 延伸到大模型中的应用

如果可以,进一步说明Transformer解码器、GPT系列、BERT等现代模型都依赖残差连接,如果去掉,这些大模型将无法训练到数百层深度。

六、面试中常见的误区与避坑技巧

6.1 误区:残差连接只解决梯度消失

实际上,它也应对了梯度爆炸(通过捷径不放大梯度)和退化问题。回答时要全面。

6.2 误区:残差连接等同于ResNet

残差连接是一种组件,ResNet是使用该组件的网络。很多模型(如DenseNet、Transformer)也用了残差连接但不同架构。

6.3 误区:认为层数越深,残差连接越不重要

恰恰相反,层数越深,残差连接越重要。没有它,超深层网络根本无法实现。

| 常见误区 | 正确理解 | 面试扣分点说明 |

|---|---|---|

| 只提梯度消失 | 还涉及梯度爆炸和退化 | 不全面,缺乏深度 |

| 把残差连接=ResNet | 残差连接是通用组件 | 概念混淆 |

| 认为浅层不需要残差 | 浅层也受益于梯度传递 | 理解不够本质 |

七、利用AI工具高效准备面试题

7.1 传统方式:自己查资料、记笔记、画图

很多求职者花大量时间刷论文、看博客、整理笔记。这种方式效率低,容易遗漏关键点,而且难以将知识点串联成系统回答。

7.2 AI工具如何提效

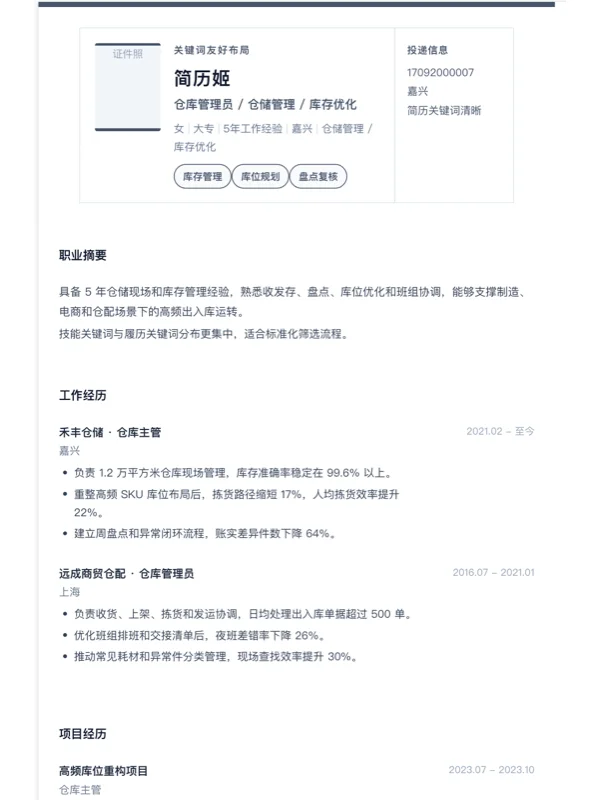

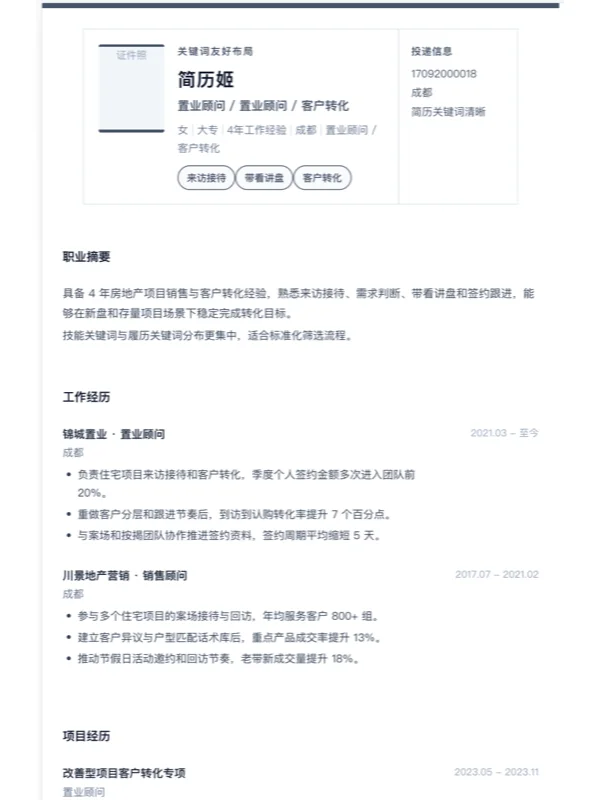

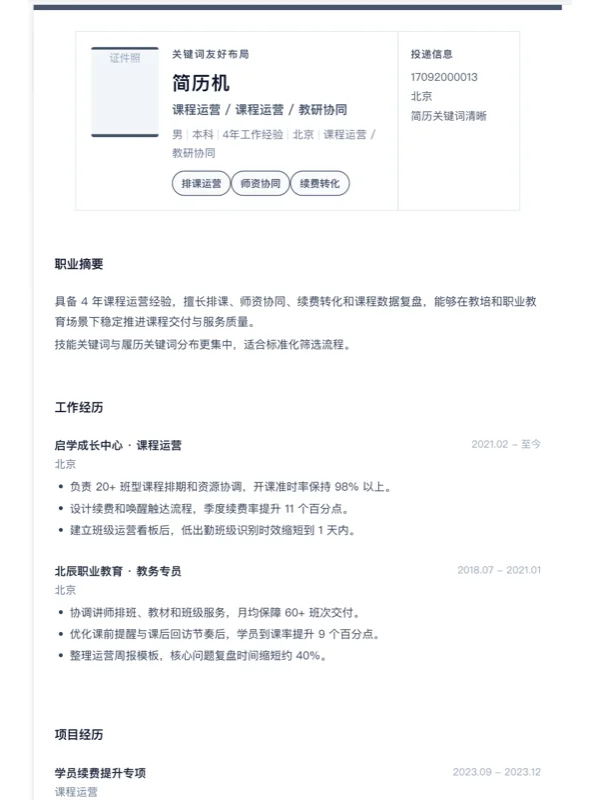

现在可以用AI简历姬这类求职工作台来辅助面试准备。它不仅能帮你优化简历,还能基于你的简历和目标岗位生成定制面试题,包括类似“没有残差连接会怎样”这样的技术题,并提供参考回答思路和追问。例如,你只需在AI简历姬中导入自己的技能清单(如熟悉PyTorch、了解ResNet),系统会结合目标岗位生成一个技术面试问题集,每个问题附有核心要点和回答建议。

7.3 AI简历姬在技术面试准备中的落地

- 简历分析:自动提取你的技术栈,识别薄弱点(比如简历里写了“了解注意力机制”,但没提到残差连接,系统会建议补充相关项目)。

- 模拟面试:基于“简历+岗位”生成追问,比如你的项目里用了Transformer,会被追问“为什么Transformer需要残差连接?”

- 反馈优化:模拟后给出回答质量评估,指出遗漏点,帮助你迭代回答逻辑。

通过这种方式,你可以把碎片化的知识整合成连贯的回答,节省大量时间,同时提升面试通过率。

八、不同岗位对残差连接理解的侧重

8.1 算法岗:原理深度优先

需要从数学公式、梯度推导、论文依据等角度深入解释,并能够讨论变体(如Pre-Norm、Post-Norm)的优劣。

8.2 工程岗:实现与调优优先

更关心实际部署中残差连接对显存占用、计算速度的影响,以及如何用框架API正确实现(如PyTorch的nn.Module)。

8.3 研究岗:前沿进展与改进

研究者需要了解最新的残差变体(如ReZero、SkipInit),以及在Transformer、扩散模型中的应用创新。

| 岗位类型 | 面试重点 | 追问方向示例 |

|---|---|---|

| 算法工程师 | 原理、梯度、变体 | “推导带残差的BP公式” |

| 深度学习工程 | 实现、效率、框架 | “如何用TensorRT优化残差块?” |

| 研究科学家 | 前沿、改进、实验 | “ReZero与标准残差谁更好?” |

九、如何评估自己对残差连接的掌握程度?

9.1 检查清单(Checklist)

- 能用一句话说清残差连接的核心作用

- 能画出带残差连接的计算图并写出前向/反向公式

- 能解释为什么ResNet可以训练到152层而VGG不能

- 能列举至少两种残差变体及其区别

- 能说明Transformer中残差连接的位置和作用

9.2 自我模拟面试

用AI简历姬的模拟面试功能,输入问题“没有残差连接会怎样”,然后录音回答,再对比标准答案。如果回答时间超过2分钟且覆盖了梯度消失、退化、恒等映射等要点,说明掌握较好。

9.3 常见扣分点自查

| 扣分点 | 示例 | 如何改进 |

|---|---|---|

| 只答了梯度消失 | “残差连接解决了梯度消失” | 补充退化问题和梯度爆炸 |

| 未联系实际模型 | “就是添加一个跳连” | 举例ResNet和Transformer |

| 没有展开机制 | “就是残差块” | 解释恒等映射和梯度通道 |

十、从面试题到模型设计:残差连接的持续优化

10.1 优化方向1:减少计算开销

标准残差块有两层3x3卷积,参数量大。瓶颈残差用1x1+3x3+1x1,参数量减少,网络可以更深。

10.2 优化方向2:改善梯度流动

Pre-Norm残差(先Layer Normalization再计算F(x))在Transformer中被证明更稳定,使得训练百层以上Transformer成为可能。

10.3 优化方向3:自适应残差权重

像Highway Networks和SE-ResNet给残差通路加上门控,让网络自动学习是否使用残差。这些改进进一步提升了深层网络的表达能力。

十一、残差连接及相关技术未来的趋势与建议

11.1 趋势一:残差连接与大模型原生设计

随着大模型(GPT-4、Llama 3)规模扩大,残差连接成为标配。未来可能出现更高效的残差变体,例如在稀疏训练中减少计算冗余。

11.2 趋势二:无残差连接的新探索

有些研究尝试用深度可分离卷积或规范化技术(如Fixup初始化)替代残差连接,但尚未成为主流。理解残差连接依然是理解现代网络的基础。

11.3 趋势三:面试考察的深化

面试题从“知道残差连接”转向“理解为什么需要残差连接”以及“在特定场景下如何改进”。准备时应注重原理推导和实验分析。

十二、总结:掌握残差连接,面试与建模都更稳

回答“没有残差连接会怎样”这道题,关键在于从梯度流动、退化问题、恒等映射三个维度给出完整解释,并结合经典实验和现代模型(ResNet、Transformer)进行验证。如果能在回答中展现你对变体和大模型应用的理解,会让面试官看到你的系统思考能力。

准备这类技术面试题时,除了看书和论文,你还可以借助AI简历姬这类工具,通过模拟面试和知识诊断来查漏补缺。它能把“投递—面试—复盘”做成闭环,帮助你更有针对性地提升。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:没有残差连接,为什么ResNet就训练不了?

回答:没有残差连接,ResNet只是一个深层plain网络。由于梯度连乘衰减,34层以上的网络训练时梯度会消失,即使使用Batch Normalization也无法完全避免。ResNet原文实验显示,34层plain网络比18层plain网络误差更大,而同样深度的ResNet误差更小。因此,残差连接是ResNet能够训练的根本原因。

问题2:面试被问到“没有残差连接会怎样”,应该先回答什么?

回答:建议先给出核心判断:“没有残差连接,深层神经网络将无法有效训练,会出现梯度消失/爆炸以及退化问题。”然后分别解释这两个问题发生的机制,最后引用ResNet或Transformer的例子证明。这种“结论+机制+例证”的结构最清晰。

问题3:除了ResNet,还有哪些模型依赖残差连接?

回答:几乎所有现代Transformer类模型都依赖残差连接,例如BERT、GPT系列、ViT、Swin Transformer等。此外,DenseNet使用了密集的拼接式连接,也可以看作残差连接的变体。如果去掉残差连接,这些模型的深度(通常12~100+层)将无法训练。

问题4:作为应届生,如何快速掌握残差连接这类面试高频知识点?

回答:第一步,看原始论文(ResNet的Deep Residual Learning),理解原理和实验。第二步,用代码实现一个简易ResNet,观察不同层数的训练情况。第三步,用AI简历姬的模拟面试功能自测,每次回答后记录遗漏点。反复几次,就能形成完整知识体系。