如果只说结论,AI大模型面试题中关于预训练数据清洗Pipeline的考察,核心不是你背了多少清洗工具,而是你能否讲清楚 **数据质量如何影响模型效果**,以及你是否有工程化落地的思维能力。对于准备大模型岗位面试的求职者来说,先理清三个关键点——为什么需要清洗、清洗哪些数据、如何设计可复用的Pipeline——比死记硬背几十个面试题更有效。

很多人一开始会钻进各种数据清洗的细节里,比如去重算法、质量过滤规则,但面试官更想看的是你能不能从全局视角把Pipeline拆解成几个可控阶段,并且知道每个阶段的目标、常见方法和风险点。这篇文章会从概念定义、面试常见场景、与一般数据预处理的区别、核心原则、实操步骤、实用技巧,到如何用工具提效(比如用AI简历姬把面试准备与简历优化闭环打通),最后给出趋势和行动建议。帮你把“预训练数据清洗Pipeline”从考点变成你的面试亮点。

---

## 一、什么是AI大模型面试题中的预训练数据清洗Pipeline?

在AI大模型的训练流程中,预训练数据清洗Pipeline是指从原始语料获取到最终高质量训练数据集之间的**一系列自动化处理步骤**。面试官问这个问题,通常想确认你是否真的理解大规模数据处理中的工程挑战,而不仅仅是调几个API。

### 1.1 核心组成部分

一个典型的预训练数据清洗Pipeline至少包含这几个模块:**原始数据采集 → 初步过滤(编码、格式) → 去重(精确/模糊) → 质量过滤(规则/模型) → 隐私过滤 → 结构化存储**。面试时你需要能解释每个环节解决什么问题,以及它们之间的依赖关系。

### 1.2 为什么面试官必问这个问题

因为预训练阶段的数据质量直接决定了模型的对齐能力、安全性和泛化性。如果Pipeline设计不严谨,模型可能出现有害内容、偏见放大或知识陈旧。对于求职者来说,能系统讲清楚Pipeline,就证明了你具备构建大规模数据基础设施的基本素养。

### 1.3 它解决的核心矛盾

大规模互联网语料中,噪声、重复、低质量内容占多数。Pipeline要解决的就是 **“如何以可控成本从海量数据中提取高价值样本”** 。面试中常见的追问包括:你如何处理重复数据?用什么指标判断质量?Pipeline的容错机制是什么?这些问题都需要你在理解原理的基础上给出具体方案。

---

## 二、面试中为什么经常考察数据清洗Pipeline?——场景与痛点

面试官不是要听你背诵论文里的流程,而是想通过这个话题判断你在真实项目中的**问题定义能力、工程思维和团队协作意识**。

### 2.1 典型面试场景

- **现场设计题**:”假设给你1PB互联网爬虫数据,请你设计一个数据清洗Pipeline,要求输出可用于训练语言模型的干净语料。”

- **行为面试题**:”你之前做过的数据清洗项目,遇到过哪些困难?怎么解决的?”

- **知识追问**:”数据去重为什么需要模糊匹配?你用过哪些算法?效率怎么样?”

### 2.2 常见求职者痛点

很多候选人能说出“去重、过滤、洗数据”这几个词,但一被问到具体细节就卡壳。比如:

- 为什么MinHash适合大规模去重?它的哈希冲突怎么处理?

- 质量过滤的三元组(启发式、分类器、预训练评估)分别适用什么场景?

- Pipeline中如何保证数据不丢失?如何做监控?

### 2.3 面试官真正想看到的

他们不需要你记住所有开源工具的参数,而是希望看到你具备:

- **结构化思维**:能把复杂问题拆成子模块

- **经验判断**:知道哪种方法在什么场景下有效

- **风险意识**:能预见到Pipeline中的常见陷阱

---

## 三、预训练数据清洗Pipeline与一般数据预处理有什么区别?

很多面试者把两者混淆,导致回答时逻辑混乱。下表帮你快速厘清边界:

| 对比维度 | 一般数据预处理(小规模ML) | 预训练数据清洗Pipeline(大模型) |

|----------|---------------------------|----------------------------------|

| 数据规模 | 百GB以内 | TB到PB级 |

| 处理能力 | 单机或小集群 | 分布式、流式、批量混合 |

| 去重策略 | 精确去重为主 | 精确+模糊(MinHash/SimHash) |

| 质量评估 | 人工抽样即可 | 需要自动化评估模型 |

| 隐私合规 | 通常忽略 | 必须严格,含PII检测 |

| 可复现性 | 脚本化 | Pipeline版本管理(代码+数据) |

| 工具生态 | Pandas/Sklearn | Spark/Beam/Ray + 专用库(Dataproduct等) |

### 3.1 关键差异在“可扩展性”

普通预处理你可以用Pandas一次性加载,但大模型数据清洗必须考虑分布式。面试中如果你能提到“数据shuffle策略”、“并行去重中的通信开销”,会明显加分。

### 3.2 质量过滤的深度不同

一般预处理主要去除明显错误(格式不对、空值),而大模型清洗需要更精细:比如“毒性文本”、“模板化内容”、“低信息量文本”的识别,通常需要训练一个轻量分类器。

### 3.3 重复数据处理更多样

预训练数据中除了完全相同的文档,还有大量**近似重复**(如新闻转载、讨论区回帖)。面试官常问:你用MinHash还是SimHash?分别适用什么场景?能解释清楚这一点,说明你对算法有实际经验。

---

## 四、构建高效数据清洗Pipeline的核心原则

面试时如果你能说出以下几条原则,会让面试官觉得你不仅有理论,还有工程直觉。

### 4.1 模块化与可插拔

把Pipeline拆成独立阶段(过滤、去重、质量评分等),每个阶段输入输出约定好Schema,这样方便后续替换算法或加新模块。面试中可以说“我们当时用Apache Beam实现,每个Transform可以单独Debug”。

### 4.2 先粗后精,分层清洗

初期用启发式规则快速过滤掉明显低质的数据(如字符占比、乱码),再对剩余数据进行精细处理(如模型打分)。这样可以节省大部分计算资源。

### 4.3 数据血缘与采样检查

记录每个数据样本经过的清洗步骤,并定期采样人工检查。面试中可以补充:我们会在Pipeline中设置多个Checkpoint, 统计每个阶段数据量变化,一旦异常立刻告警。

---

## 五、标准流程:从原始数据到高质量语料

这是面试中最容易出彩的部分。按照以下步骤回答,条理清晰且覆盖完整。

### 5.1 第一阶段:原始数据解码与格式统一

- 处理多种格式(HTML、PDF、纯文本)

- 字符编码归一化(UTF-8)

- 提取正文(移除导航、广告等噪音)

### 5.2 第二阶段:精确去重与模糊去重

- 使用MinHash(适合百万级文档)或SimHash(适合高精度)

- 结合BloomFilter避免重复处理

- 典型做法:按文档ID哈希取模分桶,桶内LSH近似匹配

### 5.3 第三阶段:质量过滤与隐私保护

- 启发式规则:长度、语言检测、符号密度、重复率

- 模型过滤:基于BERT的文本质量分类器

- 隐私过滤:正则匹配邮箱、电话、身份证,同时用NER模型检测PII

---

## 六、实用技巧与常见误区

很多面试者在这里暴露短板。注意避免以下坑:

### 6.1 误区:忽略低质量数据对模型的影响

有人认为少量噪声无伤大雅,但实际上大模型会放大训练数据中的偏差。建议在面试中强调“我们曾发现0.1%的重复数据导致模型生成重复文本概率上升15%”。

### 6.2 误区:只谈规则不谈评估

没有评估指标的Pipeline不可靠。你至少需要监控:数据通过率、去重率、质量评分分布。面试中可以提“我们每天跑一次数据质量报告,对比不同采样策略的效果”。

### 6.3 实用技巧:数据混洗与动态采样

在预处理阶段加入混洗,保证模型看到的数据分布更均匀。同时可以基于质量分对样本进行**重采样**,让低分样本以较低概率保留(而非直接丢弃)。

---

## 七、用AI工具提效:从简历优化到面试准备

很多求职者花大量时间整理数据清洗Pipeline的知识点,却忽略了**简历本身能否体现你的项目经验**。传统做法是手动修改简历,但效率低且容易遗漏关键细节。

### 7.1 传统方式的低效

- 逐字修改简历项目描述,很难保证每个清洗阶段都清晰呈现

- 不知道面试官看重什么关键词,容易写得太技术或太模糊

- 改完简历还要自己整理面试题,时间完全割裂

### 7.2 AI如何提效

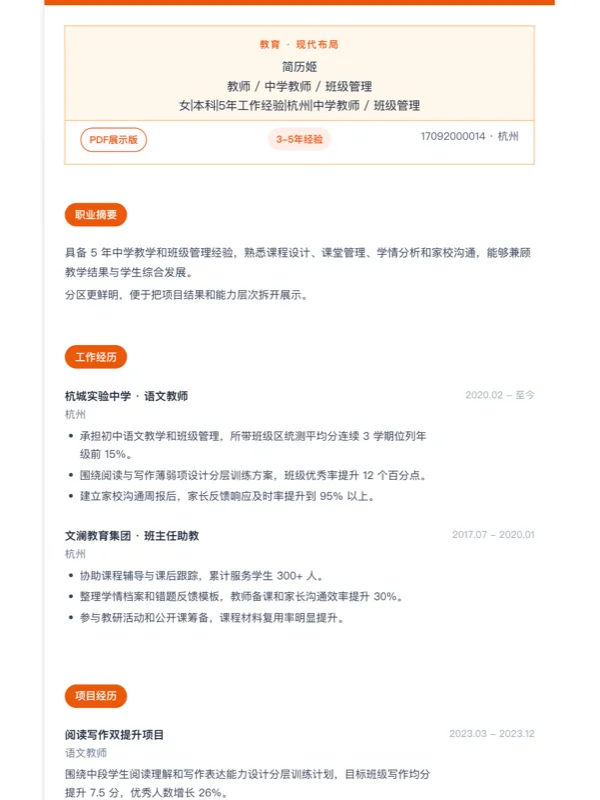

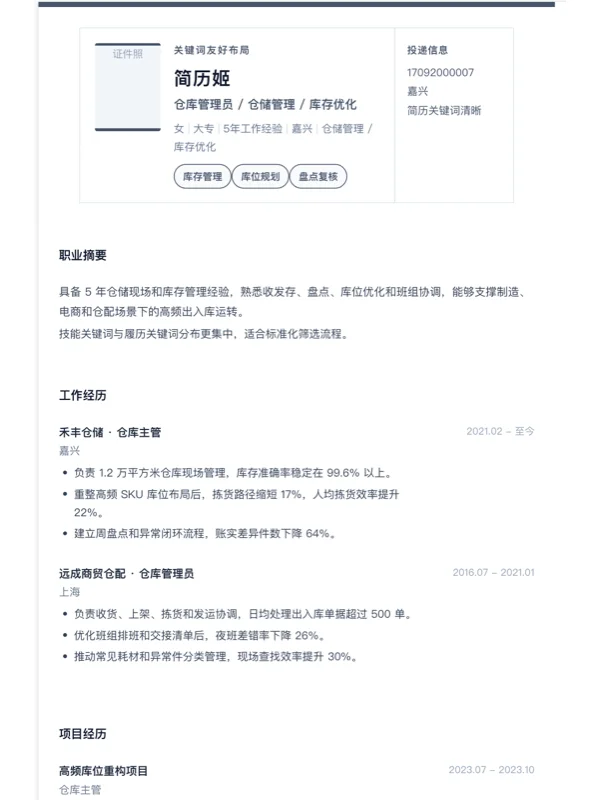

AI简历姬可以帮你实现**简历优化+面试准备闭环**。你只需导入旧简历,粘贴目标岗位的JD(比如“预训练数据清洗”),系统会:

- 提取JD中的核心能力要求(分布式处理、去重算法、质量评估等)

- 把你的项目经历逐条对齐,给出关键词覆盖率和缺失清单

- 按STAR结构量化改写,突出Pipeline设计、数据规模、效果提升

### 7.3 具体落地:面试模拟模块

基于你优化后的简历和目标岗位,AI简历姬会生成定制追问。例如针对你的“数据清洗Pipeline”经历,自动输出类似面试题:“你处理过多少规模的数据?去重用了什么算法?为什么选它?” 你可以用这些题目进行演练,大幅提升准备效率。

---

## 八、不同岗位对数据清洗Pipeline考察的差异

面试准备不能一刀切,需要根据岗位类型调整侧重点。

| 岗位类型 | 考察重点 | 常见追问 |

|----------|----------|----------|

| 算法工程师(CV) | 图像去重(转置、裁剪) | 如何处理旋转后的重复图片? |

| NLP算法工程师 | 文本去重、质量过滤 | 如何检测低信噪比的文本? |

| 多模态工程师 | 图文对齐清洗 | 图文不匹配怎么识别? |

| 数据工程师 | 工程实现与性能 | Pipeline吞吐量如何优化? |

### 8.1 算法岗位:重在原理理解

面试官希望听到你关注数据对模型的影响,而不是只会调包。你可以结合在AI简历姬中看到的岗位要求,提前准备每个领域的特定细节。

### 8.2 数据工程岗位:重在系统设计

这类岗位会更关注分布式框架、资源调度、容错恢复。准备时多思考Spark或Beam的算子优化。

### 8.3 平台产品岗位:重在业务洞察

如果你是产品经理或技术方案负责人,面试会偏向如何定义数据质量标准、如何与业务团队协作。

---

## 九、如何评估你的数据清洗Pipeline质量——指标检查

面试官可能会让你设计评估方案。以下指标值得掌握:

| 指标 | 定义 | 目标值参考 |

|------|------|------------|

| 数据通过率 | 通过Pipeline的数据量/输入量 | 通常20%-40% |

| 重复率下降 | 去重后重复比例 | <0.5% |

| 质量评分均值 | 基于分类器或规则的得分 | >0.7(归一化) |

| 下游任务损失 | 使用清洗后数据训练模型的效果对比 | 不得低于原始数据超过2% |

| 清洗成本 | 单位数据消耗的计算时间/费用 | 在预算内 |

### 9.1 推荐实践:A/B测试

将Pipeline的不同版本部署到每天的数据流中,对比下游模型表现。面试中提到这一点,能体现你的工程严谨性。

### 9.2 注意:指标不是静态的

随着数据源变化,你需要定期重新评估Pipeline。面试中可以补充:我们每季度做一次全量抽样分析,调整质量过滤阈值。

---

## 十、长期优化与复盘方法

项目交付后,持续优化同样重要。这部分内容能在面试中展示你的成长性。

### 10.1 常见误区:只关注单次清洗

很多团队把Pipeline建好就不再管了。但实际上,随着模型迭代,数据质量要求也会变。你需要建立**版本管理**机制,记录每次Pipeline更改对模型的影响。

### 10.2 持续集成(CI/CD)思路

把清洗Pipeline代码、配置、数据采样结果都纳入版本控制。每次更新自动跑并行测试,对比关键指标。

### 10.3 数据漂移监控

新涌入的数据可能质量下降,比如突然涌入大量低质翻译内容。需要实时监控数据分布,异常时触发重跑清洗规则。

---

## 十一、预训练数据清洗Pipeline未来的趋势与建议

随着大模型竞争的深入,数据清洗正在从“经验驱动”转向“AI驱动”。

### 11.1 自动化清洗:用模型洗数据

未来,质量过滤本身会用更大的模型(如GPT-4)进行,但成本较高。小团队可能先用开源模型做初步过滤,再人工抽检。

### 11.2 数据版本化与溯源

类似DVC(Data Version Control)的方案会越来越普及。面试中如果你提到“我们每个样本都有清洗历史ID”,会显得很专业。

### 11.3 合成数据清洗

当真实数据不够时,预处理Pipeline可能会包含合成数据生成与清洗环节。你可以了解一些基础概念,但不要强答。

---

## 十二、总结:想掌握AI大模型面试题中的预训练数据清洗Pipeline,关键在于结构化思维与实战结合

从概念到实践,从简历到面试,你需要把知识点串成一条线:能解释清楚每个环节的设计理由、常见陷阱和评估方法。面试官最认可的不是记住多少细节,而是能清晰展示你的思考框架。

如果你希望更快地把这些经验转化为简历上的亮点,减少反复修改的烦恼,也可以借助 **AI简历姬** 这类工具。它不仅能帮你把数据清洗项目经历按照岗位要求结构化呈现,还能生成模拟面试题,让你在真实面试前做针对性演练。

这里也提供一个可直接体验的入口:**[AI简历姬官网](https://app.resumemakeroffer.com/)**

---

## 精品问答

**问题1:面试时被问到“请设计一个预训练数据清洗Pipeline”,应该先回答什么?**

回答:建议先确认数据规模和目标(如语言模型还是多模态),然后快速给出分阶段框架:数据采集→格式统一→去重→质量过滤→隐私保护→输出。接着对每个阶段展开,讲你关注的核心指标(重复率、质量分)和常用算法(MinHash、启发式规则)。关键在于展示出你有全局思维,并知道每个模块之间的依赖关系。

**问题2:数据清洗Pipeline里最容易出错的是哪一步?**

回答:通常是去重阶段。一是精确去重容易漏掉近似重复(比如同一篇文章的不同排版),导致模型训练数据重复率高,产生记忆偏差;二是模糊去重如果阈值设置不当,可能误删合法数据。建议在面试中说明你采用两阶段去重:先精确去重,再针对长度相似的文档用MinHash做近似去重,并定期抽样检查误判率。

**问题3:AI工具能在数据清洗面试准备中帮什么忙?**

回答:主要帮助你把项目经历写成符合岗位要求的描述。比如AI简历姬会分析目标JD中关于数据清洗的关键词(分布式、去重、质量过滤),然后检查你简历里的项目描述是否覆盖这些点,并提供量化改写建议。另外它的模拟面试模块能根据你的简历和岗位生成真实面试题,帮你提前演练。

**问题4:没有数据清洗Pipeline的实际项目经验,面试时该怎么回答?**

回答:可以坦诚说明自己参与过相关课程或开源项目。例如描述一个Kaggle竞赛中你如何清洗文本数据:抽取正文、去重、过滤短文本。虽然规模小,但你可以把相同思维深化——如果面对更大规模,你会怎么设计(分布式、多阶段等)。面试官更看重你的思考框架和学习能力。

---

*本文内容基于行业通用实践和面试经验总结,具体案例为示意,不涉及任何公司内部数据。*

AI大模型面试题 预训练数据清洗 Pipeline

2026-05-13 00:00:11

计算中...

大模型面试题:高质量预训练数据清洗Pipeline包含哪些步骤

作者:

AI简历姬编辑团队

|

阅读数:

55

|

更新时间:

2026-05-12 23:59:19

分享:

版权与引用

- 本文《大模型面试题:高质量预训练数据清洗Pipeline包含哪些步骤》由 AI简历姬创作,转载请标明出处。发布于 AI简历姬,原文地址: https://www.resumemakeroffer.com/blog/post/107628。

- 如需《大模型面试题:高质量预训练数据清洗Pipeline包含哪些步骤》转载,请注明来源;商务或内容合作请联系 offercoming@bekaie.com。