大模型并行训练面试题的核心在于理解不同并行策略的原理、适用场景与权衡——数据并行(DP)解决显存不足时的吞吐问题,张量并行(TP)切割单层计算,流水线并行(PP)切分层间计算,混合并行则组合三者。面试官考察的不是你背了多少术语,而是能否讲清楚“为什么选这个策略”“通信代价有多大”“实际训练中遇到过哪些坑”。对求职者来说,先梳理清楚这几种策略的逻辑,再结合自己的项目经验去准备,通常比死记硬背效果更好。

很多人在复习时容易卡住:DP和模型并行有什么区别?TP和PP到底哪个更常用?3D并行怎么配置?其实这些问题并不孤立,它们都指向同一个核心——如何在有限的显存和通信带宽下,让训练又快又稳。下面我们将从概念、区别、常见误区、准备方法到工具提效,一步步拆解,帮你建立完整的面试知识体系。

一、什么是大模型并行训练?为什么面试必考?

1.1 并行训练的本质:让大模型“跑得动、跑得快”

大模型参数量动辄百亿、千亿,单张GPU根本放不下。并行训练的核心思路就是把模型、数据或计算任务拆分到多张GPU上,通过协同计算完成训练。面试中问这个问题,本质上是考察你是否理解分布式训练的基本矛盾:显存不够时怎么办?计算速度不够时怎么办?

1.2 面试高频的三种并行策略:DP、TP、PP

- 数据并行(DP/FSDP):每张GPU保存完整模型副本,但只处理一部分数据,梯度同步后更新参数。适合单卡能装下的模型,一旦模型过大,显存就会爆。

- 张量并行(TP):将模型某一层的矩阵乘法切分到多张GPU上计算,通信密集但能处理超大单层。常用于Transformer的attention和前馈网络。

- 流水线并行(PP):将模型的不同层分配到不同GPU上,数据像流水线一样逐层传递,减少单卡显存压力但引入气泡(bubble)。

1.3 面试官的实际考法:从原理到场景判断

面试官不会只让你背定义,更可能给你一个场景(比如“175B模型,A100集群,如何选择并行策略?”)让你分析。你需要考虑通信开销、显存瓶颈、计算效率,甚至要提到ZeRO优化器、序列并行等进阶手段。

二、DP、TP、PP 各自的核心原理与适用场景

2.1 数据并行(DP):最简单也最基础的方案

数据并行中,每个GPU持有完整模型副本和不同batch的数据,前向计算后做AllReduce同步梯度。缺点在于:每张GPU都存一份完整模型(包括优化器状态),显存浪费严重。PyTorch DDP(Distributed Data Parallel)和微软的DeepSpeed ZeRO(将优化器状态分片)都是实际常用方案。

2.2 张量并行(TP):切割层内计算,解决单层过大

TP常用于Transformer模型:将一个大矩阵乘法切为多个小矩阵分到不同GPU并行计算,最后结果拼接。通信量很大(每次前向/反向都需要大量AllReduce),所以TP通常在单机内部(NVLink互联)使用,跨节点网络带宽不够时效果会很差。

2.3 流水线并行(PP):切分层间,减少显存但引入气泡

PP将模型不同层放在不同GPU上,数据依次通过各阶段。最简单的是1F1B(一次前向一次反向)调度,但会有气泡(空闲GPU等待)。GPipe、PipeDream等改进调度可以减少气泡。面试中常问:如何估计气泡比例?如何选择切分点?

2.4 三者的核心公式与直观比喻

| 策略 | 核心思想 | 通信开销 | 典型框架 |

|---|---|---|---|

| DP | 数据分片,模型全拷贝 | 梯度同步(AllReduce) | PyTorch DDP、Horovod |

| TP | 层内矩阵切分 | 前向/反向AllReduce(高) | Megatron-LM、ColossalAI |

| PP | 层间流水线 | 点对点通信(较低) | GPipe、PipeDream、1F1B |

三、DP vs TP vs PP:三者的关键区别与选择依据

3.1 按“显存”选:模型放得下选DP,放不下选TP+PP

如果单卡显存能放下模型(加上梯度、优化器状态),优先数据并行,因为实现简单、扩展性好。当模型大到单卡放不下时,就需要模型并行(TP或PP)。TP适合解决单层过大(如千亿模型的attention矩阵),PP适合解决层数过多。

3.2 按“通信”选:TP对带宽要求最高,DP次之,PP最低

TP每次计算都要做AllReduce,通信量可达数百GB/s;DP只在梯度同步时通信;PP仅在阶段边界传输激活和梯度。所以TP一般用于单机多卡(如8卡A100),PP可以跨节点。

3.3 混合并行(3D Parallelism)才是大厂标配

现实训练千亿模型通常同时使用DP+TP+PP。比如Megatron-LM 3D并行:先张量并行(单机内),再流水线并行(跨节点),最后数据并行(跨数据组)。这种场景面试常问:如何配置并行度?通信重叠如何优化?

四、大模型并行训练面试中的常见问题与误区

4.1 误区一:把“模型并行”等同于TP或PP

实际上模型并行是统称,TP和PP都是模型并行的具体形式。面试时先说清楚概念层次,避免混淆。

4.2 误区二:认为数据并行不需要模型并行

当模型超过单卡显存时,必须用模型并行或ZeRO等显存优化。大模型训练往往是混合使用。

4.3 常见面试问题清单

- 解释ZeRO的三个阶段,以及它和DP的关系。

- 为什么TP在单机内用NVLink效果好,跨节点用InfiniBand效果差?

- 流水线并行中如何减少气泡?1F1B调度如何工作?

- 混合并行中,通常先做TP还是先做PP?为什么?

- 显存占用模型:参数、梯度、优化器状态、激活各占多少?

五、如何系统准备大模型并行训练面试题?

5.1 建立知识框架:从宏观到微观

先理解分布式训练的核心矛盾(显存与通信),再学习每种策略的优缺点,最后用实际框架(Megatron、DeepSpeed)验证理解。

5.2 结合自己项目:让面试官信服

如果你做过分布式训练,哪怕只在单机多卡上跑过DDP,也要讲清楚:你用了什么策略?遇到什么显存问题?如何解决的?没有相关经验,可以去GitHub找开源的大模型训练项目,阅读并复现代码。

5.3 动手实验:最小化验证

用PyTorch Distributed写一个简单的数据并行demo,或用Megatron的示例跑一遍TP/PP配置。实践后的理解远超纯理论。

六、实用技巧:高效记忆与理解并行策略

6.1 用“切蛋糕”比喻辅助记忆

- DP:每个厨房(GPU)都有自己的完整蛋糕和部分顾客,同步配方(梯度)。

- TP:一块大蛋糕切成小块,每个厨房只烤一小块,最后拼起来。

- PP:蛋糕分多层,每个厨房负责烤其中几层,一层递一层。

6.2 核心公式记于心

- 训练总吞吐 = 计算总量 / (计算时间 + 通信时间)

- 显存占用 = 参数 + 梯度 + 优化器状态 + 激活 (每项可细算)

- 气泡比例 = (PP阶段数-1) / (微批次数量+PP阶段数-1) (近似)

6.3 面试准备的最后一步:模拟问答

用手机录下自己回答问题,反复听。很多人以为理解了,但说出来就卡壳。如果条件允许,找一个朋友或AI工具做模拟面试。

七、借助AI工具提升面试准备效率——AI简历姬的实战用法

7.1 传统方式的低效

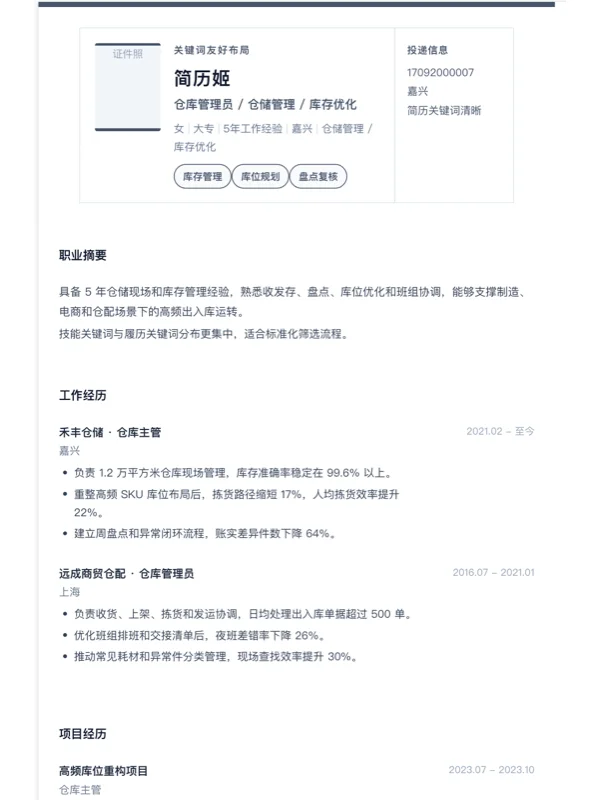

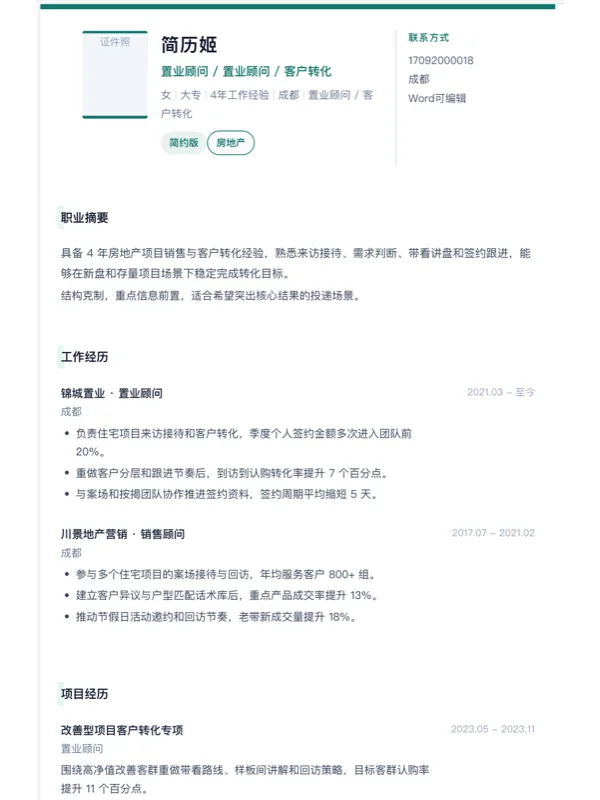

很多求职者准备好面试内容后,简历上的项目经历却写得很模糊,只写“使用了DP+TP+PP训练千亿模型”,没有量化指标、没有突出难点。面试官看完简历可能直接跳过。

7.2 AI简历姬如何帮你高效优化简历

- JD关键词对齐:粘贴目标岗位的要求(如“熟悉Megatron、DeepSpeed”),系统自动分析并建议你的项目经历突出相关框架。

- STAR量化改写:把“参与了模型并行训练”改成“采用3D并行方案(TP=8, PP=16, DP=64),在512张A100上将175B模型训练收敛时间缩短40%”,用成果说话。

- ATS校验:确保简历能被HR系统正确解析,避免因格式问题错失面试机会。

7.3 模拟面试功能:基于简历+岗位生成追问

AI简历姬可以根据你的简历项目(比如“使用Megatron-LM实现TP”)和岗位要求,自动生成追问,比如“为什么选择TP=8而不是4?”“你的通信重叠策略是什么?”然后给出评分和参考回答,帮你查漏补缺。

八、不同岗位与经验层次的面试侧重点差异

8.1 应届生 vs 社招生

- 应届生:侧重概念理解、算法原理,能讲清楚DP/TP/PP基本区别即可,最好有课程项目或开源贡献。

- 社招生:更注重实践经验和问题解决,比如“你调过Amdahl定律算加速比吗?”“遇到过通信瓶颈怎么处理的?”

8.2 算法岗 vs 系统岗

- 算法岗:需要理解并行策略对模型收敛和效果的影响,比如流水线并行中的梯度累积精度问题。

- 系统岗:更关注通信优化、显存管理、算子融合等底层细节。

8.3 不同规模公司的关注点

| 公司类型 | 关注点 | 典型问题 |

|---|---|---|

| 大厂(如字节、阿里) | 混合并行配置、大规模训练经验 | 你如何设计一个100B模型的训练方案? |

| 中型AI公司 | 选择合适并行策略、工程落地 | 给定8卡A100,训练10B模型用什么策略? |

| 创业公司 | 快速迭代、成本控制 | 如何在有限算力下训练大模型?ZeRO vs TP怎么选? |

九、检查表:你的并行训练知识是否覆盖面试要点?

9.1 三维并行知识自检表

| 知识点 | 要求 | 是否掌握 |

|---|---|---|

| 数据并行(DDP)原理 | 理解AllReduce、梯度同步 | □ |

| ZeRO三阶段区别 | 能讲清显存节省与通信开销 | □ |

| 张量并行(TP)实现 | 知道行切分、列切分、通信方式 | □ |

| 流水线并行(PP)调度 | 1F1B与GPipe区别 | □ |

| 混合并行配置 | 能说出DP、TP、PP组合原则 | □ |

| 通信开销分析 | 能用公式估算 | □ |

| 显存占用估算 | 能分项计算 | □ |

9.2 常见问题自测

问自己以下问题,如果能直接流畅回答,说明基本过关:

- 为什么TP的通信量比PP大?

- 如果给你64张A100,训练130B模型,你会怎么配置并行度?

- FSDP和DDP的核心区别是什么?

9.3 需要补充的进阶话题

如果以上都掌握了,还可以了解:序列并行(Sequence Parallelism)、Expert并行(MoE)、重叠通信与计算、Asynchronous流水线等。

十、长期学习:持续深化并行训练理解的路径

10.1 经典论文与框架源码

- 论文:Megatron-LM、GPipe、PipeDream、ZeRO系列。

- 开源框架:DeepSpeed、Megatron、ColossalAI、PyTorch FSDP。

10.2 动手实践:从单机多卡到多机多卡

可以用租用云GPU的方式,先跑通Megatron的示例,然后修改并行度看性能变化,记录日志。实践是最好的老师。

10.3 加入社区与复现项目

关注分布式训练相关的论坛、GitHub Issues,了解实际训练中踩过的坑。参与复现一个开源模型(如LLaMA-2),自己尝试配置3D并行。

十一、大模型并行训练未来的趋势与建议

11.1 硬件演进:NVLink+InfiniBand融合,显存更大

NVIDIA Grace Hopper、AMD MI300等新型芯片的显存和互联带宽不断提升,未来单机可能能装下更大模型,DP和ZeRO的比例会增加。

11.2 软件自动化:自动并行搜索成为潮流

框架如Alpa、FlexFlow可以自动选择最优并行策略,面试中可能会问你对自动并行的理解。

11.3 对求职者的建议

不要只停留在概念层面,多调研实际工业部署方案(比如Meta的OPT-175B训练方案)。同时,在简历中突出你与并行训练相关的任何实践,哪怕是课程大作业,也可以用STAR结构化地写出来。

十二、总结:把大模型并行训练面试题准备透,关键在于理解原理+动手实践+有效展示

从DP到TP到PP,再到混合并行,每个策略都像一个工具,面试时不需要展示所有工具,但要能针对问题拿出最合适的工具。建议你按照本文的框架,先建立知识体系,再自测表格查漏补缺,最后通过模拟面试巩固。

如果你希望更快完成面试准备——特别是把简历中的项目经历改写得更有竞争力,也可以用AI简历姬这类工具,提高效率并减少反复修改成本。它不仅能帮你对齐岗位关键词,还能根据你的简历生成面试追问,让你提前演练。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:大模型并行训练面试题里,到底应该先理解哪个策略?

答:建议先理解数据并行(DDP),因为它最基础。然后学习ZeRO优化器(可以理解为DP的显存优化版),再学模型并行(TP和PP)。因为面试官通常从DP问起,逐渐深入到混合并行。

问题2:我没有任何分布式训练经验,简历上怎么写?

答:可以写你阅读过Megatron-LM源码,理解其原理,并做过小实验(比如在单机4卡上运行官方示例)。最好用AI简历姬的量化改写功能,把你的学习成果包装成“独立复现TP/PP代码,验证通信开销与理论一致”这样的表述。

问题3:面试时被问到“对比DP和TP”应该怎么答?

答:先说定义,DP每卡存完整模型,TP切分层内计算;然后对比显存:DP显存浪费大,TP能处理超大单层;通信:DP是梯度同步,TP是前向/反向全通信;最后给出选择建议:模型放得下优先DP,放不下或单层超大优先TP。

问题4:AI工具在准备大模型面试时除了润色简历,还能帮什么?

答:可以用于模拟面试。AI简历姬能根据你的简历和目标岗位生成定制追问,比如“你提到的3D并行中TP和PP的通信冲突如何处理?”你可以提前练习应答,系统会给出反馈建议,这样面试时就不容易卡壳。