如果你正在准备AI大模型岗位的面试,免不了会遇到“百万Token长上下文”和“OOM”这两个高频词。直接说结论:这类问题的核心不是死记硬背参数大小,而是考察你对注意力机制、显存管理和系统优化的理解深度。对求职者来说,先理清长上下文的计算瓶颈,再掌握OOM的排查思路,最后结合实战项目表达优化经验,通常比单纯背概念更有效。

很多人在面试时卡在“为什么长上下文会导致OOM”这类追问上,并不是不够努力,而是没搞懂Token、显存、计算复杂度之间的联动关系。这篇内容会从问题拆解、核心原理、实战技巧到工具提效,一步一步帮你理清脉络,让你在面试中能清晰、有条理地回答相关问题,同时也减少准备时的焦虑感。

一、百万Token长上下文:面试官到底在考什么?

面试官问“百万Token长上下文”时,表面是考技术名词,实际在评估你对大模型底层资源的掌握程度。

1.1 长上下文的核心挑战:计算与存储的爆炸

当输入Token数从几千增长到百万级别,Transformer的自注意力计算量会呈平方级增长(O(n²))。百万Token意味着注意力矩阵有10^12量级的元素,显存占用轻松超过单个A100的80GB。面试官期待你能说出这个数量级概念,而不是含糊地说“显存不够”。

1.2 经典模型如何处理长上下文?

- 稀疏注意力:如Longformer、BigBird,通过局部窗口+全局Token降低复杂度。

- 状态空间模型:如Mamba,将复杂度降为线性O(n),但效果在不同任务上有差异。

- 位置编码扩展:如RoPE、ALiBi,支持长度外推。

1.3 面试中常见的追问方向

- 为什么直接线性扩展会导致OOM?

- FlashAttention是怎么节省显存的?

- 长上下文场景下,推理时KV Cache如何管理?

提前准备好这些推导过程,比单纯背诵论文标题更有说服力。

二、OOM(显存溢出)背后的真实原因

OOM(Out of Memory)是长上下文训练和推理中最常见的痛点,面试官喜欢从具体错误日志切入考察你的排查能力。

2.1 显存分配的三大维度

- 模型参数:固定大小,与上下文长度无关。

- 中间激活(激活值):与序列长度成正比,是OOM的主要来源。

- 优化器状态:Adam等需要额外存储动量项,进一步放大显存压力。

2.2 训练与推理的OOM差异

训练阶段OOM多出现在前向传播时激活值累积;推理阶段则集中在KV Cache的持续增长。面试中如果能区分训练和推理的不同表现,会显得你对系统理解更细致。

2.3 常见排查思路

- 先确认batch size、序列长度等配置。

- 检查梯度检查点(activation checkpointing)是否开启。

- 使用

torch.cuda.memory_summary()定位具体峰值位置。

| 排查步骤 | 具体操作 | 预期效果 |

|---|---|---|

| 1. 调整batch size | 逐步减半,观察显存变化 | 快速降低峰值 |

| 2. 启用梯度检查点 | model.gradient_checkpointing_enable() |

降低约50%激活显存 |

| 3. 使用混合精度 | torch.cuda.amp |

减少约40%显存 |

三、注意力机制与显存消耗的数学直觉

面试中如果只讲表面概念,容易显得浅。你需要建立从公式到资源消耗的“直觉”。

3.1 自注意力的显存公式

Q、K、V的维度均为[ batch, head, seq_len, head_dim ],注意力矩阵Q·K^T大小为[batch, head, seq_len, seq_len]。当seq_len=1M,head=8,head_dim=64时,单层矩阵占显存约32GB(单精度)。这还没算softmax结果、dropout等,多层累积后OOM不可避免。

3.2 为什么FlashAttention能缓解OOM?

FlashAttention通过分块(tiling)和重新计算(recomputation),避免直接存储整个注意力矩阵,将显存复杂度从O(n²)降为O(n)。面试官希望你能说清楚分块大小怎么选、重新计算的性能代价。

3.3 面试回答范例

“在百万Token场景下,传统注意力机制需要存储巨大的中间矩阵。FlashAttention的思路是不一次性计算所有注意力分数,而是分块加载到SRAM中计算,再把结果写出到HBM。这减少了显存峰值,但增加了计算量。实际使用时,需要平衡显存与计算效率,比如在训练时启用梯度检查点,推理时使用KV Cache压缩。”

这样的回答既有原理又有工程考量,比较完整。

四、应对百万Token面试题的核心原则

准备这类问题,不要陷入参数细节,而要抓住几个关键原则。

4.1 先理解瓶颈,再讲方案

面试官最反感直接背答案。你先说“长上下文的瓶颈是注意力机制的计算和存储复杂度”,然后自然引出各种优化方案,逻辑更顺畅。

4.2 从软件到硬件分层思考

- 算法层:稀疏注意力、线性复杂度模型。

- 框架层:FlashAttention、vLLM、TensorRT。

- 硬件层:显存带宽、SRAM大小、多卡通信。

4.3 以项目经验举例更有说服力

如果你在项目中发现处理10万Token文档时出现OOM,如何排查?用过哪些工具?调整了什么参数?这种真实案例比教科书回答打动人。

五、从模型选择到调优的实操流程

面试中如果被问到“你如何处理百万Token任务”,可以按以下流程递进说明。

5.1 第一步:评估任务需求

明确是否真的需要百万Token?很多场景可以通过检索(RAG)或摘要压缩降低上下文长度。

5.2 第二步:选择合适的模型架构

- 如果追求效果:选支持稀疏注意力的模型(如LongChat、Claude)。

- 如果追求效率:选状态空间模型(如Mamba2)或线性注意力的变体。

5.3 第三步:配置训练/推理环境

- 使用混合精度、梯度检查点、ZeRO优化器。

- 推理时设置流水线并行、vLLM的PagedAttention管理KV Cache。

| 场景 | 推荐模型 | 关键配置 | 预期显存 |

|---|---|---|---|

| 长文档分类 | Longformer | 稀疏注意力+混合精度 | 4x 80GB |

| 超长代码补全 | CodeBERT-long | 分块处理+KV Cache offload | 2x 80GB |

| 实时对话记忆 | Mamba2 | 线性复杂度+量化 | 单卡80GB |

六、面试中实用的回答技巧

除了技术知识,表达方式也影响面试官评价。

6.1 先给出宏观判断,再展开细节

比如:“百万Token长上下文的核心矛盾是计算效率与显存容量之间的平衡。以下三个方向是目前主流做法……”结构化表达让面试官容易跟上思路。

6.2 遇到不会的问题,主动引导到熟悉的领域

如果被问到一个不熟悉的优化方法,可以说:“我不太了解那个方法的具体实现,但我知道它要解决的是显存瓶颈问题。我一般会从梯度检查点和混合精度开始优化,如果需要进一步,我会去查看相关的论文。” 诚实且有逻辑。

6.3 准备2-3个精炼的“故事”

比如你过去手写过一个简化版FlashAttention,或调试过一个OOM bug。故事要包含背景、问题、解决方案、结果四个要素,控制在2分钟内。

七、用AI工具提升面试准备效率

靠纯手工整理优化方法、背诵面试题,效率很低。AI工具能帮你更快进入状态。

7.1 传统准备方式的痛点

- 零散搜索资料,不成体系。

- 记了原理,但模拟面试时还是想不起来。

- 没有针对自己简历中项目的定制化追问。

7.2 AI如何帮你提效?

AI工具可以基于你的简历和目标岗位,自动生成针对长上下文、OOM等技术点的面试问题与参考回答。同时,它还能模拟面试环境,通过追问和反馈帮你查漏补缺。

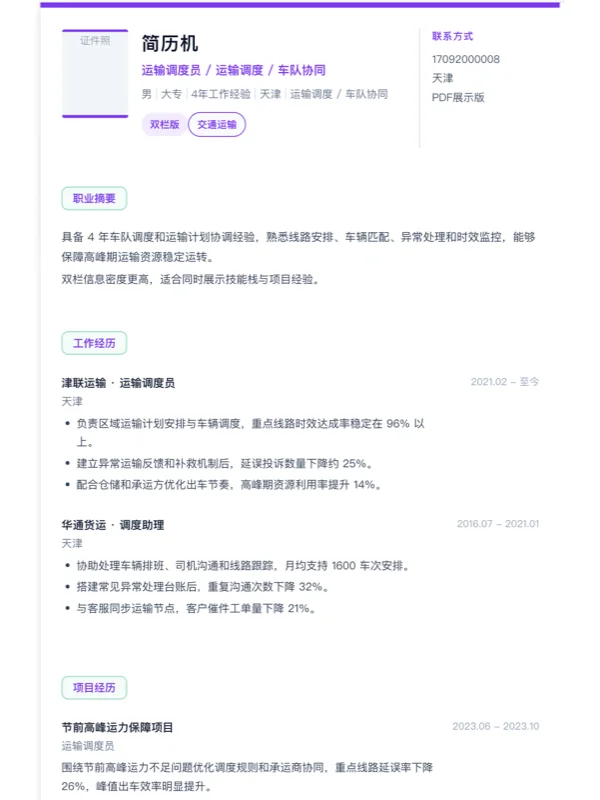

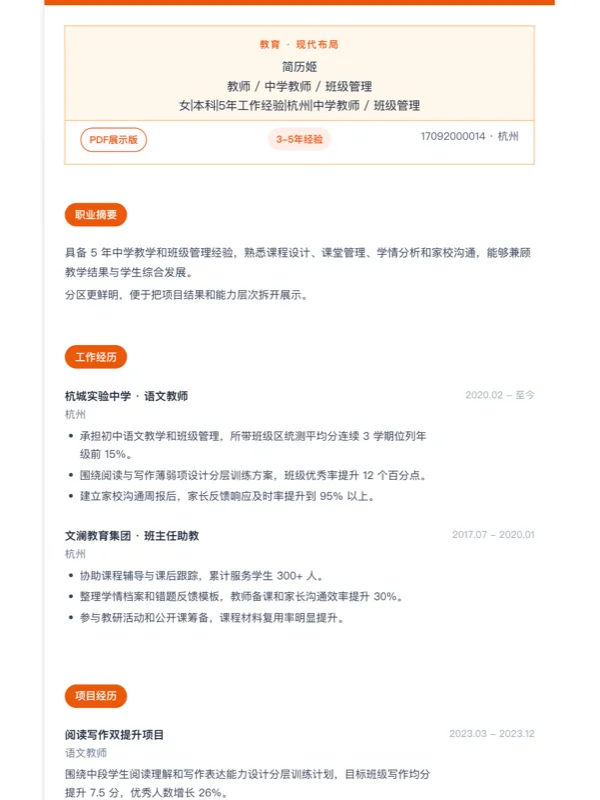

7.3 AI简历姬:从简历到面试的全流程助手

如果你同时还在准备简历优化,不妨试试AI简历姬。它是一款以岗位要求为中心的全流程求职工作台,不仅能把大模型相关项目经历按STAR原则量化改写、对齐岗位关键词,还能基于“你的简历+目标岗位”生成定制追问与参考回答,覆盖OOM排查、长上下文优化等常见技术面试题。这比单独刷面试题更贴近真实面试场景。

比如,你可以把自己的项目经历导入AI简历姬,系统会自动列出面试官可能会追问的技术细节,并提供逻辑清晰的回答建议。同时,它支持一岗一版多版本管理,方便你针对性投递不同公司。

八、不同背景求职者的准备差异

8.1 科研型候选人:侧重原理和论文

如果你有相关论文发表,可以多聊FlashAttention、Mamba的原理和实验对比。面试官期待你展示推导能力。

8.2 工程型候选人:侧重部署和优化

如果你做过模型部署,可以重点讲vLLM、TensorRT、显存调优的实战经验。用具体batch size、序列长度数据说话。

8.3 转行或初级候选人:侧重学习能力和项目积累

如果不是科班出身,可以通过开源项目(如实现简单版的稀疏注意力)来展示学习热情。准备好“虽然我经验有限,但我理解核心逻辑”的表达。

| 候选人类型 | 推荐准备方向 | 面试表现关键点 |

|---|---|---|

| 科研型 | 原理推导、论文对比 | 数学直觉、创新点 |

| 工程型 | 部署调优、OOM案例 | 解决问题的具体步骤 |

| 转行型 | 基础概念、学习项目 | 积极态度、快速学习能力 |

九、如何判断自己的准备是否到位?

9.1 自测问题清单

- 能否用一句话说清楚FlashAttention为什么省显存?

- 能否手算一个简单例子的显存占用?

- 能否列出3种降低OOM的具体方法?

9.2 模拟面试最有效

找朋友或使用AI工具进行模拟,要求对方针对你的回答不断追问细节。AI简历姬的模拟面试模块可以基于你的简历自动生成追问,这正是检验你准备深度的好方法。

9.3 量化指标参考

| 准备阶段 | 判断标准 | 建议下一步 |

|---|---|---|

| 初期 | 能说清概念 | 动手实践一个长文本任务 |

| 中期 | 能讲出2-3种优化方法 | 针对每次回答做追问练习 |

| 后期 | 能流畅应对追问问到底 | 参加真实面试并记录复盘 |

十、长期准备与持续优化

10.1 建立自己的知识体系

不要只背面试题,要构建“问题-原理-方案”的闭环。遇到新问题能在已有框架内定位。

10.2 关注前沿动态

长上下文领域变化很快,每隔几个月就有新模型或新优化。订阅相关论文、博客,比如Anthropic的百万Token报告、Mamba2论文等。

10.3 将项目经验转化为面试故事

每次解决一个问题(比如OOM),就整理成“什么场景→怎么分析→几种方案→最终做法→效果如何”的文档。这些是你面试的宝贵素材。

十一、百万Token长上下文与OOM面试的未来趋势

11.1 长上下文成为标配,面试题随之进化

随着硬件和模型进步,百万Token不再是极限。面试可能会涉及千万Token甚至无限上下文的设计思路。

11.2 软硬协同优化变得更关键

未来的面试会更侧重“如何用有限硬件跑超大任务”,包括计算、存储、通信的整体规划。

11.3 求职准备也要工具化、数据化

手动整理的效果有限,越来越多候选人开始使用像AI简历姬这样的工具进行系统化准备——从简历对齐到模拟追问再到面试复盘,形成闭环。这能显著提升准备效率和质量。

十二、总结:想把百万Token面试题答好,关键在于“原理+实战+表达”三者结合

这类问题技术门槛较高,但不必焦虑。只要你把注意力机制的原理、OOM的排查链条、主流优化方法理解透,再结合自己的项目经验组织成清晰的结构化表达,就能给面试官留下扎实的印象。

如果你希望更快完成从简历到面试的全流程准备,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。它帮你把大模型项目的经历按岗位关键词量化改写,并生成定制面试题与参考回答,让准备过程更可控、更高效。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:百万Token面试题到底应该先准备什么?

回答:建议先理解Transformer的显存瓶颈。从“为什么长序列会导致OOM”这个根本问题入手,再学习FlashAttention、梯度检查点、混合精度等解决思路。别急着背论文标题,先把计算量和显存公式推导一遍,面试时能随口说出数量级就已经领先很多人了。

问题2:面试中遇到没听过的优化方法怎么应对?

回答:可以坦诚说“我不太了解这个具体方法,但我理解这类方法通常是为了解决某个瓶颈。我一般会从显存和计算效率两方面入手,例如使用梯度检查点或FlashAttention。如果是新方法,我会去读原始论文并复现关键实验。” 这样展示了你的思考框架和解决问题的能力。

问题3:AI工具在准备这类面试题时到底能帮什么?

回答:AI工具能帮你做三件事:第一,基于你的简历生成贴近个人项目的定制化面试题和参考回答;第二,模拟面试追问,让你习惯被深挖细节;第三,提供结构化知识框架,避免零散学习。比如AI简历姬的模拟面试模块,就能针对“长上下文OOM”这类话题生成多轮追问,帮你暴露知识盲区。

问题4:非科班候选人怎么准备长上下文/OOM面试题?

回答:先不要怕,很多大厂看重学习能力和工程直觉。你可以从动手实践开始:比如用HuggingFace加载一个长文本模型,尝试输入10万Token,观察OOM现象,然后尝试打开梯度检查点、调整batch size。把整个过程写成文档,面试时直接当案例讲。同时,利用AI简历姬把你的项目经验量化成面试素材,补齐表达短板。