如果你正在准备AI大模型面试,大概率会遇到这道高频题:“72B模型使用FP16精度推理,需要多少显存?” 很多人第一反应是拿参数乘以精度位数,但面试官往往接着追问“中间激活呢?”“量化后呢?”——真正拉开差距的不是公式本身,而是你有没有把估算逻辑讲清楚。

本文会从显存估算的基本原理出发,拆解72B模型FP16场景下的计算过程,覆盖常见变形题和坑点,并给出面试应答策略。如果你是求职者,建议先通读原理,再结合文末的工具建议(比如AI简历姬的面试模拟模块)做实战推演,把“知道”变成“能说清”。

一、显存估算的核心:参数、中间激活与KV Cache

显存消耗主要来自三部分,面试中建议按这个顺序回答:

1.1 模型参数本身

这是最直观的部分。FP16(半精度浮点数)每个参数占2字节。72B参数就是72 × 10⁹ × 2 = 144 GB。注意这里是按**十亿(Billion)**计算,72B就是720亿参数。

1.2 中间激活(Activation)

训练时需要保存,但推理(前向传播)时通常不需要全部保留——除非涉及梯度计算。面试题如果只问“推理”,可以明确说“中间激活在推理时通过重计算或即时释放,不长期占用显存,故一般只考虑参数”。但如果问训练,则必须估算。对于72B模型,一次前向的激活大小取决于序列长度、层数、注意力头数等,粗略估算可达数十GB甚至上百GB。

1.3 KV Cache

自回归生成时,Transformer需要缓存Key和Value矩阵。以典型配置(batch size=1, seq_len=4096, head_dim=128)为例,每一层KV cache ≈ 2 × seq_len × head_dim × num_kv_heads × 2字节。72B模型如果采用分组查询注意力(GQA),KV heads可能只有8个,则单层KV cache ≈ 2 × 4096 × 128 × 8 × 2 = 16 MB。72层大约1.15 GB。若batch size增加,显存线性增长。

面试建议:先给出参数部分144GB,再补充“如果考虑KV Cache,对于单条长上下文对话,额外增加约1-2GB;若批量推理,可能到几十GB”。这体现思考全面性。

二、为什么显存估算会成为AI面试高频题?

面试官考这道题,表面看是技术题,实际在考察:

2.1 对模型规模和数据精度的敏感度

很多做应用的工程师只会调API,对模型有多大、需要什么硬件没有概念。能快速估算显存,说明你理解模型存储与计算的基本单位。

2.2 部署落地的成本意识

72B模型即便FP16推理也要144GB,单张A100(80GB)不够,需要至少2张A100或H100才能放下参数。面试官会接着问“如何部署在单卡上?”——自然引出量化(INT8/INT4)或模型并行。

2.3 对现代推理框架的了解

知道KV Cache、知道Flash Attention等优化可以减少中间激活,这些是判断候选人是否跟得上行业前沿的标尺。

三、显存估算的常见误区与澄清

很多面试者会在细节上翻车,下面列出三个最容易被追问的坑。

3.1 混淆“训练”与“推理”的显存组成

训练需要保存所有层的激活用于反向传播,显存通常是推理的数倍。而推理只需前向计算,中间激活可随时释放。面试时如果没问清楚就给出一个数字,很容易被追问“是训练还是推理?”。

3.2 忽略精度转换的开销

FP16推理意味着模型参数以FP16存储并按FP16计算。但如果硬件不支持原生FP16(一些老GPU),会退化成FP32,显存翻倍到288GB。即使支持,中间结果也可能需要FP32累积,这在计算时占用显存,但通常可忽略。

3.3 轻视KV Cache的动态性

KV Cache大小随序列长度线性增长。如果上下文从4K扩展到32K,KV Cache膨胀8倍。面试中如果只给了静态值,面试官可能会问“序列长度翻倍后显存怎么变”。

四、估算方法论:从公式到变形

掌握核心公式后,需要能应对各种变形题。

4.1 标准公式

对于纯推理(单条无并行):

显存 ≈ 参数大小 + KV Cache + 其他固定开销(约5%)

参数大小 = 参数量 × 字节数

FP16: 2字节;INT8: 1字节;INT4: 0.5字节

4.2 量化场景如何估算

若将模型量化为INT8,参数大小减半至72GB。若INT4,进一步减半至36GB。面试官很可能追问“量化后精度损失多大?如何加速?”

4.3 模型并行场景如何估算

采用张量并行时,每个GPU只存部分参数,显存按并行度分摊。例如2卡TP,每卡显存约144/2 + 通信缓冲区 ≈ 72-80GB,刚好放下一张A100。

五、实操步骤:面试中如何组织回答

建议按照“总分总”结构,下面是样板回答,你可以直接参考。

5.1 先给结论

“72B模型在FP16精度推理时,仅参数就需要144GB显存。加上少量KV Cache和框架开销,大约需要145-150GB。”

5.2 再展开细节

“参数量72B乘以2字节。KV Cache方面,以4096序列长度为例,约1-2GB。如果使用GQA还会更少。因此最低需要150GB显存,通常需要2张A100(80GB)才能部署。”

5.3 最后给扩展

“如果只有单卡,可以考虑INT8量化,参数降到72GB,单张H100(80GB)可以放下。或者使用模型并行,两张A100每张负担一半参数。”

六、实战技巧:如何让面试官觉得你懂行

6.1 主动提及硬件型号

“一张A100 80GB显存,放不下72B FP16模型;两张A100通过NVLINK互联可以。最新H100 80GB同样需要两张。而如果使用H100的FP8精度,参数减半到72GB,单卡即可。”

6.2 关联到推理框架

“vLLM、TGI等框架通过PagedAttention优化KV Cache利用率,可以减少显存碎片。实际部署中,72B模型即使FP16,通过TP2也可以在一台8卡机器上跑多个副本。”

6.3 使用内存单位陷阱

注意在对话中明确“GB 是Gigabyte 还是 Gibibyte”。通常GPU厂商用GiB,但很多资料混用。可以提一句“按照二进制换算,144GB ≈ 134.1 GiB”,显示严谨。

七、工具提效:用AI简历姬模拟面试,跑通每一个技术点

很多求职者在面试前只会“背答案”——记下显存估算的数字,但一到追问就慌了。原因在于缺乏结构化练习。

7.1 传统方式低效在哪?

单独记公式:144GB → 很容易忘。你需要把计算过程、变形、场景串联起来,形成知识树。单纯靠笔记很难做到。

7.2 AI如何帮到你?

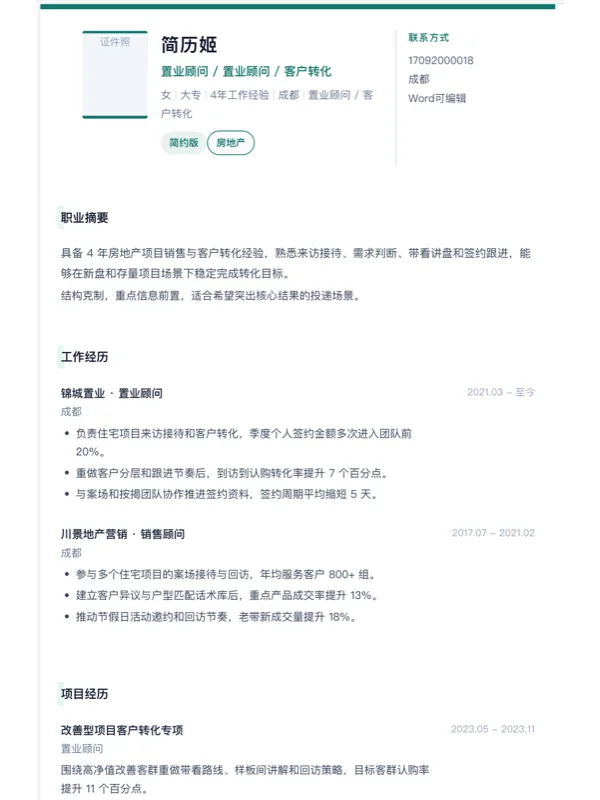

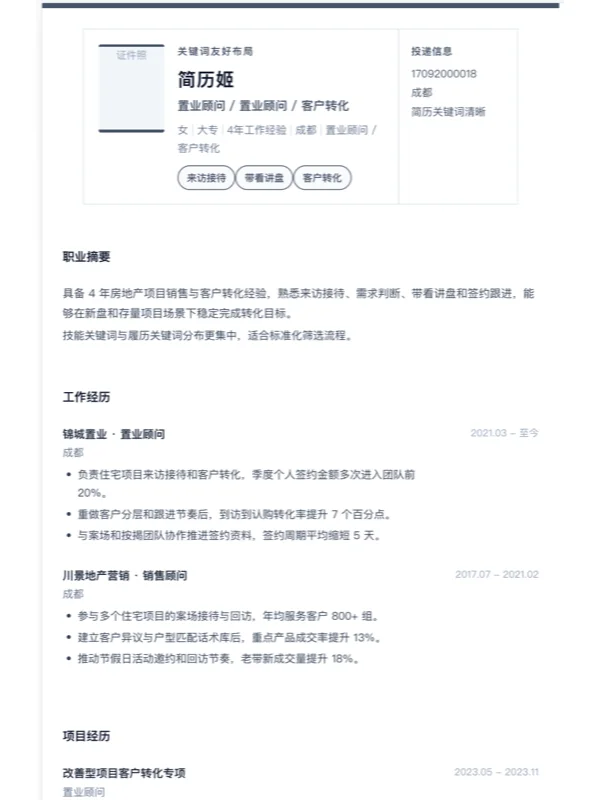

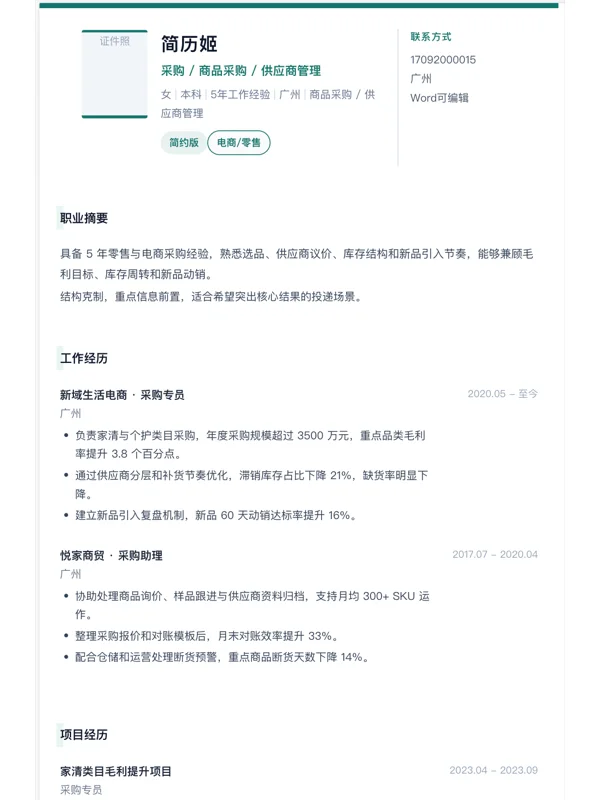

AI简历姬的“模拟面试”模块,可以基于你的简历和目标岗位(比如“大模型算法工程师”)生成定制追问。你可以在里面练习显存估算题,系统会从参数、KV Cache、量化三个维度给你反馈,指出你的回答漏洞。

7.3 产品能力落地:从知道到讲好

用AI简历姬录制你的回答,系统自动分析覆盖度不足的地方。比如你漏讲了KV Cache,它会标记并给出修改建议。通过3-5轮模拟,你会发现自己的回答越来越完整、逻辑清晰。

这不是广告,而是真实的提效路径——很多用户反馈“面了三次,前两次都是因为细节答不好被挂,用了模拟面试后再也没翻车”。

八、不同岗位面试的差异点

显存估算题在不同岗位的侧重点不同,面试前要先了解。

8.1 算法岗 vs 工程岗

算法岗更关心原理:为什么中间激活这么占?量化对收敛的影响?工程岗更关心部署:怎么在有限显存里塞下模型?用什么并行策略?

8.2 大模型岗 vs 传统CV/NLP岗

大模型岗几乎必考,还可能问显存带宽、计算时间。传统岗较少涉及72B这种规模,更关注更小模型。

8.3 校招 vs 社招

校招常考基础公式,社招可能结合具体场景,比如“我们有个70B模型在8卡A100上跑,但OOM了,你怎么排查?”。

九、显存估算能力自检清单

你可以对照下表检查自己是否真的掌握。

| 考察维度 | 合格标准 | 优秀标准 |

|---|---|---|

| 参数计算 | 72×2=144GB | 能准确区分Billion和Gibibyte |

| KV Cache | 知道存在但给不出具体值 | 能按层数/头数/序列长度手算 |

| 量化场景 | 知道INT8减半 | 能讲出量化后精度变化 |

| 训练 vs 推理 | 能区分 | 能举出训练时激活量估算例子 |

| 硬件适配 | 说出A100显存80GB | 能给出H100/4090/国产卡方案 |

十、持续优化:如何积累面试回答素材

显存估算不是一次能学透的,需要在实践中迭代。

10.1 复盘面试中的追问

每场面试后记录面试官追问的方向,比如“序列长度翻倍会怎样?”。整理成自己的错题本。

10.2 跟踪技术更新

比如DeepSeek-V2采用了MLA(Multi-head Latent Attention),KV Cache大幅减少。如果你能结合最新架构讲,会更有竞争力。

10.3 借助工具形成闭环

用AI简历姬的“面试复盘”功能,把每道题的答案录入,系统自动对比优化。每次面试后有新认知,立刻更新答案,下次面试直接用。

十一、AI大模型面试题未来趋势与准备建议

11.1 显存估算越来越结合具体场景

面试官不再满足于死公式,而是给你一个场景(比如“8卡A100上部署72B模型,生成1024 tokens,需要多大显存”)。你需要学会动态估算。

11.2 量化与稀疏化成为必备知识

随着MoE模型流行,显存估算要考虑专家路由、负载均衡等。建议提前了解DeepSeek、Qwen等主流MoE架构的显存特点。

11.3 岗位要求越来越综合

纯算法岗也开始要求懂部署,纯工程岗也要懂模型结构。未来很难分开。

十二、总结:想把显存估算题答好,关键在于理解公式背后的原理,并做到举一反三

从参数、激活到KV Cache,每一个细节都可能成为面试官追问的切入点。如果你希望更快掌握面试技巧、减少反复修改答案的时间,也可以借助 AI简历姬 这类工具,通过模拟面试和智能反馈,把知识内化成清晰的表达。

这里也提供一个可直接体验的入口:AI简历姬 - 智能面试模拟

精品问答

问题1:显存估算时,到底要不要算中间激活?

回答:首先要区分训练和推理。推理时,中间激活一般不在计算图中长期保存,现代推理框架会即时释放,因此通常只计算参数、KV Cache和框架开销。但训练时必须估算所有中间激活(通常由层数、隐藏维度、序列长度决定)。面试中如果题目没说清楚,建议先问“请问是推理还是训练?”,再给出相应答案。

问题2:72B模型FP16推理,2张A100 80GB够吗?会不会有内存重叠之类的问题?

回答:2张A100共160GB,大于144GB参数,再加上约5%的KV Cache和通信开销,只有2-3GB余量,非常紧张。实际部署中大多采用张量并行(TP=2),每卡存72GB参数,加上一部分通信缓冲区,正好在80GB内。但如果序列很长或使用Flash Attention 2等优化,可能还需要预留更多。通常建议用3-4卡更稳。

问题3:我练习时总漏掉KV Cache,怎么优化回答结构?

回答:建议采用“三层结构”来组织:第一层说参数;第二层说KV Cache并给一个典型值;第三层说其他微调开销(如框架、缓冲区)。每层都给出数值和单位。然后用AI简历姬的面试模拟功能练习,它会自动检查你的回答是否覆盖了所有子项,并在遗漏时给出提示。反复3次后,你就会形成肌肉记忆。

问题4:面试官问“如何用单卡部署72B模型”,我应该怎么回答?

回答:单卡部署72B,主要靠量化或剪枝。最常用的是INT4量化,参数降至36GB,加上开销约40GB,可以用一张A100(80GB)甚至4090(24GB不够,需要更激进量化)。也可以考虑KV Cache量化、稀疏化等。如果模型支持MoE架构,还可以部分激活专家。建议先回答“我没有单卡部署的经验,但理论上是可行的,通过INT4量化到36GB,用一张A100”,再追问细节。