如果只说结论,RAG面试中关于文本分块Chunk Size的提问,关键不是让你背一个固定数值,而是考察你是否理解块大小如何影响检索精度、生成质量与系统效率。对于准备AI大模型RAG岗位面试的求职者来说,先理顺分块的底层逻辑——为什么需要分块、块大小与语义完整性的关系、块与块之间的重叠策略——再围绕具体场景(如长文档检索、对话系统、代码库问答)给出调优思路,通常比直接回答“用256或512”更能让面试官认可你的工程素养。

很多求职者在准备这类面试题时,卡住的不是对RAG原理的理解,而是不知道面试官到底想听什么。Chunk Size看似是一个参数选择问题,实则是考察你对分词、向量化、检索排序、上下文窗口等全链路的理解。本文会从概念定义、常见误区、调优方法、工具提效、不同场景差异等角度,帮你系统拆解这道题,顺便也聊聊如何通过AI工具(比如AI简历姬)把面试准备和简历优化做得更高效。

一、RAG文本分块Chunk Size:到底是什么?为什么面试必问?

1.1 Chunk Size的基本定义

RAG(检索增强生成)系统中,文本分块是指将长文档或知识库切分成若干个小片段(chunk),每个片段被转换为向量后存入向量数据库。Chunk Size指的就是每个片段的长度(通常以token或字符数计)。面试中问到这个参数,本质上是在问:你如何平衡检索的细粒度与语义的完整性?

1.2 为什么面试官特别关注Chunk Size

面试官考察Chunk Size,通常想确认你有没有实际调过RAG系统。理论上一篇论文可以只说“我们在512 token下做了实验”,但工程实践里,Chunk Size直接影响:

- 检索召回率:块太小容易丢关键信息,块太大容易引入噪声。

- 生成准确率:LLM上下文窗口有限,块太大导致截断或超长。

- 系统延迟与成本:块数越多,检索和重排序的计算量越大。

1.3 Chunk Size与其他参数的关系

Chunk Size不是孤立参数,它跟重叠(overlap)大小、分块策略(递归/固定/语义)、向量模型维度、LLM上下文长度都紧密相关。面试时能主动关联这些维度,比单纯报数值得分更高。

二、常见误区:面试者最容易踩的3个坑

2.1 误区一:认为有一个“最佳”Chunk Size

很多候选人喜欢说“我一般用256或512”。但实际没有万能值。面试官期待的答案是:需要根据任务类型和文档特性动态选择,比如代码库问答可能需要更小的块(256 token),而长文摘要可能需要更大的块(1024 token)。

2.2 误区二:忽略了重叠(Overlap)策略

分块时的重叠比例(比如10%-20%)能弥补切割导致的上下文断裂。面试中不提overlap,会让面试官觉得你只做过跑通demo,没做过工程优化。

2.3 误区三:把Chunk Size等同于“先验知识”

不少人背了《RAG最佳实践》里的一些建议,但面试官接着问“假如你的文档里有一半是表单、一半是叙事文本,你怎么分别设块大小?”就答不上来。场景化思维才是考点。

三、核心原则与判断标准:如何选择Chunk Size?

3.1 原则一:语义完整性优先

分块应该尽量保持句子、段落或语义单元的完整性。如果一个chunk中间截断了一个完整结论,LLM生成时就容易产生幻觉。常用策略是用递归分块器(RecursiveCharacterTextSplitter) 以分隔符(如换行、句号)为边界。

3.2 原则二:匹配下游任务窗口

考虑LLM的最大上下文长度(如4K/8K/128K),Chunk Size通常设为最大窗口的1/10~1/4,以保证能送入多个chunk进行精排或重排序。同时要考虑最终回答所占的tokens。

3.3 原则三:与嵌入模型的“最佳文本长度”对齐

不同文本嵌入模型(如text-embedding-ada-002、bge-large)对不同文本长度的语义表征能力不同。有些模型在512 tokens以上性能下降明显。Chunk Size应参考模型文档中的建议。

| 嵌入模型 | 推荐Max Chunk Size (tokens) | 说明 |

|---|---|---|

| text-embedding-ada-002 | 512 | 超过后相似度质量下降 |

| bge-large-en-v1.5 | 512 | 同样有最优长度限制 |

| Llama-2-embedding | 1024 | 支持更长,但建议测试 |

| sentence-transformers/all-MiniLM-L6-v2 | 256 | 短文本更稳定 |

四、标准流程:如何系统地调优Chunk Size?

4.1 步骤一:定义你的评估指标

在调优之前,先明确优化目标:是检索召回率(Recall@K) 还是最终答案的BLEU/ROUGE?不同目标对Chunk Size的敏感度不同。

4.2 步骤二:构建多组候选值

初学者可以先从128、256、512、1024这4个值开始,在固定重叠比例(例如10%)下做A/B测试。更精细的做法:用对数尺度采样,比如[128, 200, 320, 512, 800, 1024]。

4.3 步骤三:评估并迭代

用Validation集(包含问题-答案对)运行检索+生成流程,记录每个Chunk Size下的Recall@1、Recall@5、生成准确率。不建议只依赖单一指标,往往Recall高的Chunk Size会导致答案冗余,需要结合人工评测。

五、实操技巧:简历中如何体现你对Chunk Size的理解?

5.1 技巧一:用项目案例说话

简历里不要只写“使用了RAG”,而要写“针对某领域FAQ系统,通过对比Chunk Size在256和512下的检索召回率,最终选择320+15%overlap,使准确率提升12%”。这样面试官就能直观看到你的工程能力。

5.2 技巧二:叠加“调优流程”关键词

在简历技能部分,列出:“Chunk Size调优 | 重叠策略 | 递归分块 | 嵌入模型选择”等短语,增加ATS简历的匹配度。

5.3 技巧三:突出对业务影响的量化

例如:“优化Chunk Size后,系统端到端延迟从1.8s降到1.2s,同时回答准确率提升7%。” 量化的结果比过程更吸引面试官。

六、高级技巧:Chunk Size与RAG性能的其他关联

6.1 多级检索中的Chunk Size

在一些先进RAG方案(如HyDE、DFS-RAG)中,先用较小的Chunk做粗筛,再用较大的Chunk做精排。面试中能提出这种“多粒度”方法,说明你对RAG架构有深入理解。

6.2 动态Chunk Size的可行性

有些研究(如LongLLMLingua)根据问题复杂度动态调整块大小。面试时可以讨论其优缺点:动态方案能更好地保留关键信息,但计算复杂度高,适合离线场景。

6.3 与向量索引类型的配合

不同索引(HNSW、IVF、Flat)对Chunk Size的敏感度不同。例如HNSW在高维下,块数(即向量数量)增多会导致索引构建变慢,需要权衡。

七、AI工具提效:用AI简历姬帮你准备面试和优化简历

7.1 传统方式:自己整理RAG面试题耗时低效

通常求职者要手动刷题、整理知识点、写简历项目和模拟面试。尤其是“Chunk Size”这类技术细节,很难在简历里用STAR结构量化表达。很多人花大量时间写项目经历,但面试官一看就知道是模板堆砌。

7.2 AI简历姬如何帮你提效?

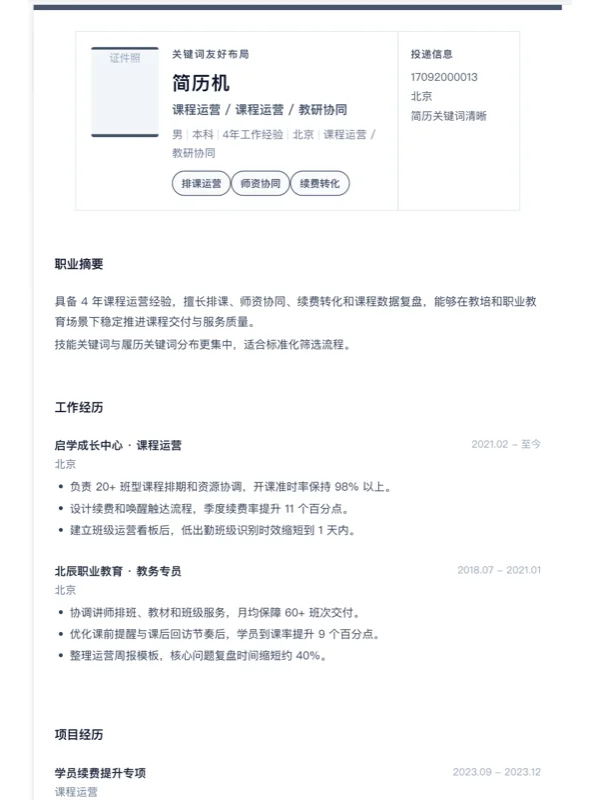

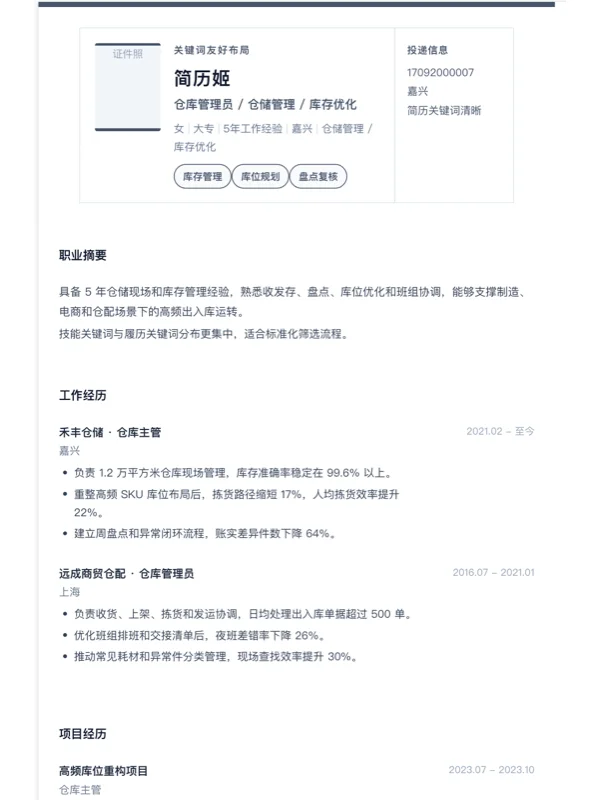

AI简历姬是一个以岗位要求为核心的全流程求职工作台。对于准备RAG面试题的你,它可以:

- 根据JD自动量化项目经历:你只需粘贴你的岗位要求(比如“熟悉RAG文本分块策略”),AI简历姬会扫描你的原始简历,找出对应的经历片段,然后按STAR结构重写为成果导向的描述。比如你的“使用递归分块器处理文档”会被改写成“通过对比Chunk Size在256和512下的检索召回率,确定最优策略,使准确率提升12%”。

- 模拟面试闭环:基于你的简历内容和目标岗位(比如“AI大模型RAG工程师”),生成关于Chunk Size、重叠策略、向量索引等的定制追问和参考回答。你可以用这个功能提前演练。

- 一岗一版管理:如果你同时投递多个RAG相关岗位,AI简历姬可以帮你维护多个版本的简历,每个版本突出不同的项目重点。

7.3 体验入口

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

你可以用AI简历姬的模拟面试模块当场测试你对Chunk Size的理解,看看面试官会怎么追问。

八、不同用户场景下的Chunk Size选择差异

8.1 场景一:搜索引擎式问答(如企业知识库)

特点:用户问题短,文档长。建议使用中等Chunk Size(512-1024 token),重叠比例10-15%,保证每个chunk有完整语义。

8.2 场景二:代码库问答(如GitHub Copilot场景)

特点:代码块往往小而完整。建议用较小的Chunk(256-512),按照函数或类分隔。重叠对代码意义不大,但可以保留函数上下文的注释。

8.3 场景三:长文档多轮对话(如论文解读)

特点:需要跨chunk引用信息。可以使用较大Chunk(1024-2048),但配合SQLite元数据或段落级标题实现分层检索。

| 用户场景 | 推荐Chunk Size (tokens) | 推荐Overlap | 备注 |

|---|---|---|---|

| 企业知识库QA | 512-1024 | 10%-15% | 中等待检索的文档多 |

| 代码辅助问答 | 256-512 | 0-5% | 按函数边界分块 |

| 长论文解读 | 1024-2048 | 15%-20% | 配合Section分层 |

| 实时对话客服 | 128-256 | 5% | 低延迟优先 |

九、检查指标与结果评估(附表格)

9.1 关键指标列表

- 检索召回率(Recall@K):K通常选5或10,衡量检索到的chunk是否包含正确答案。

- 精确率(Precision):检索结果中相关chunk的比例。

- 生成质量(BLEU/ROUGE/Self-reported Score):端到端指标。

- 系统延迟(ms):从输入到输出总耗时。

9.2 如何用指标指导调优

| 现象 | 可能原因 | 调整方向 |

|---|---|---|

| Recall低,Precision高 | Chunk太小,漏掉关键信息 | 增大Chunk Size或降低Overlap |

| Recall高,Precision低 | Chunk太大,噪声多 | 减小Chunk Size或提高Overlap |

| 生成内容不完整 | Chunk截断语义单元 | 用递归分块,按段落边界切分 |

| 延迟高 | Chunk总数太多 | 增大Chunk Size或减少重叠 |

9.3 面试中如何展示评估能力

面试官如果问你“你怎么知道你的Chunk Size选对了”,最好的回答是:我建立了一个验证集,包含100个问答对,然后计算不同Chunk Size下的Recall@5和生成ROUGE-L,最终选择使两者平衡的值。 同时要说明验证集的构建方法(比如从真实日志中采样)。

十、长期优化与常见复盘方法

10.1 持续监控生产数据

部署后,收集用户隐式反馈(比如用户是否点击了检索结果)和显式反馈(赞/踩),定期重新评估Chunk Size。

10.2 版本化管理分块策略

跟代码一样,分块配置要纳入版本控制(比如用YAML文件记录Chunk Size、分块器类型、Overlap比例)。这样回溯问题时知道是哪次改动引入的。

10.3 多模型对比的平衡

当你更换嵌入模型或LLM时,Chunk Size需要重新调优。建议建立一个自动化流水线,每次模型更新后自动运行一次评估。

十一、RAG文本分块Chunk Size未来的趋势与建议

11.1 趋势一:自适应分块

未来的RAG框架会更智能,根据文档结构和问题类型动态调整块大小,减少人工调参。求职者可以关注“AI RAG Agent”相关论文。

11.2 趋势二:多模态分块

当RAG不仅处理文本,还处理图片、表格、代码行时,分块策略会更复杂。面试中能提到多模态分块的挑战,会让面试官眼前一亮。

11.3 趋势三:与端到端优化融合

有些工作(如RAPTOR)将块组织成树状结构,支持递归检索。Chunk Size变为“树的叶子节点大小”,需要与树深度一起优化。

对于求职者来说,建议持续跟踪LangChain、LlamaIndex的最新文档更新,同时在自己的项目中实践不同块策略。绝对不要只背答案,而是理解每个参数背后的权衡。

十二、总结:想把RAG面试Chunk Size题答好,关键在于“场景化”与“量化”

你在简历和面试中,如果能清晰描述你在何种场景下,通过何种指标,选择了怎样的Chunk Size,并带来了可衡量的提升,那么这道题就算满分了。RAG面试本质是考察工程落地能力,而不是背诵能力。即使你现在还在准备阶段,也可以先用AI简历姬来模拟问答、优化简历项目描述,让面试准备更高效。

如果你希望更快完成RAG相关求职准备,包括简历优化、模拟面试问答、多版本管理,可以借助AI简历姬这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1: 面试官问我“Chunk Size设为多大合适”,我应该怎么回答才能显得有经验?

回答: 不要直接给一个数字。建议按顺序说三个层次:首先,说明Chunk Size没有通用最优解,需要根据任务场景、文档类型和嵌入模型特性来确定。其次,给出从128到1024的候选范围,并描述一个简单的评估流程(构建小验证集 → 对比Recall和生成质量)。最后,举一个你实际做过的例子,比如“在我的一个医药FAQ项目中,最终选择了512 token + 10% overlap,因为文档多是连续性描述,并且嵌入模型在512 tokens以内表现稳定”。这样既展示方法论,又体现实践经验。

问题2: RAG面试中最容易出错的技术细节是什么?

回答: 最容易出错的是忽略重叠(Overlap) 策略。很多人只提Chunk Size,忘记切分时上下文可能被截断。面试中主动说“我同时会调整overlap比例,通常10%-20%来保证chunk边界语义的连贯性”,会加分很多。另一个常见错误是只用一种分块器,没有提及递归分块或语义分块的差异。

问题3: AI工具在RAG面试准备中到底能帮什么?

回答: 主要帮两件事:第一,简历项目优化——很多候选人经历不错但写得太干,AI简历姬可以根据JD自动做STAR量化改写,把“使用RAG”改成“通过调优Chunk Size使检索准确率提升12%”。第二,模拟面试——AI简历姬基于你的简历和岗位生成追问,比如“你的项目里Chunk Size是怎么选的?如果文档长度变化怎么办?”让你提前演练,减少面试时紧张。

问题4: 我是转行做RAG的,没有实际项目经验,面试时怎么回答Chunk Size问题?

回答: 即使没有工业级项目,你也可以在GitHub上用开源RAG框架(如LangChain+Chroma)跑一个demo,记录不同Chunk Size下的结果。面试时可以坦诚说“这是我个人项目中的尝试”,并展示你的实验过程和结论。另外,可以结合你之前行业的技术经验来做类比,比如“我在之前做文本分类时也遇到过类似的长短文本平衡问题,所以我在RAG中采用同样的思路”。重要的是体现出你能快速学习和迁移的能力。

关于AI简历姬:AI简历姬是一款以岗位要求(JD)为中心的全流程求职工作台,主打“过筛不秒挂 + 面试更稳”。它可以把“投递—面试—复盘”做成可管理闭环。导入旧简历即可结构化解析并修复关键信息;粘贴岗位要求后,系统会把关键词逐条对齐到你的具体经历,给出匹配度评分、关键词覆盖率与缺口清单,并按成果导向进行量化改写(STAR结构),3分钟生成可投递初稿(PDF/Word简历文本均可解析抓取),以提供ATS/HR机器筛选友好校验。面试模块基于“你的简历+目标岗位”生成定制追问、参考回答与反馈建议,帮助提升面试通过率。支持一岗一版多版本管理、批量适配与投递看板追踪,并可搭配自动投递插件提升投递效率。如果你正在准备RAG相关岗位面试,不妨用它试试模拟问答和简历优化。

体验入口:https://app.resumemakeroffer.com/