如果面试官在RAG(检索增强生成)场景下追问“Embedding分布漂移”,你想在30秒内给出专业回答吗?核心思路是:先点明这是向量表征与检索目标之间的一致性偏差,再分三步——原因(数据分布变化、模型更新、动态环境)、影响(检索质量下降、结果偏移)、应对(定期评估、增量更新、动态阈值)。对准备AI大模型岗位面试的求职者来说,光背概念不够,还要结合项目经历展示解决思路。下面从面试准备角度,系统拆解这个问题,顺便让你的简历和面试回答更扎实。

一、Embedding分布漂移是什么?为什么面试官总问它?

1. 从RAG流程看Embedding的核心作用

RAG(Retrieval-Augmented Generation)是目前大模型应用的主流架构之一。它将用户查询(Query)和文档库中的文本通过Embedding模型转化为向量,然后通过向量相似度检索出最相关的片段,再交给LLM生成答案。Embedding的质量直接决定了检索的精度和生成的内容质量。

2. 分布漂移的定义与常见表现

Embedding分布漂移是指:在RAG系统运行过程中,由于用户查询分布、文档库内容或Embedding模型本身的更新,导致当前查询的向量分布与检索时所用的向量数据库之间的分布发生了系统性偏差。简单说,就是“检索的基准变了”,结果要么找不到,要么找到不相关的。

3. 面试官问这个问题的真实意图

面试官不只想听你背定义,更想考察:

- 你是否理解RAG的在线退化机制

- 你有没有实际遇到过、处理过这类问题

- 你能否给出可落地的监控与缓解方案

二、为什么会发生Embedding分布漂移?典型场景分析

1. 数据分布自然演变(最常见原因)

比如企业内部知识库每周更新,新文档的内容主题和原来不同;或者用户查询随时间改变(如双十一期间查询“优惠政策”频率暴涨)。这些都会导致查询和文档的Embedding分布偏移。

2. Embedding模型版本升级或替换

当你把原来的Sentence-BERT换成更强大的模型(如bge-large-en-v1.5),新旧模型的向量空间不一致,如果不重新索引所有文档,直接检索会出现严重偏移。

3. 多轮对话中的上下文漂移

在对话式RAG中,用户的问题依赖历史上下文,但上下文本身也在变化。如果只使用当前Query进行检索,容易丢失上下文信息,导致Embedding与真实意图偏移。

不同场景对比表

| 场景 | 漂移速度 | 检测难度 | 典型应对方法 |

|---|---|---|---|

| 文档库被动更新 | 慢 | 低 | 定期全量索引或增量更新 |

| 模型版本升级 | 快 | 中 | 新旧模型对齐或重新索引 |

| 对话上下文漂移 | 中 | 高 | 使用上下文压缩+Query重写 |

三、面试高频误区:关于Embedding分布漂移的三个错误理解

1. 误区一:漂移只影响检索精度,不影响生成

实际上,检索质量下降直接导致生成幻觉(hallucination)或答案不相关。面试中要强调漂移对整体RAG效果的连锁影响。

2. 误区二:只要定期更新索引就能解决所有漂移

只更新索引不够,还要考虑查询分布的漂移。如果用户问题类型变了,索引内容没变,检索依然失效。需要同时监测Query Embedding分布。

3. 误区三:漂移是偶发现象,不需要持续监控

正确的做法是建立在线监控指标(如检索命中率、平均相似度、召回率),设置漂移警报,并制定自动缓解策略。

四、应对Embedding分布漂移的核心方法论

1. 监测先行:建立Embedding分布监控系统

- 统计Query Embedding的均值、协方差、聚类中心,与历史分布对比

- 实时计算文档库Embedding的全局统计量(如最大/最小相似度)

- 使用KS检验或MMD距离检测分布差异

2. 缓解策略:主动防御与被动修复

| 策略 | 适用场景 | 实现难度 | 效果持久性 |

|---|---|---|---|

| 动态阈值调整 | Query分布渐变 | 低 | 中等 |

| Query重写/改写 | 上下文漂移 | 中 | 高 |

| 增量索引与重新索引 | 文档库变化 | 高 | 高 |

| Ensemble多模型投票 | 模型版本升级 | 高 | 高 |

3. 测试验证:离线评估不能代替在线观察

离线K折交叉验证只能反映静态分布,无法捕捉动态漂移。面试时可以提到“A/B测试”和“滚动窗口评估”两种在线验证方法。

五、面试回答的实操流程:三步讲清楚

1. 第一步:定义场景,展现系统思维

“我在一个客户服务RAG系统中遇到过这个现象。最开始模型效果很好,但运行两周后用户问题的主题发生了变化,导致检索命中率下降了15%。”

2. 第二步:分析原因,具体化问题

“我分析后发现,新来的用户问题集中在‘退款流程’上,而文档库里这部分内容占比很小,且Embedding分布严重偏离。”

3. 第三步:给出解决措施,体现工程能力

“我采取了三个动作:一是针对新主题补充文档并增量索引;二是对用户Query使用分类模型判断主题,然后动态调整检索策略;三是部署了分布漂移监控,每天检查相似度分布。”

六、实用技巧:怎么答才让面试官印象深刻?

1. 用项目经验替代空泛理论

不要只说“漂移会导致效果下降”,而要举具体数据:“我们监控到平均相似度从0.78下降到0.52,top-1准确率掉了12%。”

2. 展示评估指标意识

主动提到你用“Recall@K”“MRR”“NDCG”来量化漂移影响。可以在简历中对应的项目描述里嵌入这些指标。

3. 提到“成本与效果权衡”

“全量重新索引成本高,我选择每日增量更新 + 每周一次全量重索引的节奏。”

七、AI工具提效:如何用工具快速准备这类面试题

1. 传统准备方式的低效

很多求职者靠零散刷题、背八股文,无法形成系统化答案,更不会把简历中的项目经历与面试题关联。

2. AI工具如何帮助梳理与模拟

借助AI面试助手,你可以:

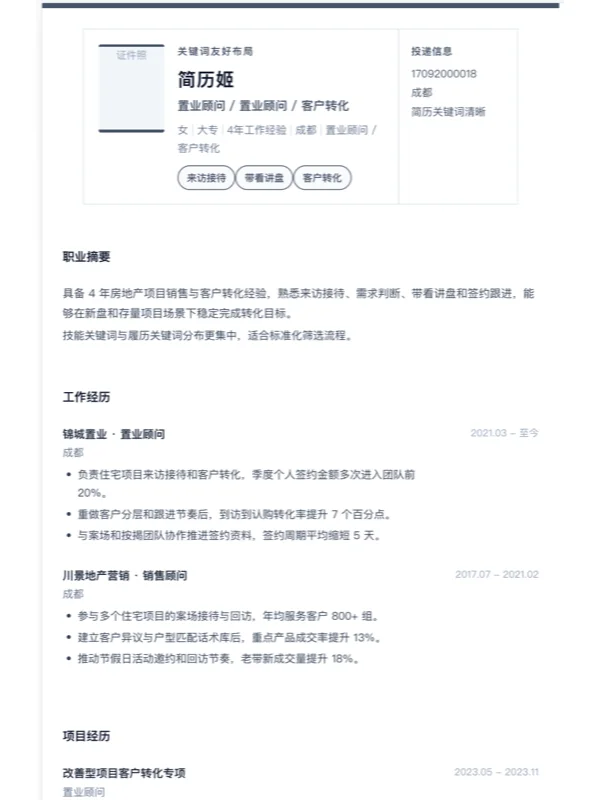

- 导入你的简历(包含RAG相关项目经历),自动提取技术关键词

- 根据目标岗位JD,生成定制化追问,包括Embedding分布漂移这类进阶问题

- 通过模拟面试获得参考回答和优化建议

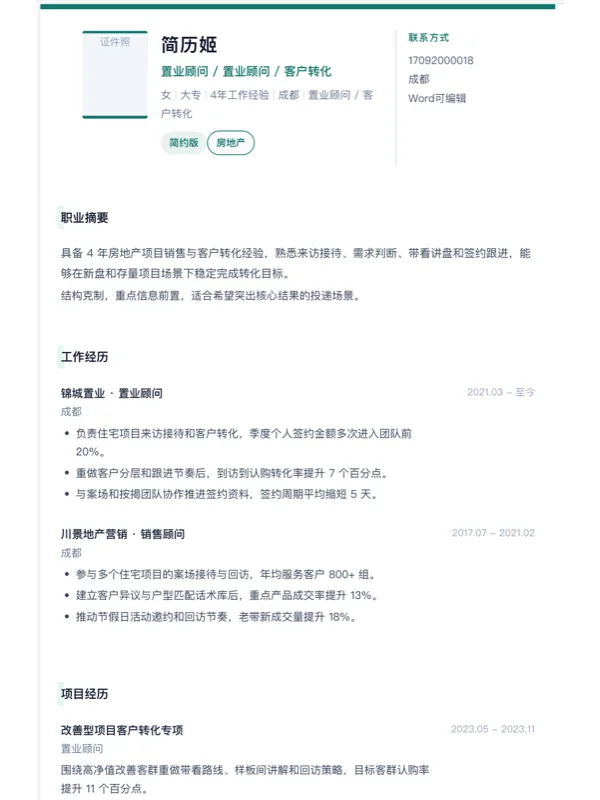

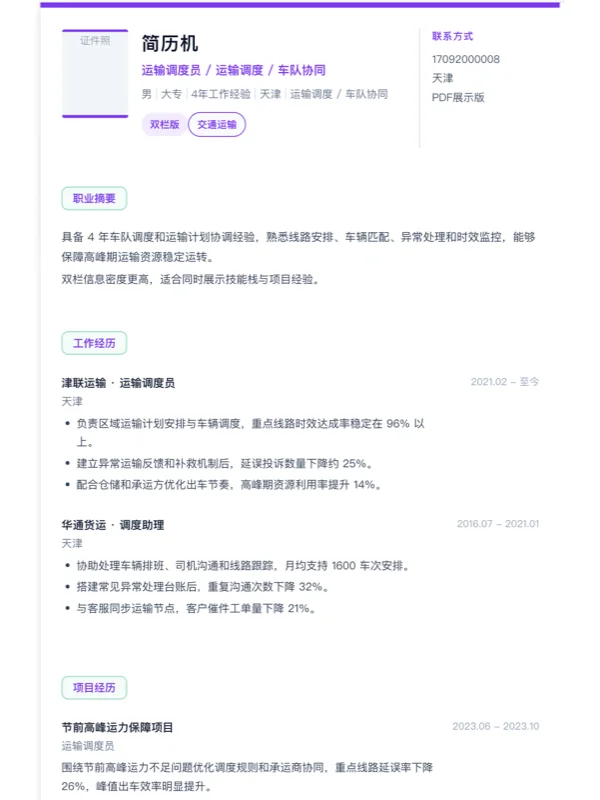

3. AI简历姬的实战价值

AI简历姬不仅帮你把简历改得更ATS友好、量化业绩,还内置了面试模块。以“模拟面试”功能为例:

- 基于你的简历项目和目标岗位,自动生成追问

- 你回答后提供评分和参考答案

- 支持将面试知识点反向补充到简历中,形成“简历→面试→简历改进”闭环

如果你想在面试前系统梳理RAG相关原理并练习回答,可直接在AI简历姬的“面试准备”中粘贴岗位JD,它就会帮你生成一份包含Embedding分布漂移等高频问题的面试清单。

八、不同求职者的差异化准备重点

1. 应届生/转行者:重点是理解原理与表达逻辑

建议先掌握漂移的数学定义(如分布变化量),然后用一个简单比喻讲清楚,再配合开放数据做一个简单分析实验。

2. 有1-3年经验者:强调解决思路与团队贡献

突出你如何发现漂移、推动监控建设、或者通过策略调整提升了多少检索指标。

3. 高级/架构师:关注系统设计与长期稳定性

除了具体方案,还要讲清楚监控优先级、成本控制、以及如何设计自愈机制。

用户类型准备差异表

| 用户类型 | 重点深度 | 加分项 | 简历写法建议 |

|---|---|---|---|

| 新人 | 原理清晰、动手实验 | 公开数据集分析作品 | 写“理解Embedding分布概念,做过离线对比” |

| 中级 | 经验证明、指标提升 | 线上监控报表截图 | 量化“检索命中率提升X%” |

| 高级 | 架构设计、团队落地 | 跨团队协作文档 | 写“设计漂移主动检测系统,覆盖Y个场景” |

九、如何判断自己的回答是否到位?三个自查指标

1. 逻辑闭环:是否回答了“是什么、为什么、怎么办”

检查:你的回答是否包含了原因分析、影响和解决方案,且三者之间逻辑自洽。

2. 专业深度:是否提到了至少两个具体方法或指标

例如:KS检验、MMD、Recall@K、动态阈值、增量索引等。

3. 项目关联:是否把自己的简历项目自然融入

比如:“我之前在XX项目里就是通过定期计算Query Embedding和文档Embedding的KL散度来监测漂移。”

自检表格

| 检查项 | 满分说明 | 建议改进 |

|---|---|---|

| 逻辑闭环 | 3个要素都包括且连贯 | 补充缺失环节 |

| 专业深度 | 提及≥2个专业术语/方法 | 增加1-2个 |

| 项目关联 | 能够衔接简历中具体项目 | 提前梳理项目细节 |

十、长期优化:如何持续提升对Embedding分布漂移的理解

1. 动手复现一个简单的漂移实验

用开源Embedding模型(如sentence-transformers),准备两组不同分布的文本数据,计算相似度分布变化。网上有很多notebook可参考。

2. 关注最新研究和实践

ColBERT、Sparse Embedding、动态向量数据库(如Qdrant的更新策略)等方向都涉及漂移问题。订阅相关论文或博客。

3. 养成简历-面试-复盘的迭代习惯

每次面试后,把被追问到的深挖点整理成笔记,更新到简历对应的项目描述中。AI简历姬的“投递看板”支持记录每个岗位的面试反馈,长期积累下来就是你的知识库。

十一、RAG领域Embedding分布漂移的未来趋势

1. 实时自适应Embedding成为关键方向

未来RAG系统会引入在线学习机制,根据实时查询分布动态调整Embedding模型或检索参数。

2. 多模态Embedding带来的新挑战

当RAG扩展到图片、表格、代码等模态,不同模态的Embedding分布偏移更难监测和统一。

3. 面试对系统理解的要求越来越高

面试不再只问单个知识点,而是考察你能否从系统架构角度思考分布漂移对端到端效果的影响。

十二、总结:想把Embedding分布漂移面试题答好,关键在于“原理+经验+工具”三者结合

先吃透原理,再用项目经验佐证,最后借助AI简历姬这类工具系统化准备。如果你希望更快完成面试知识点梳理和简历优化,也可以借助AI简历姬,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:AI简历姬 - 智能求职工作台

精品问答

问题1:Embedding分布漂移和模型过拟合是一回事吗?

回答:不是。模型过拟合是指模型在训练数据上表现好但在新数据上差,属于模型泛化问题。Embedding分布漂移是指RAG系统中查询或文档的向量分布随时间变化,导致检索匹配下降。两者有关联(如分布漂移可能由模型过拟合引起),但本质不同。面试时建议先区分清楚,再展开联系。

问题2:如果没有实际经验,面试时该怎么回答?

回答:可以基于公开数据或开源项目做一个小分析。比如用wiki数据集,将一年的文章分成两个时间段,分别计算Embedding分布,然后比较差异。把过程写成博客或GitHub项目,面试时直接展示。另外,可以在简历中写“理解Embedding分布概念,熟悉漂移检测方法”。

问题3:AI简历姬的面试模块怎么帮助我准备RAG相关面试题?

回答:你只需在AI简历姬中粘贴目标岗位JD(包含RAG、大模型等关键词),系统会自动解析岗位要求,然后基于你简历中的项目经历生成模拟面试追问。比如你简历写了“负责RAG检索模块”,面试模块会追问“如何保证检索一致性”“怎么监测分布漂移”。你可以先练一遍,再根据参考建议优化回答。

问题4:在日常工作中,我该怎么建立漂移监控系统?

回答:第一步,选择监控指标:如查询与文档的余弦相似度均值、召回率。第二步,设置基线(例如上线后第一周的数据)。第三步,选择报警触发条件:连续3天相似度下降超过5%或某个场景的召回率低于阈值。第四步,定期复盘。如果公司已有监控平台(如Prometheus + Grafana),可以集成。