AI大模型RAG面试题主要围绕“检索增强生成”的技术原理、多跳推理的实现方式以及检索流程的细节展开。对于求职者来说,面试官通常不会只问一个孤立的概念,而是会结合应用场景考察你对“如何让模型从外部知识中获取信息、进行多步推理并生成答案”的理解。直接回答:你需要掌握RAG的基本架构、多跳推理的链条设计、检索与生成的衔接机制,并且能够用清晰的逻辑表达出来。下面从概念到实操,帮你系统梳理。

一、什么是AI大模型RAG面试题?多跳推理与检索流程的核心概念

RAG(Retrieval-Augmented Generation)面试题通常包含三个层面:检索流程(如何索引、检索、排序)、生成增强(如何将检索结果输入大模型)、多跳推理(如何通过多次检索或推理串联信息)。面试官想看你是否真正理解这些模块的运作逻辑。

1.1 RAG的基本架构

典型的RAG系统包括:文档切分 → 向量化 → 建索引 → 检索 → 重排序 → 生成。面试中常见问题如:“倒排索引和向量检索有什么区别?”“如何设计chunk size?”“检索返回top-k后怎么融合?”你需要清楚每个环节的设计动机和权衡。

1.2 多跳推理的核心逻辑

多跳推理(Multi-hop Reasoning)要求模型或系统多次检索/推理,比如“A在北京出生,B是A的学生,问B现在居住的城市?”这需要先找到A,再找B,再找城市。在RAG中多跳通常通过迭代检索、图结构或动态查询改写实现。面试官会追问:“如何处理多跳带来的累积错误?”“如何决定跳数?”

1.3 面试题常见类型

- 理论题:解释RAG vs 微调、为什么用检索而不是直接训练。

- 流程题:画出一个完整的RAG pipeline,并说明每个模块的输入输出。

- 应用题:给定一个场景(如客服系统),设计RAG方案,包括多跳推理的实现。

- 优化题:检索结果不相关怎么办?生成幻觉怎么缓解?

二、为什么大模型RAG面试越来越受重视?常见场景与行业需求

当前企业级大模型应用大多基于RAG(而非纯生成),因为它能结合私有知识、降低幻觉、便于更新。因此,RAG相关岗位从算法工程师到AI产品经理都在考察。

2.1 企业落地的核心场景

- 智能客服(FAQ、手册检索)

- 知识问答(企业内部知识库、法律/医疗文档)

- 文档摘要与事实核查

- 多轮对话中的上下文增强

这些场景都需要RAG,而多跳推理在复杂问题中尤其关键。

2.2 面试官考察的深层意图

他们不是考你背论文,而是看你能否设计一个可用的系统。比如:“用户问‘某产品的退货政策是什么?’如果政策分散在多个文档中,怎么用多跳检索拼凑答案?”这是工程思维。

2.3 行业招聘趋势

2024-2025年,大模型岗位的JD中超过60%提到了RAG或检索增强。很多岗位要求候选人不仅懂理论,还能动手实现一个简单的RAG demo。了解这些背景,你会明白为什么面试题越来越细。

三、多跳推理与RAG检索流程的区别与联系

很多人容易混淆“多跳”和“检索流程”,其实它们既有交叉又有独立的概念边界。

3.1 检索流程是管道,多跳推理是策略

检索流程是固定的步骤(查询 → 分块 → 向量检索 → 重排序),而多跳推理是决定如何多次执行这个管道。比如第一次检索结果不够,需要重新改写查询再检索。

3.2 核心区别对比表

| 维度 | 检索流程 | 多跳推理 |

|---|---|---|

| 关注点 | 如何从知识库找到相关信息 | 如何通过多次交互得到最终答案 |

| 技术实现 | 索引结构、检索算法、排序 | 查询改写、记忆机制、图遍历 |

| 面试常问 | chunk_size、召回率、排序策略 | 跳数控制、错误传播、中断条件 |

| 典型难题 | 语义匹配不准确 | 多步依赖导致的推理断裂 |

3.3 两者如何协同工作

在一个成熟的RAG系统中,多跳推理通常依赖检索流程的结果。例如:第一跳检索出候选实体,第二跳利用这些实体构造新查询再检索。面试官可能会问:“如果第一跳检索结果噪声很大,你会怎么设计第二跳的查询?”

四、应对RAG面试的核心原则:从理解到表达

面试不是背书,而是展示你对系统设计的把控。下面几个原则可以帮助你组织回答。

4.1 先定义边界,再展开细节

回答任何RAG问题前,先明确问题范围:是只关心检索,还是包括生成?是单跳还是多跳?比如问“如何提升RAG的准确性”,你可以先分类:检索侧(召回率、相关度)、生成侧(提示词、模型能力)。这样显得逻辑清晰。

4.2 用“问题拆解 + 方法论”说话

面试官喜欢看到你拆解问题的能力。例如:“多跳推理中如何避免错误传播?”你可以拆解为:1)每跳的置信度评估 2)基于阈值决定是否继续 3)引入回退机制。然后给出方法。

4.3 强调权衡与取舍

没有完美的方案。比如chunk_size:太小则上下文缺失,太大则噪声多。在面试中主动指出trade-off,会让你的回答更专业。

五、RAG面试题的标准回答流程与步骤

当面试官抛出一个RAG问题时,你可以按照以下步骤组织回答。

5.1 明确问题类型

是原理类、设计类还是优化类?快速判断后决定回答侧重点。

5.2 画图(或文字描述)

如果是系统设计题,先在脑内或纸上画出RAG pipeline:用户查询 → 查询理解 → 检索 → 结果融合 → 生成。然后指出你关注的是哪一部分。

5.3 分模块说明

例如面试官问:“请描述一个多跳RAG系统的实现。”你可以分步骤:

- 第一跳:查询实体识别,从知识库检索候选片段。

- 中间处理:利用大模型从片段中提取新的查询关键词。

- 第二跳:用新查询再次检索,并合并结果。

- 生成:将两跳结果作为上下文输入LLM。

5.4 讨论局限性

最后主动提及可能的问题:累积错误、检索延迟、长上下文支持等。

六、实操技巧:如何拆解多跳推理问题,组织逻辑

多跳推理题在面试中比较难,因为需要你现场推理。以下技巧可以帮助你更从容。

6.1 从输入到输出的链条跟踪

比如面试题:“用户问‘特斯拉2023年第三季度的营收是多少?它的股价当天波动如何?’”你可以一步步:先找特斯拉2023Q3财报的文档,找到营收数字;再找2023Q3财报发布日的股价数据;合并回答。

6.2 使用结构化思考框架

很多RAG多跳问题可以用“实体-关系”图来辅助。面试中可以在纸上画出:实体A → 关系R → 实体B → 属性V。然后对应检索模块。

6.3 常见误区:忽略信息合并

有时多跳得到的片段有冲突或冗余,如何合并?可以提到:使用LLM进行信息融合,设定优先级规则(如最新来源优先)。

七、AI工具如何助力RAG面试准备

准备RAG面试,除了啃论文,更重要的是实践和对齐岗位要求。传统方式是自己搭环境、刷题,但效率不高。AI工具可以帮助你快速了解岗位JD背后的技术栈、模拟面试问题、优化简历中与RAG相关的项目描述。

7.1 传统准备的低效点

- 盲目搜索面经,无法确认哪些知识点是目标公司重点。

- 项目经验描述平淡,没有体现多跳推理或检索流程的设计。

- 面试练习缺乏针对性,不知道从何练起。

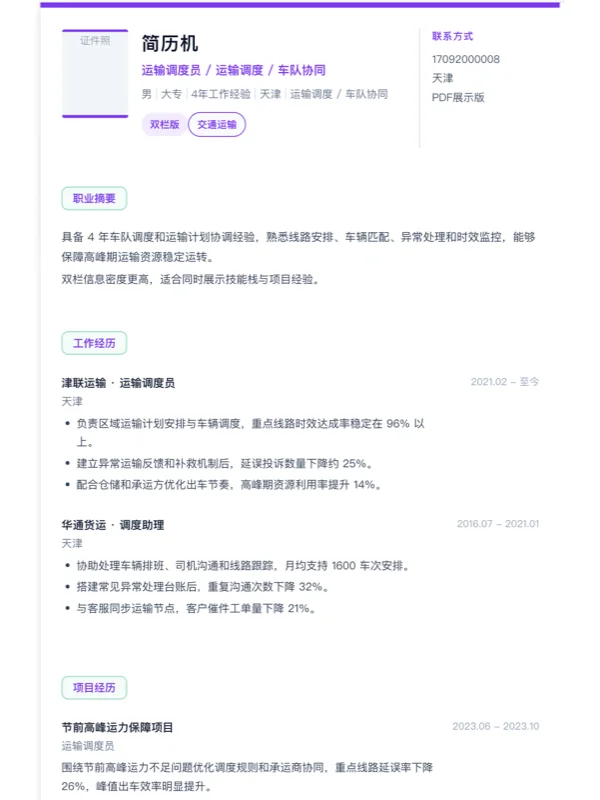

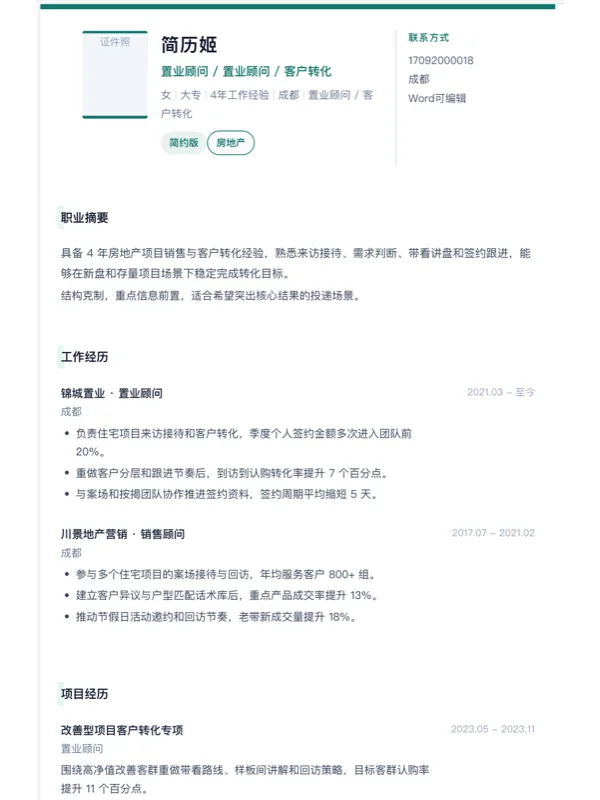

7.2 AI简历姬如何帮你高效准备

AI简历姬是一款以岗位JD为中心的求职工作台。你可以:

- 导入你的旧简历或项目描述,系统会自动解析并识别你涉及RAG的亮点。

- 粘贴目标岗位的JD,AI简历姬会生成关键词匹配报告,指出你的RAG相关技能与JD的重合度,并给出缺口清单。

- 对于项目经历,系统会按STAR结构进行量化改写,突出你在多跳推理、检索流程中的具体贡献,比如“设计了基于图的多跳检索策略,使问答准确率提升15%”。

- 模拟面试模块:基于你的简历和目标岗位,生成定制化的RAG面试追问,帮你提前演练。

7.3 更进一步:ATS友好的简历输出

很多公司初筛使用ATS系统,简历中的RAG关键词(如“向量检索”“多跳推理”“chunk策略”)必须清晰可解析。AI简历姬的ATS友好校验功能可以确保你的PDF/Word简历文本能被正确抓取。

八、不同岗位对RAG面试的差异

应聘算法岗、工程岗、产品岗,RAG面试的考察侧重点区别很大。

8.1 算法岗(NLP/ML研究员)

重点:模型原理、最新论文(如RAG、Self-RAG、REPLUG)、消融实验、多跳推理的数学建模。面试官会深挖你对attention、检索梯度等方面的理解。

8.2 工程岗(后端/搜索工程师)

重点:检索系统实现、性能优化、索引设计、流水线搭建。可能会问:如何用Elasticsearch做RAG?向量数据库选型(Milvus vs Faiss vs Qdrant)?如何减少检索延迟?

8.3 产品岗(AI产品经理)

重点:业务场景理解、用户体验、RAG的局限性及产品化。问题如:“如果用户问的问题需要多跳,而检索错了一跳,产品怎么兜底?”需要提出交互设计或反馈机制。

岗位差异总结表

| 岗位类型 | 核心关注点 | 典型面试题 | 准备策略 |

|---|---|---|---|

| 算法 | 模型设计、消融实验、多跳推理的数学 | “如何用对比学习优化检索?” | 读论文+复现关键实验 |

| 工程 | 系统实现、性能、可维护性 | “设计一个低延迟的多跳RAG系统” | 动手搭建demo |

| 产品 | 场景、用户、评估指标 | “如何定义多跳RAG的召回率?” | 结合案例思考 |

九、如何检验自己的RAG面试准备是否到位?

你需要一套自检标准,避免“我感觉自己懂了但面试答不出来”。

9.1 知识掌握检查点

- 能否三句话解释RAG与微调的区别?

- 能否手画一个多跳RAG的流程图?

- 能否说出至少三种提高检索召回率的方法?

9.2 实践能力检查点

- 是否用LangChain或LlamaIndex写过RAG demo?

- 是否调参过chunk_size并观察效果?

- 是否处理过检索结果为空或噪声大的情况?

9.3 表达清晰度检查点

- 能否用“首先…其次…最后”的结构回答复杂问题?

- 能否在5分钟内完成一个系统设计阐述?

- 能否主动指出你的方案的不足?

你可以对照下表自评:

| 自评维度 | 优秀(3分) | 合格(2分) | 需加强(1分) |

|---|---|---|---|

| 概念清晰 | 能带出对比和trade-off | 能说出定义 | 说不清 |

| 流程细节 | 能设计完整pipeline并优化 | 能说大概步骤 | 只能背术语 |

| 多跳推理 | 能举例并分析错误传播 | 知道是什么 | 不清楚 |

| 项目描述 | 量化了多跳策略的效果 | 提了但无数据 | 没体现 |

十、常见误区与持续优化:避免背诵模板,建立体系

面试中常见失误包括:只记套路、忽略工程细节、不会应对变化。

10.1 误区一:死记硬背RAG流程,但不了解内部机理

比如面试官问“为什么用稠密检索比稀疏好?”如果只回答“语义匹配更好”,但说不出具体场景(比如领域专有名词多时稀疏检索可能更好),就显得不够深入。

10.2 误区二:忽视多跳推理的难度

很多人以为多跳只是多次检索,但没考虑每跳的结果质量对后续的影响。面试中主动提到“可以用置信度阈值控制跳数”会加分。

10.3 持续优化方法

每次模拟面试后,记录自己回答中的漏洞,并对应弥补。比如发现对“检索与生成的融合策略”不熟,就去找资料学。同时,用AI简历姬的模拟面试模块反复练习,它可以根据你的简历和JD生成不同角度的追问,帮你暴露盲区。

十一、大模型RAG面试的未来趋势与建议

RAG领域变化很快,2024-2025年的趋势将影响面试题方向。

11.1 趋势一:从单轮检索到多轮交互

Agentic RAG(具备工具调用能力)逐渐流行,面试题可能会包含“如何让RAG系统调用外部API进行多跳查询?”

11.2 趋势二:个性化与实时更新

简历、岗位知识库等个性化场景要求RAG能快速更新索引。面试可能问:“如果知识库每天更新,索引设计如何处理增量?”这需要你了解局部更新策略。

11.3 趋势三:评估指标的细化

以前主要看召回率、精确率,现在更看重“回答的事实一致性”和“多跳推理的正确路径率”。面试官会问:“你如何自动评估多跳RAG的最终答案?”准备时建议研究如REACT、Self-Consistency等评估方法。

建议:持续关注最新ArXiv论文,动手实践,并利用AI简历姬这类工具将你的项目经验结构化,让面试官一眼看出你的能力。

十二、总结:想把RAG面试准备做好,关键在于系统梳理 + 实战练习 + 对齐JD

RAG面试题看起来杂,但核心逻辑是有限的。只要你把概念、流程、多跳推理、常见优化吃透,并且能通过模拟面试检验表达,就能在面试中稳定发挥。不要焦虑,绝大多数候选人都是在准备中逐渐清晰起来的。

如果你希望更快地针对目标岗位完成简历优化、关键词对齐、面试模拟,可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:RAG面试题中的多跳推理到底应该先做什么?

回答: 先明确跳数来源。多跳推理通常源于问题本身需要多个信息片段才能回答。面试前,你可以练习“拆解问题”的能力:把问题分解成若干子问题(实体关系链)。然后,针对每个子问题考虑如何检索。准备时,建议用面试常见问题(比如“如何查找一篇论文的引用关系”)反复练习拆解和检索设计。不需要一次完美,重点在逻辑链。

问题2:RAG面试里最容易出错的是哪一步?

回答: 最容易出错的是“检索结果的融合”。很多人只关注检索,但忽略了如何将多段相关文本有效输入给大模型。错误包括:把不相关片段也放入上下文(增加噪声),或者多跳结果前后矛盾。建议你在回答时明确提到“我会对检索结果进行重排序或去重,再用LLM做答案提取”,并给出具体方法(如基于相似度阈值过滤)。

问题3:AI工具在RAG面试准备中到底能帮什么?

回答: AI工具主要帮你做三件事:1)快速对标:贴JD生成你的技能匹配清单,让你知道岗位要求的RAG技能树;2)项目润色:把你的RAG项目经历改成STAR结构,突出亮点(如召回率提升、多跳策略);3)模拟面试:根据你的简历自动生成追问,帮你提前应答。比如AI简历姬的模拟面试功能就能针对“多跳推理”“检索优化”等关键词生成具体问题。

问题4:算法岗和工程岗在准备RAG面试时应该注意什么?

回答: 算法岗应重点理解论文细节(如Self-RAG的token-level control)、实验设置(消融实验、评估方法)。工程岗则要关注系统实现:能够手写简单的检索代码、配置向量数据库、解释索引结构。两者的共同点是都要能画出完整的RAG pipeline并讨论优化点。建议根据目标岗位JD,用AI简历姬先做技能诊断,再有针对性地查漏补缺。