如果你正在准备AI大模型相关的面试,尤其是检索增强生成(RAG)方向,那么Cross-Encoder和Bi-Encoder这两个概念几乎是必考题。它们到底是什么?在实际面试中怎么回答才能拿高分?本文直接给出判断:Cross-Encoder和Bi-Encoder的核心区别在于计算方式与适用场景——Bi-Encoder注重效率与可扩展性,适合大规模检索;Cross-Encoder注重精确匹配与相关性排序,适合小规模精排。 下面从概念到实战,帮你一次理清,并附上面试应答技巧和提效工具建议。

一、什么是Cross-Encoder和Bi-Encoder?

这一章我们先搞清楚两个模型的基本定义和运行原理,这是面试回答的基础。

1.1 核心定义:两种不同的句子对交互方式

- Bi-Encoder(双编码器):将查询(query)和文档(document)分别独立编码成固定长度的向量,然后通过余弦相似度或点积计算相似度。两个输入不直接交互,编码过程相互独立。

- Cross-Encoder(交叉编码器):将查询和文档拼接成一个序列,输入到同一个Transformer中进行全交互编码,最后输出一个相关性分数。两个输入在每一层都进行交互。

1.2 直观理解:独立工作 vs 深度对话

可以把Bi-Encoder想象成两个陌生人各自写下自己的简介,然后让第三者对比简介是否匹配;Cross-Encoder则像是在让两个人面对面深度交流,通过对话判断他们是否合拍。

1.3 为什么这两种模型在RAG中如此重要?

RAG(检索增强生成)的流程包含检索和生成两个阶段。Bi-Encoder通常用于第一阶段(粗召回),快速从海量文档中找出候选集;Cross-Encoder则用于第二阶段(精排序),对候选文档进行精细打分,提升最终输入给大模型的质量。两者配合能兼顾效率与精度。

二、面试中常见的问题场景与痛点

了解了概念,接下来看看面试官通常会怎么问,以及求职者容易在哪里卡壳。

2.1 面试官最爱问的三种提问方式

- 直接对比型:“请解释Cross-Encoder和Bi-Encoder的区别,各自优缺点是什么?”

- 场景应用型:“如果要做一个实时搜索系统,你会选哪个?为什么?”

- 代码实现型:“请用伪代码或PyTorch实现一个简单的Bi-Encoder。”

2.2 求职者最常犯的三个错误

- 混淆概念边界:有人误以为Bi-Encoder不需要共享权重,实际常见的双塔模型会共享编码器或共享底层参数。

- 忽视计算复杂度:面试时只提“Cross-Encoder更准”,却解释不清为什么慢——因为需要计算O(N)次完全交互,而Bi-Encoder可以通过向量索引将复杂度降到亚线性。

- 脱离RAG实际流程:很多人只讲模型本身,没有结合RAG的两个阶段说明如何搭配使用,显得不够落地。

2.3 面试官真正想考察的是什么?

本质上,面试官想确认你是否理解:1)模型设计背后的trade-off(效率vs精度);2)在真实系统中如何做技术选型;3)能否用清晰的语言把复杂概念讲清楚(这体现了你的沟通能力,在团队协作中非常重要)。

三、Cross-Encoder与Bi-Encoder的核心区别

这一章我们从多个维度进行对比,帮你建立系统性的认知。

3.1 计算效率与推理速度

| 维度 | Bi-Encoder | Cross-Encoder |

|---|---|---|

| 编码方式 | 查询和文档独立编码,可预计算文档向量 | 每个查询-文档对必须实时拼接并计算 |

| 时间复杂度 | O(1) 查询向量化 + O(log N) 近似最近邻搜索 | O(N) 次完整Transformer前向传播 |

| 适用场景 | 大规模候选集检索(十万至亿级) | 小规模精排(通常几百到几千) |

| 能否向量化存储 | 可以,文档向量可离线建立索引 | 不可以,必须在线两两计算 |

3.2 精度与交互深度

Bi-Encoder将信息压缩到一个固定向量中,损失了细粒度交互信息;Cross-Encoder则通过注意力机制让查询和文档的每个词都能互相“看见”,因此能捕捉更复杂的匹配信号(如短语匹配、否定词处理等)。在典型NLP基准测试中,Cross-Encoder的准确率通常比Bi-Encoder高出5~15个百分点,但代价是每个pair的推理耗时增加数十倍。

3.3 训练方式与损失函数

- Bi-Encoder:常用对比学习(contrastive learning),如用InfoNCE损失,让正样本对的向量距离近、负样本对距离远。训练时需要构造大量的negative pairs。

- Cross-Encoder:通常直接将拼接后的序列输入,输出一个分数,可以用回归损失(如MSE)或二分类损失(如交叉熵)。训练相对简单,但每个pair都需要处理。

四、在RAG系统中如何选择与搭配?

这是技术面试中最常被追问的部分。你需要给出有说服力的判断。

4.1 基本原则:先粗后精

在RAG系统中,标准的做法是使用两阶段检索:第一级用Bi-Encoder召回Top-K文档(K通常为100~1000),第二级用Cross-Encoder对召回结果重新排序,选出Top-N(N通常为5~10)作为上下文给大模型。这样可以平衡速度与精度。

4.2 什么情况下可以只用Bi-Encoder?

如果系统对延迟要求极高(如毫秒级响应),且文档量巨大(百万级以上),可以只使用Bi-Encoder配合向量数据库(如FAISS、Milvus)。此时需要保证Bi-Encoder本身的质量足够高,比如用蒸馏方法从Cross-Encoder中学习。

4.3 什么情况下必须上Cross-Encoder?

如果召回结果的质量直接影响最终生成效果(例如法律文档问答、医疗知识库),那么即使多花几百毫秒的排序时间也是值得的。另外,当训练数据有限时,Cross-Encoder有时比Bi-Encoder更容易微调,因为不需要构造复杂的负样本。

五、面试实战:如何回答“请比较Cross-Encoder和Bi-Encoder”

这一章给出可直接套用的回答框架和话术。

5.1 回答的结构化模板

- 先给出定义(一句话分别说清是什么)

- 然后指出核心区别(交互方式、效率、精度)

- 再结合RAG场景(两阶段使用方式)

- 最后总结选型原则(根据业务需求取舍)

5.2 示例回答(可直接背诵)

“Cross-Encoder和Bi-Encoder都是用于文本匹配的神经网络架构。Bi-Encoder将查询和文档分别编码成向量,通过相似度计算匹配,优点是速度快、可扩展,适合大规模检索;Cross-Encoder将两者拼接后一同输入,通过深层交互获得更精确的相关性分数,但计算量大,适合精排。在RAG系统中,通常先用Bi-Encoder做第一轮粗召回,再用Cross-Encoder对结果精排序,从而在效率和精度之间取得平衡。如果一个场景对延迟要求极高且文档量大,可以只用Bi-Encoder配合高效的向量索引;如果对精度要求极高且候选集规模可控,则建议加入Cross-Encoder。”

5.3 进阶亮点:提及权重共享与蒸馏

如果想展示更深的理解,可以补充:“Bi-Encoder的双塔可以共享或独立,实践中常用共享编码器减少参数量;Cross-Encoder可以用于蒸馏Bi-Encoder,将它的匹配知识迁移到更高效的模型上。”

六、干货:16个RAG面试高频题目与参考答案

这里帮你整理了一份精华列表,按主题分类。

6.1 RAG基础与流程

| 问题 | 要点 |

|---|---|

| RAG比传统微调有什么优势? | 知识可动态更新、避免灾难性遗忘、成本更低 |

| 如何构建知识库的chunk? | 按语义段落切分,注意chunk大小与重叠 |

| 什么是索引优化? | 倒排索引、向量索引(HNSW、IVF) |

6.2 Cross-Encoder与Bi-Encoder

| 问题 | 要点 |

|---|---|

| Bi-Encoder如何训练? | 对比学习,构造正负样本对 |

| Cross-Encoder的缺点是什么? | 计算量大,无法预计算,不适用于大规模候选集 |

| 如何评估两个模型的好坏? | 离线用NDCG、MAP,在线用A/B测试 |

6.3 系统设计与优化

| 问题 | 要点 |

|---|---|

| 如何保证RAG的实时性? | 增量索引、缓存高频查询、异步更新 |

| 如果检索结果不相关怎么办? | 调整检索策略、增加重排序、修改prompt |

| 大模型如何利用检索结果? | 通过特定提示词格式将文档作为上下文 |

6.4 面试中的“陷阱”问题

- 问:“Bi-Encoder和Cross-Encoder能互相替代吗?”

- 答:“不能完全替代。它们解决不同阶段的问题。如果只用一个,要在效率和精度之间做取舍。实际系统中往往搭配使用。”

七、用AI提效:准备面试的技术工具

准备这些技术概念和面试回答,传统方式是自己查论文、看博客、整理笔记,效率较低。现在你可以借助一些AI工具来加速。

7.1 为什么传统方式效率低?

- 资料分散:需要从多篇文章、论文、视频中提取关键信息。

- 练习困难:很难获得针对性的模拟面试反馈。

- 记忆曲线:概念容易忘,需要反复复习。

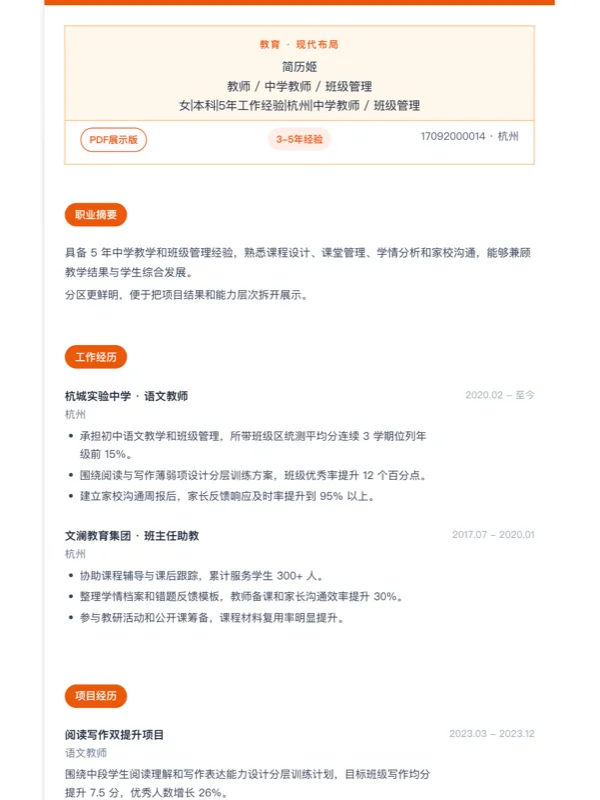

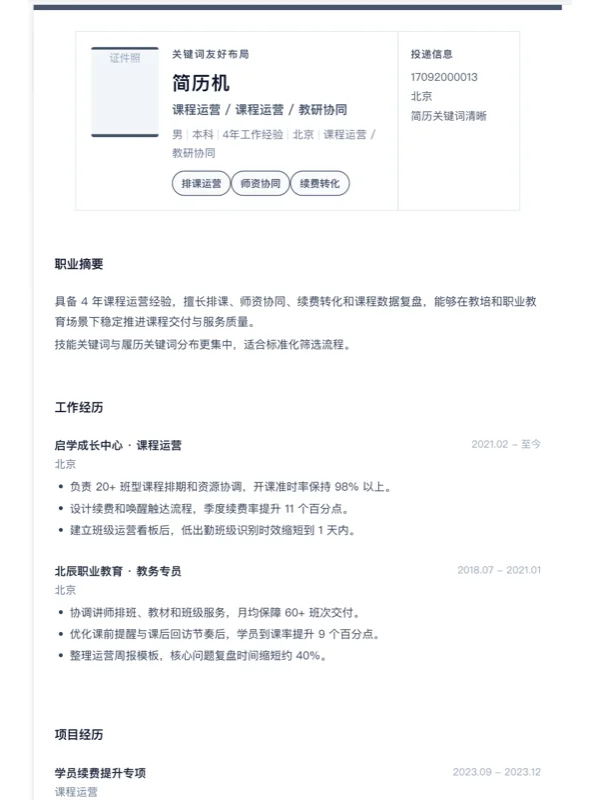

7.2 AI简历姬如何帮你?

AI简历姬是一款以岗位要求为中心的求职工作台。它不仅可以帮你优化简历,还提供了强大的模拟面试功能。对于准备RAG相关面试,你可以这样做:

- 粘贴目标岗位JD:例如“算法工程师-RAG方向”,系统会解析出技术要求。

- 使用模拟面试:基于你的简历和目标岗位,AI会自动生成定制化的技术问题,包括Cross-Encoder与Bi-Encoder的区别、RAG架构设计等,并给出参考回答和反馈建议。

- 及时纠偏:AI会指出你的回答中逻辑不清或遗漏的核心点,帮助你补齐知识盲区。

7.3 结合简历优化提升命中率

除了面试准备,AI简历姬还能帮你将简历中的项目经验写成更符合岗位要求的表述,比如在项目中体现你用过双塔模型或重排序,这样更容易通过简历筛选。

八、不同背景求职者的准备策略

不同资历的求职者,准备重点不太一样。

8.1 应届生/转行者

- 重点:把概念清晰讲出来,能画图解释流程。

- 建议:多看开源实现(如Hugging Face的sentence-transformers),理解基本原理即可。

- 常见失败点:过度深究细节,反而忽略了宏观逻辑。

8.2 1-3年经验工程师

- 重点:能结合项目经验说明权衡过程。

- 建议:准备好一个你曾经做过的检索或推荐项目,说明为什么选择某一种模型。

- 常见失败点:说不清具体的性能数据(如QPS、召回率)。

8.3 3年以上资深工程师/架构师

- 重点:系统设计与扩展性思考。

- 建议:讨论多级检索架构、跨语言场景、大规模分布式部署等技术方案。

- 常见失败点:只谈技术不谈成本(GPU资源、运维复杂度)。

8.4 面试心态调整

面试不是让你展示所有知识,而是证明你能胜任工作。不用因为某个概念卡住就慌乱,可以坦诚说:“这个点我还不太确定,但我的理解是…,我之后会再查证一下。”避免不懂装懂。

九、如何检验自己是否掌握了关键?

这一章提供自检清单和评估方法。

9.1 知识掌握度自评表

| 问题 | 能清晰解释 | 需要复习 | 完全不懂 |

|---|---|---|---|

| 分别用一句话定义Cross-Encoder和Bi-Encoder | |||

| 能画出两种模型的架构图 | |||

| 说出各自时间复杂度(粗略) | |||

| 给出RAG中的典型搭配方案 | |||

| 说出一个你实际使用过的案例 | |||

| 知道如何用代码简单实现 |

9.2 实战自检:找一个面试常见题自己回答并录音

例如:“请设计一个RAG系统,用于公司内部文档问答,要求响应时间<2秒,文档数量100万。”试着在5分钟内回答,然后听录音检查逻辑是否清晰。

9.3 如何持续巩固?

- 每周复盘:看一篇相关论文的摘要,试着用三句话讲给朋友听。

- 动手实践:用sentence-transformers库跑一个Bi-Encoder的demo,改换数据集观察效果。

- 关注前沿:注意多模态RAG、长上下文模型等对检索的需求变化。

十、常见误区与长期优化思路

避免踩坑,才能走得更远。

10.1 三个非常常见的误区

- 误区一:认为Cross-Encoder一定比Bi-Encoder高级。实际两者应用场景不同,不存在绝对优劣。

- 误区二:面试中只讲理论不讲落地。应当主动提及自己实际搭建过或调优过类似的系统。

- 误区三:忽视负样本的重要性。在Bi-Encoder训练中,负样本的质量直接影响召回效果。

10.2 长期学习路径建议

- 入门:通读Sentence-BERT原论文,动手实践。

- 进阶:了解ColBERT(一种介于两者之间的交互方式,兼顾效率与精度)。

- 深入:学习时域检索(如DRAG)、稠密检索与稀疏检索的结合。

10.3 如何将面试准备融入日常?

每天花15分钟回答一个面试问题,用笔记工具记录答案,每周回顾一次。坚持一个月,你的知识体系会非常牢固。

十一、Cross-Encoder与Bi-Encoder的未来趋势与建议

技术不断进化,面试内容也会变化。

11.1 多模态RAG对检索模型的新要求

随着图像、视频、表格等多模态数据加入RAG,检索模型需要处理跨模态的匹配。Bi-Encoder的多模态版本(如CLIP)已经广泛应用,而Cross-Encoder的多模态变体也在研究中。

11.2 端到端学习与检索生成的深度融合

未来可能出现检索与生成联合训练的模型,使得检索器和生成器更好协同。但这会增加训练复杂度,目前仍在探索阶段。

11.3 对求职者的建议

- 保持算法基本功:理解模型本质,而不是只会调库。

- 关注开源项目:如LangChain、LlamaIndex等框架的实现,能帮助理解工程化细节。

- 实践出真知:找一个kaggle竞赛或开源数据,自己搭建一个完整的RAG系统并写成博客,面试时会非常加分。

十二、总结:想把RAG面试准备做好,关键在于理解Trade-off并亲手实践

本文从概念定义、核心区别、面试技巧、工具提效、误区规避等方面,系统梳理了Cross-Encoder与Bi-Encoder在RAG面试中的考察要点。最核心的是:不要死记硬背,而是要理解为什么这样设计、在什么场景下选择什么方案。

如果你希望更快完成面试准备,也可以借助 AI简历姬 这类工具,提高效率并减少反复复习成本。AI简历姬的模拟面试模块能基于你的简历和目标岗位生成定制问题,包括本节讨论的Cross-Encoder与Bi-Encoder,帮你快速定位知识盲区。同时,它还能帮你优化简历中的项目描述,让招聘者一眼看出你的RAG相关能力。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/(AI简历姬官网)。祝你面试顺利,早日拿到心仪的offer!

精品问答

问题1:准备AI大模型RAG面试,应该先学Cross-Encoder还是Bi-Encoder?

回答:建议先学Bi-Encoder,因为它概念更基础(双塔结构、对比学习),而且在面试中常常作为对照组出现。理解Bi-Encoder后再学Cross-Encoder,聚焦两者的交互方式差异和trade-off。如果时间有限,可以两个同时看,但重点放在“两者如何配合”的思维上。

问题2:面试中如果被问到“Cross-Encoder的缺点”,除了说计算慢,还能说什么?

回答:除了计算慢,还可以说:1)无法预计算文档表示,因此不适合在线实时大规模检索;2)训练时每个query-document pair都需要前向传播,数据标注成本高;3)当文档长度不一时,拼接后的输入长度可能超过模型限制,需要截断或切分。

问题3:使用AI工具准备面试,真的比看博客效率高吗?

回答:看博客是系统学习的基础,但AI工具能帮你做两件事:一是“主动检索”——根据你的薄弱项生成针对性问题;二是“即时反馈”——回答后得到点评,纠正错误认知。两者结合效果最佳。AI简历姬的模拟面试功能特别适合想做针对性练习的求职者。

问题4:没有相关项目经验,面试时怎么回答RAG相关的问题?

回答:坦白说没有直接经验,但可以展示自己的学习能力。例如:“我目前没有在实际项目中使用过,但我阅读了经典论文并复现了一个简单的demo(如用sentence-transformers做相似度检索)。我理解的核心流程是…。如果有机会在贵公司实践,我相信能很快上手。” 同时建议你立即动手做一个mini项目,哪怕只是一个Jupyter notebook。