如果你正在准备AI大模型岗位的面试,RAG(检索增强生成)几乎是绕不开的考点,而其中“LLM重排序”和“成本”更是面试官最喜欢追问的深度话题。为什么?因为RAG系统在落地时,重排序决定了检索结果的质量,而成本直接关系到方案的可行性。对于求职者来说,光知道RAG概念远远不够,能讲清楚重排序的选型逻辑、成本优化的实际路径,才是拿下面试的关键。本文会从面试题出发,帮你拆解重排序和成本的核心问题,并给出可执行的准备方法,让你在面试中更有底气。

很多候选人在准备这类面试题时,容易陷入“背概念”的误区——知道RAG的三步流程(检索、重排序、生成),但一被问到“为什么需要重排序?如果用交叉编码器成本太高怎么办?”就卡住了。更糟糕的是,有些面试官会结合具体业务场景,让你现场估算成本或设计优化方案。所以,这篇内容会从原理、常见误区、实操步骤到工具提效,帮你建立起系统性的理解。

一、什么是AI大模型RAG面试题?为什么重排序与成本是关键考点?

1. RAG面试题的核心考察范围

RAG(Retrieval-Augmented Generation)是当前大模型落地的主流方案,面试题通常围绕三个层面:检索(Retrieval)、重排序(Re-ranking)、生成(Generation)。其中,重排序是连接检索和生成的关键桥梁,它决定了输入给LLM的上下文质量,而成本则是衡量方案是否可落地的硬约束。面试官通过这类问题考察候选人对系统整体架构的理解深度,以及在实际工程中做权衡的能力。

2. 重排序:为什么面试官反复追问?

很多候选人会混淆“重排序”和“向量检索”,实际上重排序是检索后的精排环节。常用的方法包括基于交叉编码器(Cross-Encoder)的深度重排序,以及基于轻量模型的粗排序。面试官追问重排序,通常是想知道你能否理解“Why re-rank?”——因为初检索(如向量相似度)只能找到语义相近的信息,但无法精准判断哪个结果对当前问题最有用。重排序能显著提升最终生成的质量,但也会引入额外的延迟和成本。

3. 成本:从面试题到实际落地的考验

成本问题经常以场景题出现:“如果你的RAG系统每天需要处理100万次查询,重排序阶段用交叉编码器,每次推理成本0.01元,你能接受吗?如果不能,你会怎么做?”——这不仅仅是算账,更考验候选人对模型选型、缓存策略、分段推理等优化手段的掌握。面试官希望看到你既能从技术角度分析,又能从业务角度做取舍。

二、RAG面试中关于重排序的常见问题与误区

1. 误区一:重排序和检索是同一回事

这是最常见的理解偏差。有人以为“向量数据库返回的结果已经按相似度排序了,不需要再重排序”,但忽略了相似度不代表相关性。面试官会问你:“假如用户查询‘iPhone 14的电池寿命’,检索到的文档包含iPhone14和电池寿命两个主题,但一个是参数列表,一个是维修指南,哪个更相关?”向量相似度可能把参数列表排在前面,但用户实际需要的是维修指南。重排序通过更精细的模型(如Cross-Encoder)可以纠正这种偏差。

2. 误区二:重排序模型越深越好

有些候选人会推荐使用大参数量的交叉编码器,认为准确度更高。但面试官会反问:“如果线上延迟要求<200ms,你的方案还能用吗?”这里需要权衡:深模型带来更好的排序,但成本和延迟也线性增加。正确的做法是根据业务场景选择合适规模的模型,或者采用级联重排序(先用轻量模型粗排,再用深模型精排前K个)。

3. 误区三:成本只跟模型大小有关

成本不仅仅是模型计算,还包括:文档嵌入的存储成本、检索服务的调用成本、重排序模型的推理成本、LLM生成的Token成本。很多候选人只盯着推理部分,忽略了基础设施。面试官会追问:“你的RAG系统如果使用外部API(如OpenAI Embeddings),每调用一次多少钱?如果数据量从1万条增长到100万条,存储和检索成本增加多少?”需要全面考虑。

常见误区总结表

| 误区 | 正确理解 | 面试应对要点 |

|---|---|---|

| 重排序=检索 | 两者是不同环节,重排序是精排 | 能解释清楚各环节目的 |

| 模型越深越好 | 需要结合延迟和成本 | 能给出不同场景的选型建议 |

| 成本只算推理 | 包括存储、检索、推理、生成等 | 能估算整体成本并优化 |

三、LLM重排序的核心概念与面试高频考点

1. 重排序技术的分类与原理

面试中常见的重排序方法:

- 基于交叉编码器(Cross-Encoder):将查询和每个候选文档拼接成“[CLS] query [SEP] doc [SEP]”输入编码器,直接输出相关性分数。准确度高,但计算复杂度O(n)(n为候选数)。

- 基于双编码器(Bi-Encoder):查询和文档分别编码,通过余弦相似度排序,速度更快但准确度稍低。常用于初检索,也可以作为重排序的基础。

- 级联重排序:先用Bi-Encoder或小模型粗排选Top-K(如100→20),再用Cross-Encoder精排Top-K。

- 学习排序(Learning to Rank):使用特征工程和轻量模型(如LambdaMART)排序,适合大规模工程场景。

面试官常要求你画出架构图并解释各环节的输入输出。

2. 如何根据场景选择重排序策略?

一个高频场景题:“你正在做一个法律文档问答系统,数据量1亿条,查询延迟要求<1秒,预算有限。你会怎么设计重排序?”参考答案思路:先通过BM25或向量检索召回Top-100,然后用一个高效的MiniLM模型(如all-MiniLM-L6-v2)进行粗排,最后用一个小型Cross-Encoder(如ms-marco-MiniLM-L-4-v2)精排Top-10。同时引入缓存机制,对常见查询预先计算排序结果。

3. 重排序效果评估指标

面试官可能会问:“你怎么知道自己的重排序效果好不好?”常用指标:

- NDCG(归一化折损累计增益):考虑排序位置,适合多级相关性。

- MRR(平均倒数排名):关注第一个相关结果的位置。

- Recall@K:前K个结果中包含相关文档的比例。

- Latency & Throughput:线上系统的实际延迟和吞吐量。

需要结合业务目标选择一个主要指标。

四、RAG系统成本构成与优化方法论

1. 成本构成明细

RAG系统的成本分为如下几部分:

| 成本项 | 影响因素 | 典型优化手段 |

|---|---|---|

| 文档嵌入与存储 | 向量维度、文档数量、存储介质(内存/磁盘) | 降维、量化(PQ)、使用低成本向量数据库(如FAISS) |

| 检索服务 | 查询频次、检索算法(近似最近邻) | 建立索引(如IVF、HNSW)、缓存热门查询 |

| 重排序推理 | 模型大小、候选数、推理框架 | 级联排序、模型量化、批处理、使用GPU/TPU |

| LLM生成 | Prompt长度、输出Token数、模型价格 | 压缩上下文、使用小型LLM、知识蒸馏 |

2. 面试中常见的成本优化方案

面试官希望你能条理清晰地回答,比如:

- 剪枝与分段:对于长文档,先检索段落而非全文,减少重排序候选的粒度。

- 分层检索:先检索元数据(如标题、摘要),再精检具体内容。

- 异步与批处理:对非实时查询做批处理重排序,降低单次推理开销。

- 模型量化与剪枝:将重排序模型从FP32压缩到INT8,推理速度提升2-4倍,精度损失可接受。

3. 用具体数字估算成本

面试官可能会出计算题:“假设一个文档平均长度512 tokens,一共100万条文档,使用BAAI/bge-large-en-v1.5(768维)嵌入,FAISS索引存储需要多少内存?”你可以这样估算:每条向量768 * 4 bytes = 3072 bytes,100万条约3GB,加上索引开销约5-6GB。再比如,“每天100万次查询,每次重排序候选50条,使用6层Cross-Encoder(延迟10ms/条),需要多少GPU算力?”可以引导计算:峰值QPS约12,单卡可承载,但需考虑冗余。

五、RAG面试题的标准回答流程与步骤

1. 面对RAG面试题的四步法

第一步:明确问题边界。先问面试官:“您指的是通用RAG系统,还是特定业务场景?”避免答非所问。第二步:梳理核心流程。从检索到重排序到生成,画出简单流程图。第三步:针对重排序或成本问题,给出2-3种可选方案并对比优劣。第四步:结合具体业务给出推荐方案,并说明权衡理由。

2. 重排序问题的回答模板

例如被问到:“你会如何设计RAG系统的重排序模块?”可以这样回答:

- 先说明目的:提升检索结果相关性,降低LLM幻觉。

- 接着分析约束:延迟、成本、数据规模。

- 然后给出方案:对于小规模高质量数据,直接用Cross-Encoder精排;对于大规模,采用两阶段级联。

- 最后补充评估指标和优化空间。

3. 成本问题的回答模板

“如何控制RAG系统的运行成本?”

- 从架构层面:减少不必要的检索和重排序(如查询改写、意图分类)。

- 从模型层面:使用轻量重排序模型、知识蒸馏。

- 从工程层面:缓存、批处理、弹性伸缩。

- 从数据层面:数据去重、分段、索引优化。

最好能给出一个实际案例,比如自己做过的项目。

六、准备RAG面试题的实用技巧

1. 建立知识体系而非死记硬背

很多面试题是开放式的,比如“请比较Dense Passage Retrieval和BM25在RAG中的优劣”。你需要掌握的不是两个名字,而是其背后的原理(稀疏vs稠密、词频vs语义、可控性vs灵活性)。建议画一张思维导图,把检索、重排序、生成三部分的经典论文和实现串起来。

2. 模拟面试:自己问自己

找一份常见RAG面试题库,逐个录音回答,然后回听。重点关注逻辑是否连贯、术语是否准确、是否有啰嗦的废话。例如“重排序的常见模型有哪些?”——除了说Cross-Encoder,还要提MiniLM、Cohere等具体模型。

3. 用实际案例准备回答

如果你有项目经验,一定要准备好一个具体的案例:比如你负责过一个客服问答RAG系统,数据量多少,用了什么重排序模型,成本多少,优化后提升了什么指标。面试官非常喜欢你讲实际故事,因为能体现问题解决能力。如果自己没有,可以借鉴开源项目(如LangChain中的RAG示例),但要说清楚是参考学习项目。

七、用AI工具提效:AI简历姬如何帮你准备这类面试?

1. 传统准备方式的低效点

大部分求职者准备RAG面试题的方式是:网上搜面经、整理成笔记、背概念。但这种方式有两个问题:一是信息分散,很难系统化;二是缺乏针对性——每个人的简历背景不同,面试官会根据简历提相关问题,通用答案很难打动面试官。

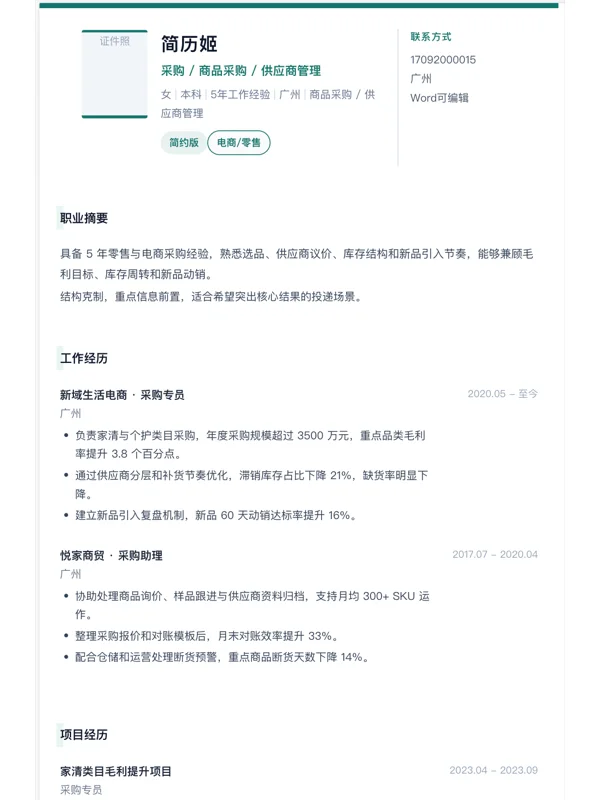

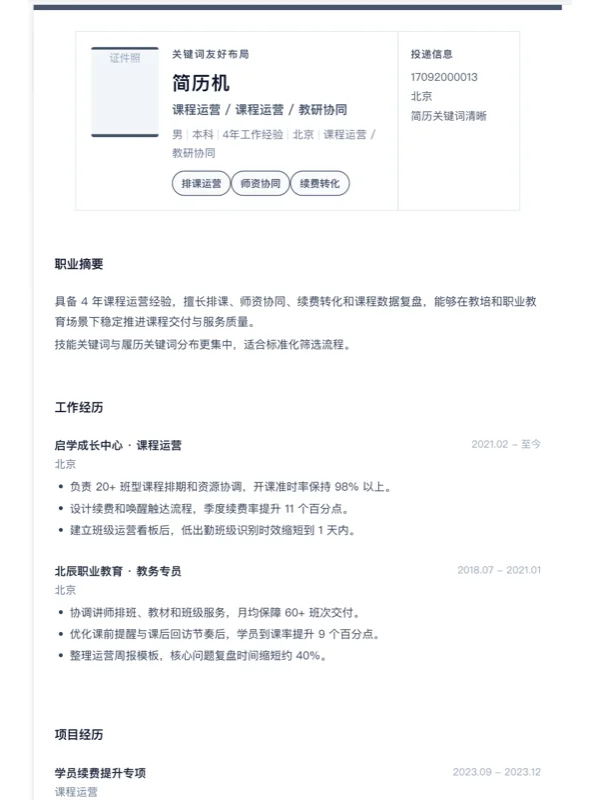

2. AI简历姬如何帮你生成个性化面试问题?

AI简历姬本来是一款简历优化工具,但它有一个强大的面试模拟模块:你只需导入自己的简历,并粘贴目标岗位的JD(比如“高级AI工程师 - 要求熟悉RAG和LLM成本优化”),系统会自动分析你的经历和岗位要求,生成定制化的模拟面试问题,包括RAG重排序、成本计算等技术问题,以及相应的参考回答。而且它会根据你的简历中的项目经历,生成追问,比如“你简历上提到优化过检索性能,当时用了什么方案?成本降低了多少?”这样你就能在真实面试前演练一遍。

3. 使用AI简历姬的3分钟准备流程

- 第一步:上传你想投递岗位的JD,AI简历姬自动解析关键词(如RAG、重排序、成本)。

- 第二步:系统基于你的简历和JD,生成一份“面试重点清单”,包括常考知识点和你的薄弱点。

- 第三步:启动模拟面试,在对话中练习回答,系统会根据你的回答给出反馈建议,比如“你的回答缺乏具体数字估算,建议补充”。

- 第四步:将改进后的回答整理到面试准备笔记中,形成一岗一版的储备。

通过这种方式,你不需要自己全网搜索,AI简历姬把信息整合成闭环,让你更专注在理解和练习上。

八、不同求职者的RAG面试准备差异

1. 应届生 vs 有经验者

| 对比维度 | 应届生 | 有经验者 |

|---|---|---|

| 面试侧重 | 基础概念、论文理解、动手能力(如实现简单重排序) | 系统设计、场景化问题、成本优化实际工程经验 |

| 典型问题 | “请解释RAG为什么需要重排序” | “你过去是如何优化RAG系统成本的?” |

| 准备重点 | 学习经典论文(如REALM、RAG)、动手做一个Demo | 复盘自己项目中的技术选型、考虑业务约束 |

2. 算法岗 vs 工程岗

算法岗更关注重排序模型的精度、最新研究(如RankLLaMA),而工程岗更关注延迟、成本、可维护性。准备时要有侧重。例如算法岗要准备:“请讲一下SetRank与ListNet的区别”;工程岗要准备:“如果用Redis作为缓存层,如何设计过期策略平衡成本和新鲜度”。

3. 跨行者如何快速补齐?

如果你是从其他方向转AI,建议先花一周时间搭建一个最小RAG系统(LangChain + Chroma + Ollama),然后自己提出优化重排序和成本的问题,再尝试解决。动手实践比单纯看书更能加深理解。

九、衡量RAG面试准备是否到位的检查清单

1. 知识要点检查

| 项目 | 是否掌握 | 备注 |

|---|---|---|

| RAG整体架构(检索-重排序-生成) | 是/否 | 能画出流程图 |

| 至少说出3种重排序方法及其优缺点 | 是/否 | Cross-Encoder, Bi-Encoder, 级联 |

| 成本构成包括哪些?至少说出4项 | 是/否 | 参考第四章节 |

| 能用一个实际例子说明如何优化成本 | 是/否 | 比如使用量化模型 |

| 能评估重排序效果(NDCG, MRR等) | 是/否 | 理解指标含义 |

2. 实战能力检查

- 给你一个业务场景(如医疗问答),你能在30分钟内设计出一个包含重排序和成本控制的RAG方案吗?

- 面对面试官的追问“你方案的瓶颈在哪里?”,你能快速识别吗?

- 你能用伪代码描述一个简单的级联重排序逻辑吗?

3. 持续改进清单

每周做一次模拟面试,记录下回答不流畅的问题,针对性补强。同时关注最新论文(如Survey on Re-ranking for RAG),保持知识更新。

十、长期机制:持续学习与RAG面试题复盘

1. 建立自己的知识库

用Notion或Obsidian,把每次学习到的RAG相关知识整理成卡片,包括:问题、回答参考、优化思路、参考链接。定期复习,把零散知识串成网络。例如,从“重排序”可以链接到“交叉编码器”、“知识蒸馏”、“延迟优化”等。

2. 面试后的复盘方法

每次面试后,立刻记录面试官的提问和你的回答,标记哪些问题没答好。然后找资料补全答案,更新到知识库。下一次面试前重读复盘记录。反复几次,你会发现自己对RAG的理解越来越深。

3. 加入社区讨论

在GitHub Discussions、知乎、V2EX上参与RAG相关话题,尤其是关于重排序和成本的讨论。很多实践者会分享真实踩坑经验,比看书更接地气。你也可以主动回答别人的问题,教是最好的学。

十一、RAG面试题未来的趋势与建议

1. 多模态RAG的出现

未来RAG不再只限于文本,还会包含图像、表格、音频等。重排序将面临跨模态的挑战,如何将不同模态的检索结果统一排序?成本也会因为多模态嵌入学而增加。面试题可能会延伸:“怎么设计一个既支持文本又支持图片检索的RAG系统?”建议先熟悉多模态模型(如CLIP)的Embedding对齐原理。

2. 端到端优化趋势

传统RAG各环节独立,但未来可能出现端到端训练的RAG模型,直接优化最终生成质量。重排序和生成将更紧密耦合。面试官可能问:“你是否了解过Self-RAG或Rewrite-Retrieve-Read范式?”建议提前阅读相关论文。

3. 低成本落地成为硬性要求

随着大模型API价格下降,但调用次数增加,总成本依然很高。面试官会更加看重候选人对成本敏感设计方案的能力,比如利用LoRA微调一个大模型来同时做检索和排序,减少模型数量。建议多关注模型压缩和混合精度推理等技术。

十二、总结:搞定AI大模型RAG面试,关键在于理解重排序与成本的平衡

面试官想看到的不是你背诵了多少概念,而是你能否在实际场景中做出合理的技术决策。RAG系统中的重排序与成本是互为犄角的关系:提升排序精度往往要付出更多计算成本,而降低成本又可能影响最终回复质量。你能做的是,掌握不同方案的适用边界,并通过工程手段(缓存、级联、量化)来找到最优解。

如果你正在找AI大模型相关岗位,并且希望系统性地准备面试,除了自己看书和做项目,也可以借助一些工具来提高效率。例如,AI简历姬不仅能帮你优化简历,还能基于你的经历和目标岗位生成定制化的面试模拟题目,包括RAG重排序、成本优化等高频问题。这样你可以在短时间内熟悉面试节奏,发现自己的薄弱点。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

最后,记住求职过程难免有压力,但每一次面试都是学习的机会。把RAG面试题当作提升自己技术深度的契机,而不是负担。祝你顺利拿下心仪的Offer!

精品问答

问题1:RAG面试题中,重排序和向量检索的区别到底是什么?

回答:向量检索(如ANN)是第一步,它从海量文档中快速找到语义相近的Top-K结果,侧重速度和召回。重排序是第二步,它对Top-K结果再做精细排序,使用更准确的模型(如交叉编码器)计算每条文档与查询的相关性,提升排序精准度。简单说,向量检索保证“不漏掉”,重排序保证“排得好”。面试时可以用一个比喻:向量检索是“海选”,重排序是“决赛”。

问题2:如果面试官让我估算一个RAG系统的成本,我该怎么回答?

回答:先确认边界(用户量、文档量、模型选择),然后分项拆解:1)文档嵌入和存储成本(假设每条文档嵌入维度768,100万条存储约3GB,使用GPU实例租用费用可估算);2)检索成本(调用API或自建索引的QPS费用);3)重排序成本(每秒推理次数×每次延迟×实例单价);4)LLM生成成本(Prompt+Output Token数×模型单价)。最后给出一个粗略的月度开支数字,并说明优化方向。这样显得专业且有条理。

问题3:我是一个刚毕业的学生,没有项目经验,怎么准备RAG面试题?

回答:没有工程经验不代表不能答好。建议你:1)精读3篇经典论文(RAG原始论文、REALM、DBRQA),并用自己的话总结贡献和不足;2)动手跑通一个开源RAG Demo(如LangChain的RAG例子),改几行代码测试不同重排序效果;3)准备一个“假如我来设计”的框架回答,比如“如果让我设计一个知识库问答RAG系统,我会先考虑数据量级和实时性,然后选择……”。重点展示思考逻辑和学习能力。很多面试官更看重潜力而不是已有经验。

问题4:AI工具在准备RAG面试题方面能帮到什么具体作用?

回答:AI工具可以帮你节省时间并聚焦在弱项。比如AI简历姬能根据你的简历和岗位JD,生成定制化的面试问题列表,包括RAG重排序和成本计算等高频题,并给出参考回答框架。你可以在它的模拟面试模块中练习,系统会记录你的回答并提示改进点。这样你就不需要自己去找散落的面经,同时还能针对性补强。不过AI只是辅助,关键还是自己理解原理和练习表达。