如果你正在准备大模型算法工程师的面试,Transformer几乎是绕不开的核心考点。很多求职者都会先刷一遍论文,但面试官真正想考察的往往不只是背出Attention公式,而是看你是否理解它为什么能取代RNN、如何解决长距离依赖、以及在实际大模型里是怎么落地的。更关键的是,把Transformer讲清楚,不仅考验你的技术深度,还考验你结构化表达的能力。下面这篇文章会从面试出题逻辑、核心概念、准备方法到工具提效,帮你系统梳理一遍。

一、Transformer面试题是什么?为什么是大模型算法工程师的必考内容?

Transformer模型自2017年提出后,几乎成了所有现代大语言模型的基石。面试官问Transformer相关题目,本质上是在考察你的深度学习基本功是否扎实,以及你是否能理解大模型训练的底层逻辑。

1.1 Transformer的核心贡献是什么?

Transformer首次完全抛弃循环和卷积,仅靠注意力机制建立输入输出的全局依赖。它解决了RNN的梯度消失和长距离遗忘问题,同时带来了可并行的训练方式。对于大模型来说,可并行意味着可以在大规模算力集群上高效训练,这也是GPT、BERT等模型成功的基础。

1.2 为什么大模型算法工程师必须掌握?

大模型从GPT-1到GPT-4,再到LLaMA、ChatGLM等,底层都是Transformer的变体。如果你不了解它的结构、位置编码、多头注意力机制,在面对模型优化、推理加速、微调等实际问题时会寸步难行。面试官通常会从“画图解释Transformer结构”开始,逐步深入到“为什么Layer Norm放在残差块前/后”“稀疏Attention的注意事项”等。

1.3 面试题常见考察维度

| 考察维度 | 典型问题示例 |

|---|---|

| 结构理解 | 画出Transformer整体架构,说明每个组件作用 |

| 数学细节 | Attention的计算公式中softmax为什么除以√d_k? |

| 与RNN对比 | Transformer相比LSTM的优势在哪里? |

| 实际应用 | GPT中Decoder-only结构如何保持自回归? |

| 优化技巧 | FlashAttention的原理和收益是什么? |

二、面试中Transformer常考的典型问题与难点

很多同学反映,Transformer论文读了好几遍,但面试时被问到“为什么需要位置编码”“Multi-Head Attention中Head数怎么设”还是会卡住。下面列出几个高频考点和背后的难点。

2.1 位置编码的原理与变体

原始Transformer使用正弦余弦函数,为什么不用数字0,1,2?因为数字绝对大小会随时间步长大幅增加,导致梯度问题。正弦余弦函数可以通过三角恒等式让模型捕捉相对位置,且能外推到任意长度。但面试官常追问:为什么后来有了可学习位置编码、RoPE(旋转位置编码)和ALiBi?每种有什么优劣?你需要答出RoPE能解决内积随时间步长退化的问题,且兼容线性Attention。

2.2 自注意力机制的计算复杂度与优化

自注意力的时间复杂度是O(n²),当序列长度达到几千甚至几万时,显存和计算开销不可接受。面试官常问:如何降低复杂度?可以答稀疏Attention、线性Attention、FlashAttention等。其中FlashAttention通过分块计算和重计算,减少显存读写,实际加速效果明显。

2.3 残差连接和Layer Normalization的放置

Transformer中每个子层都有残差连接加Layer Norm。面试官经常问:为什么Post-Norm早期流行而现在Pre-Norm更常用?因为Post-Norm在深层时梯度容易出现数值不稳定,Pre-Norm让输入直接残差传播,训练更稳定,尤其适合深层大模型。

三、Transformer核心概念与常见误解

有的人以为Transformer就是一个Attention层,还有的人认为“多头注意力就是多个Attention并行计算”。这些理解虽然方向对,但不够准确,面试时容易暴露短板。

3.1 多头的本质不是并行多个注意力

多头注意力其实是把Q、K、V投影到h个低维子空间,然后在每个子空间独立计算注意力,最后拼接投影回原始维度。这样做让模型能同时关注不同位置的表示子空间信息,类似于CNN中多个卷积核提取不同特征。

3.2 自注意力输出为什么需要线性变换?

多头输出拼接后,通常会接一个线性映射,目的是让模型自身学习如何融合不同头的信息,而不是简单相加。如果去掉,模型表达能力会受损。

3.3 Dropout在Transformer中如何使用?

在Attention的softmax输出后和残差连接前都可以加Dropout,但要注意训练和推理时行为差异。很多面试者会忽略推理时Dropout被关闭,导致对模型行为判断失误。

四、应对Transformer面试题的核心原则

准备面试题不是背答案,而是构建一个清晰的思维框架。下面三个原则可以帮助你更高效地准备。

4.1 结构化表达优于零碎记忆

面试官问“请解释Transformer”,你如果从输入embedding开始,按流程讲到输出,然后总结优点,会比零散地讲“有注意力、有残差”显得更有条理。建议用“流程+组件+理由”的结构。

4.2 理解为什么比记住公式更重要

比如softmax中除以√d_k,很多人背了“防止梯度消失”,但更本质的原因是:点积的结果随d_k增大而方差变大,softmax的梯度会进入饱和区,除以√d_k可以让方差稳定为1,保持梯度流动。

4.3 从场景出发,而非孤立记忆

思考每个设计在实际大模型中的作用。比如,为什么要用因果掩码(causal mask)?因为在生成任务中不能看到未来token。为什么LLaMA用SwiGLU激活函数?因为相比于ReLU或GELU,SwiGLU在相同参数量下效果更好。

五、系统准备Transformer面试题的步骤

准备时间有限,按照以下步骤可以最大化效率。

5.1 第一步:精读原论文,抓主干

读Attention Is All You Need,重点看Section 3(模型架构)和Section 4(实验)。自己动手画一遍结构图,标注每个层的作用。

5.2 第二步:亲手实现一个简化版Transformer

使用PyTorch或TensorFlow,按照经典教程(如The Annotated Transformer)实现一个机器翻译或文本生成的小模型。在debug过程中你会深刻理解数据流动。

5.3 第三步:整理面试题库,输出自己的答案

收集常见问题,针对每个问题写出300-500字的答案,并用自己的语言录音复述一遍。面试时口头表达流畅度很重要。

六、实用技巧:如何高效理解和记忆Transformer

很多人觉得Transformer知识点多而杂,其实可以通过几个技巧降低记忆负担。

6.1 建立核心组件清单

| 组件 | 功能 | 关键细节 |

|---|---|---|

| Embedding | 词向量+位置编码 | 位置编码方式 |

| Multi-Head Attention | 捕捉不同子空间的关系 | 并行→拼接→映射 |

| Add & Norm | 残差+层归一化 | 顺序(Pre/Post) |

| Feed Forward | 两层线性+激活 | 激活函数的选择 |

| Dropout | 防止过拟合 | 训练/推理不同 |

6.2 对比学习法

把Transformer和RNN、CNN做一个对比表格,列出相同点和不同点,以及为什么Transformer更适合大模型训练。例如RNN不能并行,CNN感受野受限。

6.3 用类比帮助理解

可以把多头注意力想象成多个专家同时看同一份文件,每个专家关注不同侧面,最后把意见汇总。

七、AI工具如何辅助准备Transformer面试题

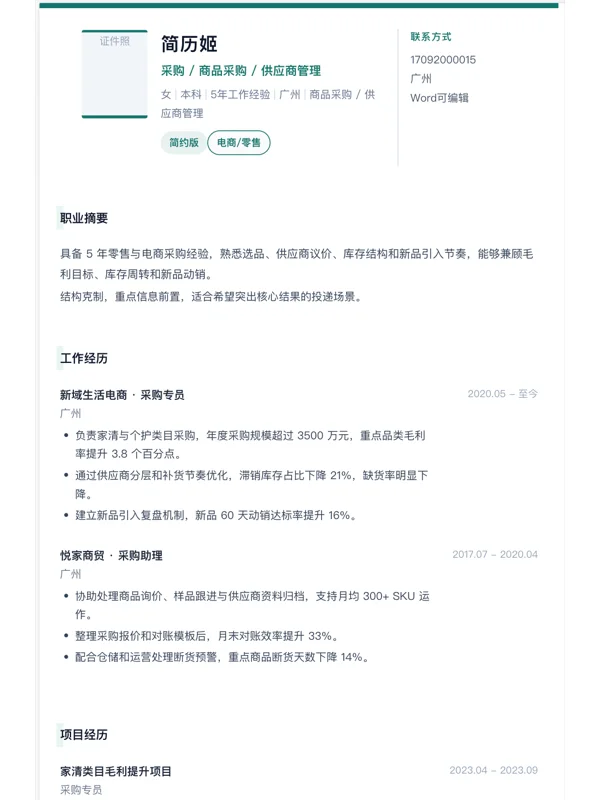

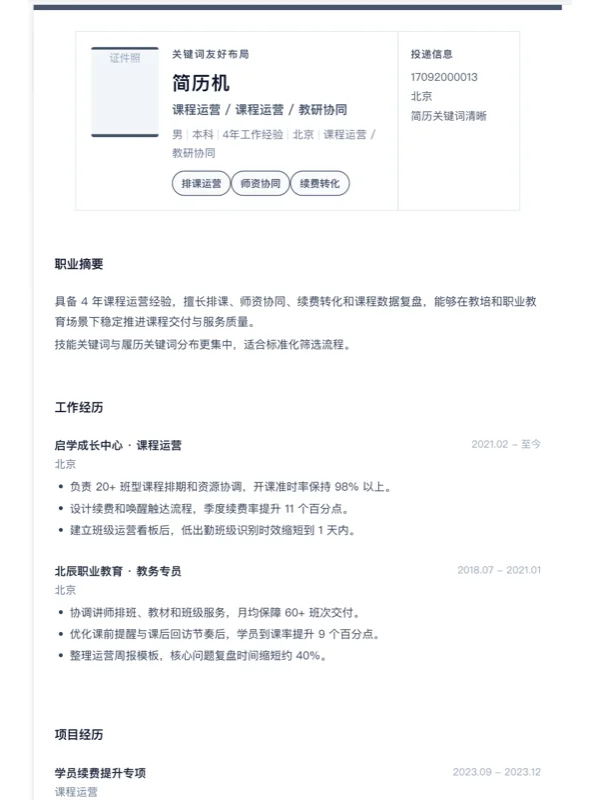

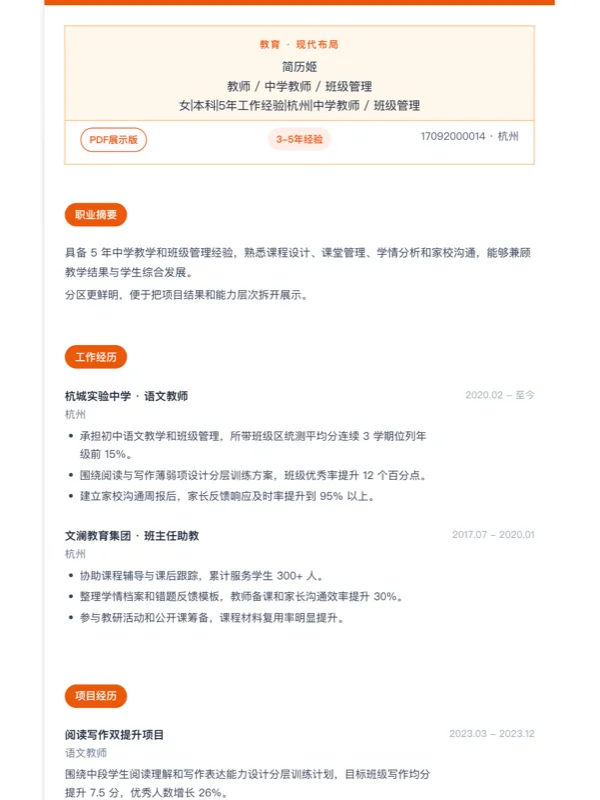

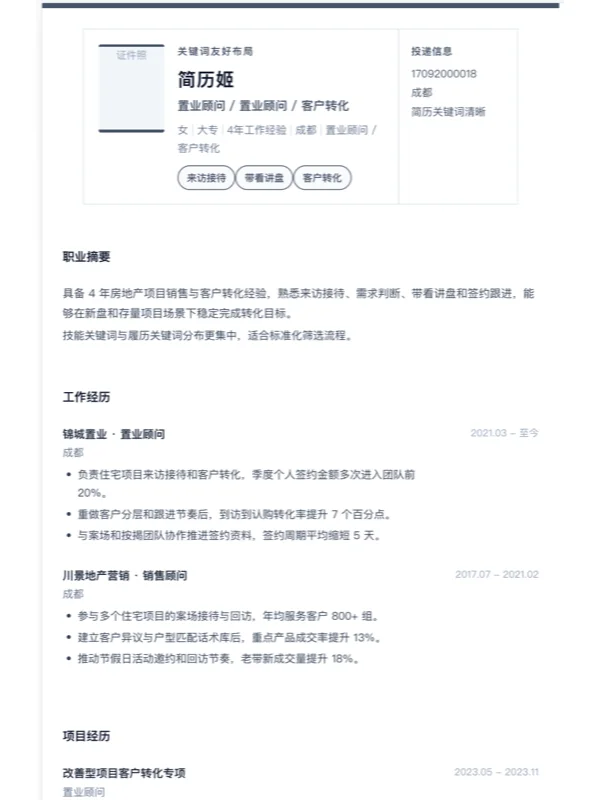

传统准备方式耗时且容易漏掉重要知识点。AI简历姬在这方面可以帮你做两件事:一是把你的简历和岗位要求对齐,确保面试官看到你的技能与岗位匹配;二是基于你的简历生成定制化面试追问和参考回答,让你在面试前就能模拟真实场景。

7.1 传统准备方式的低效之处

自己整理Transformer面试题,需要在知乎、B站、GitHub上翻很多资料,然后手动摘录,再花时间记背。但往往到了面试现场,被问到“你之前项目中用过Transformer吗?”你却一时想不起怎么跟自己的业务结合。

7.2 AI简历姬如何帮你提效

AI简历姬内置了“模拟面试”模块,输入你的目标岗位(比如大模型算法工程师),系统会根据你的简历内容自动生成可能的追问。比如你简历里写了“基于BERT做文本分类”,面试官很可能追问“BERT和Transformer有什么关系?预训练MLM的原理是什么?”AI简历姬会给出参考回答和反馈建议,帮你提前准备好。

7.3 落地到实操:3分钟生成一份简历+面试准备清单

如果你现在还没有一份突出Transformer技能的简历,可以直接把旧简历导入AI简历姬,系统会自动解析并结构化,然后粘贴一份大模型算法工程师的JD,它会自动匹配关键词,给出匹配度评分和缺口清单。你按照它的建议修改,不到3分钟就能生成一份过筛率更高的简历。在此基础上,再用面试模块进行模拟,整个流程一气呵成。

八、不同背景求职者的准备差异

校招、社招、转行者在准备Transformer面试题时,侧重点有所不同。

8.1 校招/应届生:重基础,轻项目

校招面试官通常期待你能够清晰地推导Attention公式、画出完整架构图、说明Mask的作用。建议多刷LeetCode式的Transformer推导题,并准备好一个参与过的项目(如课程设计)用Transformer思想解释。

8.2 社招/有经验者:重应用,深原理

社招面试更关注你如何在实际业务中使用Transformer优化模型或解决工程问题。比如“在大规模推理时如何优化Attention计算”“你如何选择Transformer的层数和头数”。这类问题需要结合实践经验回答。

8.3 转行/非科班:先建立直觉,再深入数学

对于转行者,建议先看直观的视频教程,理解Transformer解决了什么问题,再逐步看公式。不要一开始就陷入数学推导,否则容易放弃。

九、如何检验自己的掌握程度

准备效果如何?你可以用以下标准自测。

9.1 你能流利地讲出Transformer的工作流程吗?

试试看:假设面试官让你在两分钟内画图并解释Transformer,你能边画边说清楚从输入到输出的每一步吗?注意不要遗漏位置编码、Multi-Head Attention、Feed-Forward、残差和Layer Norm。

9.2 你能回答三个常见的追问吗?

| 问题 | 自测要点 |

|---|---|

| 为什么要除以√d_k? | 控制方差,稳定梯度 |

| 为什么Transformer比LSTM快? | 可并行,无递归步 |

| Decoder和Encoder的结构差异体现在哪里? | Masked Self-Attention和Cross-Attention |

9.3 你能把Transformer与当前大模型技术联系起来吗?

例如,GPT-3使用了更大的层数和参数,但架构基本保持Transformer Decoder-only;BERT使用Encoder-only;T5使用Encoder-Decoder。能说清楚不同架构的优缺点,说明你已经深入理解了。

十、常见误区与长期优化路径

很多人在准备Transformer面试题时会陷入一些误区,及时避开可以节省大量时间。

10.1 误区一:只背公式,忽视可视化理解

直接背Attention公式:Attention(Q,K,V)=softmax(QK^T/√d_k)V,却不理解它每一步在做什么。建议手动画出矩阵乘法的维度变化图,理解Query、Key、Value的物理意义。

10.2 误区二:只关注论文,不关注实际框架实现

面试官有时会问:“在PyTorch中如何编写Multi-Head Attention?”你需要知道nn.MultiheadAttention的forward参数,以及如何设置batch_first和add_bias_kv。

10.3 长期优化路径

- 第一周:精读原论文,画架构图

- 第二周:代码实现,跑通小例子

- 第三周:整理面试题库,录音口述

- 第四周:用AI简历姬进行模拟面试,查漏补缺

- 后续:关注新变体(如LLaMA的RMSNorm、Google的PaLM等),持续更新知识库

十一、Transformer面试题未来的趋势与建议

随着大模型快速发展,Transformer相关面试题也在不断演变。

11.1 从模型结构向训练和推理工程倾斜

未来面试可能更关注如何在有限显存下训练大模型(如ZeRO、模型并行、混合精度),以及如何优化推理延迟(如量化、剪枝、KV-Cache)。Transformer的基本结构是前提,但面试官更希望看到你解决实际问题的能力。

11.2 多模态与Transformer的结合

ViT(视觉Transformer)、CLIP等跨模态模型兴起,面试中可能会出现“Transformer如何处理图像”“图文匹配任务中Cross-Attention怎么设计”等问题。提前了解这些方向会让你更有优势。

11.3 数据化优化意识

很多面试官会问:“你如何评估一个Transformer模型的效果?除了loss,还关注什么?”建议你准备一些指标,比如Perplexity、BLEU、ROUGE,以及在实际落地中关注的响应速度、吞吐量等。用数据说话,比空谈理论更有说服力。

十二、总结:把Transformer面试题准备扎实,关键在于理解原理和结构化表达

回到开头的问题,大模型算法工程师面试中Transformer题目虽然覆盖面广,但只要你抓住“结构-原理-应用”这条主线,配合持续的练习和输出,完全可以从容应对。核心不是记住所有细节,而是能用自己的话清晰讲出关键设计的原因和场景。

如果你希望更快完成简历与面试的准备,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它不仅能帮你把简历优化得更匹配岗位,还能围绕你的简历生成定制化面试题和回答建议,让你在面试前就胸有成竹。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:大模型算法工程师面试Transformer,到底应该先做什么?

回答:建议你先做两件事:第一,读一遍原论文《Attention Is All You Need》,边读边画出整体架构图。第二,用PyTorch手写一个简化版的Transformer,并跑通一个翻译或文本生成demo。这两步能让你从理论和实践两个维度彻底理解Transformer。之后再去整理面试题库,你会发现很多问题都迎刃而解。

问题2:Transformer面试题里最容易出错的是哪一步?

回答:最容易出错的是位置编码的说明和多头注意力中维度的变化。很多人讲不清为什么用正弦余弦函数而不是整数,也容易被问到“输入维度是512,8个头,每个头维度是64,最后怎么合并?”就把维度算错了。建议你在纸上完整推导一次矩阵的维度变化,并记住每个步骤的shape。

问题3:AI工具在准备Transformer面试题里到底能帮什么?

回答:AI工具主要帮你解决两个痛点:一个是知识结构化,比如你输入“Transformer面试”相关内容,工具可以帮你自动生成知识点思维导图或问答对;另一个是模拟实战,像AI简历姬可以根据你的简历和目标岗位生成定制追问,并给出口头回答模板,让你在面试前就能像真实场景一样演练,避免临场慌乱。

问题4:校招学生做Transformer面试准备时应该注意什么?

回答:校招最忌讳的是“只背不练”。建议你不仅要理解公式,还要准备一个与Transformer相关的项目经历(哪怕是课程设计或竞赛),并且能把项目拆解为:问题、方法、实验、结论。面试官很可能会追问:“你在这个项目里用了Transformer的哪个变体?为什么选择它?遇到了什么困难?”你需要能自圆其说。