如果你正在准备大模型岗位的面试,MoE(Mixture of Experts,混合专家模型)几乎是绕不开的高频题。很多候选人习惯先背一遍概念,再记几个公式,但面试官更想考察的是:你能否把MoE的好处说清楚?负载均衡为什么难?路由策略怎么设计?以及——你在实际项目中用过吗?

这篇文章会从面试官视角出发,帮你拆解MoE的底层逻辑、常见追问、避坑技巧,以及如何用工具把准备过程变得可量化、可复盘。全文围绕“LLM工程师面试题MoE”展开,覆盖概念、对比、实操、提效四个层面。如果你正处在秋招或跳槽窗口期,读完这篇至少能节省3天翻资料的时间。

一、MoE面试题为什么成为“必考点”

1.1 大模型规模化与效率的矛盾

当前LLM的参数量动辄千亿甚至万亿。如果用传统的稠密Transformer训练,计算成本和显存消耗会指数级上升。MoE通过稀疏激活机制,在保持模型容量的同时大幅降低每次推理的计算量,因此成为主流方案(如GPT-4、Mixtral 8x7B等)。面试官希望通过MoE考察你是否理解“效率与效果”的权衡。

1.2 面试高频体现“系统思维”

MoE不是孤立的架构改动,它涉及路由策略、负载均衡、分布式训练、显存优化等多个系统层面的问题。能清晰回答MoE原理,说明你对大模型工程有全局认识。很多岗位JD会明确要求“熟悉MoE架构”,面试题自然成为筛选门槛。

1.3 从论文到落地的完整链路

MoE最早在2017年《Outrageously Large Neural Networks》中被提出,但直到近年才在工业界大规模应用。面试官问MoE,也是在问你是否关注前沿演进、是否有读论文并落地的能力。

二、MoE核心概念:从专家网络到门控机制

2.1 什么是MoE?一句话说明白

MoE(Mixure of Experts)的核心思想是:训练多个“专家”子网络,但每个输入只激活其中少数几个。由门控网络(Router)决定哪个/哪些专家被使用,从而在推理时只计算部分参数。

2.2 门控网络的两种主流形式

- Top-k路由:选择得分最高的k个专家。比如Mixtral 8x7B采用Top-2,每个token激活2个7B专家,计算量约等于14B模型,但参数量相当于47B(8×7B-共享参数)。

- 噪声Top-k:在Top-k中加入可学习的噪声,鼓励探索,防止路由坍缩(所有token都去同一个专家)。

2.3 负载均衡的必要性

如果门控网络总是选择少数几个专家,大部分专家得不到充分训练,模型能力无法最大化。因此需要添加负载均衡损失(Load Balancing Loss),鼓励专家被均匀使用。常见的实现有Switch Transformer中的辅助损失、或Expert Choice路由。

面试常见追问:“负载均衡loss怎么加?加多大权重?会不会影响主任务效果?”

三、MoE与传统Transformer架构的核心区别

| 维度 | 传统Transformer | MoE Transformer |

|---|---|---|

| 前馈网络(FFN) | 所有token通过同一组FFN | 每个token通过不同专家的FFN |

| 参数量 | 固定,与层数线性增长 | 可远远超过计算量(稀疏激活) |

| 推理计算量 | 与参数量成正比 | 与激活参数量成正比 |

| 训练难度 | 相对稳定 | 需处理负载均衡、专家崩溃 |

| 显存占用 | 模型参数全部加载 | 所有专家参数需加载,但每次计算只激活部分 |

3.1 核心差异:稀疏 vs 稠密

稠密模型在每个FFN层都计算全部参数;MoE模型每个FFN层被替换为多个专家,但只激活其中少数。面试官常追问:“为什么MoE可以扩大参数量而不增加推理延迟?” 回答要点:延迟取决于激活参数量,而不是总参数量。

3.2 专家间的参数是否共享?

大部分MoE实现中,专家之间不共享参数,每个专家独立学习不同的知识模式。但也有些变体(如BASE Layers)让专家共享底层特征。

3.3 训练时需要注意什么?

- 显存:所有专家都需要加载到显存,对于千亿模型需要多机多卡。

- 数据并行与模型并行:MoE通常结合专家并行(Expert Parallelism),每个GPU负责部分专家。

- 通信开销:all-to-all通信在门控与专家之间频繁发生。

四、MoE面试中必问的六大常见问题

| 问题 | 考察点 | 回答框架 |

|---|---|---|

| 为什么MoE比稠密模型效果好? | 容量与计算解耦 | 更多专家意味着更大容量,且稀疏激活防止过拟合 |

| 如何解决专家坍缩? | 负载均衡机制 | 加辅助loss、使用softmax温度、或者Expert Choice |

| MoE在推理时如何部署? | 工程理解 | 模型合并(Merge)或动态专家加载 |

| 路由网络的训练策略? | 优化细节 | 梯度估计、ST-Gumbel-Softmax等 |

| MoE与亿级参数的优化器如何适配? | 分布式训练 | ZeRO、FSDP与MoE结合时的通信模式 |

| 你在实际项目中用过MoE吗? | 动手能力 | 如用Megatron-LM跑过MoE,或自己实现过一个简化版 |

4.1 第一个问题:为什么MoE比稠密模型效果好?

不仅因为参数更多,更因为MoE让模型学习到分而治之的范式:不同专家自动擅长处理不同类型的token(比如标点、停用词、专业术语)。这是一种隐式的结构化先验。

4.2 第二个问题:如何防止专家坍塌?

- 添加辅助负载均衡loss(典型值0.01);

- 使用noisy Top-k路由增加随机性;

- 在训练初期强制均匀分配(例如每个batch按专家均匀采样)。

4.3 第三个问题:工程部署有哪些坑?

推理时所有专家都需要加载到显存,但一次只激活少数。因此部署时需要对专家进行量化或专家卸载(offloading),否则显存占用依然很大。

五、如何系统准备MoE面试题(方法论)

5.1 从论文导图到面试答案

- 必读论文:

- 《Outrageously Large Neural Networks: The Sparsely-Gated MoE Layer》

- 《Switch Transformers: Scaling to Trillion Parameter Models》

- 《Mixtral of Experts》

- 《GShard: Scaling Giant Models with Conditional Computation》

- 整理笔记:将每篇论文的动机、方法、实验、不足写成200字以内卡片,面试时直接引用。

5.2 构建分层知识树

MoE

├── 原理

│ ├── 路由机制

│ ├── 专家设计

│ └── 负载均衡

├── 训练

│ ├── 分布式策略

│ ├── 显存优化

│ └── 稳定性技巧

└── 应用

├── Sparse MoE

├── Dense MoE

└── 最新变体(如DeepSeek MoE)

5.3 模拟面试闭环

不要只背诵,练习口头表达。可以先用录音自我讲解,再找朋友模拟面试。重点看自己能否在5分钟内说清MoE的“是什么、为什么、怎么做”。

六、MoE面试中的实操技巧与避坑指南

6.1 面试官最反感的三个错误

- 只背定义不举例:没有结合具体模型(如Mixtral 8x7B)解释。

- 混淆稀疏激活与稀疏网络:MoE的稀疏体现在激活,而不是参数本身的稀疏(比如剪枝)。

- 无视工程细节:只会理论,不知道负载均衡loss的具体实现。

6.2 如何用“STAR法则”回答项目经验

如果简历上有MoE相关项目(即使只是调参),用STAR框架组织:

- Situation:当时模型训练loss下降慢/显存不够;

- Task:更换为MoE架构;

- Action:使用Fairscale实现Top-2路由,添加负载均衡loss;

- Result:训练速度提升20%,效果持平。

6.3 准备反问的问题

面试最后,可以问:“贵司当前LLM部署用MoE吗?遇到的最大负载均衡问题是什么?” 体现深度。

七、用AI工具提升MoE面试准备效率

7.1 传统方式的低效点

很多求职者准备面试时,先花大量时间翻博客、看论文、记笔记。问题是:知识点零散,难以形成回答框架;另外,简历上关于MoE的项目经历往往写得很笼统,面试官追问细节就答不上来。

7.2 AI如何帮到你:从简历优化到面试模拟

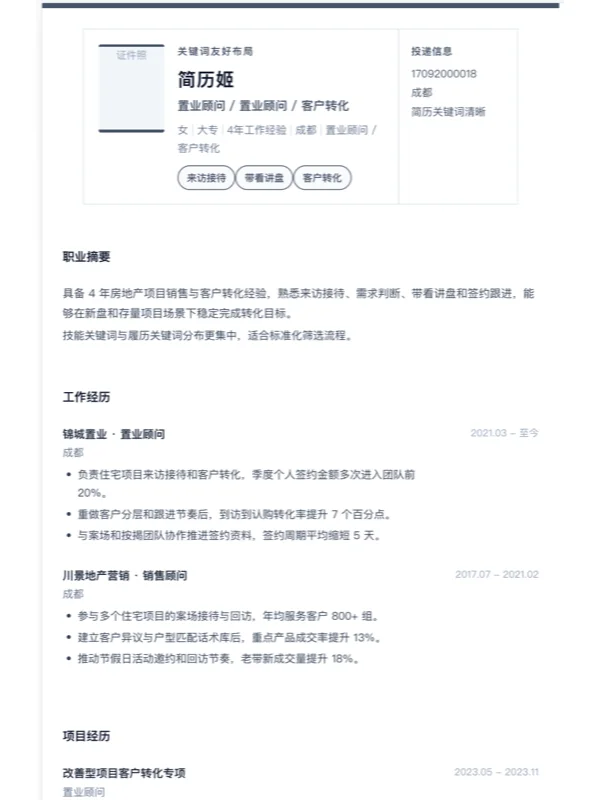

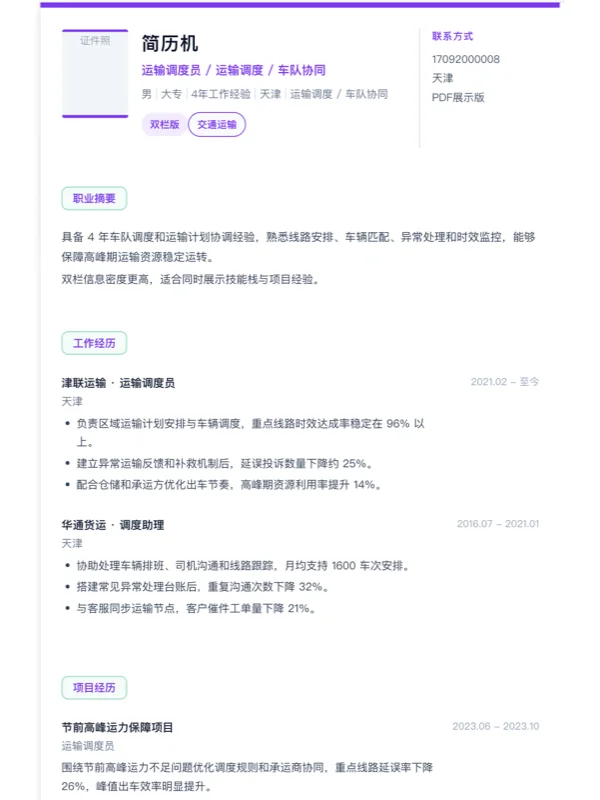

AI简历姬可以帮你做三件事:

- 把MoE项目经历STAR结构化:导入旧简历,粘贴岗位要求(JD),系统会自动识别“MoE”“专家网络”等关键词,并建议将经历改写为成果导向的表述。

- 生成定制面试追问:基于你的简历+目标岗位,自动生成面试官可能追问的MoE细节问题(比如“你负载均衡loss的权重设了多少?为什么?”)。

- 模拟面试反馈:你口头回答后,AI会给出参考回答和提升建议,先诊断再优化。

7.3 3分钟生成可投递简历初稿

如果你之前没有在简历中突出MoE相关技能,可以用AI简历姬导入现有简历,系统自动解析并修复关键信息。然后粘贴一个要求“熟悉MoE架构”的JD,系统会把JD中的关键词逐条对齐到你的经历,给出匹配度评分和缺口清单,帮你快速补齐。

核心能力:过筛不秒挂——通过ATS友好格式和关键词对齐,降低HR机器筛选阶段的淘汰风险。

八、不同背景候选人准备MoE面试的差异

8.1 学术背景(研究生/博士)

优势:对理论推导、论文细节熟悉。

短板:容易陷入数学细节,忽略工程落地。

建议:多讲你读过的MoE论文的实验设置、baseline对比;花时间了解Megatron-LM或DeepSpeed中的MoE实现。

8.2 工程背景(后端/算法工程师)

优势:熟悉分布式训练、显存优化。

短板:对路由机制、损失函数等细节可能不深。

建议:从工程角度切入,解释communication overhead、显存优化策略(如ZeRO + MoE),并自学负载均衡loss的原理。

8.3 转行背景(从NLP、CV转大模型)

优势:对原有领域理解深,能类比说明。

短板:对MoE在大模型中的重要性认识不足。

建议:先快速通读3篇核心论文,并用AI简历姬梳理项目经历中与“稀疏激活”“多专家”相关的部分,哪怕只是用attention层做类比。

| 背景 | 核心优势 | 注意提升 |

|---|---|---|

| 学术 | 理论深度 | 工程实践 |

| 工程 | 系统优化 | 算法细节 |

| 转行 | 类比迁移 | 基础知识 |

九、检验MoE面试准备的四个关键指标

9.1 知识覆盖率:你能回答多少Open问题?

用下表自检:

| 问题 | 能否清晰回答(3分钟内) | 是否需要补强 |

|---|---|---|

| 门控网络的梯度是怎么回传的? | □ 能 □ 不能 | |

| 为什么Top-2比Top-1更常用? | □ 能 □ 不能 | |

| MoE训练时所有专家都需要梯度同步吗? | □ 能 □ 不能 | |

| 讲一下你所知的MoE变体(如DeepSeek MoE)? | □ 能 □ 不能 |

9.2 表达流畅度:能不能不用“嗯”“啊”地说完?

录音自测,如果卡顿超过3次,需要重新组织表达逻辑。

9.3 简历与面试的一致性

确保简历中提到的MoE项目细节(如专家数量、路由方式)能与面试回答一致。AI简历姬的“诊断+改写闭环”可以帮你纠正不一致的地方。

9.4 实战模拟分数

使用AI模拟面试功能,每次模拟后得到能力雷达图,重点关注“模型架构”维度是否达80%以上。

十、MoE面试后的复盘与长期学习机制

10.1 面试后立即记录遗漏点

建议用Notion或飞书建一个“大模型面试复盘表”,每次面试后记录被问到的MoE题目、自己的回答、面试官的表情或追问。一周后重答一遍。

10.2 持续跟踪新论文

MoE方向发展迅速(如DeepSeek-V2的Multi-Head Latent Attention + MoE、DRAMoE等)。建议订阅arxiv“cs.CL”分类,每周浏览MoE相关论文摘要。

10.3 多版本简历维护

随着你对MoE理解的加深,简历中相关描述也要迭代。AI简历姬的“一岗一版/多版本管理”功能,可以让你针对不同岗位(偏研究/偏工程)保留不同侧重点的简历版本,投递看板帮你追踪每个版本的效果。

十一、MoE在LLM领域的未来趋势与面试新方向

11.1 从Sparse到Dense再到Sparse的螺旋演进

早期MoE是稀疏的,后来Switch Transformer证明了稀疏在大规模下的优势。但近期有工作(如Mixture-of-Depths)探索结合动态计算,面试可能问到“MoE与MoD的区别”。

11.2 端侧MoE与小模型

为了在手机/笔记本上运行大模型,MoE也在变小(如个人电脑的MoE模型)。面试可能问“如何压缩MoE到端侧?”。

11.3 自动路由与量化协作

未来路由策略可能不再依赖Top-k,而是用强化学习或可微分搜索。同时专家量化(如INT4)支持显存节省。这些工程化问题会越来越多出现在面试里。

十二、总结:把MoE面试题准备落地,关键在于系统化+实战模拟

12.1 三个核心行动

- 建立知识体系:阅读论文并整理笔记,形成5分钟阐述框架。

- 优化简历项目:用STAR结构改写MoE相关经历,突出个人贡献。

- 高强度模拟面试:不止背题,要能应对追问。

12.2 调整心态,降低焦虑

面试准备不是一场百米冲刺。MoE知识点虽然多,但核心逻辑清晰。先理解“为什么要稀疏”,再理解“怎么选专家”,最后理解“训练有哪些坑”。如果遇到不懂的地方,先标记下来,再找对应论文补齐。求职是个系统工程,给自己留足时间,每一步都走扎实,结果自然水到渠成。

12.3 用工具让准备更高效

如果你希望更快完成MoE相关项目的简历优化以及面试模拟,也可以借助 AI简历姬,它能帮你把“投递—面试—复盘”做成可管理闭环。从导入旧简历、诊断匹配度到生成面试追问,3分钟就能得到一份可投递的版本。

这里也提供一个可直接体验的入口:

👉 AI简历姬 - 过筛不秒挂,面试更稳

精品问答

问题1:LLM工程师面试题MoE里到底应该先准备什么?

回答:建议按优先级排序:第一,能用3分钟讲清MoE是什么(稀疏激活、门控、专家);第二,能说出至少两种负载均衡策略及其优缺点;第三,能结合你简历中的实际项目或课程项目说明应用场景。如果时间紧张,先把前两点练熟,其他细节可以边投递边补充。

问题2:MoE面试题里最容易出错的是哪一步?

回答:最容易出错的是“门控网络的梯度如何反向传播”。很多人以为门控是离散的选第k个,不能用梯度,实际上在训练时使用softmax加straight-through估计或gumbel-softmax来解决。面试官一问这个,很多人就卡住了。建议提前画一下计算图。

问题3:AI工具在准备MoE面试题里到底能帮什么?

回答:AI工具能解决两个核心痛点:一是把散乱的知识点变成结构化的面试回答框架(比如AI简历姬的模拟面试模块);二是把简历中被忽略的MoE相关细节优化为STAR表述,提升面试官对项目深度的感知。注意工具只是辅助,关键还是你自己要理解并内化。

问题4:转行做LLM工程师,准备MoE面试应该注意什么?

回答:转行者不要强求自己理解所有论文细节,而是先理解MoE为什么存在(解决大模型效率问题),再对比传统架构。同时要在简历上展示“我能上手”——比如调过MoE的config、跑过开源模型。AI简历姬可以帮你把哪怕很小的使用经历包装成有逻辑的成果,但不要虚构,实事求是最重要。