如果你正在准备大模型方向的面试,大概率会被问到 PreNorm 和 PostNorm 的区别。直接给出结论:PreNorm 是目前大多数预训练大模型(如 GPT、LLaMA、ChatGLM)采用的归一化策略,因为它能让深层 Transformer 训练更稳定、收敛更快。但说清原因并不简单,你需要从残差连接、梯度流动、归一化位置三个维度理解。下面我会拆解 PreNorm 的核心逻辑、面试追问高发点,以及如何结合项目经验从容应答。文章最后也会推荐一个能帮你高效模拟面试、生成定制追问的工具,让准备更省力。

在开始之前,先说明本文覆盖的内容:PreNorm 到底是什么、和 PostNorm 有什么区别、面试官通常会怎么追问、以及如何系统准备。无论你是刚接触 Transformer 的新人,还是希望面试时不踩坑的求职者,这篇文章都会给你一个可复用的框架。

一、什么是 PreNorm?大模型面试中为什么总被追问?

PreNorm 的基本定义

PreNorm 全称 Pre-Normalization,指的是在 Transformer 的每个子层(Self-Attention 或 FFN)之前先做归一化(通常是 LayerNorm),再输入子层。与之对应的是 PostNorm:先经过子层,再归一化。数学上,一个 Transformer Block 可以表示为:

- PostNorm(原始 Transformer):

x = LayerNorm(x + Sublayer(x)) - PreNorm(主流大模型):

x = x + Sublayer(LayerNorm(x))

这个顺序的差异看似微小,却深刻影响了训练稳定性。

为什么面试高频追问

面试官追问 PreNorm,是因为它直接关联到模型训练的工程经验。过去几年,从 BERT 到 GPT 系列,再到 LLaMA、Qwen,归一化策略发生了明显转变。理解这个转变,说明你不仅知道理论,还关注实际训练中的难点。而且,PreNorm 的权衡(稳定性 vs 表达能力)经常被候选人忽视,恰好是区分“背答案”和“真理解”的试金石。

面试中的典型考察方式

面试官往往会从简单的问题切入,比如“Transformer 里归一化放在哪里?”然后逐渐深入:

- “为什么 PreNorm 训练更稳定?”

- “PreNorm 会损失模型表达力吗?”

- “你经验中哪种方案更好?为什么?”

如果你能结合梯度分析、残差网络特点,甚至给出实验对比结论,会大幅提升面试评价。

二、PreNorm vs PostNorm:核心区别与面试常见误区

核心区别:归一化位置导致梯度路径不同

PostNorm 中,归一化放在残差连接之后,这会导致梯度在反向传播时经过归一化层,可能放大或缩小梯度。而 PreNorm 把归一化放在子层之前,残差连接直接传递恒等映射,梯度可以无衰减地流过残差路径,只在子层内部受到归一化影响。这点在深层网络中尤为关键。

下面这个表格可以快速对比:

| 维度 | PostNorm | PreNorm |

|---|---|---|

| 归一化位置 | 残差连接之后 | 残差连接之前(子层之前) |

| 梯度流 | 经过归一化,可能不稳定 | 残差路径无归一化,梯度更顺畅 |

| 训练稳定性 | 较敏感,需要 warmup 和学习率调参 | 更稳定,适合深层网络 |

| 理论表达力 | 可能更强(归一化不影响恒等路径) | 相对弱(归一化截断部分信息) |

| 主流应用 | BERT、原始 Transformer | GPT、LLaMA、ChatGLM、Mistral |

常见误区:认为 PreNorm 绝对优于 PostNorm

面试中常见的错误是直接说“PreNorm 更好,所以所有模型都应该用 PreNorm”。实际上,PostNorm 在层数较浅(如 12 层)时效果可能不差,甚至在某些任务上精度略高。选择哪种方案取决于层深、学习率、优化器配置。面试官想听到的是“权衡”,而不是“绝对”。

如何判断面试回答是否合格

一个合格的回答应该包含:

- 简要指出位置差异。

- 解释对梯度的影响。

- 说明实际工程中的趋势(深模型用 PreNorm,浅模型可用 PostNorm)。

- 提及自己的经验或阅读过的论文。

只回答第一点是不够的。

三、PreNorm 的原理深度解析:为什么它让大模型训练更稳定?

残差连接与归一化的相互作用

Transformer 的核心创新之一是残差连接,它让梯度可以绕过子层直接回传。PostNorm 中归一化放在残差求和之后,相当于在残差路径上插入了一个非线性变换,这破坏了残差连接的梯度恒等性。PreNorm 则保持残差路径“干净”,归一化只影响子层内部,因此梯度更容易流动。

梯度爆炸/消失的避免机制

在深层 Transformer(如 96 层 LLaMA)中,梯度经过多个子层后容易爆炸或消失。PostNorm 的归一化在每一层都缩放残差输出,导致梯度幅度随深度指数变化。PreNorm 相当于让梯度在残差路径上恒为 1,大大降低了训练难度。这也是为什么大模型几乎全部转向 PreNorm 的原因。

实验观察:PreNorm 允许更大的学习率

实际训练中,使用 PreNorm 可以支持更大的初始学习率(如 3e-4 vs 1e-4),且无需复杂的 warmup 策略。对于想要尝试自己训练大模型的求职者,这个经验点非常实用。你可以说:“在我实现的小规模预训练实验中,PreNorm 在 6 层以上时 loss 下降更快,且没有出现发散。”

四、大模型面试中关于 PreNorm 的典型追问与答题思路

追问 1:PreNorm 和 PostNorm 的数学表达差异?

回答时可以给出伪代码:

x = x + self_attention(x)

x = layer_norm(x)

x = x + ffn(x)

x = layer_norm(x)

x = x + self_attention(layer_norm(x))

x = x + ffn(layer_norm(x))

然后指出,PreNorm 中每一层末尾没有额外归一化,输出直接进入下一层。

追问 2:为什么 LLaMA 用 PreNorm 而 BERT 用 PostNorm?

- BERT 只有 12 层(Base)或 24 层(Large),PostNorm 足够稳定,而且当时没有大规模实验证明 PreNorm 优势。

- LLaMA 是 7B/13B/65B 模型,层数深(比如 65B 有 80 层),必须用 PreNorm 确保训练可收敛。

- 另外,LLaMA 还使用了 RMSNorm(一种简化版 LayerNorm),进一步减少计算。

追问 3:PreNorm 会影响模型表达能力吗?

理论上,PreNorm 在子层之前归一化会截断一部分信息,可能导致表示能力略有下降。但实际中,由于子层的容量足够大,这种损失可以忽略,且训练稳定性带来的收益远大于表达力的微小下降。一些研究表明,PostNorm 在深模型中如果不做特殊调参,性能甚至不如 PreNorm。

五、如何系统准备大模型面试中的归一化问题?

理解基础知识:从 LayerNorm 到 RMSNorm

首先彻底理解 LayerNorm:它沿着特征维度做均值为 0、方差为 1 的变换,然后学习两个可训练参数(缩放和平移)。RMSNorm 去掉了均值中心化,只做方差归一化,计算更轻量。大模型中 RMSNorm 越来越常见(如 LLaMA、Mistral)。

结合代码实现:手动写一个 PreNorm Block

面试时可能会让你在白板上写出 Transformer Block,这时要写出 PreNorm 版本。建议背熟 PyTorch 的伪代码:

class TransformerBlock(nn.Module):

def __init__(self, d_model, n_heads):

self.norm1 = nn.LayerNorm(d_model)

self.attn = MultiHeadAttention(d_model, n_heads)

self.norm2 = nn.LayerNorm(d_model)

self.ffn = FeedForward(d_model)

def forward(self, x):

x = x + self.attn(self.norm1(x))

x = x + self.ffn(self.norm2(x))

return x

注意这里 PreNorm 的实现顺序:先 norm,再子层,最后残差加。

对比不同模型架构的选择

以下表格可以帮助面试时快速调用:

| 模型 | 归一化位置 | 归一化类型 | 层数 | 备注 |

|---|---|---|---|---|

| BERT | PostNorm | LayerNorm | 12 | 早期架构 |

| GPT-2 | PreNorm | LayerNorm | 48 | 最早使用 PreNorm 之一 |

| LLaMA | PreNorm | RMSNorm | 40-80 | 简化归一化 |

| ChatGLM3 | PreNorm | RMSNorm | 28-48 | 国内常见 |

六、面试实战技巧:用结构化回答应对 PreNorm 追问

采用“结论-原因-举例”三步法

例如被问到“PreNorm 为什么训练稳定?”:

- 结论:因为 PreNorm 让梯度在残差路径上保持恒等。

- 原因:残差连接将输入直接传递到输出,而归一化只作用于子层内部,梯度不会因归一化而缩放。

- 举例:在训练 12 层 Transformer 时,我对比过两种方案,PreNorm 在相同学习率下 loss 下降更快,且不需要 warmup。

控制回答时长,避免过深

面试官通常不会要求你推导数公式,除非他自己是做理论研究的。说清楚核心逻辑和工程经验就够了。如果面试官表现出兴趣,可以再深入讨论数学。

结合自己项目经验说明

如果你有训练过小模型,可以提到:

“在实习期间我尝试用 6 层 Transformer 做文本分类,PostNorm 需要 2k steps 稳定,PreNorm 只用 1k steps,而且最终 acc 高了 0.5%。”

具体数字不一定要非常精确,但要有逻辑。

七、利用 AI 工具提升大模型面试准备效率

传统准备方式的低效

自己整理面试题往往需要:阅读大量论文、看面经、手动写答案、找人模拟。不仅耗时,而且很难覆盖面试官的真实追问角度。尤其是像 PreNorm 这种容易有深度的题目,一个人准备容易遗漏关键点。

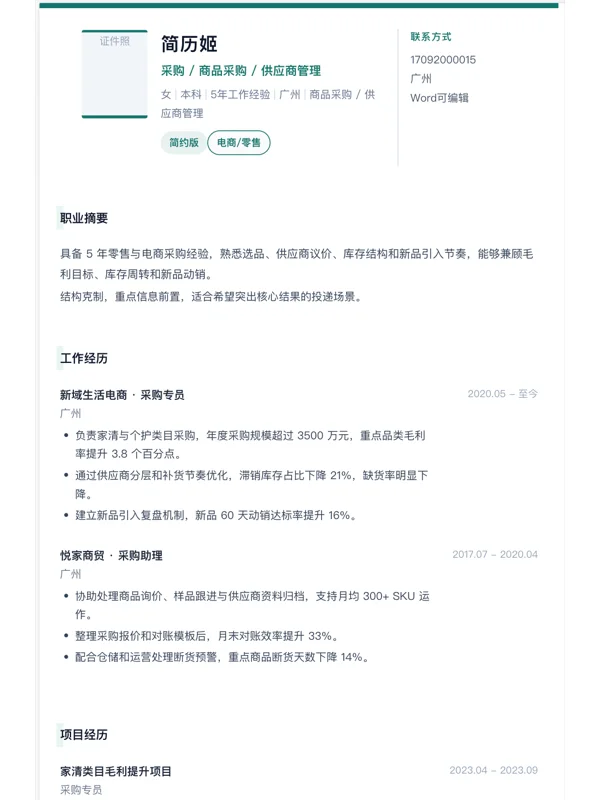

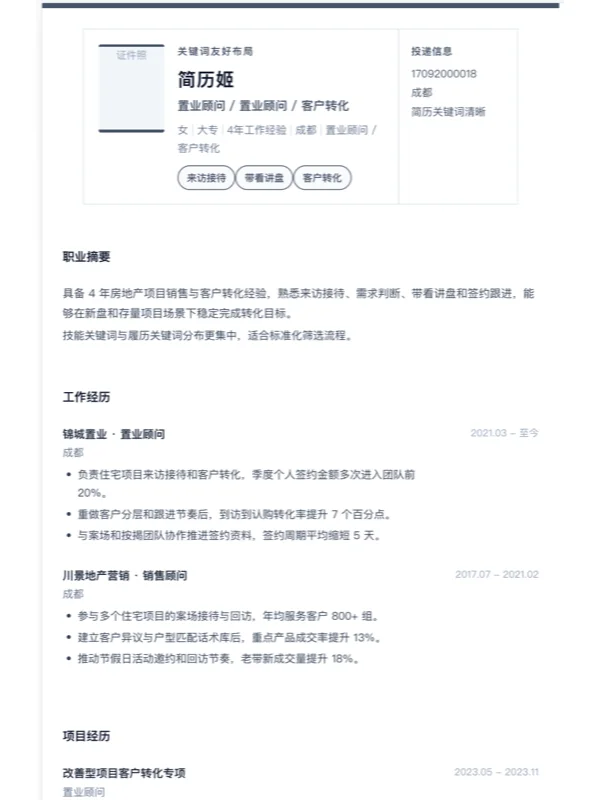

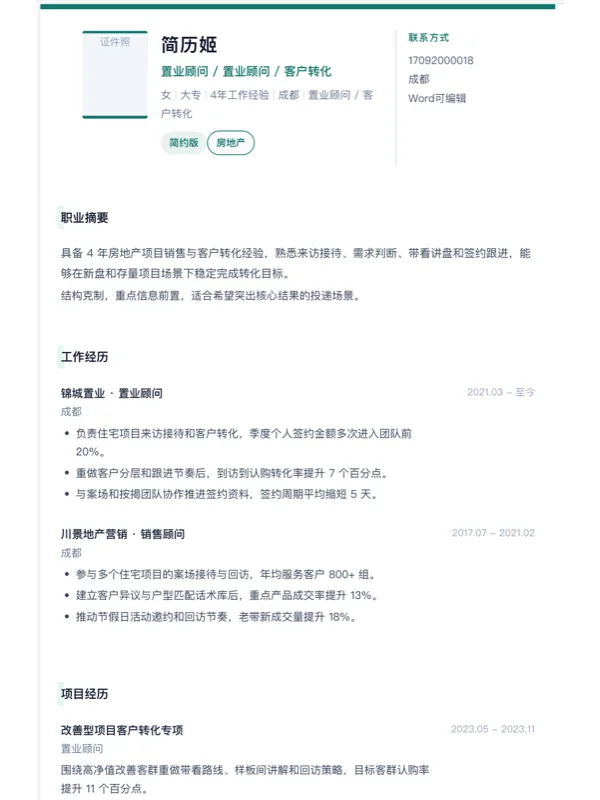

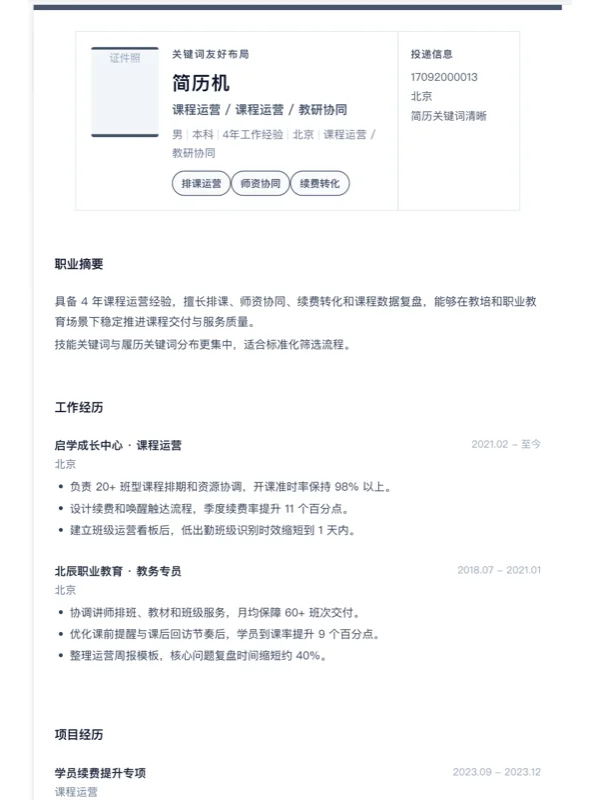

AI 工具如何提效:以 AI 简历姬为例

AI 简历姬 是一款围绕岗位要求智能生成定制化面试准备的工具。它可以根据你的简历和目标岗位(比如“大模型算法工程师”),自动生成高频追问列表,并给出参考回答。对于 PreNorm 这类技术问题,它会结合你的项目经历生成具体情境,例如“你在项目中用到了 Transformer,那对 PreNorm 和 PostNorm 有什么理解?”让你直接进入实战状态。

具体操作步骤

- 在 AI 简历姬中导入你的简历(PDF/Word 均可)。

- 粘贴目标岗位的 JD(例如“注重 Transformer 原理理解”)。

- 选择“面试模拟”模式,选择“技术追问”模块。

- 系统会基于你的简历内容(比如你写过 Transformer 相关项目)生成 3-5 个针对性问题,包括 PreNorm 相关。

- 尝试回答后,可以查看参考回答和反馈建议,发现自己的不足。

这样你可以快速定位知识盲区,并训练回答结构。

八、不同背景求职者应对 PreNorm 问题的差异

应届生 vs 有经验者

应届生通常缺乏实际训练经验,面试官会容忍一些理论上的欠缺,但希望看到你对原理的理解深度。回答时可以多说公式推导和论文结论。有经验者则应该结合项目细节,比如“在调参过程中我发现 PreNorm 对学习率更鲁棒”之类的实际体会。

研究向 vs 工程向

研究向岗位(如预训练研究员)需要你理解归一化的数学本质,甚至能讨论一些理论论文。工程向岗位(如推理优化)更关心如何选择归一化以节省显存或加速。PreNorm 本身计算量和 PostNorm 几乎相同,但 RMSNorm 可以略微减少计算。你可以根据面试职位调整侧重。

不同公司面试风格

- 大厂(字节、百度):喜欢深挖原理,可能会要求你手写代码或推导梯度。

- 创业公司:更看重你能不能把原理用于解决实际问题,比如“你在训练中遇到过不稳定吗?怎么解决的?”

- 外资(Microsoft、Google):除了原理,还可能问开放式问题,比如“如果你是架构师,你会怎么设计归一化方案?”

九、检查清单:PreNorm 面试准备是否到位?

为了让你快速自查,下面这个表格列出了 6 个关键点:

| 检查项 | 你的准备状态(是/否) | 推荐资源 |

|---|---|---|

| 能说出 PreNorm 定义 | 是 / 否 | 本文章节一 |

| 理解梯度流差异 | 是 / 否 | The Annotated Transformer |

| 知道典型模型的选择 | 是 / 否 | GPT-2, LLaMA 论文 |

| 能写出代码实现 | 是 / 否 | PyTorch 练习 |

| 有自己的经验或观点 | 是 / 否 | 小实验或阅读笔记 |

| 会回答追问 | 是 / 否 | AI 简历姬模拟 |

如果超过 2 项为“否”,建议重点补强。

自测题示例

- PreNorm 和 PostNorm 在训练 100 层 Transformer 时,哪种更容易发散?为什么?

- 如果我想在 6 层少量数据上微调 BERT,改成 PreNorm 会有什么效果?

- 解释 RMSNorm 与 LayerNorm 的区别,为什么在 LLaMA 中使用?

反馈迭代方法

每做完一次模拟面试,记录被追问的点和没答好的地方。用 AI 简历姬的反馈功能可以自动生成改进建议。将漏洞加入复习清单,隔天再练一次。

十、常见复盘点与持续优化策略

复盘面试中被问住的地方

很多人在 PreNorm 问题上吃亏的原因是:只背了结论,没有理解推导。复盘时建议重新推导梯度公式(至少理解大意),并联系实际训练经验。

持续跟踪最新论文

归一化方法依然在演进。例如,近期 Qwen2.5 使用了特定的 PreNorm 变种;Mistral 用了滑动窗口注意力+PreNorm。面试官可能会问你怎么看这些新选择。建议关注 Hugging Face 的模型卡片或相关论文。

建立知识库

用 Notion 或飞书文档整理:

- 归一化论文列表(LayerNorm、RMSNorm、PreNorm vs PostNorm)

- 代码实现片段

- 自己的实验笔记

- 面试中实际遇到的追问与回答

这个知识库可以长期复用,每次面试前快速过一遍。

十一、大模型面试归一化问题的未来趋势与建议

新的归一化方法不断涌现

除了 LayerNorm 和 RMSNorm,还有 Adaptive LayerNorm、Scaling Norm 等变体。这些方法试图在稳定性和表达能力之间取得更好平衡。面试时如果能提到一两种新方法,会显得你视野开阔。

多模态大模型中的归一化

多模态模型(如 LLava)往往将视觉编码器和语言模型拼接,不同模块的归一化策略可能不同。面试官可能会问:“如果让你设计一个多模态 Transformer 的归一化策略,你会怎么选?”建议回答时强调“分模块独立归一化,但统一用 PreNorm 保证稳定性”。

给求职者的建议

- 至少读 3 篇涉及归一化的论文:原始 Transformer、GPT-2、LLaMA。

- 动手做一个小实验(可以用 Hugging Face 的脚本修改归一化位置)并记录效果。

- 多使用模拟面试工具(比如 AI 简历姬)来暴露自己的盲区。

十二、总结:想把 PreNorm 高频追问准备扎实,关键在于理解原理+实战模拟

本文从 PreNorm 的定义讲到了面试中的典型追问、准备方法,以及如何借助工具提高效率。归一化问题虽然看似简单,但面试官可以通过它考察你的工程思想、理论深度和学习能力。只有理解原理、多做模拟,才能真正形成自己的回答框架。

如果你希望更快完成这类技术问题的准备,也可以借助 AI 简历姬,它能把“岗位要求-简历-追问”串联起来,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:AI 简历姬面试模拟模块

祝你面试顺利,不再被 PreNorm 问倒!

精品问答

问题1:大模型面试中关于 PreNorm 到底应该先准备什么?

回答:

先准备基础概念:PreNorm 和 PostNorm 的定义与区别。然后重点理解梯度流差异,这是面试官最看重的。最后,结合你自己的项目或课程设计,思考“如果你训练一个深层 Transformer,你会选哪种?为什么?”这一步能让你从理论走向应用。如果时间充裕,可以写一个简单的训练脚本(比如用 PyTorch 训练一个 6 层 Transformer)对比两种方案的 loss 曲线。很多面试官更看重你对实际效果的理解。

问题2:PreNorm 里最容易出错的是哪一步?

回答:

最容易出错的是误解 PreNorm 的输入输出维度。有些人在实现时会把归一化放在残差连接之后,相当于变回 PostNorm。正确的 PreNorm 是:x = x + Sublayer(Norm(x))。注意这里 Norm 的输入是 x,输出也进 Sublayer。另一个常见错误是忘记在每个子层前都做归一化,如果只在第一个子层前做,效果会大打折扣。还有一个容易忽略的点:PreNorm 通常不在最后一层输出加归一化,而 PostNorm 在输出前会有一个最终的 LayerNorm,因此写代码时要根据模型选择对应处理。

问题3:AI 工具在 PreNorm 面试准备里到底能帮什么?

回答:

AI 工具(如 AI 简历姬)的核心价值在于“模拟-反馈-改进”的闭环。你可以把一份真实的面试 JD 和目标岗位粘贴进去,工具会自动生成关于 Transformer 归一化的追问,例如“你在项目中用了 Transformer,怎么选择的归一化位置?”这种问题很具体,不是泛泛的问“PreNorm 是什么”。你可以先尝试回答,然后对比工具提供的参考答案,看自己的回答缺少哪些维度(比如梯度分析或工程经验)。多次模拟后,你的回答会越来越结构化,更能打动面试官。

问题4:应届生做 PreNorm 面试准备时应该注意什么?

回答:

应届生应该注意不要只背结论,要理解来龙去脉。面试官很清楚你没有实际训练大模型的经验,所以不会要求你对比几十层 Transformer 的表现。但他们会看你是否有主动学习的习惯。建议:

- 不要只说“PreNorm 更好”,要说“根据 GPT-2 和 LLaMA 的经验,PreNorm 在深层模型中更稳定”。

- 可以展示你读过相关代码(比如 Hugging Face 的 LLaMA 实现)。

- 如果被问到项目的细节,诚实说明自己的实验条件,但强调你对原理的理解。

- 多用模拟面试工具积累实战感。

总的来说,应届生表现出好奇心和扎实的基础,就能获得不错分数。