如果你正在准备大模型相关岗位的面试,大概率会遇到一个绕不开的追问组合:MQA(Multi-Query Attention)和GQA(Grouped Query Attention)。很多候选人能把定义背下来,但一旦被问到“为什么MQA能加速推理”“GQA相比MQA的trade-off是什么”就容易卡住。这篇文章的目标很直接:帮你理清这两个概念的本质区别、在面试中如何系统输出、以及如何用工具(比如AI简历姬)把准备效率提上去。

全文会从概念拆解开始,逐步深入到面试应答策略,最后给出一个可复用的自检清单。全文约5000字,阅读时间15分钟左右。

一、MQA与GQA到底是什么?为什么面试会高频出现?

首先,MQA和GQA都是对经典多头注意力(MHA)的改进,核心目标是在不显著损失模型效果的前提下,降低推理时的KV cache开销。面试官问这个问题的真实意图往往是考察你对大模型推理效率瓶颈的理解深度。

1.1 从MHA到MQA:KV cache的存储爆炸

传统MHA中,每个注意力头都独立维护自己的Key和Value矩阵。当上下文超过4k token时,KV cache可能占据数GB显存。MQA的做法是:所有Query头共享同一组Key和Value。这样KV cache大小直接缩减为原来的1/头数(比如32个头就减少32倍)。Google PaLM就是典型代表。

1.2 GQA:MHA与MQA的折中方案

GQA由LLaMA 2首次大规模采用。它将Query头分成若干组(例如8组),每组内共享Key和Value。这样KV cache大小是MHA的1/组数,比MQA略大但保留了更多多样性。常见配置如LLaMA 2 70B使用8组,每组8个Query头。

1.3 面试官为何高频追问这两个术语?

因为大模型面试越来越偏向推理部署实践。大部分公司都在做模型压缩和服务化,MQA/GQA直接关联到:显存占用、首token延迟、多轮对话吞吐、以及训练收敛速度。能讲清楚它们的人,往往具备“从研究到工程”的全局视角。

二、常见场景:哪些环节最容易遇到MQA/GQA问题?

虽然问题形式多变,但出现场景非常集中。提前了解能帮你快速识别背后的考察点。

2.1 面试开始前的“简历深挖”阶段

如果你的简历里写了“熟悉LLaMA/GPT系列模型”,面试官很可能顺势问:“LLaMA 2使用了什么注意力机制?和GPT-4的可能差异是什么?”注意,这里是在考察你是否真的读过论文或代码,而不是只看过博客。

2.2 项目经验中的“推理优化”部分

假设你做过模型推理加速项目,面试官会追问:“你们有没有考虑过改用MQA或GQA?为什么没用?”这时候需要从效果损失、训练兼容性、代码改造成本三个维度回答。

2.3 开放式问题中的“设计”环节

经典问题:“如果要你设计一个超长上下文(比如128K token)的语言模型,你会怎么改造注意力机制?”这时主动提出MQA/GQA+RoPE+FlashAttention的组合方案就是高分答案。

三、MQA与GQA的核心区别与联系

理解区别不能只看定义,要放在实际推理链路中看。

3.1 参数共享方式不同

| 维度 | MQA | GQA |

|---|---|---|

| 共享粒度 | 所有Query头共享同一组KV | 每组(Group)内Query头共享KV |

| 典型参数 | 如32个头,1组KV | 如32个头,4组KV(每组8个头) |

| 代表模型 | PaLM、Gemini早期版本 | LLaMA 2、ChatGLM3 |

3.2 推理效率与效果权衡

MQA的KV cache最小,推理速度最快,但可能导致模型质量下降(因为不同Query头无法学到差异化的Key/Value)。GQA通过分组保留了部分多样性,效果更接近MHA,同时KV cache比MHA小很多。实验表明,GQA在8组时效果与MHA几乎持平。

3.3 训练与推理的解耦性

注意:很多模型预训练时使用MHA,但在推理时可以用权重转换方式插入MQA/GQA(需要finetune或蒸馏)。面试官可能会问:“如果一个MHA预训练的模型,想直接转成GQA推理,有什么问题?”答案是:KV投影权重需要重新对齐,通常需要post-training或adaptive bridging。

四、理解MQA/GQA需要哪些前置知识?

零基础直接看会很难吸收。建议先把以下几个知识点梳理清楚。

4.1 多头注意力的完整流程

从输入到QKV投影、注意力分数计算、加权求和、concat + Output投影。脑中要有完整的矩阵形状变化图。尤其是K和V在训练时是每个头独立,推理时则要持续缓存。

4.2 KV cache的实现细节

必须知道:在自回归生成中,每步只需要新计算的Q与缓存的K、V做attention。缓存的大小 = batch_size × num_heads × seq_len × head_dim × 2(K和V)。MQA/GQA就是在头数维度上做压缩。

4.3 模型推理的显存瓶颈

为什么需要关注KV cache?因为当batch_size增大或序列变长时,KV cache会迅速占满显存,甚至超过模型权重本身。例如一个70B模型,权重约140GB(4bit量化后35GB),但KV cache在4k长度、8个batch时可能超过100GB。

五、面试中如何系统回答MQA/GQA问题?

不要只背定义。推荐用“原理-优势-局限性-工程实现”四层结构。

5.1 第一层:一句话定位

“MQA是让所有Query头共享同一组Key和Value,GQA是分组共享。两者都是为了降低推理时的KV cache内存占用和访存开销,属于牺牲一定表示多样性换取吞吐提升的设计。”

5.2 第二层:关键公式或图示

如果允许板书,可以画一下形状变化:

- MHA: Q [b, nh, s, d] x K [b, nh, s, d] → 每个头独立

- MQA: K [b, 1, s, d] 广播到所有头

- GQA: K [b, g, s, d] 广播到每组内头数

5.3 第三层:带案例的trade-off

“从LLaMA 2的消融实验看,GQA在组数=8时,困惑度(PPL)比MHA仅增加0.05以内,但推理吞吐提升了约2倍;MQA的PPL增加约0.3-0.5,但吞吐可以提升4倍以上。实际选择取决于对质量损失容忍度和部署资源约束。”

六、大模型面试中关于MQA/GQA的常见追问与陷阱

面试官往往会在你回答后追加几个变体问题,看你能站多高。

6.1 追问1:“为什么LLaMA 2选择GQA而不是MQA?”

陷阱:不要只说“因为效果更好”。回答要点:LLaMA 2的目标是开源可复现的强基座模型,需要兼顾研究与落地;GQA提供了更好的效果-效率边界,且8组的设置几乎不损失质量。同时MQA在更大规模的模型(如340B)上可能表现更好(PaLM 540B也用了MQA)。

6.2 追问2:“训练时能不能直接用GQA预训练?”

可以,LLaMA 2就是直接用的。但需要注意:GQA需要在训练代码中修改attention mask的广播逻辑;推理时KV cache组数需和训练一致。有些方案是先用MHA预训练,再在SFT阶段转为GQA微调。

6.3 追问3:“MQA/GQA对多轮对话有什么影响?”

多轮对话意味着更长的序列和更大的KV cache。MQA/GQA的优势更明显:同样的显存可以服务更多轮次或更大batch。但要注意,如果模型使用MQA,可能会削弱对长程依赖的建模能力(因为Key/Value信息量减少了),需要在位置编码上做补偿,例如用RoPE或ALiBi。

七、如何利用AI工具高效准备大模型面试?

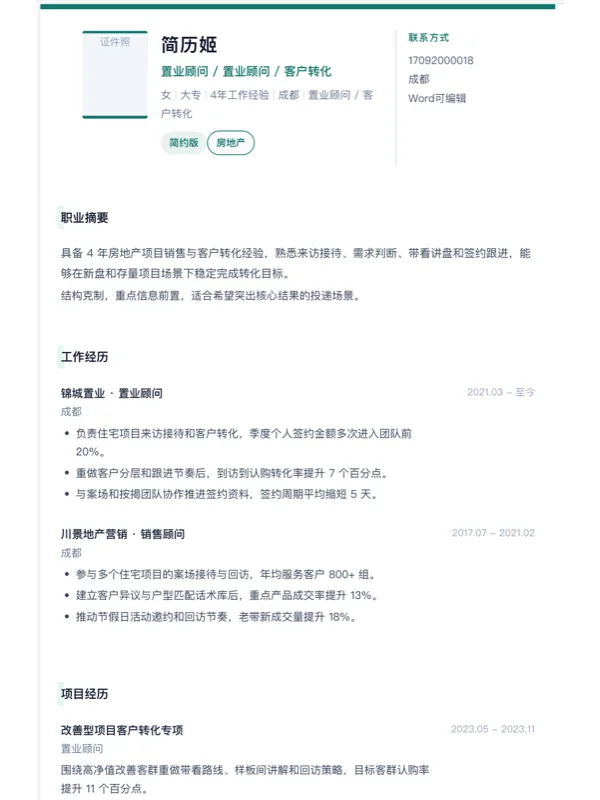

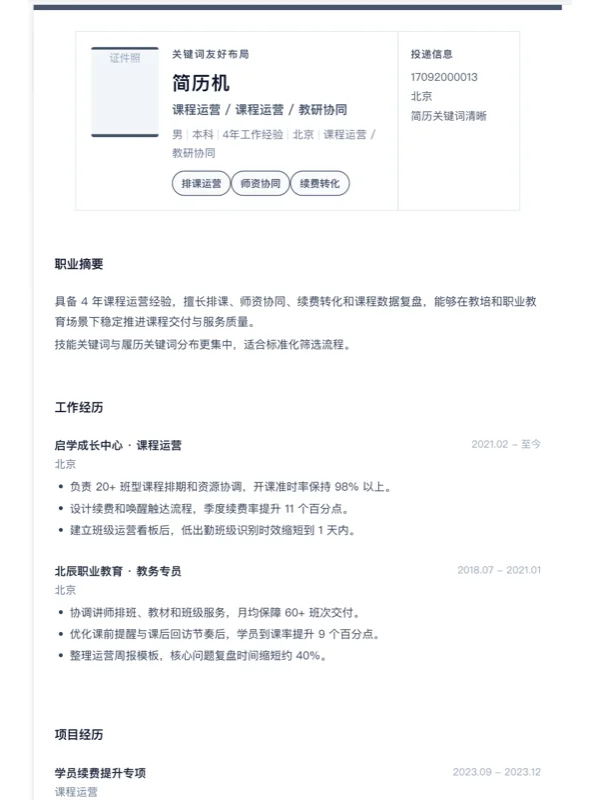

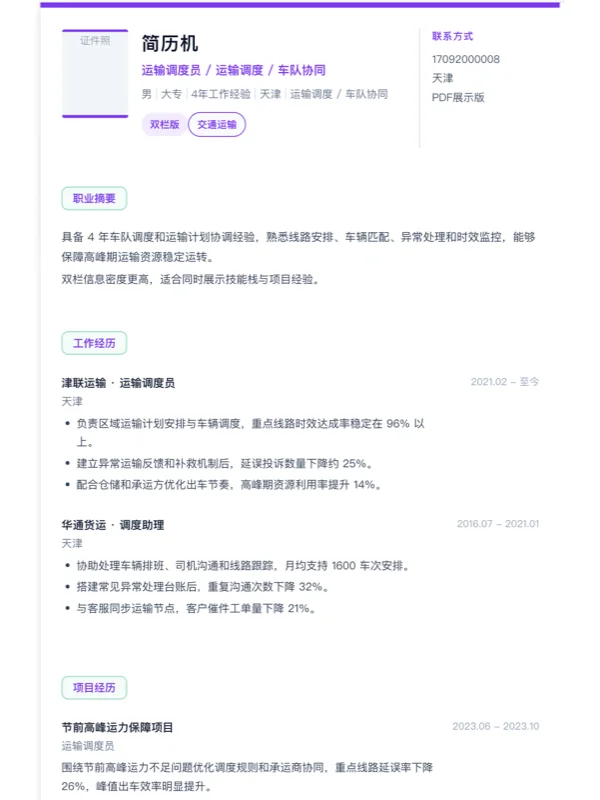

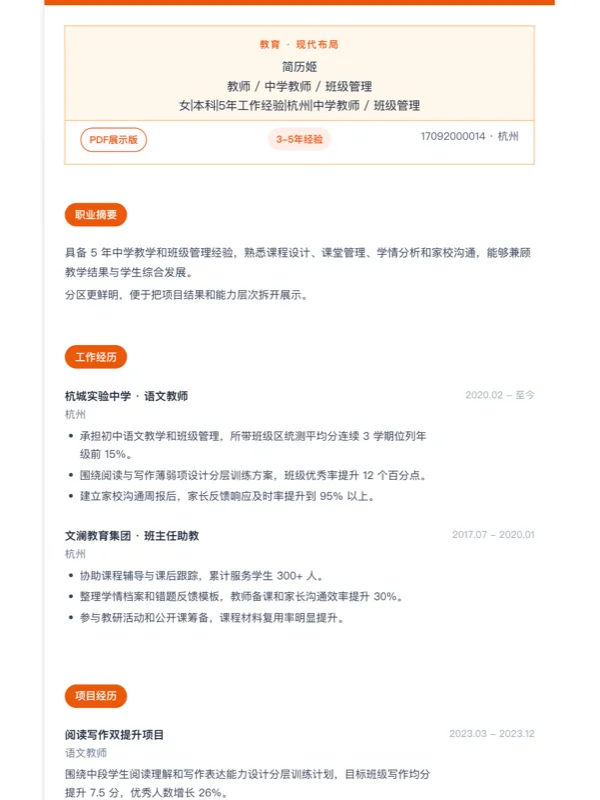

传统准备方式是把论文翻一遍、手推公式、刷LeetCode。但面试中很多问题是针对某个岗位的特定场景。AI简历姬可以帮你把准备过程变成“模拟真实面试+简历深度绑定”的闭环。

7.1 传统方式的低效点

- 不知道目标公司用什么模型(比如字节用self-attention变体?小公司用GPT架构?)

- 背了很多概念,但面试官一问“你简历里的这个项目用了什么注意力机制”就接不上

- 面试后不知道哪里没答好,也无法针对性复盘

7.2 AI简历姬如何提效?

把目标岗位的JD粘贴进来,系统会自动解析出高频技能要求。如果提到“LLaMA”“推理优化”“MoE”等关键词,AI简历姬的模拟面试模块会基于你的简历和岗位生成定制追问。比如你简历里写了“优化过Transformer推理”,它可能会出题:“你试过MQA吗?如果没试过,为什么?如果试过,遇到的最大问题是什么?”

7.3 落地路径:三步走

- 导入简历:上传你的旧简历,AI简历姬结构化解析并修复信息缺口。

- 粘贴JD:选择目标大模型岗位,系统自动对齐到你的经历,生成匹配度评分和关键词缺口清单。

- 模拟面试:针对MQA/GQA等高频概念,AI简历姬会输出追问列表和参考回答,你可以在看板里标记熟练度并反复练习。

这一套流程下来,能把面试准备时间从几天压缩到2小时左右,而且结果更聚焦。

八、不同岗位对MQA/GQA的考察差异

算法工程师、推理引擎工程师、研究员侧重点完全不同。

8.1 算法岗(模型训练/调优)

侧重:为什么选择GQA而不是MQA?训练稳定性如何?是否需要调整学习率?如何评估效果损失?通常会结合消融实验细节。

8.2 推理部署岗(MLSys/工程)

侧重:KV cache具体怎么管理?如何做paged attention?MQA/GQA对FlashAttention是否兼容?如何优化访存?需要给出显存计算公式和吞吐对比数据。

8.3 研究岗(Intern/PhD)

侧重:有没有比GQA更好的折中方案?能不能动态调整组数?或者与attention sink、streaming LLM等新方向结合?需要展现对前沿论文的跟进。

| 角色 | 典型问题 | 关键准备点 |

|---|---|---|

| 算法 | GQA与MHA的PPL差距能否通过其他方式弥补? | 消融实验设计 |

| 工程 | 用MQA时,如何支持可变长batch? | 显存管理与算子优化 |

| 研究 | 是否考虑过group size自适应? | 多篇论文对比分析 |

九、如何检验自己是否真正掌握了MQA/GQA?

不要只看概念,要用可执行的自检标准。

9.1 基础层自检表

| 检查项 | 判断标准 |

|---|---|

| 能画出MHA、MQA、GQA的Q/K/V形状 | 无需查文档直接画出 |

| 推导KV cache大小公式 | 能区分训练与推理场景 |

| 列举至少两个使用MQA/GQA的模型及其参数 | PaLM(1组)、LLaMA 2(8组) |

9.2 进阶层自检表

- 能否手撕一个简化版的GQA注意力前向代码(Pytorch风格)?

- 能否解释为什么GQA在推理时比MHA容易做tensor并行?

- 能否说明MQA在超长上下文(>64k)时可能出现的Causal Mask问题?

9.3 实战层自检

打开AI简历姬的模拟面试模块,选择“大模型推理”相关岗位,看系统生成的追问列表你是否能全部给出60分以上的回答。答不上的就是复习重点。

十、长期跟踪:MQA/GQA在业界的发展与持续优化

这两个技术不是终点,只是起点。

10.1 常见误区:以为组数越大越好

实际上组数增加会回退到MHA的问题。关键在于找到与模型规模、序列长度、batch size匹配的拐点。很多团队会做grid search。

10.2 持续优化方向

- Adaptive GQA:根据当前序列的上下文动态决定组数,节省更多的显存。

- MQA + FlashAttention:两者天然兼容,可以进一步加速。

- 与MoE结合:在专家层也应用类似策略,减少共享专家的KV cache。

10.3 如何保持更新?

建议每季度刷一遍几大模型的技术报告(LLaMA、Qwen、Mistral、DeepSeek),看它们在注意力机制上有没有新设计。用AI简历姬的“投递看板”追踪你关注的公司,一旦有新岗位发出,系统会自动提醒你更新简历并针对新的技术栈做模拟面试。

十一、MQA与GQA未来的趋势与建议

从当前大模型竞争来看,注意力效率优化依然是核心战场。

11.1 趋势一:多尺度注意力融合

未来模型可能在一个层内混合使用MHA、GQA、MQA,根据头部重要性自适应分配。这需要更复杂的训练和推理基础设施。

11.2 趋势二:与硬件协同设计

例如在NVIDIA Hopper架构上,可以利用Tensor Core的WGMMA指令加速GQA的group broadcast。面试中如果提到这部分会非常加分。

11.3 给求职者的建议

- 对算法岗:把GQA的消融实验复现一遍,记录PPL和显存数据。

- 对工程岗:尝试在vLLM或TGI框架里修改attention实现,跑个benchmark。

- 对研究岗:关注ICML/NeurIPS 2024-2025关于注意力压缩的论文,形成自己的观点。

十二、总结:准备好大模型面试中的MQA/GQA,关键在于理解原理与实战融合

面试不是考试,而是展示你处理模糊技术问题的能力。针对MQA/GQA这类高频追问,你需要的不是一堆笔记,而是一个能随时调用的知识框架:原理定位→优劣分析→工程落地→行业对比。

行动建议:

- 用纸笔画出三种注意力的KV cache占用公式;

- 找一个你熟悉的模型(比如LLaMA 2-70B),手推其GQA的组数配置;

- 用AI简历姬的模拟面试针对你心仪的岗位做2-3轮练习,记录每次回答的卡顿点。

如果你希望更快完成简历与面试准备,也可以借助 AI简历姬 这类工具,一键解析JD、量化改写经历、生成面试追问和参考回答,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:面试时如果被问到“MQA和GQA哪个更好”,应该怎么回答?

回答:先分场景:如果是追求极致推理吞吐且效果损失可接受(比如对话场景),MQA更好;如果是追求强基座模型的多任务能力(比如代码、数学),GQA更稳妥。然后补充一句:“当前主流开源模型如LLaMA 2选择GQA-8,而PaLM选择MQA,说明两者在不同约束下都可以是最优解。”最后可以反问对方关注的是哪种场景,体现互动意识。

问题2:MQA/GQA对Multi-turn对话的显存节省具体有多大?

回答:假设模型有32层、32个头、head_dim=128、seq_len=4096、batch=4。MHA的KV cache大小≈3232409612824=4GB。换成MQA(1组)后≈321409612824=128MB,节省32倍。GQA若8组,则为1GB,节省4倍。在多轮对话中,每轮序列增长,节省比例维持不变,节省的显存可以用于扩大batch或降低延迟。

问题3:AI简历姬在准备MQA/GQA面试时能具体帮什么?

回答:主要帮两件事。第一,根据你投递的JD(例如“熟悉LLaMA架构及其推理优化”),自动匹配出MQA/GQA作为高频考点,并生成针对你简历经历的追问(比如你之前项目用了MHA,它会问“为什么不尝试换成GQA?”)。第二,每次模拟面试后给出反馈,指出你的回答在原理完整性、工程细节、前沿了解度三个维度上的得分,以及优化建议。这样你的复习就有了数据闭环。