如果你正在准备大模型算法的面试,或者已经遇到过面试官突然抛出“DeepSeek 的 UE8M0 怎么理解?FP8 Scale 在训练里有什么用?”这样的问题,那这篇文章或许能帮你省下不少翻论文的时间。

先说一个直接的判断:这类问题的核心不是考你是否背过某个特定参数,而是看你对模型效率与精度之间的权衡有没有系统理解。面试官真正想知道的,是你知不知道为什么有量化、怎么选择精度、以及训练或推理中缩放因子(Scale)起了什么作用。把这三条逻辑撑起来,比零散记几个数字有用得多。

下面我们把这组“AI大模型面试题 DeepSeek UE8M0 FP8 Scale”拆成 12 个部分,逐步把概念、场景、答题框架、准备方法串起来。中间也会提到怎么用 AI 简历姬 这类工具来优化你的简历和面试准备,但更多是作为提效手段,不是硬广。

一、AI大模型面试题中,DeepSeek、UE8M0、FP8 Scale 到底是什么?

当你在面试题里看到“DeepSeek UE8M0 FP8 Scale”这样一串词,通常不是让你解释某一个孤立名词,而是考察你对大模型量化训练或推理的整体认知。下面先拆开来看。

1.1 什么是 DeepSeek?

DeepSeek 是一家专注于大模型研发的公司,其开源模型的训练和推理采用了多种工程优化,包括低精度计算(如 FP8)和特定的缩放方案。在面试中提及 DeepSeek,往往是为了让问题有一个实际的上下文,而不是纯理论讨论。

1.2 UE8M0 是什么?

UE8M0 是“Ultra-Enhanced 8-bit with Mantissa 0”的缩写,常见于一些对精度有特殊要求的量化场景。它本质上是一种 8 位浮点格式的变体,其指数位和尾数位比例不同于标准 FP8(如 E5M2 或 E4M3)。UE8M0 把尾数压缩到极致(M0 表示 mantissa 为零?实际中可能有不同定义),从而在极端情况下获得更大的动态范围。面试官可能希望你能解释这种设计背后的动机:精度 vs 范围 vs 计算效率之间的取舍。

1.3 FP8 Scale 的含义

FP8 本身就是一种 8 位浮点数格式,常用于模型训练或推理的混合精度方案。FP8 Scale 指的是在量化过程中,为了适应不同层或不同张量的数值范围而引入的缩放因子(scaling factor)。简单说,就是先统计整个张量的最大值,然后除以一个合适的倍数,使得量化后的 FP8 表示能尽量覆盖原始数值。正确设置 Scale 直接影响模型精度,这也是面试中常被追问的细节。

一句话总结: 这三个词共同指向“如何用更低精度、更高效的数值表示来加速大模型,同时尽量保持效果”。知道这一点,后面的准备方向就不会偏。

二、为什么面试官会问这些技术细节?——理解考察意图

很多候选人一听到“FP8 Scale”就紧张,觉得这是冷门知识。其实面试官的考察意图很清晰,下面三点最常见。

2.1 考察你对计算效率与模型精度的平衡能力

大模型训练动辄数千 GPU 小时,降低精度能节省显存和带宽,但精度损失过大又会导致模型不收敛。面试官想听你如何系统地分析这种 trade-off,而不是背一个结论。

2.2 考察你是否关注前沿工程实践

DeepSeek 在 FP8 量化和缩放上做过公开分享。如果你能简单提及他们的做法(比如分块缩放、逐层缩放),说明你平时有跟踪工程落地,不只是读论文。

2.3 考察你在实际项目中是否踩过坑

有过混合精度训练经验的人通常能说出:FP8 在反向传播时容易梯度消失、缩放因子如果选大了或选小了都会出问题、不同的模块(如 attention 与 MLP)可能需要不同 Scale。这些实际痛点比理论定义更有说服力。

三、常见混淆点:FP8、FP16、INT8 的区别与适用场景

既然面试题里提到了 FP8 Scale,就需要先厘清几种常见精度格式的边界。下面用最简单的语言区分。

3.1 FP8 与 FP16 本质差异

FP16(16 位半精度)有 5 位指数、10 位尾数;FP8 通常只有 5 或 4 位指数加 2 或 3 位尾数。FP8 的计算速度更快、显存消耗更少,但动态范围大幅缩小,数值溢出风险更高,所以必须配合缩放因子。

3.2 INT8 与 FP8 的本质不同

INT8 是整数格式,完全无法表示小数;FP8 仍保留指数部分,能表示非常小的数值(如 1e-5)。因此 INT8 更适合推理阶段的权重压缩(需要校准),而 FP8 可用于训练阶段的前向和部分反向计算。

3.3 什么时候用 FP8 vs FP16 vs INT8?

下面用一个表格来总结适用决策,方便你在面试中快速引用:

| 精度格式 | 典型用途 | 主要限制 | 是否需要缩放因子(Scale) |

|---|---|---|---|

| FP16 | 训练大部分网络 | 动态范围有限,梯度易溢出 | 不一定,但可以用 loss scaling |

| FP8 | 高效训练/推理,尤其大模型 | 更窄的数值范围,需要精细缩放 | 几乎必须 |

| INT8 | 推理加速,手机端、边缘端 | 不支持小数,需严格校准 | 需要量化参数(scale + zero point) |

四、应对这类面试题的核心原则:从原理到应用

面试官不会只满足于你背出定义。你需要遵循一个底层逻辑 + 工程视角的框架。

4.1 原理优先:理解为什么需要量化

量化(包括 FP8)的目的是用更少的比特数近似浮点数值。根据香农信息论,降低比特数必然引入误差,但只要这种误差不显著影响最终任务指标(如 loss、accuracy),就是可行的。关键是如何控制误差分布。

4.2 工程视角:Scale 如何确定?

常见的做法是使用最大绝对值(absmax) 或 分位数(percentile) 来估算一个张量的浮点范围,然后除以 FP8 能表示的最大值(比如对于一个 E4M3 格式的最大值是 480),得到缩放因子。面试官可能追问:为什么不用均值?因为 FP8 对离群值很敏感,离群值会压缩其他数值的精度。

4.3 记住一个关键 trade-off:精度 vs 效率 vs 稳定性

越低精度效率越高,但稳定性越差。你需要脱口而出几个应对策略:逐层缩放(per-tensor scaling)、逐块缩放(per-block scaling)、统计异常值裁剪(clipping outliers)。这些都能体现你的深度。

五、面试官追问时,如何有条理地拆解?——回答框架

直接给一个可复用的三层回答结构。

5.1 第一层:一句话定性

“您提到的 DeepSeek UE8M0 FP8 Scale,本质上是行业在 8 位低精度训练/推理场景下,针对特定模型结构(如 DeepSeek)做的一种工程优化。核心是想在不显著掉点(精度损失)的前提下,把训练速度或者吞吐量提上来。”

5.2 第二层:拆解技术细节

- 对 UE8M0:解释这是一种特殊的 8 位浮点格式,尾数清零,保留更多指数位以扩大动态范围,适合某些对极值敏感的算子。

- 对 FP8 Scale:说明缩放因子的作用——把原始浮点范围映射到 FP8 有效范围,并举例(比如 per-tensor scaling 与 per-token scaling 的差别)。

5.3 第三层:结合场景给出判断

“如果是训练场景,我倾向使用 per-block 的 FP8 scale,因为它能局部地适应不同位置的数值分布,比全局一个 scale 更稳定。如果是推理,INT8 配合 calibration 也许会带来更好的加速比。具体选用哪种,取决于模型任务对精度的敏感度。”

这个框架能在 2-3 分钟内展示你的知识体系。

六、准备这类面试题的高效技巧:从简历到面试

很多候选人明明做过相关项目,但在面试中说不出细节。下面几个实战技巧可以帮你把简历和面试串起来。

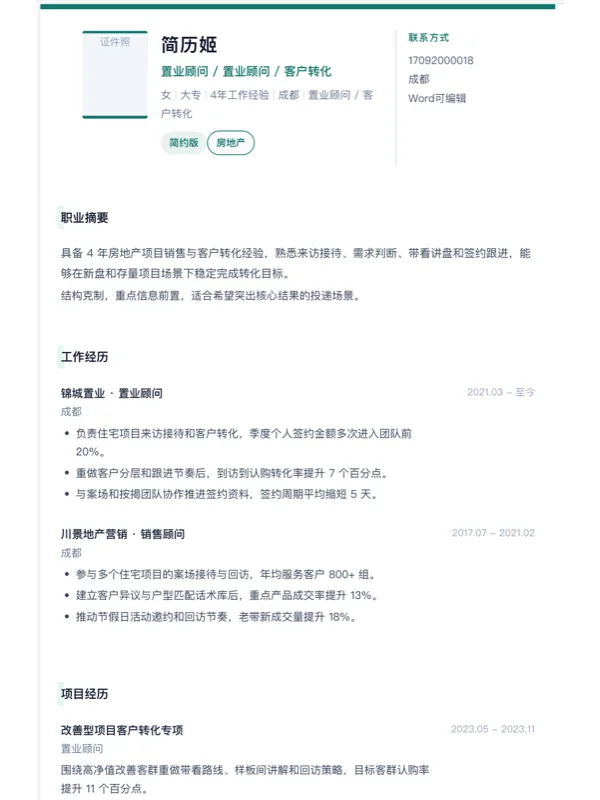

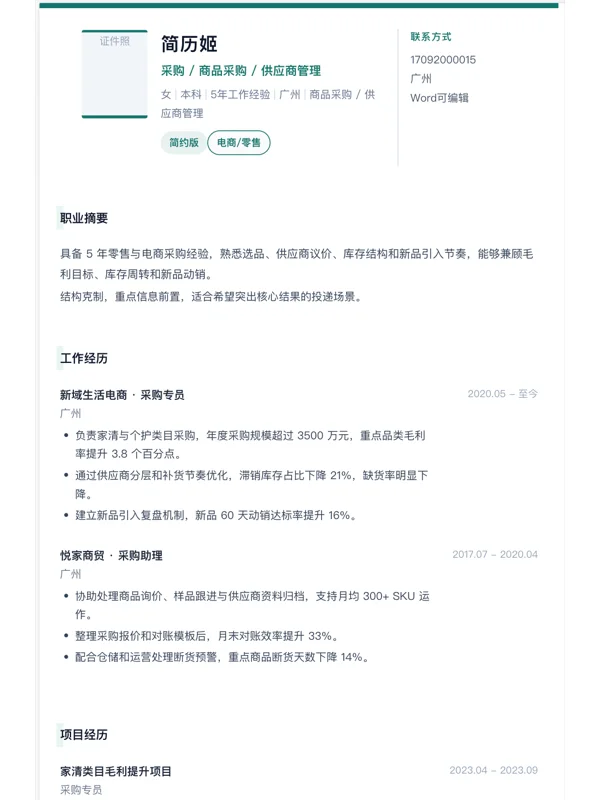

6.1 简历上如何体现量化经验?

不要只写“使用了混合精度训练”。要写清楚格式、缩放方式、效果对比。例如:“在 XX 大模型微调中引入 FP8 per-tensor scaling,训练速度提升 30%,精度损失 < 0.1%”。这样的描述在 ATS 简历扫描中更容易被识别,也方便面试官追问。

6.2 准备一个“一句话版本”和一个“打底版本”

面试中先给简短结论,等对方感兴趣再展开。提前练习一遍,录音听听是否清晰。

6.3 实在没有相关经验,如何应对?

可以诚恳地说:“我目前还没有在生产环境中使用 FP8 量化的直接经验,但我研究过 DeepSeek 的技术博客,并自己写了一个小实验对比 FP16 与 FP8 的训练 loss 曲线。” 这种坦诚加学习能力往往比硬编更有好感。

七、工具提效:如何用 AI 辅助准备技术面试题?

应对这类面试题,光靠刷面经效率很低。你需要反复打磨自己的回答逻辑,同时让简历与面试内容对齐。传统方式是自己写稿、找朋友模拟,但遇到像 FP8 Scale 这种细节极多的问题,很容易陷入死记硬背。

7.1 传统方式的痛点

- 自己搜索技术博客,信息散乱,难以形成体系。

- 模拟面试没有人即时指正逻辑漏洞。

- 简历中涉及量化项目的描述往往不够量化(没有具体数字、对比)。

7.2 AI 如何提效?

使用像 AI 简历姬 这样的全流程求职工作台,你可以:

- 导入旧简历 → 自动解析:系统能识别出你的技术栈(比如“PyTorch AMP”、“混合精度训练”),然后帮你结构化地补充量化细节,比如设定一个合理的“成果指标”(速度提升比例、精度变化)。

- 粘贴岗位要求(JD):如果岗位描述里出现“FP8 quantization”、“scaling factor”等关键词,AI 简历姬会自动给出匹配度评分,并提示你哪些经历可以对齐这些关键词——你的简历就不会因为“没有直接写 FP8”而被筛选掉。

- 生成定制面试题:基于你的简历 + 目标岗位,系统可以高频追问这类细节,然后你对照参考答案和反馈建议,反复练习。

7.3 举个例子

假设你有一段使用 LLAMA 模型做 fine-tune 的经历。传统写法可能是“使用混合精度训练加速”。在 AI 简历姬 中,你可以让它根据 JD 提示改写为:“在 LLAMA-7B 微调中采用 FP8 训练(基于 transformer engine),通过 per-layer scaling 控制精度损失,训练时间减少 40%,下游任务 BLEU 仅下降 0.2。” 这样既真实又有力,面试官看到大概率会追问细节,而这恰恰是你准备好的。

八、不同背景求职者的应对差异

不是每个人都直接做过 FP8 量化。下面分三类人群给出侧重建议。

8.1 应届生 / 在校生

重点放在理解原理 + 小实验。可以坦白没有工业项目,但提过自己复现过 DeepSeek 的量化论文,并用小模型跑过对比。面试官欣赏这种主动研究。

8.2 有 1-3 年经验的算法工程师

重点放在实际遇到的坑:比如 FP8 scale 在哪里爆炸过、怎么调整;或者对比过不同格式的训练曲线。用具体例子说明你理解了 trade-off。

8.3 转行(如从传统 ML 转大模型)

强调迁移能力:你熟悉传统量化的概念(如 INT8 校准),现在正在学习 FP8 的新进展。体现出快速学习能力比硬凹经验更重要。

| 背景类型 | 核心策略 | 建议准备时长 |

|---|---|---|

| 应届 | 原理 + 论文复现 | 2-3 周 |

| 1-3 年 | 项目复盘 + 数据对比 | 1 周 |

| 转行 | 概念映射 + 跟进博客 | 2 周内 |

九、如何判断自己的准备是否到位?——检查清单

别在面试前才慌。用下面这个表格逐条核验。

| 检查项 | 是否掌握 | 备注 |

|---|---|---|

| 能解释 FP8 的两种常见格式(E4M3 vs E5M2)的差异 | □ 是 □ 否 | 核心考点 |

| 知道什么是 scaling factor,以及至少两种确定 Scale 的方法(absmax / percentile) | □ 是 □ 否 | 必须 |

| 能说清楚 FP8 训练中常见的稳定性问题(梯度溢出 / underflow)及应对策略 | □ 是 □ 否 | 加分项 |

| 了解 DeepSeek 在量化方面的一个公开做法(如 block-wise quantization) | □ 是 □ 否 | 体现前沿跟踪 |

| 能用一个 STAR 结构描述自己与量化相关的经历 | □ 是 □ 否 | 简历对应 |

| 准备过至少一个“如果数值偏差变大,你会怎么调试”的思考题 | □ 是 □ 否 | 展示工程思维 |

如果“是”少于 4 个,建议再花一周补一下上面的点。

十、长期机制:技术面试后的复盘与持续学习

面试结束不代表学习停止。你下一次面试可能会遇到更深入的追问。

10.1 记录面试问题

每次被问及的细节,比如“FP8 scale 在 zero-shot 场景下如何设置?” 记下来回去查。

10.2 建立小知识库

把 DeepSeek 的公开技术博客、Microsoft 的 FP8 论文、NVIDIA Transformer Engine 文档整理成卡片反复回顾。

10.3 保持动手

在 Colab 上用 Hugging Face Transformers 配合 bitsandbytes 或 transformer-engine,实际跑一下 FP8 微调一行代码到底能省多少显存。有真实数据后在简历里更新会更可信。

十一、AI 大模型面试题未来的趋势与建议

11.1 量化技术更精细化

未来面试题可能不限于 FP8,而是针对不同算子(Attention、FFN)采用不同精度(混合精度量表)。需要理解“为什么”而不是“怎么做”。

11.2 面试题更强调落地指标

面试官会追问量化对 QPS、card utilization、power consumption 的实际影响。提前准备一些典型数字(比如 FP8 训练吞吐是 FP16 的 1.6x)。

11.3 系统化准备工具会越来越重要

手动搜资料越来越低效,使用 AI 简历姬 这类工具可以快速将简历与目标岗位的知识对齐,并生成定制化面试模拟,大幅缩短准备周期。这也是为什么很多候选人在准备这类硬核面试题时,选择兼用技术博客 + AI 辅助。

十二、总结:想把 AI 大模型面试题(DeepSeek UE8M0 FP8 Scale)准备好,关键在于理解 trade-off 并与简历形成闭环

从头到尾梳理下来你会发现,面试官问的不是冷门知识,而是一套关于如何在大规模训练中平衡效率与效果的方法论。你需要的不是硬背,而是建立从原理到工程、从简历到面试的逻辑链条。

如果你希望更快完成相关任务——包括把简历中关于量化项目的描述优化得更专业、或生成定制化的面试问答练习——也可以借助 AI 简历姬 这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:

AI 简历姬 - 官网

(支持导入简历、粘贴 JD、模拟面试,帮助你在准备“AI大模型面试题”这类硬核话题时,更聚焦在核心知识而非排版和表述上。)

精品问答

问题1:面试官问“FP8 Scale 你是怎么确定具体数值的”,我该先回答什么?

回答:先给出结论:通常有两种主流方法,一种是基于最大绝对值(absmax),另一种是基于分位数(percentile)。absmax 简单但受离群值影响大,分位数更鲁棒但计算略复杂。然后举一个实际场景,比如在 DeepSeek 的工程分享中,他们对 attention 层采用了 per-tensor 的 percentile scaling,对 MLP 层用了 per-block absmax。最后补一句,关键在于通过小规模实验(比如几个 step)观察 loss 曲线,如果没有明显异常,再正式训练。这样既有理论又有实践细节。

问题2:我是应届生,简历里完全没有量化项目,面试官问到这个怎么办?

回答:不要虚。你可以如实说:“目前我的直接经验更多在标准的 FP32/FP16 训练上,但我对低精度量化一直很感兴趣,自己根据 DeepSeek 的公开技术博客和 NVIDIA 的文档写了一个 mini 实验,对比了 FP8 和 FP16 在训练一个小模型时的收敛速度和精度损失。” 面试官看重的是你是否有主动探索和快速学习的能力,不一定是已有的项目。如果你能把实验数据讲清楚(比如 loss 曲线、最终 accuracy 差异),大概率能加分。另外,可以在 AI 简历姬 中通过“技能诊断”功能,把“低精度量化”补充到技能标签中,系统会自动建议关联的课程或项目描述方式。

问题3:FP8 训练中常见的坑有哪些?能给个清单吗?

回答:主要有三个:(1)梯度下溢(underflow):FP8 能表示的最小正数约 1e-38,但 far 的梯度值可能更小,导致直接变零。对策是使用 per-layer loss scaling 或调整为 FP16 master weights。(2)指数出界(overflow):当原始数值超过 FP8 最大可表示范围(如 480 对于 E4M3),需要调整 scaling factor 或 clipping。(3)统计离群值:attention 层的 outlier 特别多,全局一个 scale 容易压缩其他有效信息,可以考虑 per-head 或 per-block 缩放。面试中能列出这三个,并针对性地提一个解决方法,基本就能过关。

问题4:UE8M0 如果从字面理解是尾数清零,那为什么还要用浮点格式,不用 INT8?

回答:很好的问题。UE8M0 虽然尾数部分为零(即完全没有小数位),但它保留了指数的可变性,从而能做到比 INT8 大得多的动态范围。INT8 是均匀分布,无法表示一个非常小和一个非常大的值之间的巨大差距。而 UE8M0 的指数可以浮动,相当于用指数位来模拟“对数尺度”,特别适合那些数值跨度极大的计算图(如 softmax 后的 attention 分布)。虽然它丢失了尾数的精度,但换来的是能容纳极端值而不溢出。这个 trade-off 在某些任务(如需要处理概率分布的场合)比 INT8 更有效。