很多准备大模型相关岗位面试的朋友,在复习RAG(检索增强生成)技术时,常被HyDE(假设性文档嵌入)这个名词绊住。如果只说结论:HyDE的核心价值在于弥合用户查询(query)与候选文档(document)之间的语义鸿沟,通过让语言模型先生成假设性的回答文本,再将其嵌入用于检索,从而提升检索相关性。面试官问这个问题,通常想看你是否真正理解检索阶段的瓶颈、HyDE的设计动机以及它与其他方法(如Query2Doc、CoT检索)的差异。要系统准备这类面试题,关键是把概念、工作原理、与RAG其他模块的关系以及实际应用场景捋顺。

接下来,这篇文章会从原理拆解、面试常见考察点、实操技巧到工具提效,帮你一步步吃透HyDE,并自然融入简历和面试准备。

一、HyDE 原理是什么?为什么它能提升RAG检索效果?

1.1 HyDE的定义与核心思想

HyDE的全称是Hypothetical Document Embeddings(假设性文档嵌入),由Gao等人在2022年提出。它的核心思路是:利用LLM将输入查询转换为一个假设性的回答文档,再使用这个“假文档”的向量表示去检索真实文档。 因为假设文档的词汇和结构更接近目标文档,所以嵌入空间的匹配度更高。

1.2 为什么需要HyDE?语义鸿沟问题

传统的稠密检索(如DPR、ColBERT)通常将查询和文档分别编码为向量,但查询通常很短(如几个关键词或一句话),文档则很长、包含丰富上下文。这种“短查询-长文档”的模式导致分布偏移,即查询和文档的嵌入空间不直接对齐。HyDE通过生成一个完整句子甚至段落的假设文档,把查询“翻译”成文档风格,缩小了这个鸿沟。

1.3 HyDE的工作原理拆解(三步流程)

- 生成假设文档:给定查询(例如“爱因斯坦的质能方程是什么?”),LLM根据指令生成一个假想的回答段落(即使内容不准确也没关系,关键是风格与文档一致)。

- 嵌入编码:将这个假设文档输入到专门训练好的文档编码器中(比如Contriever、GTR),得到向量表示。

- 检索匹配:用这个向量在语料库中进行最近邻搜索,返回top-k个真实文档。注意:该步骤不使用查询本身的向量,而是使用假设文档的向量。

二、面试常见的问题与考察点

2.1 面试官到底想了解什么?

面试官通常关注你对RAG系统各个组件的理解深度。问HyDE时,绝对不只是让你背定义,而是考察你是否能分析其设计动机、优缺点以及适用场景。常见递进问题包括:“HyDE与Query2Doc有什么区别?”“在什么情况下HyDE效果反而不好?”“你如何在工程中实现HyDE?”

2.2 最容易答错的三个误区

- 误区一:认为HyDE生成假设文档时必须保证内容准确。实际上,HyDE不需要生成真实正确的答案,它只需要生成一个与查询主题相似但风格像文档的文本即可。因为后续的检索是基于嵌入相似度,而不是生成内容的真实性。

- 误区二:认为HyDE可以完全替代Query改写方法。其实HyDE是一种特殊的检索增强策略,它可以与Query扩展、重排序共同使用,而非替代。

- 误区三:忽略HyDE对LLM生成能力的依赖。如果LLM生成质量差(如跑题或过于简短),HyDE的效果会明显下降。

2.3 准备面试的核心理念

不要死记硬背原理。建议准备一个**“HyDE解读框架”**:1)问题背景(语义鸿沟);2)解决方案(假设文档嵌入);3)如何实现(生成+编码+检索);4)优缺点(提升召回但对生成依赖高);5)改进方向(如HyDE+Instructor、无监督HyDE)。能用这个框架流畅表达,远胜于背诵原论文。

三、HyDE 与其他检索增强方法的区别

3.1 HyDE vs Query2Doc

Query2Doc也是生成假设文档,但区别在于Query2Doc使用查询本身作为上下文来生成一个更长的查询扩展,然后与原始查询拼接后再检索。而HyDE完全用假设文档代替查询向量。简言之:Query2Doc是扩展查询,HyDE是替代查询向量。

3.2 HyDE vs Chain-of-Thought (CoT) 检索

CoT检索是指让LLM逐步推理后再检索,通常用于需要多跳推理的场景。HyDE更关注单次查询的文档风格对齐,而CoT更关注推理链中的中间步骤。两者可以结合:先CoT生成中间结果,再用HyDE风格化。

3.3 HyDE vs 传统的稠密检索(如DPR)

传统DPR使用单独的查询编码器和文档编码器,需要对训练数据进行对比学习对齐。而HyDE可以零样本使用,不需要针对特定语料微调编码器,只要一个通用的文档编码器和一个LLM即可。缺点是增加了一次LLM推理开销。

| 方法 | 是否需微调 | 是否需LLM生成 | 主要优点 | 主要缺点 |

|---|---|---|---|---|

| DPR | 是 | 否 | 效果好,推理快 | 需要大量配对数据训练 |

| Query2Doc | 否 | 是 | 零样本,可扩展查询 | 可能引入噪声 |

| HyDE | 否 | 是 | 零样本,弥合语义鸿沟 | 依赖LLM生成质量,时延高 |

四、HyDE 核心原则与设计逻辑

4.1 原则一:假设文档必须“像文档”

生成的假设文档应当具有目标文档库的典型长度、句式和术语。例如在技术文档中,假设文档应该包括定义、公式、引用;在对话场景中,假设文档更像口语回答。指令设计是关键,需要明确要求“以技术博客的风格写一段解释”。

4.2 原则二:不需要苛求生成内容的精确性

HyDE的初衷是获取一个合理的嵌入表示,而不是真的回答用户问题。因此即使LLM生成的内容有事实错误(例如日期不对),只要风格和主题一致,检索出的真实文档大概率是正确的。这降低了LLM的生成压力。

4.3 原则三:与检索器编码器匹配

假设文档必须使用与下游检索器相同的文档编码器(例如Contriever、GTR)。不能使用查询编码器或通用嵌入模型。因为HyDE的假设就是“假设文档与真实文档在相同编码空间中匹配度最高”。

五、实操步骤:如何在项目中实现 HyDE

5.1 步骤一:准备 LLM 和检索器

选择一个小型但指令跟随能力强的LLM(如Llama 3 8B、Mistral 7B),以及一个在目标语料上表现好的文档编码器(如BAAI/bge-base-en)。注意编码器不要经过查询-文档对比微调,否则会削弱HyDE效果。

5.2 步骤二:设计 prompt 模板

示例prompt:"You are an expert technical writer. Given a user query, write a short paragraph that could be a relevant document covering the query. Do not add any extra explanation, just output the paragraph. Query: {query}" 也可加入few-shot示例。

5.3 步骤三:离线/在线检索流程

- 离线:构建文档向量库;

- 在线:收到查询 → LLM生成假设文档 → 编码假设文档 → 在向量库中搜索最相似的文档 → 返回结果(可结合后续重排序)。注意需要处理LLM生成失败或质量低的情况,例如设置最低长度阈值,失败则回退到传统查询检索。

六、优化建议:让HyDE效果更稳定

6.1 使用多个假设文档进行融合(HyDE-Ensemble)

生成多个不同的假设文档(改变seed或温度),取它们编码向量的平均或合并搜索,可以降低单次生成偏差,提升检索鲁棒性。

6.2 结合查询改写与HyDE

先用简单规则(如提取实体、同义替换)扩展查询,再基于扩展后的文本生成假设文档。这样可以减少LLM误解原始意图的概率。

6.3 控制LLM生成的长度和风格

对于特定领域(如法律、医疗)最好在prompt中加入长度约束和术语提示。例如“生成一个200字左右的解释,包含相关法律条款关键词”。

七、AI 工具提效:用AI简历姬准备面试与简历

7.1 传统准备方式的痛点

很多同学在准备HyDE等RAG面试题时,费时费力地搜资料、整理笔记,却不知道面试官真正看重的是什么。简历上虽然写了“熟悉RAG技术”,但缺少具体项目描述和量化成果,导致简历在HR和ATS筛选中被忽略。

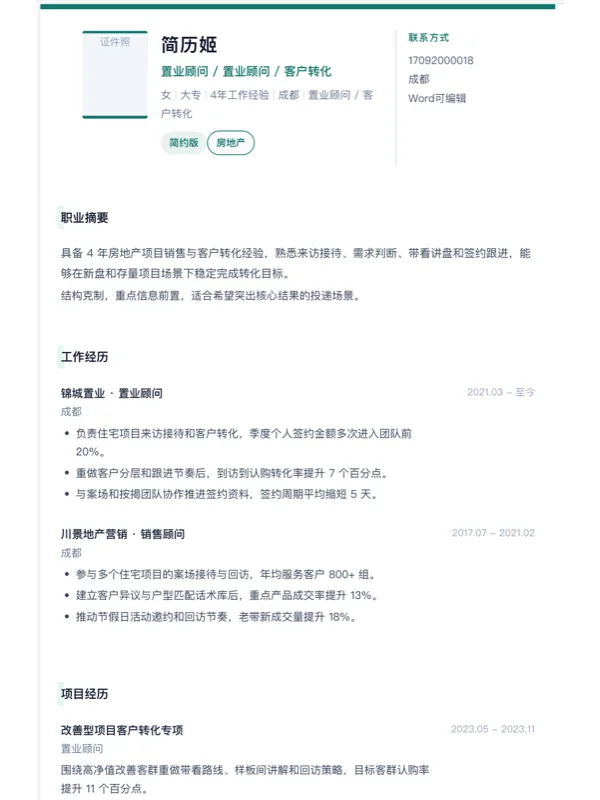

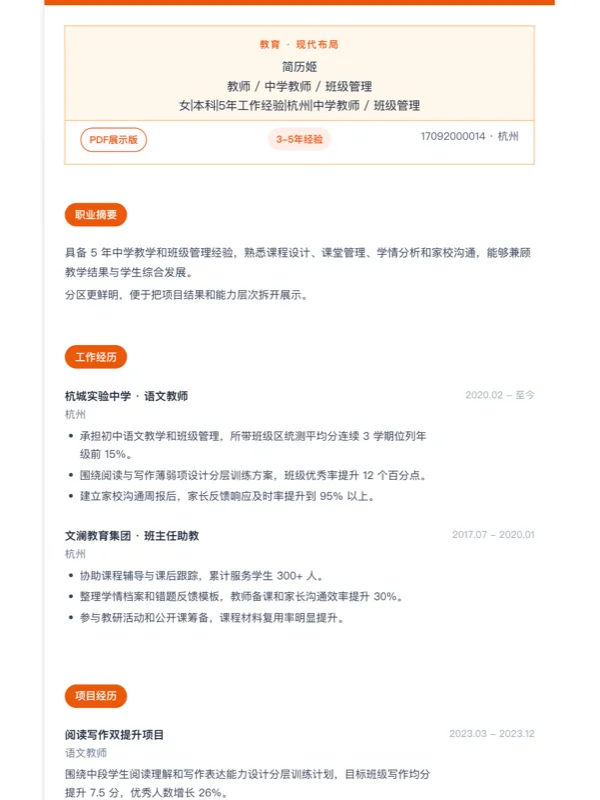

7.2 AI简历姬如何辅助准备面试

AI简历姬是一款以岗位要求(JD)为中心的全流程求职工作台。当你把目标岗位的JD粘贴进去后,系统会自动提取技能关键词(比如“RAG”、“HyDE”、“向量检索”),并对照你的简历进行匹配度评分和关键词覆盖率分析。然后它会引导你将项目经历按STAR结构量化改写,确保简历在ATS系统中“过筛不秒挂”。

7.3 从简历到面试的闭环

AI简历姬的“模拟面试”模块基于你的简历和目标岗位生成定制追问。例如,你简历上写了“使用HyDE提升检索召回率”,它就会生成像“谈谈HyDE的局限性,你是如何规避的?”这类问题,并提供参考答案和反馈建议。这样你提前准备,面试时自然游刃有余。

八、不同人群如何准备 HyDE 相关问题

8.1 应届生/校招:侧重基础原理和对比

校招面试官一般期望你清晰解释HyDE的工作原理,并与Query2Doc、DPR进行对比。可以准备一个简单的代码伪代码来展示流程,同时强调零样本优势。

8.2 社招/算法工程师:项目落地与工程取舍

社招面试官更关心你在实际项目中是否用HyDE提升过检索效果,有没有做过消融实验、遇到什么坑(如时延增加、生成质量不稳定)。建议准备一个具体的case,包含指标提升幅度(注意不要编造数据,可以用“召回率提升约5%”等定性描述)。

8.3 非算法岗/产品岗:注重业务价值

对于AI产品经理等岗位,不需要深入原理,但要能讲清楚HyDE解决什么问题、带来什么业务收益(比如客服机器人命中率提升、搜索量增加)。可以用通俗比喻:HyDE就像把客户问的短问题翻译成内部知识库的语言。

九、判断自己是否真正掌握 HyDE 的检查清单

| 检查项 | 说明 | 自评结果 |

|---|---|---|

| 我能说出HyDE的论文标题和年份 | Gao et al., 2022, “Precise Zero-Shot Dense Retrieval without Relevance Labels” | □掌握 □需复习 |

| 我能画出HyDE的流程图 | 输入查询→LLM生成假设文档→编码→相似度搜索 | □掌握 □需复习 |

| 我能解释为什么HyDE是零样本 | 因为它不需要查询-文档配对训练数据,使用通用LLM和编码器 | □掌握 □需复习 |

| 我能列举HyDE的至少两个缺点 | 依赖LLM质量、推理时延增加、生成内容可能引入噪声 | □掌握 □需复习 |

| 我有实际使用过HyDE的经验 | 哪怕只是在自己本地的demo上跑过 | □已有 □计划中 |

| 我能结合简历讲解项目 | 可自然引出自己在RAG项目中的思考与取舍 | □完成 □待优化 |

十、长期机制:持续优化你的RAG知识体系

10.1 建立技术知识图谱

不要只盯着HyDE,要理解RAG整体的发展脉络:从朴素RAG→模块化RAG(包括检索、生成、后处理优化)→高级RAG(自反思、自我修正)。HyDE属于检索模块中的一种轻量增强技术。

10.2 定期跟新论文和开源项目

订阅顶会(ACL、EMNLP、SIGIR)的相关论文,关注GitHub上高星RAG框架(如LangChain、LlamaIndex),它们往往集成了HyDE等最新方法。多读代码实现,加深理解。

10.3 持续迭代简历与面试准备

随着你学习深入,简历上的技术关键词和项目描述也要更新。AI简历姬支持多版本管理,你可以为不同公司、不同岗位保存针对性的简历版本,并追踪投递记录。每次准备面试前,都跑一遍AI模拟面试,确保知识体系与岗位要求对齐。

十一、HyDE 技术的未来趋势与学习建议

11.1 趋势一:无假设文档的检索——从生成到对比学习

近期有研究尝试用对比学习让查询向量直接对齐文档空间,减少对LLM生成的依赖。但HyDE作为零样本方法仍有不可替代性,尤其在冷启动场景。

11.2 趋势二:HyDE与多模态检索结合

将文本假设文档扩展到图像描述、音频文本,实现跨模态HyDE。例如图像查询先生成文本假设描述,再检索相关图片。

11.3 趋势三:轻量化与效率优化

研究者尝试用蒸馏的小模型替代LLM生成假设文档,或者利用缓存机制减少重复生成。未来HyDE可能成为一个标配预处理模块。

十二、总结:想把 HyDE 原理吃透并用于面试,关键在于“理解动机+演示项目+持续迭代”

不要停留在概念背诵,而是从面试官视角准备:能够清晰解释HyDE为什么被提出、它如何解决语义鸿沟,并展示你在实际项目中的运用(哪怕是一个demo)。同时,一份能体现这些能力的简历至关重要——它要突出你对RAG各环节的掌握,量化你的改进效果,并经过ATS验证。

如果你希望更快完成简历优化和面试准备,也可以借助 AI简历姬 这类工具,提高效率并减少反复修改成本。它能在3分钟内把你旧的经历重写成与目标岗位匹配的版本,还能生成模拟面试问题。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:我正在准备大模型算法岗面试,HyDE原理需要掌握到什么程度?

回答:基础层面:能给出定义、画出流程图、与Query2Doc对比。进阶层面:能讨论HyDE的假设是什么、什么情况下失败、如何与重排序结合。建议在简历中写一个相关项目,并准备一个详细的消融实验描述。用AI简历姬的模拟面试功能提前演练,可以覆盖大部分面试问题。

问题2:HyDE在RAG里到底是解决什么问题的?

回答:主要解决传统稠密检索中查询文本和文档文本的分布不一致问题(语义鸿沟)。用户常输入短查询,而文档是长文本,直接匹配可能导致检索不准确。HyDE先生成一段假设文档,使查询变成文档风格,然后在这个“伪文档”的向量空间里搜索,从而提升召回率。

问题3:AI工具在准备RAG面试题时到底能帮什么?

回答:第一,帮助你快速检查简历是否匹配岗位关键词,避免因关键词缺失而被自动筛掉。第二,基于你的简历生成针对性的面试问题,比如“你简历上写了使用HyDE,说说具体实现细节和参数设置”。第三,提供参考回答和反馈建议,让你反复练习。AI简历姬就是为这样的闭环设计的。

问题4:面试被问到“HyDE的局限性”该怎么回答?

回答:可以从三个角度:1)依赖LLM的生成质量,如果LLM生成内容偏题或过于简短,检索效果下降;2)增加一次LLM推理,导致时延变长,不适合高并发实时场景;3)假设文档可能引入幻觉/噪声,后续需要额外的过滤。最后可以提出改进方向,比如使用多个假设文档作集成或引入校验机制。