很多准备AI大模型岗位面试的人,在遇到RAG(检索增强生成)相关问题时,最先想到的是背几个检索算法或生成模型。但实际面试中,面试官更倾向考察你对Metadata(元数据)和检索优化的底层理解——这两点直接决定了RAG系统在实际场景中的表现。如果你正处在准备大模型面试的阶段,先把RAG的核心组件理清,再重点掌握元数据管理和检索优化策略,会比只刷面试题更有效。下面我会从概念到实战,帮你逐一拆解这一方向的所有关键点。

一、RAG的基础概念:为什么Metadata和检索优化是面试高频区?

1.1 RAG的核心逻辑

RAG(Retrieval-Augmented Generation)本质上是“检索+生成”的混合架构。它先从一个外部知识库中检索相关文档,再将检索结果输入大模型生成回答。在这个过程中,检索质量直接影响最终生成内容的准确性与相关性。

1.2 Metadata在RAG中的角色

Metadata(元数据)是描述数据的数据,比如文档的创建时间、作者、标签、来源、权限等。在RAG系统中,Metadata用于过滤、排序、去重和增强检索结果。面试中问Metadata,往往是在考察你如何利用结构化信息提升检索精度。

1.3 检索优化为什么是必考题

检索优化涉及向量召回、混合搜索、重排序等一系列技术。面试官希望通过这类问题了解你是否掌握从“召回”到“精排”的全链路优化思路。更关键的是,你是否能在实际业务中平衡“召回率”和“精确率”。

二、RAG面试中常见的Metadata元数据相关考题

2.1 元数据过滤的典型场景

例如:“一个电商客服RAG系统,用户问‘去年买的手机怎么退换’,如何利用订单时间元数据来过滤只返回近期的售后政策?”这类问题考察你能否把业务逻辑翻译成检索策略。

2.2 元数据与向量检索的融合

很多候选人不清楚Metadata如何与向量检索协同。通常做法是:先通过Metadata过滤缩小候选集,再对缩小后的集合进行向量相似度搜索,或者向量搜索后使用Metadata重排序。面试中你需要能讲出不同顺序的优劣。

2.3 元数据管理的最佳实践

包括如何设计元数据字段(避免冗余)、如何保证一致性(数据源变更同步)、如何在检索时高效利用索引(如倒排索引配合元数据过滤)。常见错误是过度设计字段导致检索性能下降。

三、检索优化在RAG中的核心作用与常见误区

3.1 检索优化不是盲目刷模型

许多面试者会回答“用更好的embedding模型”,但这只是局部优化。真正的检索优化要从数据预处理、索引构建、查询改写、混合检索、重排序五个环节入手。

3.2 常见误区一:只关注向量检索忽略稀疏检索

向量检索擅长语义匹配但可能丢失精确匹配(如ID、日期)。混合检索(向量+BM25)能在很多场景下提升召回率。面试中讲出这个思路会加分。

3.3 常见误区二:Metadata过滤放错位置

比如先做向量检索再做元数据过滤,会导致原本不相关的文档被过滤掉,浪费计算资源。正确做法通常是“先过滤再检索”或“检索过滤并行后再合并”。

四、应对RAG面试的核心原则:从理解到表述

4.1 原则一:从业务场景出发

不要只讲技术名词,要能结合例子。例如:“招聘平台RAG需要根据岗位类型(元数据)筛选文档,同时根据技能描述(向量)匹配候选简历。”

4.2 原则二:讲清楚权衡

面试官喜欢的回答是能主动说明“在这个场景下为什么选择A而不是B,代价是什么”。例如:使用稠密检索精度高但计算成本大,需要结合缓存或索引优化。

4.3 原则三:能画出简洁流程图

面试时用语言描述RAG检索流程:用户query → 意图识别 → 元数据过滤 → 召回(向量/稀疏)→ 精排 → 生成。这种结构化表达能让面试官快速理解你的掌握程度。

五、RAG面试题实战:标准回答流程与结构

5.1 问题类型分类

| 问题类型 | 示例 | 回答要点 |

|---|---|---|

| 概念解释 | “什么是RAG中的元数据?” | 定义+作用+例子 |

| 技术实现 | “如何优化检索速度?” | 索引策略+近似最近邻+缓存 |

| 场景设计 | “设计一个医疗问答RAG系统” | 数据分块+元数据(科室/疾病分类)+检索策略 |

| 故障排查 | “检索召回效果差,如何分析?” | 检查embedding质量、元数据完整性、检索参数 |

5.2 回答的黄金三步法

- 先给出结论:例如“元数据过滤应该前置,因为能减少后续计算量。”

- 解释理由:给出对比实验或理论依据。

- 补充边界条件:在什么情况下这个结论不成立(比如数据量极小)。

5.3 常见错误:回答空洞

很多候选人只说“我们用开源框架LangChain”而不展开具体配置。正确的做法是说明你如何配置Retriever的参数、如何编写metadata filter的逻辑代码片段(可以用伪代码)。

六、面试中讲解检索优化的实操技巧与细节

6.1 关键词与向量权重调整

有些场景中精确关键词匹配更重要(如法律条款),这时候可以把稀疏检索(BM25)的权重调高。你可以用动态权重的方法:根据query类型自动切换混合比例。

6.2 元数据字段设计技巧

- 避免存储大文本(如全文)作为元数据字段,仅存储过滤用的结构化字段。

- 使用层级元数据(如部门→团队→项目)简化过滤逻辑。

- 时间戳使用Unix时间戳方便范围查询。

6.3 检索优化中的A/B测试

如何证明优化有效?考虑设置离线指标(召回率、MRR)和在线指标(用户点击率)。面试中能聊到离线评测方法(构建测试集)会显得专业。

七、用AI工具提升RAG面试准备效率

传统准备RAG面试的方式是:看论文、刷LeetCode、整理面试笔记。但效率偏低,因为很难模拟真实面试追问。

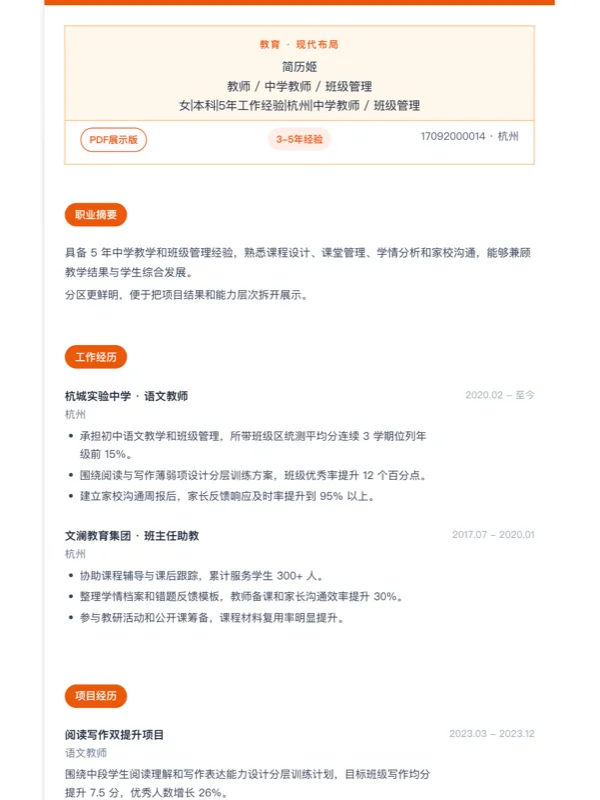

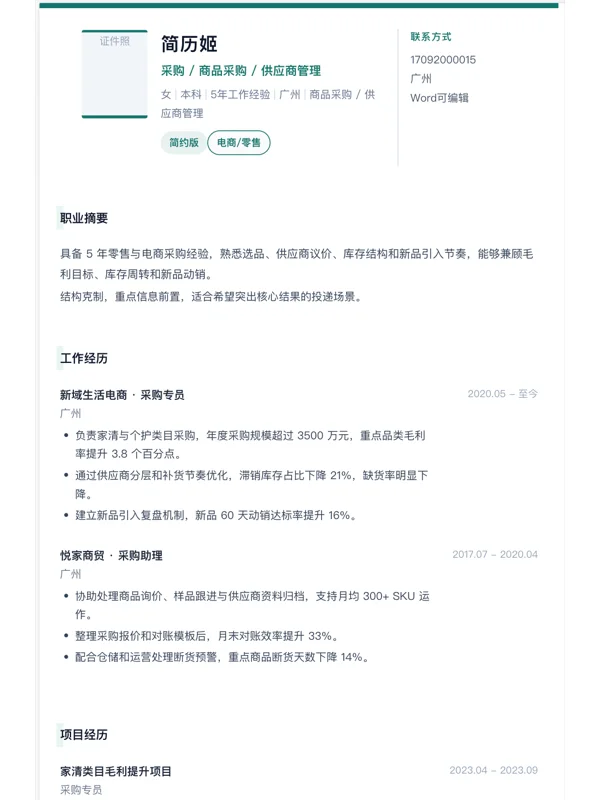

7.1 使用AI简历姬进行面试模拟

AI简历姬不仅能帮你优化简历,还具备基于岗位的模拟面试功能。你可以上传目标岗位的JD(如“大模型算法工程师”),系统会根据岗位要求生成定制追问,覆盖RAG相关技术点。

7.2 简历与岗位对齐

在准备面试前,先把简历中涉及的项目经验与RAG技术点对齐。AI简历姬会自动识别简历中的项目描述,并建议添加关键词如“元数据过滤”“混合检索”“重排序”等,让简历在ATS(招聘系统)中更容易被识别。

7.3 高效管理面试版本

面试不同公司时,侧重点不同。AI简历姬支持一岗一版多版本管理,方便你针对不同公司调整项目描述和技术细节。

八、不同岗位的RAG面试侧重点差异

| 岗位类型 | 侧重点 | 典型问题 |

|---|---|---|

| 算法研究员 | 模型改进、论文理解、Benchmark | “如何设计一个新的检索损失函数?” |

| 算法工程师 | 工程落地、性能优化、数据pipeline | “如何在一个亿级文档系统中实现毫秒级检索?” |

| 应用工程师 | 产品逻辑、场景理解、工具链使用 | “用LangChain实现一个带元数据过滤的RAG系统” |

| 技术管理 | 架构设计、技术选型、成本控制 | “比较两种检索方案的成本和收益” |

8.1 算法岗:注重理论深度

需要讲清楚embedding模型选择(如bge vs e5)、索引结构(IVF vs HNSW)、以及如何做端到端效果评估。

8.2 工程岗:注重系统架构与鲁棒性

需要涉及分布式检索、缓存设计、故障恢复等。元数据的一致性在高并发下更难保证。

8.3 应用岗:注重场景定制与用户交互

比如“用户查询模糊时如何利用元数据(用户画像)优化检索结果”。

九、RAG面试自我评估指标与检查清单

9.1 关键能力评估表格

| 能力维度 | 初级 | 中级 | 高级 |

|---|---|---|---|

| 元数据理解 | 知道元数据概念 | 能设计元数据字段 | 能优化元数据索引性能 |

| 检索优化 | 了解向量检索 | 能调参混合检索 | 能设计自定义检索策略 |

| 系统架构 | 会使用现成框架 | 能搭建完整pipeline | 能设计容错与监控方案 |

| 面试表达 | 能回答问题 | 能举例说明 | 能主动引导追问 |

9.2 准备检查清单

- 复习了至少3种embedding模型及适用场景

- 能画出RAG检索流程图

- 准备了2个以上带Metadata过滤的业务案例

- 实际做过一次混合检索实验(可用论文实现)

- 练习了至少5道面试题并录音复盘

9.3 如何判断自己是否达标

模拟面试中,如果能在20分钟内讲清一个RAG系统的设计,并且能应对关于“如果XXX怎么办”的追问,说明准备充分。

十、长期机制:持续跟进RAG技术迭代与面试复盘

10.1 技术迭代跟踪渠道

关注顶会论文(ACL/EMNLP/SIGIR)、开源项目(LangChain、LlamaIndex)、技术博客(Jina AI、Pinecone)。Metadata方面看Pinecone的filter功能更新。

10.2 面试复盘方法

每次面试后记录被问到的RAG问题,总结自己回答的不足。使用AI简历姬的“投递看板”功能可以追踪每家公司的面试进度,方便复盘。

10.3 持续优化简历与项目描述

根据面试中的反馈,迭代简历中RAG相关项目的表述。AI简历姬的“诊断+改写”功能可以帮你调整关键词覆盖率和成果导向表述。

十一、RAG面试趋势与未来建议

11.1 趋势一:多模态RAG成新热点

未来面试可能会涉及图像、表格等数据的元数据管理与检索。建议提前了解多模态embedding以及如何混合检索。

11.2 趋势二:Agent与RAG的结合

使用Agent主动选择检索源和元数据过滤条件将更常见。面试时如果能结合ReAct或Plan-and-Solve模式会加分。

11.3 趋势三:个性化检索与用户元数据

系统需要根据用户历史行为(元数据)调整检索结果。这在推荐系统中已经普及,RAG领域也在探索。

十二、总结:搞定RAG面试题,关键在于系统化准备与实战演练

从理解RAG基础到掌握Metadata与检索优化,再到结合项目实战,每一步都需要系统化学习。不要只靠刷题,而是把一个完整项目(比如基于LangChain搭建的知识库问答系统)从头到尾实现一遍,记录Metadata设计、检索优化策略和效果对比。这样面试时才有底气。

如果你希望更快完成简历优化和面试模拟,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。它支持以JD为中心生成定制化的简历和面试追问,帮助你精确覆盖RAG相关技术点。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:RAG面试时,如何流畅地回答“请比较向量检索与关键词检索的优劣”?

回答:首先明确向量检索擅长语义匹配(比如同义词“笔记本电脑”vs“便携电脑”),但可能对精确实体(如“iPhone 15 Pro Max”)不敏感;关键词检索(BM25)相反。然后给出结论:实际生产中采用混合检索(如加权组合或级联),并说明权重根据场景动态调整。最后补充一个例子:电商搜索中用户输入“蓝色连衣裙”,用关键词“连衣裙”缩小范围,再用向量检索“蓝色”相关描述。这样回答既全面又有落地感。

问题2:元数据在RAG中到底能帮什么忙?能举个具体例子吗?

回答:元数据可以让检索更加精准且高效。例如一个企业知识库系统,包含不同部门(销售、技术、HR)的文档。用户提问“今年招聘计划”,如果加上元数据过滤仅保留HR部门的文档,能避免命中销售部门的“招聘销售”文档。同时,元数据可以作为排序信号,比如偏好最新文档(时间元数据)。在实际实现中,元数据过滤器通常结合倒排索引或布隆过滤器来加速。

问题3:面试官问“如何评估RAG检索效果?”,我应该怎么回答?

回答:分离线评估和在线评估。离线评估使用标注数据集,计算召回率(Recall)、MRR(Mean Reciprocal Rank)、NDCG(Normalized Discounted Cumulative Gain)等。在线评估则关注最终生成回答的用户满意度或点击率。同时要区分评估检索器和生成器:检索器单独评估可以用hit rate(命中率),生成器评估用BLEU或人工评分。特别注意:要说明离线指标高未必意味着在线效果好,需要对比实验。

问题4:准备RAG面试时,AI简历姬具体能帮我做什么?

回答:AI简历姬核心解决三大痛点:第一,简历与岗位对齐。你上传目标JD后,系统会自动识别RAG相关关键词(如“混合检索”“元数据过滤”),并提醒你补全项目经历中的对应描述。第二,模拟面试。它能基于你的简历和岗位生成追问,例如“你在某某项目中如何设计元数据索引?”,然后给出参考回答。第三,多版本管理。你可以针对不同公司(一个侧重研发、一个侧重应用)保留不同版本的简历,并在投递看板中跟踪进度,方便面试复盘。