如果你正在准备AI大模型岗位的面试,尤其是涉及分布式训练的岗位,那么“千卡训练”“节点故障”“断点续训”几乎是绕不开的三座大山。很多人背了一堆概念,却在面试官追问“如果你的训练在1000张显卡上跑了三天突然挂掉,你怎么快速恢复?”时卡住。把这三个问题拆解清楚,关键在于理解分布式训练中的工程思维、容错机制和面试官真正想考察的底层逻辑。

这篇文章会从这三点的本质出发,帮你理清面试考点、常见误区、答题框架,并借助AI简历姬等工具高效准备面试。全文约4000字,覆盖从概念到实战的完整链路。

一、AI大模型面试为什么总被问到千卡训练、节点故障和断点续训?

这几个词听起来像纯工程问题,但面试官问它们的真正目的,是考察你能否从系统层面理解大模型训练的全貌,以及面对真实故障时的解决思路。

1.1 千卡训练:规模化的必然选择

大模型参数量动辄百亿甚至千亿,单卡显存根本装不下,数据也需并行处理。千卡(1000张GPU)训练已是工业级标配。面试官问“千卡训练”,其实是在问你是否了解数据并行、模型并行、流水线并行、混合精度训练等核心策略,以及跨卡通信的挑战(如all-reduce延迟、通信拓扑)。

1.2 节点故障:分布式系统的宿命

在千卡集群中,单节点故障是常态而非意外。算力节点、网络交换机、存储系统都可能出问题。面试官关心的是你能否快速定位故障类型(硬件、网络、软件抑或超时),并采取有效恢复措施。

1.3 断点续训:保命技能

没有断点续训,千卡训练就是一场赌博。每跑几天或几小时就手动重来,成本不可接受。面试官真正想听的是:你知道checkpoint的保存策略(全量vs增量、频率、异地备份)吗?知道如何从故障点恢复、避免梯度丢失吗?知道在异步模式下如何保证一致性吗?

二、千卡训练的核心概念与面试常见误区

很多候选人能背出“数据并行”“模型并行”的定义,但一聊到具体场景就暴露短板。

2.1 千卡训练并不等于“把数据分到1000张卡”

真正关键的是如何同步梯度。面试中常错的是:把数据并行和参数服务器混为一谈,或者忽略梯度压缩带来的精度损失。

- 数据并行:每卡一份完整模型副本,处理不同批次数据,通过all-reduce同步梯度。

- 模型并行:将模型切分到不同卡上,减少显存压力,但引入通信串行。

- 流水线并行:将模型分层切分,每卡处理若干层,类似工厂流水线,要求微批处理(micro-batch)来填充气泡。

2.2 常见的三个“想当然”错误

- “通信开销可以忽略”:实际上,千卡规模下all-reduce的带宽瓶颈可能占训练时间的30%以上,所以会用Ring All-Reduce或分层通信优化。

- “同步训练总比异步好”:异步训练(ps模式)可提高设备利用率,但会导致梯度陈旧,有时反而收敛更慢。面试官喜欢听你权衡利弊。

- “千卡就是1000卡同时跑”:真实训练中经常出现退火策略、动态批大小调整、通信拓扑变化,这考验你的工程灵活度。

2.3 面试问题举例

面试官:“你用1024张卡训练一个1700亿参数的模型,batch size设为4096,但loss震荡不降,可能是什么原因?”

正确思路:先排除学习率是否过大(需要线性缩放法则),再检查梯度是否出现NaN或通信丢包,最后看数据加载是否成为瓶颈。

三、节点故障在分布式训练中的影响与面试考查点

节点故障种类繁多,面试官通常用“故障推理题”考察你的系统理解。

3.1 常见节点故障类型

- 显存溢出(OOM):模型参数、优化器状态、中间激活占用太大,超过显存。

- 网络闪断:NCCL(NVIDIA Collective Communication Library)超时,导致训练卡住。

- 硬件故障:GPU卡死、内存ECC错误、网络丢包。

- 软件错误:驱动版本不兼容、CUDA错误、框架bug。

3.2 面试官最关心的三个能力

- 快速诊断:给一个错误日志,能否判断是硬件还是软件问题?例如“CUDA error: out of memory”明显是显存不足;“NCCL timeout”则是网络或卡死。

- 恢复策略:是否了解分布式故障处理机制?比如PyTorch的Elastic Training(弹性训练)如何踢掉故障节点并自动re-scale?

- 容错设计:是否在训练前就考虑过checkpoint频率、是否使用异步模式、有没有冗余链路?

3.3 一个典型面试题

“你在300张卡上训练transformer,突然有一张卡掉线,训练停了。你怎么办?”

理想回答:先看是否是单卡故障,若是,则用弹性训练机制(torchrun或Horovod的弹性模式)将该节点剔除,剩余的299个节点自动调整parallelism(通常减小batch size),并从最近的checkpoint恢复训练。同时记录故障节点信息并报修。

四、断点续训的原理与面试答题关键

断点续训不是“存一下模型再加载”那么简单。面试官期待听到工程细节。

4.1 核心机制:checkpoint、状态恢复与进度保持

- checkpoint保存内容:模型参数、优化器状态、学习率、epoch、batch索引、数据随机种子、混合精度缩放因子等。

- 保存频率:通常每几个epoch或每几万步保存一次,也可基于时间(每隔2小时)。大模型训练中,全量checkpoint可能几十GB,所以会采用增量checkpoint,只保存变化的部分。

- 恢复后的一致性:要保证数据加载的随机顺序与之前一致(用之前的随机状态),否则梯度会不一致。

4.2 面试中容易踩的坑

- 只保存模型,不保存optimizer:恢复后学习率和动量状态丢失,模型可能爆炸。

- 忽略数据顺序:恢复时从最近保存的batch之后开始,否则会重复或跳过数据。

- 多机环境下的同步问题:所有节点必须从同一个checkpoint加载,否则参数不一致。

4.3 断点续训进阶话题(加分项)

- 在线迁移:训练过程中将checkpoint复制到异地存储,避免单点故障。

- 容错调度:Kubernetes训练任务重启时自动挂载checkpoint。

- 一致性保证:异步训练中需要维护梯度状态,防止丢失。

五、面试中回答“千卡训练”问题的标准逻辑

当面试官抛出“请解释千卡训练中的关键技术”时,你可以按照以下框架回答。

5.1 三层结构法

- 为什么需要千卡训练:模型大、数据多、时间要求。

- 核心并行策略:数据并行(简述梯度同步)、模型并行(张量切分)、流水线并行(微批调度),并说明每种适用场景。

- 工程挑战:通信瓶颈(all-reduce延迟)、显存限制(激活重计算)、容错(断点续训)。

5.2 结合自身经验(如果有)

假设你用过PyTorch DDP或DeepSpeed,可以具体说:

- “我在16张A100上训练过BERT-large,采用了混合精度+梯度累积,通信用了NCCL,遇到过因网络抖动导致训练卡住,后用torchrun的elastic模式解决了。”

5.3 回答禁忌

- 不要只说概念而不提工程细节。

- 不要夸大自己了解的规模(如明明没接触过千卡,却硬说做过,很容易被追问戳穿)。

- 不要忘记面试官可能是实战派,所以可以适当说“难点主要在于……”来展示深度。

六、应对“节点故障”类问题的高分思路

节点故障类问题通常以“故障场景+解决方案”的形式出现。掌握下面三步,可以稳定输出。

6.1 故障定位四步法

- 收集信息:错误日志、监控面板(GPU利用率、NCCL状态、内存使用)。

- 分类判断:是临时故障(网络抖动)还是永久故障(硬件损坏)?

- 隔离影响:如果训练任务允许弹性,剔除故障节点;如果不行,则暂停整个任务。

- 恢复运行:从最近checkpoint恢复,并记录故障信息。

6.2 如果面试官追问“你没有checkpoint怎么办?”

- 应急方案:如果框架支持,可以尝试重新初始化该节点参数并继续(但风险大)。

- 长远方案:必须将checkpoint作为训练的基本组成部分,否则是工程事故。

6.3 展示工程思维

“我会建议团队在训练开始前就制定容错方案:例如每10分钟保存一次增量checkpoint,异地备份,同时使用Kubernetes自动重启训练。这样即使遇到节点故障,损失最多10分钟。”

七、用AI工具高效应答面试准备(自然植入AI简历姬)

很多候选人知识储备够了,但面试时表达缺乏结构,或者简历上关于分布式训练的经历写得太笼统。这时可以借助AI工具辅助提升。

7.1 传统方式的低效

- 只能自己整理面试题,翻找零散资料。

- 简历写不出现有项目中的千卡训练经验,被HR筛掉。

- 模拟面试找不到真实场景。

7.2 AI如何提效

- 简历优化:将你的训练经验用STAR结构量化,例如“负责300卡模型的分布式训练,通过优化通信策略将训练时间缩短20%”。

- 面试模拟:基于你的简历和目标岗位,AI生成针对性的追问,比如“你在那个300卡的项目中,遇到的最大节点故障是什么?怎么解决的?”

- 知识补全:AI可以帮你梳理千卡训练中的技术点,并给出解释。

7.3 AI简历姬的具体帮助

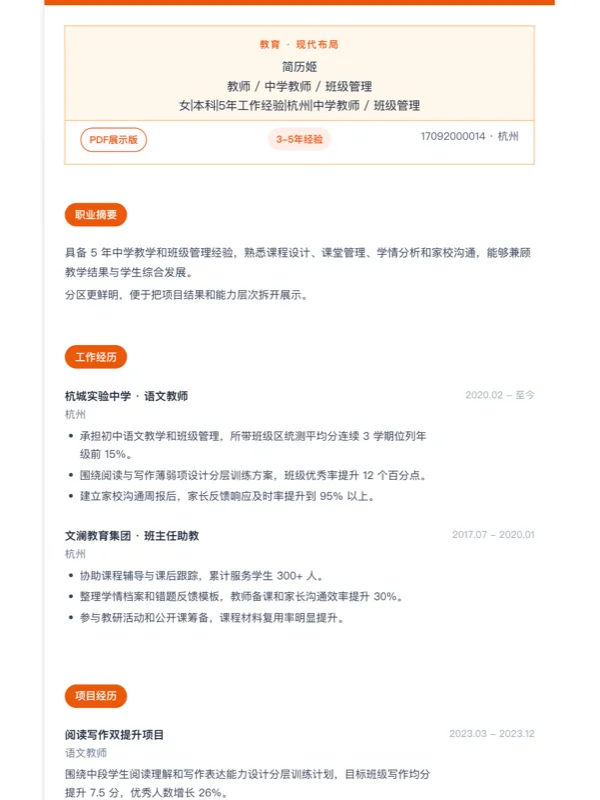

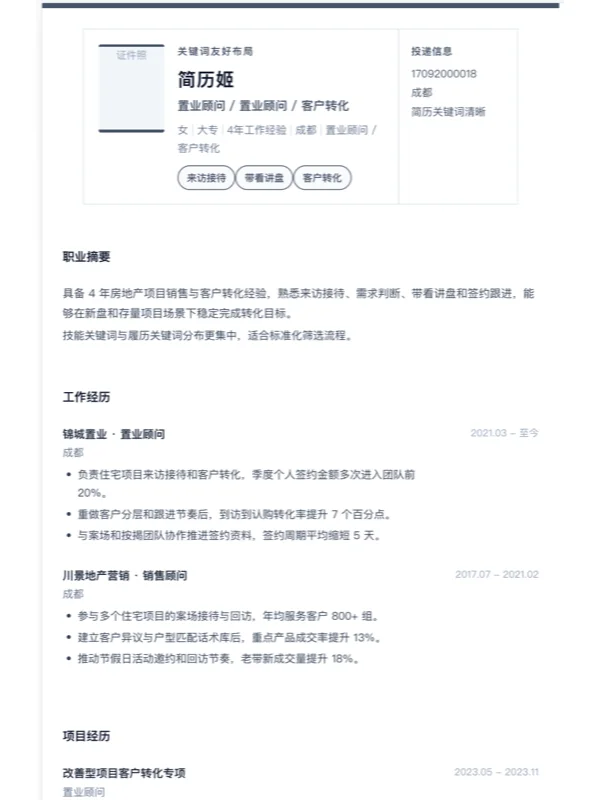

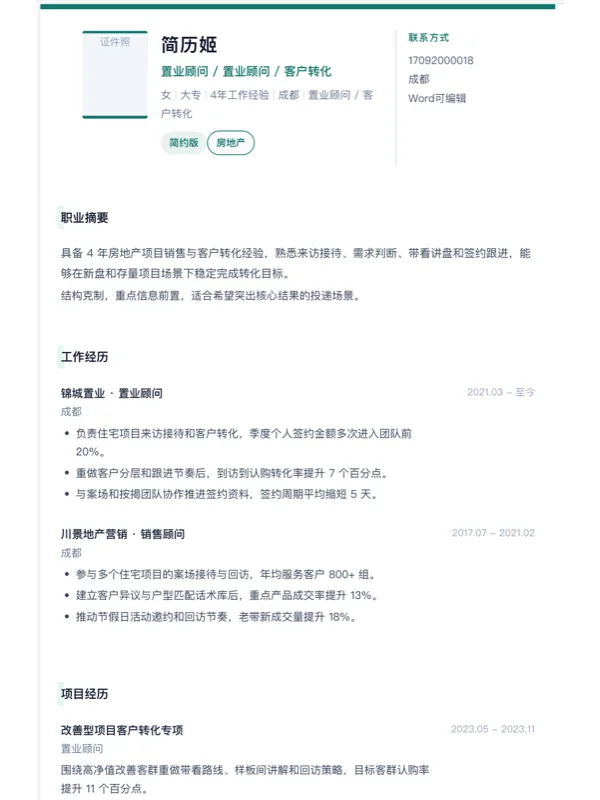

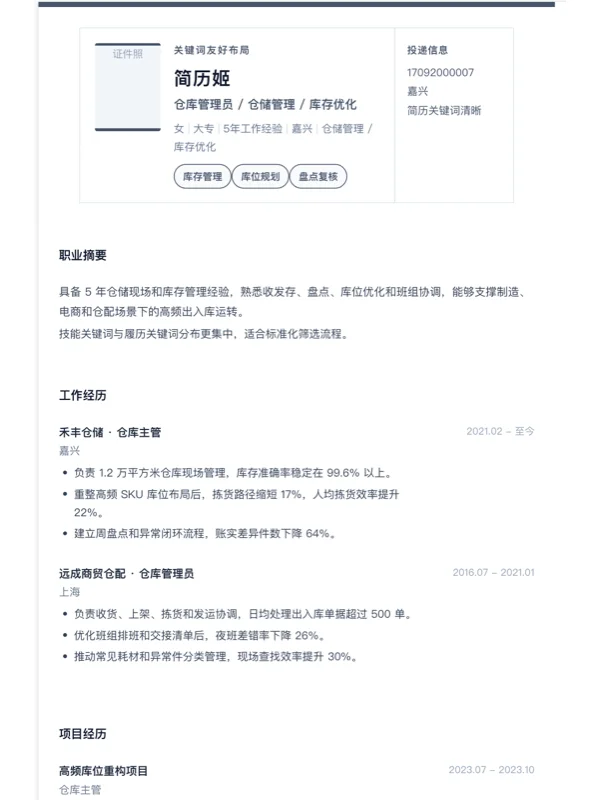

AI简历姬是一款以岗位要求为中心的求职工作台。当你准备AI大模型面试时,可以:

- 导入你的旧简历,AI自动解析并修复关键信息(比如把“用过分布式训练”改写为“主导千卡级分布式训练,实现断点续训机制”)。

- 粘贴岗位要求(如“熟悉千卡训练与故障处理”),系统会逐条对齐到你的经历,给出关键词覆盖率和缺口清单。

- 通过面试模块,基于“你的简历+目标岗位”生成定制追问和参考答案,让你提前演练节点故障、断点续训等高频问题。

- 支持一岗一版,你可以针对不同公司准备不同的面试故事。

这样,你不仅在知识上准备好了,简历和面试表达也一致,整体通过率大幅提升。

八、不同背景候选人的准备差异

根据候选人类型,面试策略和准备重点应有所不同。

8.1 应届生/转行者

- 特点:缺少真实千卡训练经验,但理论扎实。

- 策略:侧重概念原理,并利用公开文献(如GPT-3的论文)和开源框架(DeepSpeed、Megatron)来举例。面试时可以大方说“虽然我没有直接做过千卡训练,但我阅读过相关论文,并动手复现过小规模的模型并行。”

- 简历:突出课程项目、竞赛、开源贡献,并用量化成果(如“用4张显卡实现了数据并行,吞吐量提升3倍”)。

8.2 有分布式训练经验的工程师

- 特点:拥有实际故障处理经验,但可能局限于公司内部框架。

- 策略:重点准备故障案例,比如“某次训练因为NCCL超时导致任务失败,通过修改通信超时参数并增加checkpoint频率解决”。同时要展示对通用原理的理解。

- 简历:需要突出工程挑战和量化成果,如“将千卡训练的平均无故障时间从10小时提升到30小时”。

8.3 资深架构师

- 特点:可能需要设计整个训练系统。

- 策略:面试问题更偏向系统设计,如“设计一个千卡训练平台的容错机制”。需要兼顾成本、效率、可扩展性。

- 简历:强调系统级优化,如弹性训练架构、分布式存储方案等。

九、自我检查:你的分布式训练知识是否达标?

在面试前,用下面表格对照检查自己是否掌握关键点。

| 知识点 | 熟练(能讲原理+案例) | 了解(能说定义) | 不熟(需要补课) |

|---|---|---|---|

| 数据并行与梯度同步 all-reduce | □ | □ | □ |

| 模型并行(张量切分) | □ | □ | □ |

| 流水线并行与微批调度 | □ | □ | □ |

| 混合精度训练与损失缩放 | □ | □ | □ |

| 节点故障类型与诊断 | □ | □ | □ |

| 弹性训练机制 | □ | □ | □ |

| checkpoing保存与恢复全过程 | □ | □ | □ |

| NCCL通信拓扑与超时处理 | □ | □ | □ |

检查后,集中攻克标注“不熟”的部分。

十、长期优化:如何持续构建AI大模型面试竞争力

面试不是终点,随着大模型技术演进,你需要建立持续学习机制。

10.1 跟踪行业动态

- 关注NVIDIA GTC、MLPerf训练榜单、各大公司论文。

- 阅读新提出的并行策略(如ZeRO-3、Sequence Parallelism)。

10.2 动手实践

- 在本地小集群(如4卡)尝试DeepSpeed或FSDP,复现故障场景并模拟恢复。

- 参与开源分布式训练项目(如CS224n的分布式训练作业)。

10.3 结构化简历与面试复盘

每次面试后,记录被问到的题目和回答,用AI简历姬的投递看板追踪自己的面试反馈。持续优化面试故事和简历表达。

十一、AI大模型面试的未来趋势

未来几年,分布式训练面试题会向更深、更广发展。

11.1 从千卡到万卡:任务调度与容错更复杂

随着万卡集群出现,面试官会关注资源调度(如Slurm)、多租户、网络拓扑优化等。

11.2 训练+推理一体化

候选人不仅要懂训练,还要懂模型部署中的分布式推理(如vLLM、TensorRT-LLM)。面试题可能变成“如何在千卡上同时做训练和推理?”

11.3 系统与算法交叉

面试官会期待你从损失函数收敛角度解释分布式训练的稳定性,比如学习率预热、梯度裁剪对故障恢复的影响。

11.4 工具链自动化

未来的岗位要求候选者熟练使用工具(如Weights & Biases、MLflow)来管理训练实验,并利用AI工具(如AI简历姬)提升面试准备效率。

十二、总结:想搞定千卡训练、节点故障与断点续训面试,关键在于把原理讲清楚并融入工程实践

不要死记硬背答案,而要从“为什么需要”“如何实现”“故障怎么办”三个层次去理解。面试时先给出框架,再填充你的具体经验(即使只是模拟经验)。

如果你希望更快完成简历优化和面试模拟,也可以借助AI简历姬这类工具,提高效率并减少反复修改成本。

这里也提供一个可直接体验的入口:https://app.resumemakeroffer.com/

精品问答

问题1:面试官问“请解释千卡训练中的通信瓶颈”,应该怎么回答?

回答: 千卡训练中,通信瓶颈主要体现在梯度同步的all-reduce操作。当显卡数量增加到千卡时,每次all-reduce需要交换几百MB到几GB的梯度,单靠TCP跨节点通信延迟巨大。工程解决方案包括:使用RDMA(InfiniBand)低延迟网络;采用Ring All-Reduce减少连接数;使用梯度压缩(如1-bit梯度)和梯度累积降低通信频率;以及在并行策略层面用模型并行减少通信量。回答时要体现出对实际数据(如计算通信比)的理解。

问题2:我简历上没有千卡训练经验,怎么通过面试?

回答: 完全可以。你可以通过开源框架(如PyTorch DDP、DeepSpeed)在有限资源(如4-8张卡)上复现部分功能,并在简历中突出你掌握的并行技术原理和故障处理思路。面试时坦诚地说“虽然我还没在千卡规模上工作过,但我理解其关键挑战并做过小规模验证”,同时展示你对论文(如Megatron-LM、ZeRO)的深度阅读。面试官更看重学习潜力和系统思维。

问题3:节点故障后,如何保证断点续训不丢失数据?

回答: 核心是设计checkpoint策略。首先要确保checkpoint保存了模型参数、优化器状态、学习率、当前epoch/batch索引以及数据随机种子。其次,故障恢复时需要从最近的checkpoint加载,并让dataloader从保存的batch之后继续读取。同时,还要注意分布式环境中所有节点都加载相同checkpoint。最佳实践是每10分钟或每若干步保存一次增量checkpoint,并异地备份,这样即使节点故障,最多损失几分钟的训练。

问题4:AI工具在面试准备中具体能帮什么?

回答: AI工具可以在三个层面帮到你:第一,优化简历,将你的分布式训练经历量化并突出核心关键词,通过ATS筛选;第二,模拟面试,针对千卡训练、节点故障等高频问题生成追问和参考回答,让你提前演练;第三,构建知识图谱,快速补齐你缺乏的知识点。比如AI简历姬可以针对你的目标岗位生成定制化的面试问题,并基于你的背景给出反馈。