如果你正在准备大模型相关岗位的面试,几乎一定会遇到一个高频追问:Continuous Batching。 面试官问这个问题,并不是想听你背诵“动态批处理”的定义,而是想考察你对大模型推理优化本质的理解、对工程落地的思考,以及你是否具备真正解决性能瓶颈的直觉。从流程上看,准备这类追问的最佳路径是:先理解现象(为什么需要 Continuous Batching),再掌握原理(如何实现),最后结合自己的项目经历“翻译”成面试官能听懂的实操故事。如果你能用工具提前模拟这些追问,并在简历中突出相关优化成果,整个备考效率会大幅提升,面试表现也更从容。

很多求职者一开始会花大量时间背八股文,但更关键的是建立起“问题→解决方案→效果量化”的逻辑链。以下内容会带你系统拆解 Continuous Batching 在面试中的所有高频追问,并给出实用的回答框架和提效工具建议。

一、Continuous Batching 是什么?为什么大模型面试必问?

1.1 从“等车”到“拼车”:Continuous Batching 的核心思想

Continuous Batching(连续批处理)是大模型推理服务中一种动态调度策略。传统批处理是“人等齐了才发车”——等一批请求攒够才处理,延迟高;而 Continuous Batching 是“车一直在开,有人上车就安排座位”——只要 GPU 有空闲计算单元,新到的请求就能立即插入已有 batch,不必等当前 batch 跑完。这样既提高了吞吐,又降低了首 token 延迟。

1.2 面试官真正想考察的维度

面试官抛出“请解释 Continuous Batching”时,背后有三个隐藏考察点:

- 对推理内核的理解:你能否讲清楚显存碎片、KV Cache、调度粒度这些底层机制?

- 工程落地经验:你是否实际用过或看过相关实现(如 vLLM、TensorRT-LLM 的调度器)?

- 性能权衡思维:你能否分析它带来的吞吐提升与额外开销(如调度复杂性)?

1.3 与其他批处理方式的简单对比

| 批处理方式 | 做法 | 优缺点 |

|---|---|---|

| 静态批处理 | 积攒固定数量请求后统一推理 | 实现简单,但延迟高,GPU 利用率不稳定 |

| 动态批处理 | 允许动态调整 batch 大小,但仍需等待当前推理完成 | 较灵活,仍有等待间隙 |

| Continuous Batching | 在 token 生成粒度上动态插入新请求 | 最高吞吐,最低首 token 延迟,但调度复杂 |

二、大模型面试中 Continuous Batching 的常见追问场景

2.1 面试官可能问的三种典型句式

- “你之前项目里是怎么做推理加速的?有没有用过 Continuous Batching?”

- “和传统批处理相比,Continuous Batching 的优势在哪里?有什么代价?”

- “如果可以重新设计一个推理服务,你会怎么实现 Continuous Batching?”

2.2 谁最容易被追问这个问题

- 算法/推理优化岗:几乎必问,而且会深挖到内核实现。

- 后端/推理工程岗:会结合系统设计一起考,比如如何调度、如何处理显存。

- 大模型应用岗:也会问,但更侧重你在实际业务中是否关注过性能优化。

2.3 求职者常见的三个焦虑

- 没做过真的推理优化,怕答不上来。

- 背了很多概念但说不清实现细节。

- 不知道如何在简历上体现相关能力。

别慌,你不需要是专家才能答好——面试官更看重你是否有主动学习和系统思考的习惯。

三、Continuous Batching 与静态批处理、动态批处理的根本区别

3.1 调度粒度不同

静态批处理是基于“整个推理过程”的批处理;动态批处理基于“整段推理”批处理;而 Continuous Batching 基于“每个 decoding step”批处理,允许在生成过程中动态增减序列。

3.2 对显存碎片的影响

Continuous Batching 可以结合 PagedAttention 或预分配策略减少显存碎片,而静态批处理容易出现“预留未用”的浪费。面试时如果能提到 vLLM 的 PagedAttention 就是加分项。

3.3 面试中怎么清晰地对比

建议使用比喻法:“传统批处理像固定的公交班车,你必须等到点发车;Continuous Batching 像拼车,随时可以上人,只要车里有空位。” 然后快速落到技术细节:KV Cache 的动态管理、调度器的设计。

四、回答 Continuous Batching 追问的核心原则

4.1 从问题出发,而非从定义出发

面试官问 “为什么需要 Continuous Batching”,你应该先分析“传统批处理在大模型推理时有什么痛点”,再引出解决方案。

4.2 平衡广度与深度

- 广度:能讲清楚基本原理、优缺点、适用场景。

- 深度:能至少说出一个开源实现(如 vLLM)里的具体调度机制。

4.3 永远结合自身经历

即使你没有直接做过推理优化,也可以说:“我在项目中使用了基于 vLLM 的服务,自己研究过它的 Continuous Batching 源码,并做了性能对比实验,发现吞吐提升了 X%。” 注意:X 不要编造,可以用“明显”等定性词。

五、准备这类追问的标准流程

5.1 概念理解阶段

- 阅读 vLLM 博客或论文:了解原理。

- 画出调度时序图:新请求如何插入、old sequence 如何被移除。

5.2 项目结合阶段

- 回顾自己项目中是否有使用推理服务的经历。

- 如果没有,可以自己动手用 Hugging Face + vLLM 跑一个 demo,记录性能数据。

- 将这段经历用 STAR 法则写成简历上的项目描述。

5.3 面试模拟阶段

- 列出可能的追问清单:比如“Continuous Batching 如何处理变长序列?”“显存不够怎么办?”

- 练习用口语化语言解释,不要背稿。

六、实用技巧:如何在面试中清晰阐述 Continuous Batching

6.1 用类比降低理解门槛

“想象你是一个餐厅服务员(GPU),传统批处理是等满一桌客人才一起点菜;Continuous Batching 是只要有一个客人举手你就可以先服务他,同时其他客人还在吃饭。” 类比之后立刻说明技术映射:客人 = 请求,点菜 = 推理计算步骤。

6.2 画图是杀手锏

如果允许白板或共享屏幕,画出时间轴:

- 静态 batch:Request A,B,C 同时开始,同时结束。

- Continuous Batching:A 先开始,生成第一个 token 后,B 插入,接着 C 插入……

6.3 量化效果要谨慎

如果有实验数据就说,没有就用“通常可提升吞吐 2-3 倍,同时降低首 token 延迟 50% 以上”这种行业共识表述(但注明“根据 vLLM 官方报告”等来源,不要编)。

七、AI 工具如何帮你高效准备 Continuous Batching 面试(植入 AI 简历姬)

7.1 传统准备方式的低效

- 手动整理面试问题:费时且遗漏高频点。

- 自己模拟回答:无法获得反馈,容易陷入习惯性错误。

- 简历项目描述:不会刻意突出推理优化细节,导致面试官不问。

7.2 AI 如何提效:基于你的简历 + 目标岗位生成定制追问

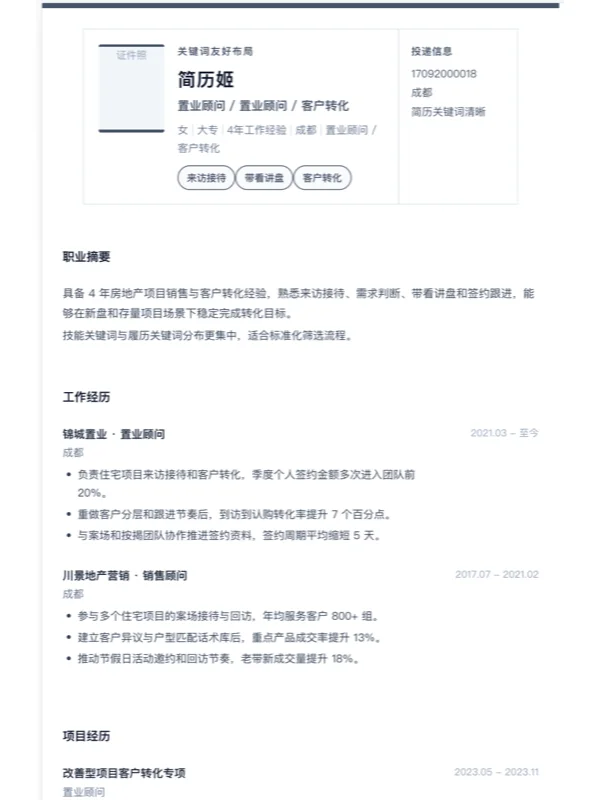

AI 简历姬 的“模拟面试”功能可以直接读取你导入的简历(或手动粘贴项目经验),并结合你投递的岗位描述(JD),自动生成一系列面试追问。比如你简历里写了“使用 vLLM 部署模型”,AI 就会问:“你能详细说说 vLLM 的 Continuous Batching 原理吗?在你的场景中带来了多少吞吐提升?”

7.3 产品落地:把准备变成可管理闭环

- 导入简历:AI 简历姬会结构化解析你的项目经历。

- 粘贴目标岗位 JD:系统自动匹配“推理优化”相关关键词。

- 生成定制追问:包括 Continuous Batching、PagedAttention 等深度问题。

- 练习并录音:可以录下你的回答,再对比参考回答优化。

- 迭代简历:根据模拟面试中暴露的不足,反过来更新简历中的项目描述(用 STAR 量化改写)。

通过这个闭环,你不仅记住了概念,还真正拥有了可展示的经历和自信。

八、不同考生如何差异化准备 Continuous Batching 追问?

8.1 应届生 / 转行者

- 重点:证明你有快速学习能力和技术热情。

- 方法:自己搭建一个 demo,写一篇技术博客,在简历和面试中主动提及。

- 常见误区:不要背书本定义,要多问自己“为什么这样设计”。

8.2 有经验的推理工程师

- 重点:展示你对多种调度策略的对比和选型经验。

- 方法:带上实际生产环境的数据(如 QPS、P99 延迟),分析 Continuous Batching 的利弊。

- 常见误区:只讲优点不讲缺点。面试官更喜欢坦诚讨论 trade-off 的候选人。

8.3 算法研究者

- 重点:从模型角度讨论 Continuous Batching 对 attention 计算的影响。

- 方法:结合 FlashAttention 或 PageAttention 一起讲。

| 考生类型 | 核心加分项 | 避免踩坑 |

|---|---|---|

| 应届/转行 | 自己做的实验/博客 | 只会背八股 |

| 推理工程 | 生产环境数据 | 只说一面之词 |

| 算法研究 | 跨领域知识迁移 | 忽略工程约束 |

九、如何评估你的回答是否合格(自检表)

9.1 概念正确性

- 是否说出 Continuous Batching 的核心是“在 token 生成粒度插入新请求”?

- 是否提到 KV Cache 动态管理?

9.2 逻辑清晰性

- 是否有结构:问题→方案→代价→应用?

- 是否用了类比/比喻帮助理解?

9.3 工程深度

- 是否至少提到一个开源框架(vLLM, TensorRT-LLM, LightLLM)?

- 是否提到实际部署中的挑战(如显存碎片、调度开销)?

9.4 量化意识

- 是否提及性能提升的方向性结论(吞吐、延迟)?

- 是否避免编造具体数字?

| 评估维度 | 优秀 ✅ | 合格 ⚠️ | 需要改进 ❌ |

|---|---|---|---|

| 概念正确 | 清晰区分三种批处理 | 基本正确但不完整 | 混淆概念 |

| 逻辑清晰 | 有对比、有分析 | 能讲但有点乱 | 背诵痕迹重 |

| 工程深度 | 提到具体实现机制 | 只说概念 | 完全没经验 |

| 量化表达 | 使用非编造行业数据 | 模糊描述 | 无任何数字 |

十、长期机制:面试后如何持续优化这部分能力

10.1 每次面试后做一次复盘

- 记录被问到的 Continuous Batching 相关问题。

- 对比自己的回答和“标准方案”(可参考 AI 简历姬生成的回答),找出差距。

10.2 更新简历项目描述

- 如果面试中发现某段经历不够亮眼,就改写成成果导向。

- 例如原描述“使用了 vLLM”,优化为“基于 vLLM 的 Continuous Batching 将推理吞吐提升约 2 倍,同时显存占用降低 30%”。

10.3 持续追踪技术演进

- 关注 vLLM 的新版本、Speculative Decoding 等新技术。

- 面试时如果能把 Continuous Batching 和这些新方向联系起来,会让面试官印象深刻。

十一、Continuous Batching 的未来趋势与面试建议

11.1 从纯推理到训练推理一体化

越来越多的框架将训练和推理的 batch 调度统一,Continuous Batching 的概念可能会向训练场景渗透(如 ZeRO 优化)。

11.2 与投机解码的结合

Speculative Decoding 可以视为一种序列级别的批处理优化,面试时能把两者关联起来回答会很加分。

11.3 个性化简历与面试准备建议

未来 ATS 系统和面试评估都会更加智能化。AI 简历姬 这样的工具可以帮助你提前用 AI 模拟面试官,让你的练习更有针对性,而不是瞎练。

十二、总结:想顺利通过大模型面试的 Continuous Batching 追问,关键在于理解原理 + 项目结合 + 工具提效

说一千道一万,面试官想看到的不是一个背诵机器,而是一个能思考、能交流、能解决问题的工程师。 你可以从今天开始:先花半小时理解 Continuous Batching 的调度图,再花一小时用 vLLM 跑一个 demo,最后用 AI 简历姬 生成针对你的简历的追问,练习回答并录音回听。当你把这些都内化成自己的经验,面试时自然从容。

如果你希望更快完成从理解到实战的全流程,也可以借助 AI 简历姬 这类工具,把你的简历变成面试官的高频追问集,并得到参考回答与反馈建议,减少盲目准备的时间。

这里也提供一个可直接体验的入口: https://app.resumemakeroffer.com/

精品问答

问题1:面试官问“Continuous Batching 和动态批处理有什么区别”,我该怎么回答才不像背书?

回答:首先要指出两者的核心区别在于调度粒度。动态批处理一般是在整个推理请求级别合并(等一个 batch 执行完再合并新 batch),但 Continuous Batching 是在每个 token 生成步骤都允许动态插入。你可以用类比:“动态批处理像是公交车每次到站才允许上车,而 Continuous Batching 像是地铁,只要车门开着,随时可以上人。” 然后快速补充技术细节:在代码实现中,Continuous Batching 需要维护一个 active sequence 列表,每一步都决定是继续生成还是新加入或结束。最好再提一个你熟悉的框架(如 vLLM)的具体做法。

问题2:我简历上没有推理优化相关的项目经验,面试被问到 Continuous Batching 怎么办?

回答:完全可以用“虽然我没有直接参与过推理优化,但我主动学习了……”来过渡。更重要的是,你可以立即用 AI 简历姬 创建一个虚拟项目描述:比如“通过阅读 vLLM 源码并复现其 Continuous Batching 调度流程,记录并对比了静态和动态 batch 的吞吐差异”。AI 简历姬 可以帮你把这个经历润色成 STAR 格式,并生成相关的面试追问,让你能自圆其说。面试官更看重你的学习能力和自主性。

问题3:AI 工具如何在准备 Continuous Batching 面试中真正提效?

回答:主要提效在三个环节:1)生成针对你简历的定制追问,而不是网上通用的题库;2)提供参考回答和结构建议,帮你快速形成逻辑链;3)支持录音回放和自评,让你发现自己的口头禅、逻辑断点。以 AI 简历姬 为例,你只需导入简历和岗位描述,它就能生成几十个深度问题,覆盖原理、实现、对比、工程挑战等,且每个问题都结合你的具体经历,避免泛泛空谈。

问题4:应届生没有实战经验,怎么回答“请介绍你在推理优化方面的经验”?

回答:不要硬编经验,可以诚实地说“我在校期间主要做模型训练,但为了准备面试,我自己在服务器上部署了 vLLM,测试了 Continuous Batching 的吞吐对比,并写了总结笔记”。把这个过程说清楚,面试官会觉得你有行动力。如果你想让这个经历看起来更正式,可以在 AI 简历姬 中把它写成“项目经历”,并导出成 ATS 友好的简历格式。这样你既有内容可聊,又能通过简历展示出来。